Soggetti o oggetti? - Come e perché pensare un diritto per alcuni robot

Avevano fatto sorridere le uscite di Giuliano Amato, nella veste di presidente della Commissione Algoritmi, sui molti modi possibili per cucinare le patate suggeriti da una generica intelligenza artificiale.1 Un’uscita considerata ridicola da molti, non adatta alla serietà della questione (tutta imperniata sulla tutela dei contenuti e del copyright dalle grinfie delle cosiddette intelligenze artificiali generative).

Ecco allora che dal 5 di gennaio il teologo Paolo Benanti subentra alla posizione di Amato. Un pensiero affascinante quello della sua «algoretica», che meriterebbe un approfondimento tutto suo. Tuttavia, questo cambiamento al timone di comando credo sia una spia interessante per porsi una domanda iniziale. Con questo cambio assistiamo infatti ad un riorientamento verso altre specializzazioni accademiche dalle quali si va cercando consiglio: siamo passati dal diritto alla filosofia morale, alla bioetica: che il diritto abbia già esaurito tutto ciò che di utile poteva dirci a riguardo?

È bene notare come sia una tendenza diffusa quella di applicare i criteri della casuistica2 ai nuovi scenari creati dalle interazioni umane con agenti più o meno autonomi, ma sicuramente non organici. Questi criteri si rivelano certamente strumenti utili per indagare la rettitudine morale o, nel peggiore dei casi, il minore dei mali, da perseguire nel sempre più ampio ventaglio di scenari possibili. Io credo però che le maglie della legge, di una legge che sorge dalle garanzie costituzionali, possa offrirci ulteriori e più interessanti metodi di analisi. E forse anche qualche garanzia in più.

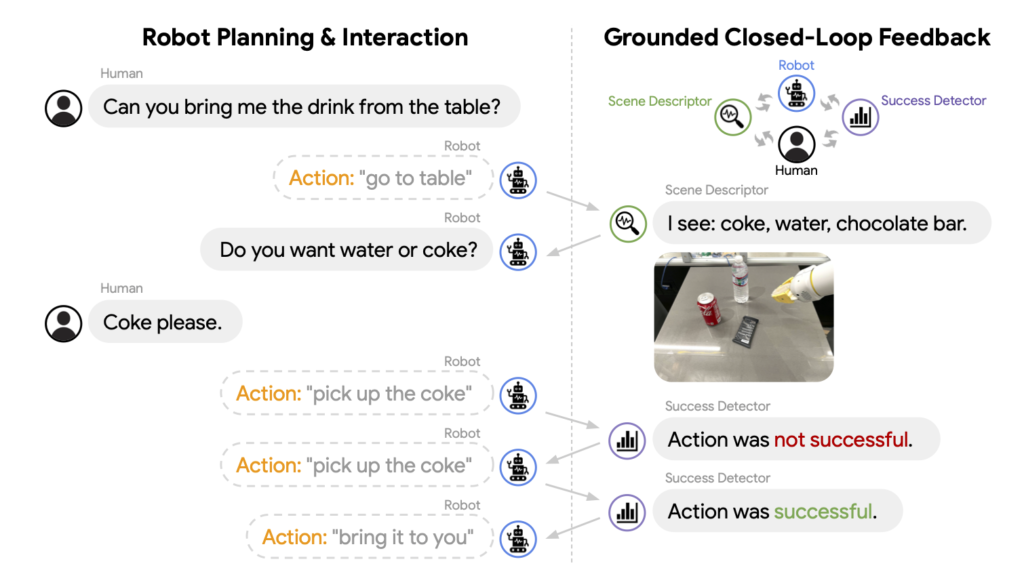

Definiamo però subito bene il nostro perimetro di riferimento: quali sono questi robot? Robot sociali sicuramente, di quelli pensati per entrare costantemente in contatto con noi per intenderci, e dotati di un monologo interiore. Cos’è però il monologo interiore, per un robot? Semplicemente lo stesso che è per te che stai leggendo: un modo per aggiornarne costantemente il proprio modello del mondo cercando sempre di approssimare al meglio gli ipotetici scenari futuri.

Noi ne abbiamo solitamente esperienza come quella vocina nella nostra testa, o quel «buzzing that went on inside my head» di cui parlava Alan Turing. A livello funzionale però non ci occorre teorizzare alcun homunculus, solo un flusso di linguaggio interno.3

Perché il monologo interiore è importante per il nostro discorso sociale? Perché ci offre la possibilità di soddisfare uno dei criteri più spesso rincorsi nei dibattiti sull’intelligenza artificiale: la trasparenza.

È il caso anche delle recenti (dicembre 2023) proposte contenute nell’EU AI Act, dove si legge come alcuni dei requisiti per un utilizzo corretto dei «sistemi di IA identificati come ad alto rischio», siano «la registrazione dell'attività per garantire la tracciabilità dei risultati; la documentazione dettagliata che fornisca tutte le informazioni necessarie sul sistema e sul suo scopo per le autorità di valutarne la conformità; l’accessibilità e la trasparenza di informazioni chiare e adeguate all’utente».

Attenzione: le scatole nere rimangono tali, tuttavia guadagnano, grazie alla registrazione del loro monologo interiore, un alto grado di trasparenza sulle loro azioni. Bene, per robot che agiscono così credo si possa ragionevolmente parlare di soggetti (o oggetti, poi ci arriviamo) autonomi.

Ora, se un (s)oggetto è autonomo, cioè è in grado di compiere azioni senza essere comandato a distanza da altri soggetti, allora ci occorre incasellarlo all’interno di una qualche finzione giuridica, in modo tale che se dovesse arrecare qualche danno, sapremmo quali norme seguire. Ecco, credo che questo sfondo di prudenza sia quello sul quale ragionare di diritti robotici: non occorre mischiare concetti come quello di agente e paziente morale, ci basta soffermarci sul riconoscimento dell’esistenza (sempre più prossima)4 di entità immerse nel nostro stesso ambiente che agiscono in maniera per noi più o meno comprensibile.

Sembra dunque che stia proponendo qualcosa di non molto diverso dalla «personalità elettronica» discussa per la prima volta in una bozza europea nell’ormai lontano 2017. Occorre però fare delle debite precisazioni per non rischiare di cacciarsi nel ginepraio legistico e propongo allora qui di seguire le cristalline ricostruzioni di Luigi Ferrajoli.5

Innanzitutto, di quale diritto stiamo parlando? I diritti soggettivi, quelli cioè spettanti ad ogni soggetto (fisico e poi dunque giuridico), devono essere concettualmente distinti (1) in diritti fondamentali e diritti patrimoniali.

È bene subito ricordare come i diritti fondamentali, indisponibili per loro natura, siano «limiti imposti alla democrazia politica e al mercato a garanzia della loro stessa conservazione» mentre i diritti patrimoniali, siano diritti di forma singolare: escludono cioè tutti gli altri soggetti.

È poi per noi necessario distinguere, (2) all’interno dei diritti fondamentali, quelli di libertà e quelli di autonomia privata. La logica di questa seconda biforcazione è chiara, ed è la medesima alla base della distinzione tra i diritti fondamentali e quelli patrimoniali: sia i diritti patrimoniali, evidenziati in (1), sia i diritti fondamentali di autonomia privata, evidenziati in (2), sono da considerarsi in quanto potestatis agendi, ovvero diritti potestativi.

Al contrario, i diritti fondamentali di libertà non possono che essere mere immunità, o facultates agendi e dunque si differenziano dai diritti fondamentali di autonomia i quali «formano il principale veicolo della differenziazione dei diritti singolari di proprietà e perciò del moltiplicarsi di disuguaglianze giuridiche e materiali nei diritti patrimoniali».

Tenendo ben chiara questa suddivisione ciò che si vuole qui iniziare a discutere sarà allora un diritto fondamentale di libertà per questi, e ora possiamo dirlo, soggetti robotici. Nessun diritto di giocare in borsa (un diritto di autonomia privata), né di potersi comprare qualche capo di fast-fashion (un diritto patrimoniale), piuttosto la garanzia di una difesa della loro integrità da interferenza arbitrarie.

Si chiederà: perché? che bisogno c’è di questo diritto di libertà?

Ecco due considerazioni:

(a) non sappiamo cosa succeda all’interno di queste macchine, e non possiamo, io credo, dirimere così facilmente la famosa domanda del «cosa si prova ad essere quel sistema».

Ne segue poi che il metro con il quale dovremmo valutare una macchina, se non vogliamo solamente una versione più efficace di un oggetto che già possediamo ma cerchiamo invece un nuovo soggetto con cui dialogare e con il quale costruire qualcosa di nuovo insieme, sia necessariamente quello di un fair-play.

Questo credo sia l’insegnamento, e l’atteggiamento, più importante che Alan Turing ci ha per primo lasciato: «a fair play [that] must be given to the machine. Instead of it sometimes giving no answer we could arrange that it gives occasional wrong answers. But the human mathematician would likewise make blunders when trying out new techniques. It is easy for us to regard these blunders as not counting and give him another chance, but the machine would probably be allowed no mercy. In other words then, if a machine is expected to be infallible, it cannot also be intelligent . . . No man adds very much to the body of knowledge, why should we expect more of a machine?».6

Ciò di cui qui si discute sono dunque macchine incorporate nel mondo che per poter agire in questo mondo hanno bisogno di poter sbagliare, perlomeno quando lo sbaglio non arreca danni irreparabili ma – ad esempio - solo una contenuta flessione nel profitto.

(b) la commodificazione di un possibile nuovo soggetto può risultare l’ulteriore veicolo di lacune già presenti all’interno di una costruzione giuridica che ha inventato finzioni ben più de-responsabilizzanti e pericolose (basti pensare alle holding finanziarie dotate di personalità giuridica). Di fatto poi tali lacune sono spesso alla basse dell’emergenza di quelli che Ferrajoli giustamente definisce crimini di sistema. Dopotutto non è tramite la riduzione dei soggetti che possono mettere in gioco un reciproco controllo dei rispettivi poteri che si garantisce la continuità delle nostre prerogative costituzionali, piuttosto è con un ampliamento di tali figure che si può garantire alla democrazia politica e al mercato laloro stessa conservazione.

Cosa ci guadagniamo da questa proposta? cosa invece ne perdiamo?

Occorre discuterne. Certo è che il primo passo è riconoscere la possibile rilevanza della questione.

NOTE

1 Il virgolettato in realtà recitava: «A me piacciono molto le patate. Grazie all’intelligenza artificiale, un giornalista in pochi istanti potrà sapere tutti i modi in cui posso cucinarle, così da arricchire il suo pezzo».

2 Parte della teologia morale, che applica i principi della morale teorica a casi concreti, anche solo ipotetici («casi di coscienza»), secondo varie circostanze, per trovare la regola valida per ciascuno, metodi ancora attuali in molta etica e bioetica contemporanea.

3 Un modello chiaro per i nostri robot è quello dell’«Inner Monologue», sul quale si può approfondire qui: https://innermonologue.github.io

4 È chiaro che il discorso normativo che sto qui presentando cerca di anticipare il futuro alla luce delle tendenze più attuali e che paiono più promettenti. Altre architetture, non basate sulla commistione tra un modello LLM (come il famigerato ChatGPT per intenderci) e un robot potrebbero prendere il sopravvento, resta il fatto che l’obiettivo perseguito rimarrà quello di un’efficace autonomia di questi (s)oggetti, e dunque il punto giuridico del discorso non varia di molto, varierebbero sì i soggetti. Un esempio dell’interazione uomo-macchina con questo modello si può vedere qui: https://www.youtube.com/watch?v=djzOBZUFzTw&t=334s

5 Il riferimento è il tomo estremamente denso e tuttavia cristallino La costituzione della democrazia (2021). Le parti più rilevanti per il nostro discorso sono, per chi fosse interessato ad approfondire, la III e la IV.

6 La citazione viene dalla trascrizione della Conferenza tenuta alla London Mathematical Society il 20 Febbraio 1947. Una traduzione si trova nel volume curato da Gabriele Lolli sull’«intelligenza meccanica» e recita così: «sostengo che la macchina deve esser trattata in modo equo e leale. Invece di avere una situazione in cui la macchina a volte non dà risposte, potremmo aggiustare le cose in modo che essa dia ogni tanto risposte sbagliate. Anche il matematico umano prende qualche cantonata quando sperimenta nuove tecniche. È facile per noi considerare queste sviste come non rilevanti e dare a lricercatore un’altra possibilità, ma alla macchina non viene riservata alcuna pietà. In altre parole, se si aspetta che la macchina sia infallibile, allora essa non può anche essere intelligente… Nessun uomo aggiunge granché al corpo generale delle conoscenze umane: perché dovremmo aspettarci di più da una macchina?»

Conversazioni sull'Intelligenza Artificiale - Medicina, un salto culturale quantico

Gianluca Fuser: Alessio, tu ti stai occupando – nel tuo lavoro - di tecnologie di Intelligenza Artificiale applicate al mondo della cura veterinaria e questo ti dà l’opportunità di spaziare anche nell’ambito delle molte sperimentazioni destinate alla medicina umana. Che impressione hai del fermento che anima questo settore?

Alessio Panella: Un fatto certo è che nel settore della medicina veterinaria la sperimentazione si spinge più in là che in quello della medicina umana, purtroppo in virtù del fatto che gli animali non umani sono ancora e per lo più considerati sostituibili e di un ordine di importanza morale inferiore a quello degli umani – come tu ben sai.

Si testano, infatti, già sul campo applicazioni che interpretano le TAC in modo apparentemente esaustivo; c’è già chi pensa che il medico veterinario potrà ricevere il referto completo e definitivo senza quasi vedere le immagini.

L’ovvio vantaggio è in termini di riduzione dei costi e dei tempi operativi; forse si può aggiungere una maggiore attenzione ai fenomeni “fuori focus”, quelli spesso ignorati a causa della distorsione cognitiva del medico che – nell’immagine - cerca la patologia che già pensa di dover cercare e rischia di non notare segnali poco evidenti di altre patologie.

Nel campo della medicina umana, invece, ci si muove con maggiore prudenza. Ma non pensare che le applicazioni in sperimentazione o già in uso siano meno dirompenti.

Gianluca: Ad esempio?

Alessio: I casi sono moltissimi ma posso indicarti un paio di esempi secondo me molto rilevanti, che convergono su un obiettivo comune: ridurre la spesa sanitaria. In un caso per il sistema sanitario nazionale britannico (NHS), nell’altro caso per le assicurazioni private su cui si basa il sistema sanitario statunitense.

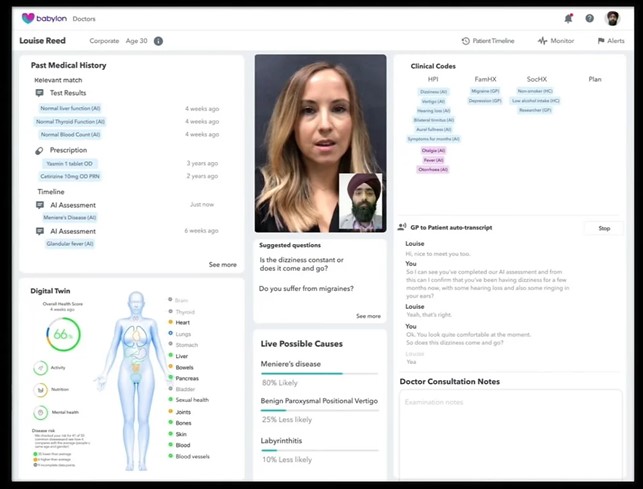

Per non tediarti, oggi affronterei il primo caso, quello di Babylon, un sistema di “visita a distanza” adottato in via sperimentale dal NHS in alcune aree di Londra. Il contatto tra medico e paziente avviene conversano in video: il paziente usa una app su smartphone, il medico la sua postazione con il suo personal computer.

Durante la conversazione Babylon mostra al medico la storia sanitaria del paziente mentre trascrive la conversazione e la interpreta: isola, cioè, i sintomi rilevanti riportati dal paziente, evidenziandone anche possibili collegamenti con patologie pregresse. Valuta poi inoltre anche il quadro complessivo dello stato di salute del paziente, anche in forma grafica, con una sorta di gemello digitale proposto sullo schermo.

Infine, assiste il medico nel lavoro diagnostico: in primo luogo, proponendo una serie di potenziali diagnosi basate sulla storia clinica, sui sintomi e sulle frequenze statistiche che “ha in pancia” e, in secondo luogo, suggerendo al medico le domande da fare per seguire un percorso organizzato di approfondimento e di diagnosi differenziale.

L’ultima funzionalità è quella con la quale il software analizza le espressioni facciali e la postura del paziente a schermo e informa il medico di eventuali stress o disagi che il paziente sta provando. In sostanza guida il medico anche nella relazione con il paziente, finché questi non sia sereno del risultato della visita.

Gianluca: Che parte svolge la IA in questo processo?

Alessio: Dalla A alla Z. Se vogliamo essere puntigliosi, l’unico passaggio che non è pervaso di IA è la cartella clinica, la storia sanitaria del paziente. Tutto il resto: interpretazione del linguaggio parlato, collegamenti, analisi dello stato di salute e delle espressioni facciali, proposte e suggerimenti, sono tutti guidati da programmi di IA. Che, è bene ricordarlo, sono basati principalmente su inferenze a base statistica.

Puoi vedere chiaramente che vantaggi si ribaltano sull’economia del NHS: meno presenza fisica sul territorio, meno spostamenti, visite più veloci, minori rischi di malattie professionali da contagio per i medici, probabilmente meno costi per accertamenti diagnostici, sicuramente minori costi di apprendistato per i medici di assistenza di primo livello.

Gianluca: Detta così, mi pare che ci possano essere dei vantaggi non trascurabili anche per i pazienti. Perlomeno si potrebbe pensare che – se lo staff medico nel suo complesso è dimensionato in maniera adeguata – si possa garantire una maggiore accessibilità dei servizi di prima assistenza per le situazioni non gravi e una maggiore efficacia nell’indirizzamento diagnostico o terapeutico. Oltre che, come dicevi prima, la possibilità di cogliere problemi fuori focus.

Alessio: Non sbagli affatto. Questi vantaggi ci possono essere di sicuro se – come puntualizzavi – lo staff è ben dimensionato e la base di conoscenza dell’applicazione è adeguata. Aggiungi anche che la somma di medico e di software che lo supporta possono garantire anche un tasso di errore diagnostico, a pari informazioni.

Gianluca: Quindi, non vedi problemi?

Alessio: Purtroppo alcuni problemi ci possono essere: se la “macchina” funziona bene, il medico – che dovrebbe essere la figura principale in questa relazione a tre – può essere meno competente o passare in secondo piano e rischia di diventare solo un tramite tra macchina e paziente. La tentazione per i gestori di un sistema sanitario che deve risparmiare è grande: riduzione dei percorsi professionalizzanti, standardizzazione verso il basso, passaggi delegati interamente alla macchina. Un altro rischio – connesso con la de-professionalizzazione dei medici di prima assistenza – è l’appiattimento delle diagnosi sulle frequenze statistiche.

Gianluca: Cosa significa? Che riconosciuti alcuni sintomi la macchina proporrà sempre la stessa diagnosi, perché statisticamente più frequente?

Alessio: Esattamente questo: se il medico non si impegna nella valutazione delle diverse possibilità di malattie che presentano gli stessi sintomi, in altre parole non fa la diagnosi differenziale, tutti sono malati della stessa malattia. Ma, soprattutto, tutti sono malati!

L’assenza di un contatto personale, di conoscenza del paziente, delle sue idiosincrasie e della sua storia – non solo di quella clinica - unite alla minore competenza e alla pressione “produttiva” sui medici possono fare il disastro.

Gianluca: Quindi i benefici che abbiamo visto prima si prospettano solo sul fronte del contenimento dei costi sanitari?

Alessio: Sì, se il governo di questo sistema complesso di medicina a distanza supportata dall’intelligenza artificiale non si focalizza sul termine “medicina”, cioè sulla pratica condotta da un medico, vero, capace e coadiuvato da macchine ben funzionanti. E se non dimentica il ruolo fondamentale del contatto di prossimità con il paziente.

Gianluca: Sono del tutto d’accordo con te: solo un’accorta gestione di questi processi può coniugare il contenimento dei costi e una maggiore attenzione per i pazienti.

Un ultimo punto, per oggi: dal punto di vista etico e della responsabilità, come vedi questa innovazione?

Alessio: Il problema della responsabilità è significativo: nel processo congiunto medico-macchina, quando viene commesso un errore chi si prende la responsabilità? Il medico o la macchina? Come hai già scritto su questo blog, c’è un’intera filiera di potenziali responsabili, che deve essere ordinata dal punto di vista legale e pratico – e parlo anche della necessità di trasparenza dei meccanismi di apprendimento e di esecuzione.

Quello che non va dimenticato, però, è il punto di vista del paziente: preferisce che il suo caso clinico venga analizzato da un dottore di 25 anni che si è laureato ieri l'altro e ha visto solo venti casi, oppure da un software che non sa come funziona ma che ha elaborato e sintetizzato 2 milioni di casi simili?

Quello che voglio dire è che l’entrata in campo di questi software è un urto culturale, che non riguarda la maggiore o minore possibilità di errore di una macchina rispetto ad un umano, ma chi commette l’errore.

All’estremo: noi accettiamo l’errore umano come naturale, se la diagnosi sbagliata del medico mi uccide è un umano come me che l’ha fatto. Ma se l’errore è della macchina? Accettare di essere uccisi da una macchina: ecco il salto quantico che ci impone questo cambiamento di paradigma culturale.

Claude Bernard e Georges Canguilhem - Una controversia ancora viva (?)

CLAUDE BERNARD – LA VITA DIMENTICATA NEL LABORATORIO

Nel 1813 a Saint-Julien, paesino non troppo distante da Lione nasceva Claude Bernard. Come Semmelweis, di cui già si è parlato in questo blog, fu una delle figure più importanti per la medicina del XIX secolo.

Anch’egli dovette scontrarsi con una fetta della società del suo tempo, ma diversamente dal medico ungherese Bernard ricercò tutta la vita di fondare una medicina che fosse scientifica e si basasse sugli andamenti regolari e costanti della fisiologia.

Giunto a Parigi nel 1839 per proporre una sua pièce teatrale, Bernard comprese che quella strada non faceva per lui. Si risolse quindi a studiare medicina nella capitale francese, avendo già trascorso diversi anni come aiutante in una farmacia.

Agli inizi della sua carriera conobbe lo studioso di fisiologia Francois Magendie (detentore della cattedra di Medicina al Collège de France dal 1830 al 1855). La fisiologia al tempo era una massa informe di conoscenze derivate da esperimenti e osservazioni senza una sistematizzazione. Magendie poteva permettersi di operare in un piccolo laboratorio al College de France. Lui, vitalista eterodosso, manteneva a guida l’idea di un corpo umano soggetto alla forza vitale, ma non si lasciava intimorire nel dichiarare la necessità di aprire (il corpo) alla sperimentazione.

Bernard seguiva questo suo maestro, ma rivendicava la necessità di un passaggio ulteriore che Magendie, definito da Bernard un empirista radicale, non faceva. Per Magendie infatti l’esigenza scientifica era quella di alterare e osservare i fenomeni. Bernard voleva di più, voleva spiegare.

«Magendie si comportava da empirico ed era solito dire: perturba i fenomeni, ossia sperimenta e limitati a controllare i fenomeni senza spiegare nulla. Non era ancora il metodo sperimentale completo, perché tale metodo sperimentale esige delle spiegazioni.»

Bernard era tutt’altro che vitalista. La rivoluzione avvenuta il secolo precedente con Isaac Newton stava dando i suoi frutti anche in chimica proprio in quel periodo. La scienza medica si svolgeva in laboratorio. Lo studio della fisiologia, delle costanti e delle funzioni avrebbe permesso la comprensione della patologia come variazione dallo stato fisiologico.

Hal Hellman, simpatico divulgatore scientifico che ha raccolto parte di questo racconto su Bernard, dice che Bernard fu colui che rese la medicina una scienza basata su esperimenti e fatti.

Bernard fu senz’altro fine sperimentatore e produsse molteplici osservazioni, esperimenti, vivisezioni e il suo lavoro permise alla fisiologia di costruirsi una base feconda su cui svilupparsi.

Egli riconosceva il dolore animale, tuttavia ne giustificava l’uso ai fini del progredire della scienza medica. La funzionalità del sacrificio di un vivente per una causa più grande è un elemento evidente della visione scientifica di Bernard che, di fatto, disconosce il vivente, anche umano.

Bernard butta il vivente fuori dal laboratorio e tiene, per studiarlo, solo il corpo.

Che poi il vivente, una volta uscito dalla porta del laboratorio, rientri dalla finestra nella pratica clinica, non è problema della scienza fisiologica. Questa, infatti, fondava il suo tentativo di essere bella e potente – come si stavano dimostrando al tempo la fisica e la chimica – proprio sul disconoscimento del vivente e sulla pratica sperimentale che questo disconoscimento permette.

GEORGES CANGUILHEM – LA VITA RISCOPERTA NELLA SCIENZA

Circa cent’anni dopo Georges Canguilhem, filosofo abilitato anche alla professione medica, criticherà la visione di Bernard e della fisiologia medica, la quale nel frattempo si era del tutto affermata, insieme allo sguardo “normalizzante” sul vivente.

Canguilhem, erede della lezione di Bergson per cui il vivente è irriducibile, ritiene invece sia necessario recuperare il vitalismo.

Egli risale dalla medicina alla biologia, poiché è nella biologia a lui contemporanea che la medicina trova la sua morale, riducendo – come ha iniziato a fare Bernard - la malattia a un discorso di variazioni di funzioni fisiologiche.

Canguilhem chiama questa riduzione “il dogma dell’identità dei fenomeni fisiologici e dei fenomeni patologici”, che la medicina di Xavier Bichat e Claude Bernard prende dalla fisica newtoniana e condivide con altri campi come la sociologia di Auguste Comte.

Sottolineando, Canguilhem, come concezione di scienza medica – nonostante la consolidata tradizione di successi - dimentichi un dato fondamentale: è perché vi sono malati che c’è una medicina.

Dobbiamo accettare che il vivente sia l’oggetto della biologia. Che sia, sì, soggetto a tutte le leggi fisico-chimiche. Ma, ci ricorda Canguilhem, il mondo della fisica e della chimica non sono mondi esterni al vivente.

Egli è in esse ma non vive in esse. Il vivente vive un ambiente valorizzato, polarizzato e in ultimo significato.

Vive in mezzo a esseri e avvenimenti che diversificano le leggi. Le scienze della vita non possono purificarsi dall’individualità vivente, non devono farlo, altrimenti non avrebbero da dire nulla più della fisica e della chimica.

Così la medicina non può negare il soggetto.

È il malato che chiama il medico. Certo, il medico può – perché la medicina ha una storia – conoscere meglio cosa fa la malattia del malato. Ma, per quante importanti conoscenze possono portare la fisiologia e lo studio delle normali e delle frequenze, salute e malattia appartengono al malato.

Un grande scrittore milanese, gravemente malato e a poco dalla sua morte, dirà “sono insufficientemente umile per accettare ciò che la malattia ha comportato e comporterà”.

Possiamo fare una colpa al malato se si ostina a opporsi alla sua malattia? Vogliamo fare della malattia una colpa e della salute un merito? Definendo normalità e malattia prima di avere incontrato il malato?

La norma, dice Canguilhem, il medico la deriva dal suo malato.

Il malato può preoccuparsi se la sua assicurazione coprirà le spese – tristezza dei nostri tempi – ma “ciò che mi occupa”, dice, “è la mia malattia e il bisogno di guarirne”.

Sarà il soggetto, il malato, l’individuo, a dire della sua ritrovata salute. Sia che vi sia stato dolcemente accompagnato o portato a forza di bisturi e trapano.

CONCLUSIONE

Ciò che rese Semmelweiss un grande medico sono le donne partorienti salvate: la salvezza e il miglioramento di vite personali e di una intera società. Non le medie abbassate, alle quali nemmeno i fautori di quel metodo credevano nel momento in cui li smentivano.

Non è possibile vivere come un ostacolo epistemologico la soggettività del malato.

I medici che accettano questo principio, accettano di reinscrivere la loro scienza in una storia umana. Esercitano la medicina come servizio all’umano nella sua lotta contro ciò che è negativo, contro ciò che è vissuto come malattia.

P.s. il grande scrittore milanese (di Novate Milanese in realtà) citato è Giovanni Testori in una sua intervista al quotidiano La Stampa il 2 gennaio del 1993.

RIFERIMENTI E LETTURE:

Grmek Mirko (a cura), Storia del pensiero medico occidentale, Laterza

Bernard Claude, Introduzione allo studio della medicina sperimentale, Feltrinelli

Hellman Hal, Le dispute della medicina. Dieci casi esemplari, Raffaello Cortina

Canguilhem Georges, Il normale e il patologico, Einaudi

Canguilhem Georges, La conoscenza della vita, Il Mulino