Covid, tecnocrazia e "vera" politica - Due progetti paralleli

Dalle prime due parti (qui, la prima parte e qui, la seconda parte) dell’analisi degli algoritmi di valutazione dell'andamento della pandemia, ad aprile 2020, è emerso che questi algoritmi sono un caso solo apparente di tecnocrazia.

In realtà, abbiamo visto che:

- il tentativo di rendere gli algoritmi completi ha generato un eccesso di complessità che ha reso questi strumenti praticamente inservibili ai fini della decisione sulla Fase 2

- la decisione di passare alla Fase 2 è stata principalmente politica, seppur basata su un set minimale di dati scientifici, limitato ai trend di contagi, decessi e di saturazione delle terapie intensive.

Ora, questo non toglie che la relazione tra scienziati e governo abbia effettivamente avuto un carattere tecnocratico già nel primo periodo della pandemia[1], tra febbraio e maggio 2020.

Per comprendere la reale portata ed estensione di questo carattere tecnocratico faremo alcune brevi considerazioni su:

- il CTS e la rilevanza del valore della salute nella gestione della crisi

- il ruolo che ha giocato il CTS nei processi di decisione del governo

Vedremo che il governo ha preso le sue decisioni in modo principalmente politico ma, invece, ha lasciato ampio spazio a scienziati e tecnici sul come metterle in atto.

COS’ERA E COME FUNZIONAVA IL COMITATO MEDICO SCIENTIFICO

La presenza del CTS nel processo di decisione del Governo ha, certamente, amplificato il ruolo dei valori di salute e di sopravvivenza come condizioni di possibilità del bene comune e, quindi, ha condizionato le azioni del governo nella direzione di “prima la salute”.

Infatti:

- il ruolo del CTS era di dare consulenza al Capo del Dipartimento della Protezione Civile – e più tardi direttamente al Governo – su come fronteggiare la diffusione del contagio;

- i componenti del CTS erano “esperti e qualificati rappresentati degli Enti e Amministrazioni dello Stato”, di fatto 8 componenti su 12 erano medici: i tre presidenti del Consiglio superiore di sanità, dell'Istituto superiore di sanità e dell’AIFA, un professore di patologia clinica e di comunità, un esperto di medicina delle catastrofi, un infettivologo e un epidemiologico.

- Il CTS era sempre – ogni giorno, al mattino molto presto – l’iniziatore del processo di decisione. Era il CTS a effettuare la sintesi e il vaglio delle informazioni raccolte dal fronte del contagio e a prepararsi, sulla base dei dati, a dare consiglio al Capo della Protezione civile e ai rappresentanti del Governo, in primis al Ministro della Salute;

- spesso, il CTS agiva in coda al processo, assumendo la funzione di supporto e di legittimazione delle decisioni prese: i membri del CTS partecipavano e parlavano alle conferenze stampa e ai talk show fornendo elementi di spiegazione e di sostegno alle misure restrittive o meno del Governo.

Ora, per disciplina, per etica procedurale, la salute è il faro guida del medico, soprattutto in termini di assenza di malattia, di normale funzionamento del corpo, «Dovere del medico è la tutela della vita, della salute fisica e psichica dell'Uomo e il sollievo dalla sofferenza» (Codice di Deontologia Medica, all’Art. 3 – Doveri del Medico).

Ne risulta abbastanza ovvio che il CTS - un consesso di medici - si sia concentrato sui pilastri deontologici, guarire chi si è ammalato, garantire il funzionamento delle strutture di cura e, in caso di infettività, prevenire e controllare la diffusione della malattia.

Altrettanto ovvio appare il fatto che il Governo, consigliato e sostenuto dal CTS abbia posto i valori della salute e della sopravvivenza biologica al primo posto della propria scala assiologica nell’affrontare la crisi.

È interessante, peraltro, vedere che paesi iper-liberisti come Inghilterra e Brasile, in cui non c’era nulla di simile al nostro CTS, si siano, invece, orientati più nettamente sui valori della sussistenza economica delle imprese, del paese in generale e di conseguenza dei cittadini, mettendo in conto «un numero evitabile di persone contagiate e di morti» (Habermas J., Proteggere la vita, tr. It. D’Aniello F., Società editrice Il Mulino, 2022, p. 51); è famosa l’infelice frase di Boris Johnson: «many more families are going to lose loved ones before their time».

TECNOCRAZIA O NO?

Si ripropone quindi la domanda: Il Governo ha davvero preso delle decisioni, ha fatto delle scelte morali[2], oppure chi le ha fatte è stato il CTS?

Prima di provare a dare una risposta va ricordato che la più grande partita di decisioni si è giocata sul campo dell’economia, quello degli aiuti e dei sostegni economici.

Su questo campo il governo ha preso delle posizioni, ha compiuto delle vere e proprie scelte morali, basate su dei criteri e su una assiologia chiari; una assiologia che ha determinato la destinazione e i tempi dei sostegni economici, a chi prima e a chi dopo, a chi di più e a chi di meno. La scala di priorità è stata inizialmente concentrata sui lavoratori dipendenti delle imprese medio-grandi, quelle in grado di accedere alla cassa integrazione guadagni, per intenderci ed è poi cambiata, per rispettare le istanze di giustizia sociale portate avanti dalle opposizioni: occhio ai dimenticati dei primi momenti – tra cui liberi professionisti, lavoratori autonomi e microimprese.

Fatta questa premessa, proviamo a focalizzare quale sia stato il rapporto tra CTS e Governo nei primi mesi; l’analisi[3] di documenti video, di verbali e di decreti mostra che:

- è fuori di dubbio che il Governo abbia fatto delle scelte morali sul tema della salvaguardia della salute e della sopravvivenza. Il Governo ha delineato una scala di valori e questi valori li ha contestualizzati nel particolare della situazione che andava affrontando.

- È altrettanto fuori di dubbio che, nel costruire questa priorità di valori che vede salute e sopravvivenza in alto, il governo sia stato influenzato dal CTS – soprattutto dalla componente medica. Però, è emerso anche che la storia personale dei leader di governo, la tradizione di partito, le esperienze fatte, abbiano avuto un ruolo determinante

- Dove, invece, il Governo è stato molto più influenzato dal CTS sembra essere stato nel COME realizzare la tutela della salute e della vita. In questo, la vera scelta del governo è stata di affidarsi a tecnici, ai medici, agli epidemiologi. Lo dice Conte in passaggio chiarissimo il 25 di febbraio.[4]

- È evidente che la scelta di affidarsi a scienziati e tecnici è stata fatta sulla base del criterio delle competenze mediche e tecniche del CTS.

Quindi, sul come gestire la crisi, come salvaguardare la salute, il governo ha scelto di affidarsi, consapevolmente, a quelli che riteneva competenti e questo delinea palesemente una forma di tecnocrazia indiretta. Il processo analisi – sintesi – decisione – legittimazione in cui il CTS è dominante in tre passaggi su quattro ne è conferma.

Ma, ricordiamolo, all’inizio nessuno sapeva cosa stesse accadendo, né capiva cosa potesse accadere e, in quel momento di emergenza, il fattore tempo sembrava essere determinante[5].

Così come – in un momento successivo - ha fatto affidando a un militare la logistica della distribuzione dei vaccini. In Italia solo i militari hanno competenze logistico-operative e piani già pronti di quel tipo. Nessun altro. Non avrebbe potuto farlo un tecnico degli acquisti come Arcuri (bravo a reperire materiali con contratti emergenziali a prova di bomba).

Che poi il CTS abbia seguito delle linee super consolidate e tradizionali come l’ospedalizzazione sempre e comunque, la rinuncia alle cure domiciliari, linee che trovano una impressionante analogia nel Diario della Peste di Defoe – parliamo del 1665 – è altra cosa, su cui non credo di poter dare giudizi. Mi tengo dei sospetti.

Quindi, in conclusione, siamo stati di fronte ad una forma di solo parziale tecnocrazia, in cui il governo ha mantenuto per sé la prerogativa delle decisioni politiche sul cosa fare per gestire la crisi sanitaria ed economica, in termini di priorità, quantità, destinazioni, inclusioni ed esclusioni, ma ha ceduto sovranità alla scienza e alla tecnica sul come perseguire a questi obiettivi.

NOTE

[1] Non considero quello che è successo nei mesi successivi, con le due seconde ondate, quella di riaperture e quella di contagi dell’autunno 2020, del secondo lockdown, dei vaccini, del green pass e delle varie misure interdittive.

[2] Scelta morale: decisione su come orientare la propria condotta pratica basata su una scala di priorità tra principi o valori, appunto, morali.

[3] Le fonti sono i discorsi pubblici del Presidente de Consiglio e dei diversi Ministri – reperibili facilmente su YouTube o sul sito della Presidenza del Consiglio, i testi dei Decreti del presidente del Consiglio, i Decreti Ministeriali, le circolari della Protezione Civile, ecc.. Chi volesse avere un’ampia bibliografia e sitografia può chiederla alla Redazione di Controversie.

[4] Le parole di G. Conte: «io non ho competenza scientifica in questo campo, non ho alcuna competenza, e sarebbe presuntuoso […] sopravanzare e sovrapporsi a […] quelle che sono le valutazioni tecnico-scientifiche […] loro hanno articolato quelli che sono tutti i comportamenti e sono raccomandazioni indicazioni rivolte al personale sanitario e ovviamente a tutti i cittadini» (Conferenza stampa del Presidente Conte dalla Protezione civile, YouTube - Palazzo Chigi, Canale ufficiale del Governo italiano, 25 febbraio 2020 (https://www.youtube.com/watch?v=gWJoo8O6mZ8))

[5] Il problema del confronto con una situazione in cui «i fatti sono incerti, la posta in gioco alta, i valori in conflitto, e le decisioni urgenti» è affrontato dalle raccomandazioni della Scienza Post Normale; rimandiamo a Saltelli, A., 2024, SCIENZA POST-NORMALE, XI Appendice dell’Enciclopedia Italiana di Scienze, Lettere ed Arti, Istituto della Enciclopedia Italiana, Roma - https://www.researchgate.net/publication/387296164

L’arte di fare attenzione nel tempo delle catastrofi - Il pensiero di Isabelle Stengers

Nel suo libro Nel tempo delle catastrofi (2021, Rosemberg & Sellier), Isabelle Stengers, una delle più importanti filosofe della scienza contemporanee, propone in maniera divulgativa una serie di riflessioni che tentano di delineare una connessione tra il pensiero ecologista e quello femminista. Ciò che emerge dalla lettura, è che entrambi gli approcci non sono solo intimamente connessi, fino a rappresentare due facce della stessa medaglia, riguardo ai problemi che sollevano e agli scopi che si prefiggono, ma nella loro più profonda essenza sono accomunati perché esprimono anche una radicale rivalutazione – e archiviazione – della narrazione del progresso, nella sua duplice veste di obbiettivo delle scienze (incluse quelle sociali, e sì, anche delle humanities) e indiscusso fine economico.

Più precisamente quindi, è attraverso la mobilitazione di diverse prospettive – epistemologica, di genere e di ecologia politica – e mostrando esplicitamente l’impossibilità di scindere l’una dalle altre, che l’autrice elabora la propria proposta per riformare le scienze secondo una concezione del sapere fortemente democratica e anticlassista. Questo allo scopo precipuo di «imparare l’arte di fare attenzione», come lei dice, nel nuovo regime climatico in cui Gaia ha fatto irruzione, costringendoci a pensare e a convivere con le minacce ecologiche che mettono in crisi il nostro modello di civiltà[1].

Stengers, infatti, argomenta che per potersi dire davvero «obiettori della crescita», occorre mettere in discussione proprio «quali idee usiamo per pensare altre idee», come direbbe l’antropologa Marilyn Strathern, perché queste inficiano la possibilità di affermare una forma di organizzazione sociale veramente plurale e sostenibile, oltre che un controllo orizzontale e diffuso del sapere e della tecnica.

Per farlo quindi, la storica della scienza esamina la genealogia del pensiero moderno, a partire dalla scoperta dei «fatti sperimentali», come delle entità che acquisiscono la capacità di prefigurare il modo in cui essi stessi devono essere interpretati. Acquisendo dunque una certa autonomia nel far pensare e dirigere gli esseri umani che li hanno fabbricati. Un’autonomia che però, come illustra appunto l’autrice, è andata sempre più trasformandosi in indipendenza:

«Tuttavia, chi ha scoperto che una simile riuscita era possibile, Galileo, si è affrettato a generalizzarla, vale a dire a trasformare la riuscita (riuscire a produrre un tipo di fatto che “provi”) in metodo (inchinarsi davanti ai fatti). Gli diventava così possibile contrapporre la nuova ragione scientifica, che riconosce autorità ai soli fatti, all’attitudine di chiunque prenda posizione riguardo questioni indecidibili, che conferiscono potere alle sue convinzioni o ai suoi pregiudizi. Questa messa in scena è senza dubbio una delle operazioni di propaganda meglio riuscite nella storia umana, se è vero che essa è stata ripresa e ratificata anche da parte dei filosofi – sebbene essi stessi ne risultassero spogliati della loro pretesa all’autorità. Certi vanno ancora oggi ripetendo il giudizio lapidario di Gaston Bachelard: ‘In linea di principio, l’opinione ha sempre torto. L’opinione pensa male; anzi, non pensa; traduce dei bisogni in conoscenze’. Che questo giudizio sia stato emesso in un libro intitolato La formazione dello spirito scientifico è una circostanza capace di testimoniare di una logica profonda. Un tale “spirito scientifico” è definibile solo in contrapposizione a qualcosa che sarebbe “non scientifico” – e ciò vale anche quando qualcuno si crede intelligente a invertire specularmente il significato di questa opposizione, attribuendo alla “gente” una ricchezza soggettiva o emozionale di cui sarebbe invece privo lo spirito scientifico, freddo, calcolatore e razionale» (Cit. p. 88).

Si sviluppa così una prima contrapposizione fra i gruppi di esperti (conoscitori di prima mano dei fatti naturali) e i profani, cioè tutti gli altri che vivrebbero nell’ignoranza rispetto a questi fatti, o peggio ancora nel disorientamento in base a bias culturali da correggere – che quindi corrisponde a una distinzione di ceto, stabilito in base alla scolarizzazione e professionalizzazione del sapere. A questa antitesi si aggiunge la naturalizzazione di questi fatti, che porta anche a oscurare le domande (cioè l’opportunità o meno di una scoperta o un’invenzione, in base al gruppo che la richiede e le sue esigenze), gli strumenti, il lavoro, le numerose prove ed errori, e il finanziamento che li hanno generati e le conseguenze che ne derivano. E si perviene quindi alla etero-direzione della società da parte di «fatti che parlano da soli», capaci di imporre valori e fini alla collettività senza che la formazione del loro determinismo possa essere messa in discussione.

L’invenzione della natura e dei fatti come entità esterne alla società e al regno della cultura, o più precisamente dell’oggettività, in quanto referenza indipendente dalla sua opinabile realizzazione a partire da soggetti incarnati che la generano, si propone come termine ultimo e insindacabile per la risoluzione di tutte le controversie, scientifiche, economiche e politiche; da essa discende la predisposizione di acritiche “parole d’ordine” che favoriscono e allo stesso tempo deresponsabilizzano coloro che le pronunciano.

Dal determinismo scientifico e tecnologico a quello economico il passo è breve; dove la realizzazione del valore di un bene e la sua commercializzazione è conseguentemente effettuata prescindendo – o circoscrivendo – da tutta la sfera di elementi possibili che contribuiscono a realizzarlo. Come l’estrazione e trasformazione di “risorse” non-umane da un lato, ma anche e soprattutto dal lavoro negletto di cura e riproduzione della vita necessaria alla creazione dei beni, che è stato storicamente svolto dalle donne.

Prendiamo ad esempio la diffusione dell’etichetta «l’era dell’Intelligenza Artificiale», che sentiamo ripetere costantemente come un mantra da entusiasti tecnofili, per forzarci ad accettare come un fatto compiuto un programma simil-totalitario di politiche sociali e culturali, basato sul preteso successo di un prodotto che in realtà è ancora indefinito e limitato proprio perché basato su un software chiuso, quale appannaggio esclusivo delle poche imprese che lo sviluppano: si tratta di un piano che parte dal bisogno di giustificare la gestione accentrata delle enormi quantità di dati che queste raccolgono, mentre rimane sottaciuto l’importante impatto ecologico dei loro servizi e prodotti[2]. Tuttavia, il successo del software è notevolmente ridimensionato – e ridicolizzato – non solo perché non rappresenta un fatto compiuto dalle vesti immateriali, ma anche da quanto riportato da Oxfam, cioè che il lavoro di cura non retribuito svolto dalle donne di tutto il mondo, varrebbe almeno tre volte il valore dell’industria delle stesse big tech, così da aver provocatoriamente nominato il suo rapporto “l’era della cura”[3].

In questo senso, si vede come la natura come entità disponibile e appropriabile – perché considerata esterna ai condizionamenti della società, che infatti dovrebbe semplicemente limitarsi ad “allocare al meglio le risorse scarse” – si rifletta nell’oggettivazione della donna come “risorsa” gratuita, remissiva e liberamente sfruttabile. Così, la figura dello scienziato ricalca quella del capitalista nella loro estrazione di ricchezza che rimane irresponsabile nei confronti delle loro sorgenti di valore. Ovvero, gli attaccamenti ecologici generativi necessari per la vita.

La scienza maschile si basa così su una soggettività virtuale del ricercatore che, quasi non avesse avuto bisogno di nascere ed essere nutrito, esprime uno «sguardo da nessun luogo» su un universo concepito come res extensa da conquistare progressivamente e da cui estrarre profitto[4]. In maniera profondamente differente, i saperi situati femminili non hanno invece direzione prestabilita, ma sentono il bisogno di radicarsi nel rizoma dei legami terrestri da cui dipendono, e di favorire la loro prosperità.

In effetti, al contrario dei quei barbari che tentano di lasciare il pianeta, per andare a conquistarne altri, o degli altri che con atteggiamento disfattista si sentono inermi rispetto all’apocalisse, questi tipi di conoscenze tentano precisamente di «avere luogo» e di «riferirsi a qualcuno», coltivando l’arte di fare attenzione alle entità neglette che compartecipano alla nostra sfera di esistenza particolare e di cui ignoriamo l’importanza favorendo le condizioni per l’abitabilità. Basti pensare alle catastrofi ambientali che si fanno sempre più tragiche e impellenti, mostrando tutta la nostra incomprensione e incuranza delle connessioni ecologiche da cui dipendiamo che ne sono all’origine.

Riprendendo quindi per concludere un altro passaggio dell’autrice, che si tratti di saperi «altri» o non-umani, che definisce «pratici», a partire dal riferimento pragmatico a ciò che li rende tali, ovvero il lavoro attorno ad una causa che impegna a pensare e ad agire in comune,

«ciò che ho tentato di fare nel caso particolare della ricerca scientifica e della valutazione dei ricercatori, è di pensare a partire da ciò che manca, da ciò di cui la mancanza ci rende malati, così critici e lucidi quanto vogliamo, ma crucialmente incapaci di resistere a ciò che ci distrugge. Sapersi malati, è creare un senso del possibile – non sappiamo ciò che avrebbe potuto essere, ciò che potrà essere la strana avventura delle scienze moderne, ma sappiamo che «fare di più» di quello che abbiamo l’abitudine di fare non sarà sufficiente a permetterci di comprenderla. Si tratta di disimparare la rassegnazione più o meno cinica (realista) e di ridivenire sensibili a ciò che forse sappiamo, ma in modo anestetizzato. È qui che la parola lentezza, così come è utilizzata dai movimenti slow, risulta adeguata: la rapidità domanda e crea l’insensibilità a tutto ciò che potrebbe rallentare, alle frizioni, ai contrasti, alle esitazioni che fanno sentire che non siamo soli al mondo; rallentare è ridivenire capaci di apprendere, di fare conoscenza con, di riconoscere ciò che ci sostiene e ci fa prosperare, di pensare e di immaginare, e, nello stesso processo, di creare insieme ad altri dei rapporti che non siano di cattura; si tratta quindi di creare fra noi e insieme ad altri il tipo di rapporto che si conviene fra malati, che hanno bisogno gli uni degli altri al fine di riapprendere gli uni con gli altri, tramite gli altri, grazie agli altri, che domandano una vita degna di essere vissuta, dei saperi degni di essere coltivati» (Stengers I. (2013), Une autre science est possible! Manifeste pour un ralentissement des sciences, La Découverte, Paris, p. 82).

NOTE

[1] Cfr. La politica dopo l’emergere di Gaia, il migliore dei mondi possibili, Controversie, 12/03/2024

[2] Scrive così Francesco Cara su Altreconomia in un articolo del 28 maggio 2024: «esiste una percezione diffusa secondo la quale il digitale è virtuale e immateriale e quindi non produce impatti ambientali significativi in termini di sfruttamento delle risorse, inquinamento, emissioni climalteranti e rifiuti. Nel libro “Ecologia digitale” abbiamo mostrato come il digitale, inteso come sistema costituito da centri di calcolo, reti di trasmissione e dispositivi, sia in realtà altamente energivoro, emissivo e idrovoro; grande consumatore di metalli rari e allo stesso tempo grande produttore di rifiuti. Immersi nel mondo delle rappresentazioni digitali, si tende infatti a dimenticare che il livello simbolico del settore, dove qualunque testo, immagine, video, brano musicale viene tradotto in sequenze di stati binari: Off (0) e On (1), poggi su segnali elettrici che scorrono su circuiti elettronici. Per ricevere l’informazione, archiviarla, trattarla e trasmetterla, il sistema digitale necessita quindi di materiali con caratteristiche conduttive ed elettromagnetiche particolari, di microprocessori molto impattanti, e di una fornitura ininterrotta di elettricità. Inoltre, il flusso elettrico disperde calore che, nei centri di calcolo, viene gestito con l’ausilio di sistemi di raffreddamento che, a loro volta, richiedono materiali, lavorazioni, elettricità e acqua. E lo stesso discorso vale per le reti di trasmissione dati». Disponibile al link: https://altreconomia.it/lecologia-digitale-alla-prova-dellintelligenza-artificiale-generativa/

[3] Cfr. Oxfam (2020), Time to Care: Unpaid and underpaid care work and the global inequality crisis. Disponibile al link: https://oxfam.dk/documents/analyser/davos/rapport_time-to-care-inequality-200120-embargo-en.pdf

[4] Cfr. Clarke A., Haraway D. (2022), Making Kin. Fare parentele, non popolazioni, DeriveApprodi, Roma

Deskilling e Diverse Skilling - La trasformazione delle competenze nell'era digitale

L'innovazione tecnologica ha rivoluzionato il nostro modo di vivere e lavorare, delegando molte attività a strumenti digitali. L'adozione di queste tecnologie genera due importanti dinamiche che impattano le competenze umane: il fenomeno del deskilling e quello del diverse skilling.

Da un lato, il deskilling indica la perdita di competenze necessarie a svolgere un'azione, che viene – invece - affidata a una macchina. Dall'altro lato, il diverse skilling sottolinea la trasformazione delle competenze del fare in quelle dell'uso e della gestione della macchina che fa.

IL FENOMENO DEL DESKILLING

Il termine deskilling indica la progressiva perdita delle competenze necessarie a svolgere un'attività specifica, fenomeno che si verifica quando un'azione che era abitualmente eseguita da una persona umana viene completamente delegata a uno strumento tecnico o tecnologico. In particolare, nel corso di questo XXI secolo, si tratta di strumenti di automazione digitali.

Un esempio emblematico è quello della calcolatrice: l'introduzione di questo strumento ha ridotto la necessità di eseguire calcoli complessi manualmente. Analogamente, i sistemi di navigazione satellitare hanno reso quasi superflua la capacità di leggere mappe o orientarsi con elementi naturali.

In ambito lavorativo, il deskilling è maggiormente evidente nei settori industriali oggetto di processi di progressiva automazione, settori in cui operai - che un tempo padroneggiavano procedure complesse - ora supervisionano processi gestiti da robot; oppure nei settori dei servizi, in cui numerose attività svolte tradizionalmente da umani – come, ad esempio, l’assistenza ai clienti – iniziano ad essere gestite da bot[1], sistemi automatici digitali che trovano spesso applicazione nelle chat o nei numeri telefonici di assistenza ai clienti: trascrivono e interpretano il linguaggio naturale parlato o scritto, estraggono i riferimenti delle richieste e provano (spesso senza successo, va detto) a dare delle risposte.

Questo fenomeno ha conseguenze significative sia sui processi che sui lavoratori . Da un lato, possono aumentare l'efficienza e ridurre gli errori; dall'altro, portano – sicuramente - ad una progressiva dipendenza dagli strumenti utilizzati e all’oblio delle competenze che permettono ad un umano di fare quel lavoro.

La perdita di competenze pratiche, quelle del fare può avere effetti devastanti: dal punto di vista industriale, infatti,

- riduce la comprensione del processo, in cui l’azione dello strumento, diventato una black box in cui viene immesso qualcosa e che produce qualcosa di diverso, viene data per scontata

- diminuisce la possibilità di integrazione umana manuale in caso di errori o di malfunzionamenti

- segrega le conoscenze di come funziona il passo di processo automatizzato tra gli esperti della tecnologia, del progettare (informatici, meccanici, fisici, chimici) che hanno progettato l’automatismo e che, frequentemente, non partecipano per nulla al processo produttivo, togliendole – invece - a chi il processo produttivo lo vede o lo gestisce quotidianamente

- riduce, quindi, la possibilità di miglioramento della qualità del prodotto – che continua a dipendere dal processo di realizzazione – ai soli momento di re-engineering istituzionalizzato, perdendo il contributo degli esperti del fare, operai e impiegati

Dal lato di chi lavora, invece, riduce l'autonomia dell'individuo, del lavoratore, annulla il valore del suo contributo professionale, e può generare significative ripercussioni sul piano psicologico e sociale.

IL CONTRAPPESO DEL DIVERSE SKILLING

In contrapposizione al deskilling, il diverse skilling è la traslazione delle competenze dall'esecuzione diretta di un compito ,il fare, alla gestione dello strumento che lo compie. Questo fenomeno non implica la perdita totale delle abilità, ma una loro trasformazione e adattamento.

Tornando agli esempi precedenti, l'uso di una calcolatrice richiede la comprensione dei meccanismi logici sottostanti, così come l'interpretazione di dati forniti da un sistema di navigazione richiede la capacità di valutare le condizioni reali del contesto.

In ambito lavorativo, l'automazione può portare gli operai a sviluppare competenze di monitoraggio e di manutenzione delle tecnologie di automazione i sistemi, rendendo necessarie conoscenze più avanzate, come quelle informatiche o ingegneristiche.

Un caso esemplare è stato quello della vulcanizzazione degli pneumatici: negli anni ’80, in una grande azienda industriale italiana, le attività manuali – svolte dai caposquadra – di pianificazione della produzione, delle singole macchine vulcanizzatrici, seguite – in corso di produzione – dalle vere e proprie attività di preparazione e di attrezzaggio delle macchine, sono state sostituite da sistemi informatici che permettevano di effettuare una programmazione efficace ed efficiente per la giornata o la settimana e – sulla base del conteggio automatizzato dei pezzi e delle attività, indicavano al capoturno sulla consolle di controllo quando fosse opportuno intervenire per la manutenzione oppure per il cambio di attrezzaggio programmato per una diversa lavorazione.

In questo caso, il personale ha potuto intervenire nella fase di progettazione per dare le necessarie indicazioni competenziali a chi progettava i sensori, i contatori e il software, in fase di test per controllare se il funzionamento dell’automatismo fosse in linea con le indicazioni e le esigenze e, infine, ha completato la traslazione competenziale con corsi di formazione che hanno permesso alle operaie e agli operai di gestire in autonomia i sistemi automatici e di dare indicazioni su come migliorarne il funzionamento nel tempo.

Il diverse skilling rappresenta, quindi, una forma di resilienza umana all'innovazione tecnologica. Mentre alcune competenze si perdono, altre vengono acquisite, spesso più complesse e specializzate. Questo fenomeno può favorire una maggiore produttività e migliorare la qualità del lavoro, ma non è privo di sfide: la transizione richiede risorse significative in termini di formazione e adattamento culturale e rappresenta – probabilmente – un importante cambiamento sociale guidato delle rivoluzioni tecnologiche.

UN CONFRONTO CRITICO

Il confronto tra deskilling e diverse skilling solleva interrogativi sulla direzione e sulle conseguenze del cosiddetto progresso tecnologico.

Da un lato, il deskilling è un rischio per la sostenibilità delle competenze umane, soprattutto quando interi settori lavorativi si trasformano rapidamente, lasciando molte persone senza le capacità necessarie per adattarsi.

Dall'altro, il diverse skilling dimostra che il cambiamento tecnologico può non annullare le competenze, ma – sotto alcune condizioni – può favorirne un riallineamento verso nuove frontiere di apprendimento.

Il punto di equilibrio – o di crisi - sta certamente nell'accessibilità: non tutti gli individui e non tutti i contesti sociali sono in grado di affrontare il passaggio dal deskilling al diverse skilling.

La focalizzazione delle imprese sull’incremento di efficienza, che va sempre letto come riduzione dei costi di produzione e contestuale aumento della produttività, spesso non contempla investimenti volti a ridurre le lateralità della trasformazione tecnologica.

Questo significa minori opportunità di formazione e infrastrutture dedicate alla transizione verso un diverse skilling e, come conseguenza, amplifica le disuguaglianze, creando una società divisa tra chi detiene le nuove tecnologie, chi le padroneggia e chi ne è escluso.

Nel mondo delle imprese si sente dire che “non si progredisce senza cambiare”, ma il cambiamento è una trasformazione che – purtroppo - non è alla portata di tutti e - spesso - non è portatore di maggiore benessere.

Ad esempio, in settori come la medicina o l'ingegneria, affidarsi completamente alla tecnologia senza mantenere competenze critiche e intuitive può avere conseguenze disastrose.

CONCLUSIONI

Il deskilling e il diverse skilling non sono – quindi - fenomeni mutuamente esclusivi, ma due facce della stessa medaglia. Mentre il primo evidenzia i rischi di una delega eccessiva alla tecnologia, il secondo dimostra la capacità dell’umano di adattarsi e innovarsi, migliorando di fatto la qualità delle sfide che affronta.

Per massimizzare i benefici e minimizzare i rischi, è essenziale – però – che gli innovatori promuovano strategie formative e lavorative che facilitino il diverse skilling, senza trascurare l'importanza delle competenze di base.

In un mondo sempre più automatizzato, il futuro del lavoro e dell'apprendimento dipenderà dalla capacità di bilanciare innovazione tecnologica e adattamento delle abilità umane. Solo così sarà possibile costruire una società in cui la tecnologia sia uno strumento di emancipazione e non di alienazione.

NOTE

[1] I bot sono sistemi automatici digitali che trovano spesso applicazione nelle chat o nei numeri telefonici di assistenza ai clienti: trascrivono e interpretano il linguaggio naturale parlato o scritto, estraggono i riferimenti delle richieste e provano a dare delle risposte.

Gli algoritmi del Covid-19. Un caso di tecnocrazia? - Seconda parte

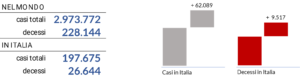

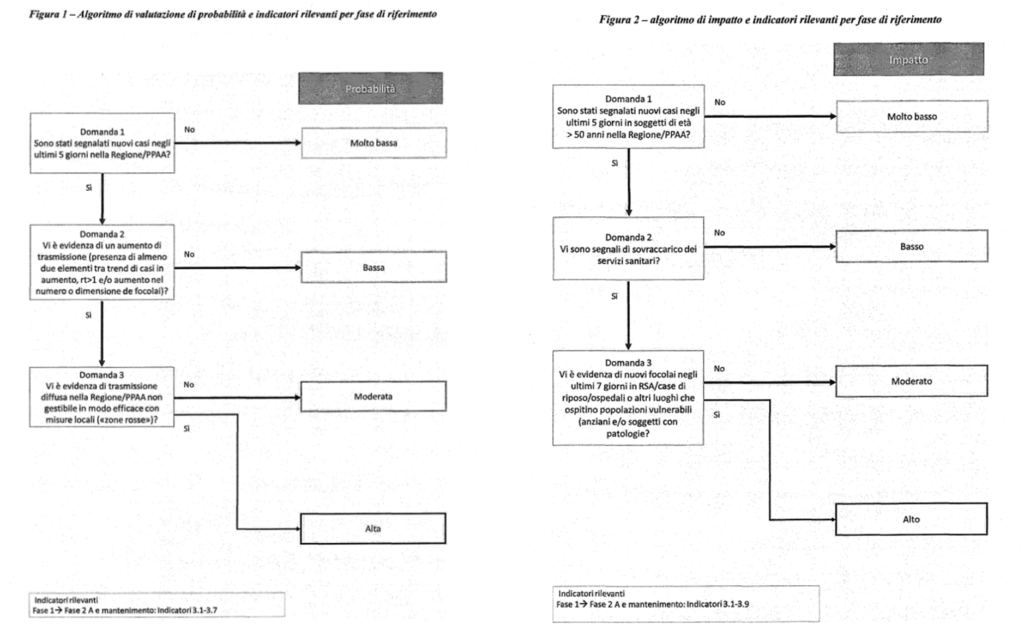

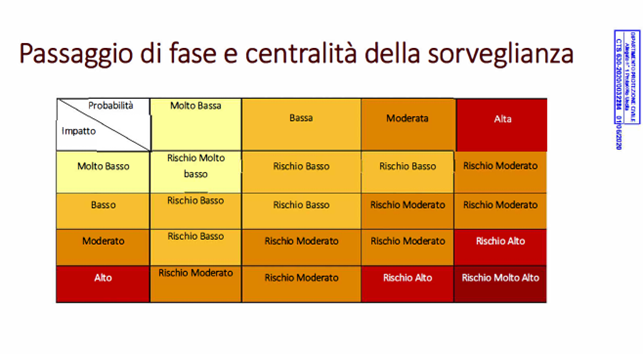

Nella prima parte di questo percorso abbiamo esaminato i meccanismi algoritmici che avrebbero dovuto guidare il Governo Conte nelle decisioni sull’allentamento delle misure restrittive e di contenimento del contagio da SARS-CO-V-2.

Ora possiamo fare un passo in avanti nell’analisi critica degli strumenti di valutazione e sul loro ruolo nelle decisioni del Governo.

CONSISTENZA DEGLI INDICATORI

Nell’intenzione del Ministero della Salute e del Governo – e del Comitato Tecnico Scientifico che ha messo a punto i criteri e gli algoritmi – questi strumenti di valutazione del contagio e delle possibilità di contrastarlo dovrebbero essere il più possibile esatti, coerenti, oggettivi e indipendenti dalle interferenze politiche, e guidare il governo in modo sicuro e incontrovertibile verso la decisione “scientificamente” più corretta.

Di fatto, invece, il sistema di valutazione presenta delle aree di criticabilità metodologica, dei punti di debolezza e di incoerenza – soprattutto considerando il particolare momento in cui deve essere utilizzato - e risente di alcune evidenti influenze di tipo storico, sociale e politico che ne minano le attese di esattezza, oggettività e indipendenza.

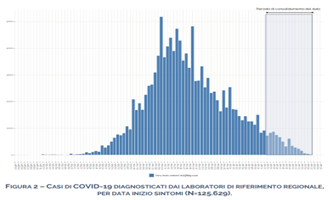

Tra queste criticità, spicca che alcuni degli indicatori della capacità di monitoraggio[1] sono statisticamente poco indicativi in un momento in cui la capacità diagnostica è fortemente sottodimensionata. In questo particolare periodo la propensione italiana alla diagnosi con tampone è tra le più basse d’Europa (pur con una percentuale di positivi molto più alta degli altri paesi). Parliamo di una media di soli 88 tamponi per 100.000 abitanti al giorno.[2] Ne viene particolarmente inficiato il riferimento alla percentuale di casi segnalati con indicata la data di inizio dei sintomi e/o il comune di domicilio del caso stesso. Quello che questo indicatore misura effettivamente è un sottoinsieme non rappresentativo della situazione reale.

Un discorso simile vale per gli indicatori sulla capacità di accertamento diagnostico., in particolar modo per quelli relativi ai tempi tra inizio dei sintomi, diagnosi e isolamento. Per le ragioni appena viste di scarsa propensione “al tampone”, il numero di diagnosi effettuate e segnalate è sicuramente molto inferiore ai casi realmente presenti sul territorio; d’altro canto, l’indicatore – in questo periodo - non può che essere “fuori soglia”, a causa del meccanismo per lo più carente di prescrizione, prenotazione ed esecuzione del test diagnostico, che dilata enormemente i tempi tra inizio dei sintomi e diagnosi.

Un altro punto di caduta è rappresentato dagli indicatori sull’impegno di personale dedicato al tracciamento e al monitoraggio dei contatti oltre che alle operazioni di prelievo e invio dei test ai laboratori Un impegno che dovrebbe essere in linea con raccomandazioni Europee relative agli standard su numero, tipologia e ore di lavoro.

Un indicatore metodologicamente confuso, poiché mette insieme “mele con pere” (le mele sono l’impegno di contact-tracing, le pere l’impegno di gestione del processo di invio ai laboratori), con contorni poco chiari: il termine tipologia figure professionali è di difficile interpretazione in assenza di un elenco chiuso e condiviso di tipologie; il valore di riferimento per l’impegno pari a 1 operatore equivalente ogni 10.000 abitanti[3] (verbalizzato al CTS il 29 di maggio) cioè almeno 750 operatori per la sola area del milanese, ma, di nuovo, senza indicazioni su che tipologie di figure professionali debbano essere impiegate.

Inutile parlare della percentuale di casi confermati di infezione nella regione per cui sia stata effettuata una regolare indagine epidemiologica con ricerca dei contatti stretti: è un indicatore importante ma decisamente fuori contesto nella situazione di aprile – maggio 2020, in cui il Sistema Sanitario rincorre a distanza con i pochi mezzi disponibili l’evolversi del contagio. Lo stesso vale per i parametri di trasmissione che implicano l’analisi dei focolai e delle catene di trasmissione. Entrambi gli indicatori risultano incongrui nella situazione di aprile e maggio 2020.

Gli indicatori sulla stabilità della trasmissione sembrano essere più consistenti e aderenti al contesto: in linea generale, il trend dei casi segnalati alla Protezione Civile e al sistema integrato di sorveglianza sono sicuramente rappresentativi dell’andamento del contagio, anche se probabilmente sottostimano il fenomeno e risentono – nella componente di temporalità – dei difetti procedurali già visti. L’indicatore dei casi segnalati alla Sentinella COVID-Net è opzionale e – di fatto – non attuato, come non sembra essere mai stata attuata la rete-sentinella.

Un discorso a parte andrebbe fatto – ma non è questa la sede - per il parametro Rt, uno strumento che sembra essere metodologicamente valido solo se i significati di alcuni suoi parametri[4] vengono usati con cautela.

UNA QUESTIONE DI POLITICA SANITARIA: GLI INDICATORI DI OSPEDALIZZAZIONE

Nel terzo gruppo di indicatori – quello dei parametri di trasmissione e di tenuta dei servizi sanitari, troviamo il Tasso di occupazione della Terapia Intensiva, con la soglia accettabile del 30%, e il Tasso di occupazione dei posti letto in Area Medica per pazienti COVID-19, con una soglia di accettabilità del 40%. Questi due parametri sono sintomatici dell’approccio di ospedalizzazione che caratterizza la gestione del contagio in Italia: quello che preoccupa il CTS e il Ministero è se gli ospedali sono in grado di sostenere il flusso di malati da ricoverare, ignorando completamente – anche negli indicatori oltre che nella pratica – il ruolo della medicina territoriale, della terapia domiciliare (attuata solo sporadicamente in poche regioni) e della relativa sorveglianza. Di fatto, chi è malato e ha sintomi preoccupanti deve andare in ospedale; chi, invece, è malato e non va in ospedale è sostanzialmente lasciato a sé stesso; non è interessante – per la valutazione dell’andamento della pandemia – avere dati sulla consistenza del presidio medico territoriale e domiciliare: il focus è l’ospedale.

INCOERENZE INTERNE DEL SISTEMA DI VALUTAZIONE E DI ALLERTA?

È curioso notare che l’algoritmo di valutazione del rischio è contenuto nello stesso documento dei 21 indicatori puntuali e di trend, ma – in realtà – fa riferimento solo al terzo gruppo di indicatori, quelli sulla trasmissione del contagio e sulla tenuta della risposta sanitaria (ospedaliera, s’intende) e include dei criteri di valutazione che esulano dai 21 indicatori - ad esempio, la gestibilità o meno della diffusione con “zone rosse” localizzate, oppure l’età (oltre i 50 anni) dei soggetti contagiati.

Lo sviluppo dell’algoritmo di calcolo del livello di rischio – nonostante sia un sistema di allarme per la “marcia indietro” verso misure di controllo più rigorose - sembra essere slegato da due terzi degli indicatori e assai riduttivo rispetto a quello per valutare la possibilità di transizione alla Fase 2.

Sembra che l’allerta e la marcia indietro tengano conto della sola misura dei fenomeni e non della loro misurabilità; come dire: non importa se i dati non sono affidabili, si decide su quelli.

D’altra parte, è pur vero che il sistema di calcolo prevede che – in caso di difficoltà o scarsa affidabilità delle misurazioni – ci si attesti su una condizione di rischio elevato e si imponga la “marcia indietro”.

In conclusione, dall’esame di dettaglio, si evidenziano numerosi punti deboli, in sintesi:

- scarsa indicatività statistica di una buona parte degli indicatori relativi alla capacità di monitoraggio e di accertamento diagnostico

- incongruenza di altri indicatori rispetto al contesto in cui sono applicati e, quindi alla loro effettiva utilizzabilità

- visione focalizzata sulle procedure di ospedalizzazione dei parametri di tenuta dei servizi sanitari e assistenziali

- incoerenza di alcuni passi dell’algoritmo di valutazione del rischio rispetto all’insieme di indicatori di processo e di risultato e la scarsa integrazione tra i due algoritmi

SIAMO DI FRONTE AD UN CASO DI SCIENTIFIZZAZIONE DELLA POLITICA?

Lo strumento di valutazione del tasso di rischio e delle condizioni di possibilità della transizione alla Fase 2, che il Comitato Tecnico Scientifico fornisce al Ministero della Salute e al Governo, composto dal set di 21 indicatori e dai due algoritmi, è molto articolato, apparente non troppo complesso da maneggiare e sembra cogliere un range ampio e abbastanza completo di punti di attenzione per la valutazione dello stato del contagio. La sua struttura rispecchia gli obiettivi di esattezza, coerenza, oggettività e indipendenza dalle interferenze politiche e sociali, per guidare l’azione politica in modo sicuro verso decisioni “scientificamente” corrette.

È chiaro che si tratta di un caso di tentata scientifizzazione della politica:

- le decisioni – se viene usato lo strumento per come è costruito – possono essere appaltate alla “scienza” e non tenere conto di variabili socialmente rilevanti quali, per fare un esempio, le esigenze di continuità del reddito o di socializzazione

- le indicazioni dello strumento sono basate su indicatori molto generali, che non tengono conto della stratificazione di età, di condizioni di salute (fa eccezione il > 50 anni dell’algoritmo della probabilità) e sociali.

- La visione dell’intervento è ristretta alla dimensione di ospedalizzazione e ignora tutti fenomeni e le possibilità di intervento e di azione sul territorio

- La scarsissima condivisione pubblica della strumentazione di osservazione e algoritmica, disponibile solo a prezzo di una ricerca approfondita tra i Decreti e i relativi allegati, denuncia una scarsa propensione della “scienza ufficiale” alla discussione pubblica.

In questo quadro, la “scienza medica ed epidemiologica” apparentemente neutrale ed oggettiva ma, come abbiamo visto, orientata alla semplificazione dei fenomeni, cieca alle sue dimensioni sociali e storicamente focalizzata sull’ospedalizzazione, sembra “catturare e guidare” la politica, portando i decisori ad abdicare al loro ruolo guida.

Tuttavia,

- le debolezze del sistema di misurazione, che lo rendono una cattedrale teoretica nel deserto epistemologico della pandemia del primo semestre 2020, con utilizzabilità estremamente limitata, salvo accontentarsi dei pochi indicatori effettivamente misurabili,

- e la mancata applicazione della regola che avrebbe imposto lo stop alla transizione a causa della valutazione di rischio elevato in caso di non misurabilità degli indicatori

hanno favorito un maggiore grado di libertà e di movimento da parte dei decisori politici.

Il governo italiano e il Presidente del Consiglio Conte hanno, infatti, dimostrato – forse solo nel caso delle riaperture del 4 e 18 maggio 2020 – di riuscire ad essere svincolati[5] dalla scientifizzazione e hanno deciso, di fatto, sulla base di una aperta dialettica tra le istanze morali della salute da un lato e della sopravvivenza economica dall’altro.

Le riaperture “limitate” del DPCM del 26 aprile[6] e il relativo controllo dello stato dei contagi sono state, quindi, il risultato di compromesso tra le istanze normative della medicina e la sintesi tra le due posizioni di stampo decisamente politico del governo e delle opposizioni[7].

NOTE

[1] Ad esempio, la percentuale di casi segnalati con indicata la data di inizio dei sintomi e/o il comune di domicili

[2] Cfr. Analisi Gimbe dei tamponi effettuati dalle Regioni nel periodo 22 aprile – 6 maggio 2020, in Franco Pesaresi, Tamponi: quanti se ne fanno e quanti ne servono, Welforum, Osservatorio Nazionale sulle politiche sociali, 14 maggio 2020

[3] Fonte: Verbale n. 83, 29 maggio 2020, Riunione del Comitato Tecnico Scientifico, Dipartimento della Protezione Civile

[4] la relativa isteresi rispetto al fenomeno, i problemi di distorsione del ricordo dell’insorgenza dei sintomi, la sua dubbia significatività per dare atto della velocità di diffusione o della virulenza di un agente infettivo in contesti di densità di popolazione diversa

[5] Questa conclusione non tiene in considerazione le decisioni del periodo successivo, in particolare quelle relative alle campagne di vaccinazione e al green pass, capitoli molto delicati sul tema della subordinazione della politica alla scienza.

[6] Si veda qui il testo del DCPM 26 aprile 2020

[7] Ne parlo diffusamente nella mia Tesi Magistrale Le scelte morali del governo italiano durante la prima parte della crisi pandemica del 2020.

Harari e il tradimento degli intellettuali - Il darwinismo algoritmico in Nexus

1. ROVESCI

Uno dei colpi di scena più riusciti della saga di Star Wars è il momento in cui il protagonista, Luke Skywalker, scopre di essere figlio dell’antagonista malvagio, Darth Vader. I modelli della fantascienza devono essere presi molto sul serio, perché gran parte dei personaggi più influenti della Silicon Valley tendono a progettare le loro piattaforme, e persino a immaginare il futuro dell’umanità, ricalcandole sui contenuti dei film, delle serie e dei romanzi che hanno dominato la loro eterna adolescenza da nerd: Larry Page e Sundar Pichai (ex e attuale CEO di Google) hanno dichiarato a più riprese che l’obiettivo del loro motore di ricerca è emulare il computer di bordo dell’Enterprise della serie Star Trek.

Ad evocare il dramma dell’agnizione di Luke Skywalker questa volta però non è il fondatore di qualche impresa miliardaria nell’area di San Francisco Bay, ma il volume appena pubblicato da uno degli esponenti più stimati del pensiero liberal, molto amato dalla sinistra americana e internazionale, Yuval Noah Harari. Nexus riepiloga e approfondisce le riflessioni che l’autore ha elaborato a partire da Homo Deus (uscito nel 2016) sul futuro della nostra specie.

Gli assunti con cui Harari inquadra la condizione umana potrebbero essere stati redatti da un ideologo del transumanesimo tanto di moda nella Silicon Valley, come Ray Kurzweil. Qualunque animale, e noi non facciamo eccezione, può essere descritto come una macchina, riducibile a dinamiche fisiche e chimiche, e a strutture comportamentali dettate da algoritmi. La coscienza, la soggettività, la felicità e lo sconforto, sono l’esito di reazioni tra molecole, e possono quindi essere eccitati o sedati da pastiglie che la ricerca scientifica renderà sempre più efficaci. Le indagini di uno dei più grandi divulgatori della realtà clinica e culturale della depressione, Andrew Salomon, contraddicono la baldanza farmacologica di Harari, insistendo sullo strano anello che si instaura tra la fisiologia, gli eventi della vita, e qualcosa di nebuloso e profondo che è identico, ma allo stesso tempo si oppone, alla chiarezza di biologia e biografia.

Nexus non è interessato a questo genere di sottigliezze, dal momento che il percorso della storia è stato tratteggiato nella sua regola generale già un paio di libri fa: al termine del Medioevo l’uomo ha rinunciato al senso dell’universo, preferendogli il potere di programmarlo a proprio piacimento. Le religioni consegnavano ai nostri antenati una posizione centrale nel cosmo e un significato per la vita degli individui e per le comunità – ma pretendevano in cambio l’obbedienza a valori e norme fondate su un’autorità intransigente. L’emancipazione da ogni forma di trascendenza, e dalle sue declinazioni nelle istituzioni politiche e culturali, ha inaugurato un percorso in cui la scienza e la tecnologia sono arrivate a sovrapporsi e a coincidere, per convertire il mondo in un serbatoio di risorse a disposizione della felicità degli uomini. Purtroppo, la farmacopea è solo il simbolo di questa trasformazione, dal momento che la dissoluzione dell’aura sacra che avvolgeva la natura alimenta l’industria delle sostanze psicotrope, ma non offre alcuna indicazione sullo scopo della nostra vita. Possiamo fare tutto liberamente, ma non abbiamo più una ragione per fare qualcosa.

2. ALGORITMI

Quando i significati iscritti nel creato dileguano, il loro posto viene occupato dall’informazione, che si assume il compito di esprimere l’essenza del meccanismo cui sono ridotti gli esseri viventi e le loro società. L’opposizione tra democrazia e totalitarismo, che ricalca la distinzione tra mondo liberale e paesi comunisti, può essere ricondotta nella sua sostanza alla differenza morfologica tra sistemi di comunicazione. La dittatura, e il socialismo, sono configurazioni sociali in cui l’informazione è centralizzata, e irradia da un punto focale che identifica il leader, o l’élite burocratica dello stato. Al contrario la democrazia, e la dottrina liberale, prediligono una forma decentrata di circolazione dell’informazione, che abilita la nascita di molti poli di accesso alle notizie e di molti livelli di elaborazione, decisione, riproduzione dei dati e della conoscenza. L’informazione è l’asset che stabilisce relazioni tra elementi, parti, individui, gruppi: la ricostruzione dei suoi percorsi permette di disegnare le reti in cui si sintetizzano i composti nella dimensione fisica e chimica, prendono vita i processi biologici negli individui, si costituiscono le comunità nel mondo sociale e si dipanano i sentieri della storia. Per questo la nozione di algoritmo diventa pervasiva, e Harari riepiloga il corso completo dell’evoluzione come un percorso di elaborazione di algoritmi sempre migliori, che trovano la sintesi più efficiente in quelli che compongono l’uomo. Questo vantaggio spiega l’ordine universale, che coincide con la conversione della natura e di tutti i suoi membri in una riserva di mezzi di cui possiamo disporre per la nostra utilità. La violenza che esercitiamo con la manipolazione tecnica non è motivata dall’ostilità contro particolari enti animati o inanimati, o dal bisogno di protezione, ma è l’esito della nostra indifferenza nei confronti di tutto quello che non può resistere alla trasformazione del mondo in un ambiente a misura della funzionalità antropologica. Un altro modo per esprimere questa condizione è il giudizio che la ristrutturazione del pianeta operata dagli algoritmi da cui è governato il comportamento degli uomini sia un processo ineluttabile, una necessità imposta dall’evoluzione naturale.

Le nozioni cui ricorre Harari annullano la separazione tra natura e tecnica. Informazione e algoritmi definiscono la struttura della realtà e le meccaniche del funzionamento di qualunque cosa, accomunando physis e techne in un’unica essenza e in un unico destino. Ma questa impostazione non può esimersi dal prevedere che nel momento in cui le prestazioni raggiunte dalle macchine supereranno le nostre, l’atteggiamento che i robot assumeranno nei nostri confronti applicherà le stesse logiche di utilità e indifferenza che noi abbiamo riservato ad animali e minerali. Il passaggio di questa soglia si chiama singolarità, e nella visione di Harari è talmente prossimo da dominare la valutazione della tecnologia che già oggi stiamo maneggiando. L’intelligenza artificiale guida l’autonomia dei dispositivi in cui si compie il salto evolutivo che segue e trascende quello della nostra specie, e che è destinato a sostituirci nel dominio del mondo: da vent’anni Ray Kurzweil ha insegnato a scandire le tappe che conducono al momento in cui i sistemi di calcolo raggiungeranno le facoltà di intuizione dell’uomo, e le travalicheranno con la corsa alla superintelligenza pronosticata e temuta da Nick Bostrom. Possiamo tentare di frenare, arginare, controllare lo sviluppo delle tecnologie digitali, ma Harari ci lascia presagire che in fondo si tratta di operazioni di retroguardia – e alla fine comunque un Darth Vader, nella forma di un Google o di un ChatGPT iper-evoluto, sciabolerà la sua spada laser in cloud e metterà fine alla resistenza della sopravanzata soggettività umana al di qua del monitor e della tastiera.

3. FINE DELLA STORIA

Elon Musk non avrebbe saputo costruire un’argomentazione migliore per giustificare la subordinazione della dimensione politica al neoliberismo tecnologico contemporaneo, e per affermare l’inesorabilità di questo processo. Pur avendo irriso per anni la tesi della fine della storia di Francis Fukuyama, l’élite di sinistra l’ha introiettata in fondo al proprio inconscio culturale, insieme alla convinzione che la globalizzazione del mercato – e i rottami di democrazia che l’accompagnano – siano la forma compiuta dello Spirito Oggettivo hegeliano nelle istituzioni umane. Harari mostra lo stato di completo disarmo concettuale in cui versa la classe intellettuale, che si proclama progressista, nei confronti delle narrazioni del «realismo capitalista» e del transumanesimo di stampo californiano. Oltre all’ingenuità con cui vengono trattati i temi della tecnologia, la questione dell’intelligenza artificiale forte, il rapporto tra biologia e coscienza – il nodo critico più preoccupante rimane il fatto che «è più facile immaginare la fine del mondo che la fine del capitalismo» nella sua versione priva di pensiero e di futuro, che caratterizza la civiltà contemporanea. Harari condivide con Margareth Thatcher la convinzione che «non ci sono alternative» allo smantellamento di qualunque percorso politico che non sia l’adattamento alla rapacità di dati e di ricchezze da parte dei monopolisti della Silicon Valley, e di qualunque prospettiva storica divergente dall’ideologia transumanista, che vede nella transustanziazione in una macchina l’apogeo dell’umanità.

Ma se alle fantasie del cyberpunk, alla comunità degli estropiani, e persino alla corsa verso la singolarità di Kurzweil, si può riconoscere la spontaneità e l’euforia di un movimento nerd che si reputa sempre adolescenziale e che perpetua acne e turbe puberali – sulla corazza dello scientismo di Harari grava il tradimento di un Darth Vader che avrebbe potuto, e avrebbe dovuto, ricorrere alle proprie risorse intellettuali per denunciare la clausura della narrazione tecnocapitalista, e cercare un percorso diverso. Invece si è consacrato al lato oscuro della banalità.

BIBLIOGRAFIA

Bostrom, Nick, Superintelligence: Paths, Dangers, Strategies, Oxford University Press, Oxford 2014.

Fisher, Mark, Capitalist Realism: Is There No Alternative?, John Hunt Publishing, Londra 2009.

Fukuyama, Francis, The End of History and the Last Man, Free Press, New York 1992.

Harari, Yuval Noah, Homo Deus: A Brief History of Tomorrow, Harvill Secker, Londra 2016.

-- Nexus: A Brief History of Information Networks from the Stone Age to AI, Random House, New York 2024.

Kurzweil, Ray, The Singularity Is Near: When Humans Transcend Biology, Viking Press, New York 2005.

O’Connell, Mark, To Be a Machine: Adventures Among Cyborgs, Utopians, Hackers, and the Futurists Solving the Modest Problem of Death, Granta Publications, Londra 2017

Solomon, Andrew, The Noonday Demon: An Atlas of Depression, Simon & Schuster, New York 2001.

Decalogo Latouriano – Il pensiero meno noto di Bruno Latour, Terza parte

La prima e la seconda parte del percorso latouriano hanno toccato:

- il legame profondo tra oggetti della scienza e società, in cui – secondo Latour – sono i primi a spiegare la seconda (il sociale, la società e la sociologia)

- la critica di Latour alle sociologie interpretative, all’empirismo storico, al riduzionismo e –ovviamente – al positivismo, dichiarandosi però “oggettivista”, “realista” e “relativista” nello stesso tempo.

- il costruzionismo

- il concetto di attante

In questa terza e ultima parte analizzeremo:

- i concetti di micro e macro, riferiti alla società e alla relazione tra locale e globale

- il metodo dell’Actor-Network Theory (ANT)

e proveremo a concludere il percorso.

Tracciando, prima, una serie di associazioni tra i diversi argomenti, da applicare a esempi reali, fino a dare qualche suggerimento su come studiare in modo innovativo anche i temi più controversi. Aggirando le banali e insensate distinzioni tra scientifico e anti-scientifico, scienza e pseudoscienza, ortodosso e eterodosso.

5. IL MICRO E IL MACRO

Anche su questo tema, Latour è stato (in parte) originale, profondo e contro-intuitivo. Perciò, praticamente inascoltato.

- “La società non è il grande tutto ‘in cui’ ogni cosa è incastonata. La società è ciò che viaggia ‘attraverso’ ogni cosa, calibrando le connessioni e offrendo alle entità che incontra un'occasione di commensurabilità”.

- “Né globale, né locale hanno di per sé un’esistenza concreta. Tranne che quando vengono connessi momentaneamente dai ‘connettori’”.

- Per cui, occorre combattere "il pregiudizio che le interazioni locali siano più concrete".

- Invece, “l'azione è dislocata. L'azione sempre imprestata, distribuita, suggerita, influenzata, dominata, tradita, tradotta (…) non appartiene a nessun luogo specifico”.

- Perciò, "l'interazione faccia-a-faccia non è un punto di partenza plausibile per tracciare le connessioni sociali”.

- “Non dobbiamo considerare che il macro inglobi il micro, ma che il micro sia composto di una proliferazione di entità incommensurabili — ciò che Tarde chiamava ‘monadi’ — che stanno semplicemente prestando uno dei loro attributi, una ‘facciata di se stessi’. Il piccolo regge il grande. O, piuttosto il grande potrebbe in qualsiasi momento sprofondare di nuovo nel piccolo da cui è emerso e a cui ritornerà”.

- Seguendo la lezione di Tarde, “il grande (Stati, organizzazioni, mercati) è un’amplificazione, ma anche una semplificazione del piccolo”.

- “Come dimostra la storia economica recente, le grandi decisioni sono meno razionali di quelle piccole”. E, sempre seguendo Tarde, “c’è generalmente più logica in una frase che in un discorso, più in un singolo discorso che in una successione o un gruppo di discorsi; ve n’è più in un rito speciale che in un intero credo, in un articolo di legge che in un intero codice, in una particolare teoria scientifica che nell'intero corpo della scienza; e ve n’è più in una singola opera eseguita da un operaio che nella somma della sua condotta”.

- "le cose, i quasi-oggetti e gli attaccamenti sono il vero centro del mondo sociale; non l’agente, la persona, il membro o il partecipante, né la società o i suoi simulacri (...) la società è la conseguenza dell'associazione e non la sua causa”.

- “Non fissatevi con il capitalismo, ma nemmeno rimanete bloccati sullo schermo della trading room: seguite le connessioni, seguite gli attori stessi”.

- Anche se non si può trascurare "l'importanza dei siti locali che fabbricano strutture globali, non si può dire che un luogo sia più grande di un altro luogo, ma si può affermare che alcuni beni beneficiano di connessioni molto più sicure con molti più luoghi".

- Le ‘grandi’ narrazioni possono essere prodotte in questi luoghi ‘locali’.

- Questo approccio laturiano, evoca molto il sociologo statunitense Randall Collins, con la sua teoria delle catene di interazione rituale (di ispirazione goffmaniana).

6. METODO ANT

- Secondo Latour, "lo studio delle innovazioni e delle controversie è uno dei luoghi privilegiati in cui gli oggetti possono essere mantenuti più a lungo nel loro ruolo di mediatori visibili, distribuiti e formalizzati nei resoconti, prima di diventare intermediari apparentemente invisibili e asociali”.

- Latour distingue tra “mediatori” e “intermediari”. Non è una distinzione ergonomicamente felice per la comprensione del suo pensiero, ma (in breve) significa che un mediatore è un ente che trasforma, fa far cose agli altri, che influenza (senza causarla) l’azione degli altri. Un intermediario, invece, un ente passivo. Tuttavia, questi non sono ruoli prestabiliti: un mediatore, in una certa occasione, può diventare intermediario; e viceversa. “Incidenti, guasti e scioperi: all'improvviso intermediari silenziosi diventano mediatori a tutti gli effetti; persino gli oggetti che un minuto prima sembravano del tutto automatici, autonomi e privi di agenti umani sono ora circondati da folle di umani pesantemente equipaggiati che si muovono freneticamente”. Così, “persino i più umili e antichi strumenti di pietra ritrovati nella Gola di Olduvai in Tanzania sono stati trasformati dai paleontologi in mediatori responsabili dell'evoluzione dell'uomo moderno”.

- Per cui il metodo ANT si focalizza sulla “traduzione”: una connessione che veicola trasformazioni, una relazione che non veicola causalità, ma induce la coesistenza di due mediatori.

- Latour confessa che actor-network theory è un’espressione goffa, fonte di enorme confusione. E ne propone diverse, che però hanno avuto scarso successo: ‘sociologia della traduzione’, ‘ontologia dell’attante-rizoma’, ‘sociologia dell’innovazione’, sociologia delle associazioni (o assologia). Tuttavia, è bene mai dimenticare, che “la rete è un concetto, non una cosa là fuori. E’ uno strumento” euristico.

- Per cui, “nutrirsi di controversie costituisce un metodo molto più sicuro” di molti altri usati dalle sociologie convenzionali, le quali “credono in un solo tipo di aggregati sociali, pochi mediatori e molti intermediari; per l’ANT, non esiste un tipo privilegiato di aggregato sociale, bensì un numero infinito di mediatori e la loro trasformazione in intermediari fedeli non è la regola, ma un'eccezione rara”. Questo è uno dei motivi per cui l’ANT “è chiaramente in contrasto con il programma esplicitamente asimmetrico di Weber, che segue una definizione dei mezzi e fini completamente in contrasto con la nozione di mediatori”.

- Inoltre, sempre a differenza delle sociologie convenzionali, “la presenza del sociale deve essere dimostrata di volta in volta, non può mai essere semplicemente postulata”. Le categorie sociologiche tradizionali (potere, società, capitalismo, cultura, identità, genere, classi ecc.) sono “il risultato finale di un processo, e non un serbatoio, una scorta o un capitale che automaticamente fornirà una spiegazione”.

- E, contro un facile determinismo sociologico, esemplifica: “sì, Einstein ha conosciuto una gioventù turbolenta e ha definito la sua teoria ‘rivoluzionaria’ e ‘relativista’, ma ciò non vi conduce fino in fondo al suo uso dell'equazione di Maxwell, solo nei suoi pressi; sì, Pasteur era in qualche modo reazionario e adorava l'imperatrice Eugenia, ma ciò non vi porta molto lontano nella comprensione della sua batteriologia, anche se questi fattori non sono privi di legami col suo rifiuto, per esempio della teoria della generazione spontanea".

- E, facendo sobbalzare sulla sedia il nuovo materialismo, afferma che "la metafisica empirica è ciò a cui conducono le controversie sulla agency, poiché esse popolano incessantemente il mondo di nuove forze e, altrettanto senza sosta, contestano l'esistenza di altre. Questione cruciale diviene allora come esplorare la metafisica degli attori”.

7. TRACCIARE ASSOCIAZIONI

Proviamo, allora, a raccogliere le tessere del puzzle laturiano e a ricomporlo, per individuare una procedura, un percorso, un tragitto metodologico per fare ricerca à la Latour:

- individuare i luoghi delle controversie, dove avviene la fabbricazione dei fatti e la presenza al contempo di proto-fatti;

- seguire i fatti nel corso della loro produzione e “moltiplicare i siti in cui non sono ancora divenuti freddi e abitudinari matters of fact”;

- “esiste soltanto scienza del particolare (...) più dettagli, voglio più dettagli. Dio è nei dettagli, come tutto il resto, compreso il diavolo, diceva Tarde”;

- “si creano gruppi, si esplorano agency e gli oggetti ricoprono un ruolo. Queste sono le tre prime fonti di indeterminazione su cui ci basiamo, se vogliamo seguire il fluido sociale nelle sue forme sempre mutevoli e provvisorie”;

- lo shuttle della Columbia in un istante si è trasformato “dal più complicato dispositivo umano mai assemblato a una pioggia di detriti che si abbatteva sul Texas”; ci si renderà conto della rapidità con cui gli oggetti ribaltano la loro modalità di esistenza”;

- la definizione di ogni gruppo implica anche la compilazione di una lista di anti-gruppi, all’interno di forme di amicizia e inimicizia;

- "non c'è gruppo senza un qualche addetto al reclutamento (…) Nessun gregge di pecore senza un pastore e il suo cane, il suo bastone, le sue pile di certificati di vaccinazione, la sua montagna di scartoffie per ottenere le sovvenzioni dell'UE”;

- occorre “non definire in anticipo il tipo di aggregati sociali che potrebbero fornire il contesto di tutte queste mappe”;

- “gli aggregati sociali non sono oggetto di una definizione ostensiva - come lo sono per esempio tazze, gatti e sedie che si possono additare con l'indice –, ma soltanto di una definizione performativa. Esisterebbero in virtù dei differenti modi in cui si asserisce che esistano”;

- per definizione performativa si intendono "pratiche necessarie per mantenere costanti i gruppi e i contributi fondamentali delle risorse di cui dispone l’osservatore stesso (...) non si può fare a meno di cercare veicoli, attrezzi, strumenti e materiali in grado di produrre una tale stabilità ";

- “se un ballerino smette di danzare, la danza è finita. Nessuna inerzia porterà avanti lo spettacolo. Ecco perché ho dovuto introdurre la distinzione tra ostensivo e performativo”;

- ricercare i mediatori e intermediari, secondo la definizione sopra riportata, concependo l'esistenza di relazioni (ad es.) tra pescatori oceanografi, satelliti e capesante, relazioni tali da far fare agli altri cose inaspettate…

- “le capesante fanno fare cose ai pescatori così come le reti immerse nell'oceano offrono alle capesante l'occasione di attaccarsi alle reti o l'oceanografo mette insieme pescatori e capesante raccogliendo dati (...) il sociale torna sotto forma di associazione (...) seguendo il principio secondo cui tutti gli attori che stiamo per schierare potrebbero essere associati in modo tale da far agire gli altri (...) generando trasformazioni manifestate dai numerosi eventi inattesi innescati negli altri mediatori che li seguono lungo la catena. È ciò che ho chiamato il ‘principio di irriduzione’;

- “un pastore e il suo cane vi ricordano le relazioni sociali ma, quando vedete il suo gregge dietro un recinto di filo spinato, vi chiedete dove siano finiti il pastore e il suo cane — tuttavia, se le pecore rimangono a pascolare nel prato, e perché il filo spinato sostiene l'abbaiare del cane. Non v'è dubbio che siate divenuti pantofolai piantati davanti alla tv grazie soprattutto al telecomando che vi permette di fare zapping da un canale all'altro (…) Provate voi stessi: buttatelo via e vedrete quanto tempo passerete andando avanti e indietro dal divano alla tv”.

- “non c’è nessuno strumento, nessun mezzo, solo mediatori e intermediari;

- evitare “una subitanea accelerazione della descrizione” ricorrendo a parole quali “società”, “potere”, “struttura”, “contesto”;

- l’ANT è una scienza lenta, “come la molteplicità di obiezioni e oggetti di cui bisogna rendere conto seguendo: le catene di associazioni, i mediatori che brulicano a ogni passo, le quattro fonti di incertezza (o indeterminazione)”.

- Per cui: “1) non gruppi, ma raggruppamenti; 2) l’azione è superata; 3) anche gli oggetti possiedono agency; 4) matter of concerns.

Queste quattro fonti devono essere affrontate coraggiosamente, una dopo l'altra; se ne manca una, l'intero progetto crolla”; - “si comincia con assemblaggi, che sembrano vagamente familiari, e si finisce con altrettanti assemblaggi completamente inediti. Il tracciamento delle connessioni sociali è particolarmente complesso”;

- “occorre sempre ampliare la gamma di attori all'opera”;

- “l’ANT non ha semplicemente il compito di stabilizzare il sociale per conto degli attori, ma ‘scoprire’ i nuovi attori inattesi emersi più di recente;

- “il relativismo è un modo di galleggiare sui dati, non di affogarci dentro”;

- “le controversie non sono semplicemente una seccatura da tenere a bada”;

- “la soluzione alle crisi del relativismo e spingersi sempre più lontano nella relatività”;

- “definirei un buon resoconto sociologico, un resoconto che traccia una rete, una catena di azioni in cui ogni partecipante è trattato come mediatore a tutti gli effetti, in cui tutti gli attori fanno qualcosa”;

- quando facciamo le interviste, ascoltiamo le persone che parlano, osserviamo i loro commenti, occorre evitare di “ascoltare distrattamente queste produzioni contorte e ignorare i termini più strani, barocchi e idiosincratici offerti dagli attori. Quando un criminale dice ‘non è colpa mia, ho avuto pessimi genitori’, i sociologici dicono che ‘la società ha lo reso un criminale’ o che ‘sta cercando di sfuggire alla colpevolezza personale, diluendola nell'anonimato della società’. Tuttavia, il criminale non ha detto nulla di simile. Ha semplicemente detto ‘ho avuto pessimi genitori’”;

- “non dobbiamo sostituire a un'espressione sorprendente, ma precisa, il ben noto repertorio della sociologia convenzionale”;

- “Avremo il coraggio di non sostituire un'espressione sconosciuta con una ben nota?”.

Se un pellegrino dice “sono giunto in questo monastero perché la Vergine Maria mi ha chiamato”, dobbiamo prenderlo sul serio e non sostituire subito “l'agency della Vergine con l’illusione”, il pretesto, l’infatuazione ecc. come farebbero i sociologi tradizionali; - parlando di amore, i poemi sono pieni del "corteo ininterrotto di angeli, cherubini, putti e frecce, la cui esistenza oggettiva, sì oggettiva, dovrebbe anche essere presa in considerazione";

- dobbiamo “rispettare la metafisica di un mugnaio”, così sorprendentemente ben descritta dallo storico italiano Carlo Ginzburg ne Il formaggio e i vermi…

- “l’ANT è semplicemente la teoria sociale che ha scelto di affidarsi agli indigeni, ai locali, non importa in quali bizzarri imbrogli metafisici essi ci conducono”;

- “sebbene non sappiamo mai con certezza chi e cosa ci faccia agire, le ragioni le possiamo trovare nei resoconti degli attori. Le agency sono sempre presentate in un resoconto (account).

8. CON LATOUR, OLTRE LATOUR

Ora, a mio avviso, con queste indicazioni metodologiche, si possono studiare in modo innovativo, serio e documentato tutti i temi che si vogliono, anche quelli più controversi, come (ad es.) l’esitazione vaccinale, i movimenti no TAV o no 5G, le pazienti che si affidano a cura omeopatiche, coloro che credono nelle scie chimiche, le persone critiche nei confronti delle cause antropiche dei cambiamenti climatici ecc.

Evitando di emulare le giornaliste e le esperte di tutto, lasciando alle sociologhe convenzionali (la “sociologia del sociale”, la chiamerebbe Latour) il pesante bagaglio di termini e concetti stucchevoli come ‘populismo’, anti-scientifico’, ‘pseudoscienza’, ‘destra e sinistra’, ‘vero/falso’ ecc. che poco hanno di empirico e molto pregiudizio.

Come ricorda Latour, “non spetta agli scienziati sociali risolvere le controversie”, dire chi ha ragione o torto, chi sono le babbee che credono alle fake news e chi sono le intelligenti che, invece, si fidano del parere delle esperte che decorano i talk show. Perché, la sociologa ANT non è una intellettuale organica o, come scrive Latour, “un intellectuel engage”.

Peccato, però, che egli non abbia avuto il coraggio o la voglia di dirle quelle cose, prima di morire…

BIBLIOGRAFIA

Berger, Peter L. (1963), trad. it. Invito alla sociologia, Venezia: Marsilio.

Descola, Philippe (2005), trad. it. Oltre natura e cultura, Milano: Cortina, 2014.

Fleck, Ludwik (1935), trad. it. Genesi e sviluppo di un fatto scientifico, Bologna: Il Mulino

Ginzburg, Carlo (1976), Il formaggio e i vermi. Il cosmo di un mugnaio del Cinquecento, Torino, Einaudi.

James, William (1890), trad. it. Principi di Psicologia, Milano: Società Editrice Libraria, 1909.

Latour, Bruno (2005), tr. Riassemblare il sociale, Milano: Meltemi, 2022.

Sloterdijk, Peter (1998), trad. it. Sfere / Bolle vol. 1, Milano: Meltemi 2009.

Sloterdijk, Peter (1999), trad. it. Sfere / Globi vol. 2., Milano Cortina, 2014.

Sloterdijk, Peter (2004), trad. it. Sfere / Schiume vol. 3., Milano: Cortina, 2015.

Tarde, Gabriel (1894), La logique sociale, Paris: Alcan.

Decalogo Latouriano – Il pensiero meno noto di Bruno Latour, Seconda parte

Nella prima parte di questo percorso attraverso le parti meno note e utilizzata dell’approccio di Bruno Latour al sociale, alle scienze e alle tecnologie, ho affrontato:

- il legame profondo tra oggetti della scienza e società, in cui – secondo Latour – sono i primi a spiegare la seconda (Il sociale, la società e la sociologia) e

- la critica di Latour alle sociologie interpretative, all’empirismo storico, al riduzionismo e – pare fin troppo ovvio – al positivismo, dichiarandosi “oggettivista”, “realista” e “relativista” nello stesso tempo.

Questa seconda parte del percorso è dedicata al costruzionismo di Latour e al concetto di attanti.

3. IL COSTRUZIONISMO

- Secondo Latour, le espressioni “costruttivismo sociale” e “costruzione sociale dei fatti scientifici” sono state infelici, un’autentica sciagura. Infatti il termine ‘sociale’ (che come abbiamo visto sopra, lui vuole abolire) si è prestato a tanti malintesi e la parola ‘costruzione’ ha scatenato una confusione ancor più grande.

- Egli confessa: “ci siamo resi conto che, per altri colleghi delle scienze sociali e naturali, la parola ‘costruzione’ significava qualcosa di completamente diverso da ciò che il senso comune aveva considerato fino ad allora. Dire che qualcosa era ‘costruito’ significava, nella loro mente, che qualcosa non era vero".

- Ma, "nessun scienziato di laboratorio si è mai confrontato con un oggetto ‘dato’ indipendentemente dal lavoro necessario per ‘renderlo visibile’; quindi perché comportarsi come se l’alternativa tra ‘realismo’ e ‘costruttivismo’ fosse interessante?”.

- “Sebbene il costruttivismo fosse per noi sinonimo di più realismo, siamo stati acclamati dai nostri colleghi come se avessimo finalmente dimostrato che ‘persino la scienza è una balla’! (...) Senza volerlo, il costruttivismo era divenuto sinonimo del suo opposto: la decostruzione”.

- Latour ha sempre voluto evitare l’espressione ‘costruttivismo sociale’: “come una repubblica socialista o islamica è l'opposto di una repubblica, aggiungere l'aggettivo ‘sociale’ a ‘costruttivismo’ snatura completamente il suo significato. In altre parole, il ‘costruttivismo’ non deve essere confuso con il ‘costruttivismo sociale’ che ne è l'opposto (…) Il ‘costruttivismo sociale’ implica sostituire ciò di cui è fatta questa realtà con qualche altra cosa, il sociale di cui sarebbe ‘realmente’ composta”.

4. GLI ATTANTI

- Secondo Latour occorre dire addio alla nozione di ‘attore’, come soggetto in carne ed ossa. Infatti, “bisogna assemblare un gran numero di agency affinché un attore diventi un individuo”.

- Usando un parallelo (che però Latour non fa nel suo libro, ma che mi sembra in linea con il suo pensiero) potremmo dire che mentre le genetiste affermano che ognuna di noi è unica grazie al suo DNA, le sociologhe invece potrebbero sostenere che ciascuna di noi è diversa perché nessuna ha avuto le stesse interazioni sociali.

- William James potrebbe essere d’accordo, perché secondo Latour egli “ha magnificamente dimostrato, che è moltiplicando le connessioni con l'esterno che c'è qualche possibilità di comprendere come la nostra interiorità sia stata composta. Bisogna sottoscrivere un gran numero di soggettivatori per divenire un soggetto. Per cui nessuno sa quante persone sono simultaneamente all'opera in un dato individuo”.

- Inoltre, Latour ammette che “usiamo il termine ‘non-umani’ in mancanza di un termine migliore; ma in realtà questa espressione è priva di senso perché dobbiamo elevare gli oggetti al rango di attori a pieno titolo”.

- E indispettito, puntualizza: “L’ANT non è - ripeto, non è – l’istituzione di qualche assurda simmetria tra umani e non umani (…) l’ANT non è interessata soltanto a liberare gli attori umani dalla prigione del sociale, ma a offrire anche agli oggetti naturali l'occasione di sfuggire all’angusto isolamento a cui il primo empirismo condanna le matters of fact (cioè quelle che vengono considerate cose, condizioni o stati permanenti). Infatti, in accordo con l’antropologo francese Philippe Descola, egli insiste: "dobbiamo ricordare che essere una matter of fact non è un modo di esistenza ‘naturale’, ma, stranamente, un antropomorfismo. Cose, sedie, gatti, tappeti e buchi neri non si comportano mai come matters of fact”.

- Il positivismo è sbagliato politicamente, perché ha ridotto troppo in fretta le matters of concerns (processi, stati transitori, movimenti) a matters of facts, e senza un giusto processo”. E, come ANT, "il nostro tocco distintivo consiste semplicemente nel sottolineare i meccanismi di stabilizzazione, al fine di contrastare la trasformazione prematura di matters of concern in matters of fact”.

- Anche se lui, l’ha più volte ripetuto, non ha alcuna simpatia per le sociologie interpretative, tuttavia si oppone a una atteggiamento naturalista perché “gli oggetti potrebbero sembrare un po’ più complicati, multipli, complessi e intricati di quanto gli ‘oggettivisti’ vorrebbero farci credere”.

- Gli oggetti sono fatti di strati multipli, esattamente come sono le persone. Per cui “tutta questa opposizione tra ‘punto di vista’ e ‘nessun luogo’ la si può completamente dimenticare. E pure questa differenza tra ‘interpretativo’ [ermeneutica] e ‘oggettivista’. Se si possono avere punti differenti su una statua, è perché la statua stessa è in tre dimensioni e ci permette di muoversi intorno a essa”. Infatti, “nessun edificio è mai visibile in toto, in qualsiasi punto della sua costruzione e del suo utilizzo”.

- “E’ la cosa stessa che può dispiegare la sua molteplicità, il che consente di apprenderla a partire da diversi punti di vista prima di essere eventualmente unificata in una fase successiva a seconda delle capacità del collettivo”.

- “Questa è anche la linea di demarcazione tra il postmodernismo e l’ANT, che considera la molteplicità una proprietà delle cose, e non solo degli umani che interpretano le cose”.

- A tal proposito, Latour critica i sociologi che “per ritagliarsi una piccola nicchia, hanno abbandonato all’inizio del XIX secolo, le cose e gli oggetti agli scienziati e agli ingegneri”.

BIBLIOGRAFIA

Berger, Peter L. (1963), trad. it. Invito alla sociologia, Venezia: Marsilio.

Descola, Philippe (2005), trad. it. Oltre natura e cultura, Milano: Cortina, 2014.

Fleck, Ludwik (1935), trad. it. Genesi e sviluppo di un fatto scientifico, Bologna: Il Mulino

Ginzburg, Carlo (1976), Il formaggio e i vermi. Il cosmo di un mugnaio del Cinquecento, Torino, Einaudi.

James, William (1890), trad. it. Principi di Psicologia, Milano: Società Editrice Libraria, 1909.