Le mani sulla montagna - “Consumismo sciistico” o sviluppo sostenibile?

Questo articolo è pubblicato in contemporanea

dal Gruppo di divulgazione e discussione online

“Ideeinformazione”

Nelle aree alpine – si è notato più volte in questi anni – il fenomeno del cambiamento climatico si sta facendo sentire con particolare acutezza. Ma a farsi sentire sembra anche una scarsa volontà di cambiare stili di vita e atteggiamenti culturali, in particolare l’idea di sviluppo del territorio. Come del resto nelle grandi pianure. Fortunatamente, però, crescenti sono anche le reazioni delle popolazioni locali, sempre più consapevoli della necessità di “cambiare rotta” dal punto di vista economico-sociale, orientandosi verso un modello di sviluppo meno consumistico e “quantitativo”. Qualcosa che può insegnare molto (e – perché no – dare anche un po’ di speranza) a chi nelle aree montane non vive.

Nelle prealpi lombarde ci sono ameno due casi di scuola, che illustrano bene questa situazione.

IL COMPRENSORIO SCIISTICO VILMINORE-LIZZOLA (BG)

Vilminore e Lizzola sono due comprensori sciistici nella Bergamasca: il primo in valle di Scalve, sopra il comune di Vilmonore, e il secondo nella parallela Val Seriana, sopra Valbondione (di cui Lizzola è frazione). In mezzo c’è il Pizzo di Petto (mt.2.227) che può essere valicato a piedi attraverso il Passo di Manina. Ebbene, da qualche tempo sta prendendo forma un progetto per la “valorizzazione” turistica e sciistica dell’area attraverso la realizzazione di un tunnel che colleghi i due comprensori. Bucando evidentemente la montagna. Grazie a questa grande opera sciistica (potremmo forse coniare al proposito un nuovo acronimo: GOS), dunque lo sciatore potrebbe godere senza scendere dagli sci né perdere quota delle due aree di divertimento. Peccato che su questi tracciati, in gran parte tra i 1.800 e i 2.200 mt., cade sempre meno neve negli ultimi anni, anche durante le stagioni buone, e per periodi sempre più brevi…

Il progetto, il cui costo previsto è di 70 milioni di euro di cui 50 pubblici, sta muovendo solo i primi passi; sono comunque previsti, oltre agli estremamente invasivi lavori di perforazione per il tunnel di collegamento, sbancamenti, vasche di accumulo dell’acqua per l’innevamento artificiale, infrastrutture viarie, la dismissione delle funivie esistenti per sostituirle con una nuova.

Quello che però va qui segnalato è che appena la notizia ha fatto il giro dei paesi della valle la popolazione è insorta decisamente contro l’insensatezza di questo ipotetico mega-progetto, e così sul finire del 2024 la petizione lanciata dal locale collettivo Terre Alt(r)e[1] ha raggiunto rapidamente le 25.000 firme (!), mentre il 3 gennaio di quest’anno una prima assemblea pubblica, a Vilminore, ha raccolto oltre trecento persone che per quattro ore hanno seguito attentissime e preoccupate i relatori convocati da una rete di associazioni, tra e quali il CAI locale.[2]

I NUOVI IMPIANTI SUL MONTE SAN PRIMO (CO)

Il progetto denominato “Oltre Lario” è, se possibile, ancora più folle. Qui parliamo del monte San Primo, il rilievo più elevato del cosiddetto “Triangolo lariano”, ovvero di quel “triangolo” avente come vertici ideali Como, Lecco e Bellagio. Il massiccio montuoso supera di poco i 1.600 mt. e non ci ha mai nevicato troppo (oltretutto si tenga presente che quella zona risente dell’effetto mitigazione esercitato dal lago). In passato, comunque vi erano state costruite delle piste da sci con relativi impianti, da molto tempo abbandonati, secondo il destino comune a gran parte degli impianti a media altezza delle aree prealpine[3] (in verità non solo per ragioni climatiche, ma anche per cambiamenti degli stili di vita e delle pratiche turistiche).

Dal 2022, dunque, un progetto finanziato da Ministero dell’Interno, Regione Lombardia e Comunità montana del Triangolo lariano, e fortemente sostenuto dal Comune di Bellagio, prevede tra le altre cose la costruzione di un nuovo impianto sciistico sul Monte San Primo con ovviamente creazione di piste, cannoni sparaneve e un laghetto di accumulo per l’innevamento artificiale, tapis-roulants e una serie di parcheggi. Da subito una grande mobilitazione ha attraversato i paesi dell’area, dando vita al Coordinamento “Salviamo il Monte San Primo” (che riunisce decine di associazioni locali)[4] e che ha per ora ottenuto, se non altro, un “ripensamento” del progetto. Che però – denunciano di recente i sostenitori del coordinamento – non è cambiato in modo significativo e continua a impegnare oltre due milioni di euro dei cinque previsti per le opere legate, appunto, a questi nuovi, surreali, impianti sciistici.

Le associazioni temono che un simile progetto trasformi «la montagna lariana in un dispendioso luna-park, sperperando ingenti soldi pubblici per depauperare un territorio di grande pregio naturale e culturale». Tra le maggiori preoccupazioni, oltre al danno per un’area che è di grandissimo pregio naturalistico e inevitabilmente vocata a un turismo “dolce” (è il caso del percorso escursionistico noto come “Dorsale del Triangolo lariano” da Como a Bellagio), quella relativa agli impianti per il prelievo di acqua funzionali alla produzione della neve artificiale (la zona presenta carsismi e difficoltà nel prelievo di acqua per gli usi civili nelle lunghe estati siccitose di questi ultimi anni – ci manca questo prelievo extra del tutto insensato!).

Passando da vicende di portata locale a questioni più ampie, è evidente che queste tendenze si trovano nella concezione che sta alla base della progettazione delle future Olimpiadi invernali Milano-Cortina 2026, i cui lavori nei prossimi mesi conosceranno una forte accelerazione (il 6 febbraio scorso è stato infatti il “One year to Go”, la cerimonia ufficiale a un anno dall’inizio dei giochi). Anche in questo caso, dietro qualche rapida frase di facciata “green” (il sindaco di Milano Sala ha assicurato che i Giochi saranno molto «sostenibili» e che alla fine come ai tempi di Expo 2015 «saranno tutti contenti»[5] – ma tutti chi?), c’è una micidiale operazione di opere «essenziali» sparse a pioggia tra Lombardia e Veneto, che non faranno che lasciare i territori più sfigurati e cementificati. O meglio, i segni si vedono già.[6]

RIPENSARE LO SVILUPPO E I TERRITORI. A PARTIRE DALLE AREE MONTANE

Le due vicende che abbiamo richiamato – ma molte altre si potrebbero rintracciare – ci mostrano in definitiva come forti siano le tenenze conservative nel modo di pensare l’impresa, lo sviluppo e il turismo (è difficile uscire dal mito della crescita illimitata), ma come anche in questi ultimi decenni tante popolazioni, imprese, amministrazioni locali, intellettualità diffusa abbiano maturato una visione nuova, capace di pensare strade inedite e inaspettate per coniugare vita moderna e tutela dell’ambiente.

Le vicende e i luoghi che abbiamo visto parlano, tra l’altro, di quelle aree che sono state definite «montagne di mezzo», cioè quella media montagna che non presenta i caratteri della “eccellenza turistica” per come è comunemente intesa. È una «dimensione intermedia» – ha osservato in un libro intelligente il geografo Mauro Varotto – tra le montagne per antonomasia, specializzate «in direzione della modernizzazione turistico-industriale» e della «compensazione naturalistica»,[7] e le aree urbane industrializzate (anzi, “post-industrializzate”, se mi consente lo scherzo terminologico), caotiche affollate e inquinate. Aree dunque destinate, in questo modello di (mal)sviluppo ad abbandono e “regressione”, a invecchiamento e spopolamento. Contro questo “destino”, che in realtà è solo l’effetto di un ben preciso orientamento dello sviluppo territoriale basato sugli imperativi del profitto, è necessario ripensare ai modelli di telefrequentazione di una montagna panoramica a disposizione del tempo libero della popolazione urbana: serve una rivoluzione copernicana che non intenda più la montagna al servizio del turista o escursionista, ma l’escursionista e il turista al servizio della montagna.[8]

Vi è oggi in Italia, per fortuna, un vasto movimento, di pensiero, di opinione, ma anche di “pratiche di vita”) che si oppone fermamente a queste visioni incentrate su un mito della crescita economica che, applicato alle aree montane, appare perfino ridicolo. Un movimento che, peraltro, non può essere derubricato a “politica del no”, ma che al contrario intende dare un “altro futuro”, di economia alternativa, al mondo delle montagne che peraltro rappresenta oltre un terzo del territorio italiano. Tra i punti alti di questa riflessione troviamo, infatti, il Manifesto di Camaldoli, un documento elaborato al termine di un convegno nazionale svoltosi appunto a Camaldoli nel 2019,[9] dove si legge tra l’altro: L’idea che la montana lasciata alle forze della natura ritrovi da sola un equilibrio stabile – la cosiddetta ri-naturazione – è del tutto infondata. Come tutti i manufatti la montagna richiede manutenzione. In netto contrasto con i comportamenti odierni di tipo distruttivo e predatorio va riscoperta la tradizionale cultura del limite, che dovrà anche presiedere all’uso produttivo della terra, ai consumi di suolo e agli altri usi del territorio. (…)

Occorre dunque lavorare a uno scenario alternativo a quello della città che invade la montagna, della proliferazione delle seconde case, delle piste da sci sempre più dipendenti dall’innevamento artificiale e dal prelievo idrico. Nuovi modelli di vita, di socialità e di compresenza culturale richiedono un’alleanza fra anziani restanti, depositari di saperi contestuali, e “nuovi montanari” innovativi. Vi concorrono iniziative e nuovi strumenti come cooperative di comunità, ecomusei che attivano coscienza di luogo, osservatori del paesaggio, comunità del cibo, feste paesane “sagge”, forme attive e inclusive di valorizzazione delle minoranze linguistiche e di integrazione dei migranti.[10]

Un pensiero altro sulla e della montagna, da cui ci sarebbe molto da imparare. Anche qui in pianura.

NOTE

[1] https://terrealtre.noblogs.org/

[2] Si veda la puntuale cronaca di Radio Onda d’Urto: https://www.radiondadurto.org/2025/01/27/nuovo-comprensorio-sciistico-colere-lizzola-prosegue-la-raccolta-di-firme-contraria-e-in-preparazione-nuove-iniziative/. E qui il video dell’incontro del 3 gennaio a Vilminore, intitolato “Comprensorio sciistico Colere-Lizzola. Patrimonio di tutti o parco divertimenti per pochi?”: https://terrealtre.noblogs.org/post/2025/01/10/video-dellincontro-pubblico-comprensorio-sciistico-colere-lizzola-patrimonio-di-tutti-o-parco-divertimenti-per-pochi-organizzato-a-vilminore-il-03-01-2025/

[3] Nell’Appennino le cose vanno anche peggio, per ovvie ragioni climatiche: dei cento impianti esistenti la metà sono chiusi. E nonostante questo – ha osservato Giuliano Bonomi, naturalista dell’Università di Napoli che ha condotto su questa realtà un’ampia ricerca – «negli ultimi anni stiamo assistendo a un paradosso: sono proliferati i progetti volti a costruire nuovi impianti di risalita in tutto l’Appennino, grazie anche a finanziamenti in parte o totalmente pubblici» (cfr. Alessandro Pirovano, La montagna che non si arrende a “grandi eventi” e impianti sciistici senza futuro, “Altreconomia”, 5 febbraio 2025, https://altreconomia.it/la-montagna-che-non-si-arrende-a-grandi-eventi-e-impianti-sciistici-senza-futuro/).

[4] https://bellagiosanprimo.com/

[5] https://stream24.ilsole24ore.com/video/economia/milano-cortinasala-fascino-cinque-cerchi-dara-grande-visibilita/AGQg6qkC

[6] Per una presentazione d’insieme degli scempi che porteranno con sé le Olimpiadi invernali 2026, si veda Luigi Casanova, Ombre sulla neve. Milano-Cortina 2026. Il “libro banco” delle Olimpiadi invernali, Milano, Altreconomia, 2022. Qui il video della presentazione del libro alla Casa della Cultura di Milano, il 15 dicembre 2022: https://www.youtube.com/watch?v=RoMk-HK9s9c&t=10s. E per un aggiornamento, l’articolo di Duccio Facchini, “L’impronta olimpica”: le opere di Milano Cortina 2026 dall’alto,“Altreconomia”, n. 278 / febbraio 2025, p. 21-25, che documenta, foto satellitari alla mano, gli effetti tutt’altro che “sostenibili” sui territori interessati dalle opere olimpiche.

[7] Mauro Varotto, Montagne di mezzo. Una nuova geografia, Torino, Einaudi, 2020, p. 165.

[8] Ivi, p. 167-68.

[9] Il manifesto è stato approvato al termine del convegno nazionale “La nuova centralità della montagna” (Camaldoli, 8-9 novembre 2019), e si trova in Luigi Casanova, Avere cura della montagna. L’Italia si salva dalla cima, Milano, Altreconomia, 2020, p. 29-36.

[10] Ivi, p. 32-33.

Le teorie del complotto, prima parte - Tra populismo, scientizzazione della politica e disincanto del mondo

Quella che segue è la prima di cinque puntate di un testo sul complottismo, indagato al crocevia tra populismo, scientizzazione della politica e disincanto del mondo. Il testo originale è stato pubblicato come prefazione al volume di Matthieu Amiech, "L'industria del complottismo. Social network, menzogne di stato e distruzione del vivente" (Edizioni Malamente, 2024). Elisa Lello

--------

Scrivo queste pagine durante un soggiorno a Coimbra come pesquisadora (ricercatrice) visitante presso un Centro universitario che deve molto del suo prestigio a una importante tradizione di studi che ha avuto il merito di fare luce sul ruolo cruciale della dimensione epistemologica nei rapporti di dominio. In particolare, nel mettere sotto esame critico il ruolo che la scienza occidentale ha avuto nel legittimare e implementare le forme della dominazione coloniale storica – e che continua a esercitare attraverso la colonialità (Quijano 2005) – alla luce del fatto che il modo in cui vediamo e descriviamo il mondo determina anche i modi in cui pensiamo sia possibile, o non possibile, agire su di esso per trasformarlo. Una tradizione che si è dunque concentrata sull’epistemologia come strumento di potere, che spoglia la scienza della sua pretesa neutralità mostrando come questa risponda ai rapporti di forza in campo e questi contribuisca a consolidare, marginalizzando, invisibilizzando o ridicolizzando modi altri di stare al mondo, di conoscerlo e rappresentarlo (Chalmers 2017; Nunes e Louvison 2020; Santos et al. 2022).

Eppure, anche in un contesto come questo, quando mi capita di raccontare a colleghe/i i temi intorno cui gravitano i miei studi durante questi ultimi anni – essenzialmente: movimenti sociali e tecnoscienze, i rapporti tra politica e scienza, tra critica sociale e complottismo, tra epistemologia e populismo – quasi sempre mi imbatto in reazioni a cui sono fin troppo abituata. Dopo sorrisi e attestazioni di quanto tutto questo sia interessante, quella che mi si cerca (senza successo) di proporre è una complicità fondata sull’indignazione, e sullo scherno, a partire da qualche aneddoto che invariabilmente vorrebbe dimostrare quanto ci sia gente, là fuori – e, ça va sans dire, soprattutto tra chi ha orientamenti conservatori – così irrimediabilmente ignorante e anti-scientifica che ha completamente perso il lume della ragione, che crede in teorie strampalate, risibili e complottiste, e come è possibile che costoro abbiano diritto di parola e, quel che è peggio, pure di voto.

La mia perplessità, ma a volte è quasi scoramento, nasce non solo dal constatare la mancanza di qualunque cautela nel trattare del rapporto tra scienza, “ignoranza” e politica – ancor di più qui, appunto. Ma anche dal vedere come si tratti quasi sempre di ricercatrici/tori che si autodefiniscono militanti, di sinistra, che rivendicano un’attenzione estrema all’inclusività nelle pratiche e nel linguaggio quando si parla di identità di genere, orientamenti sessuali o body-shaming, eppure tutta questa inclusività, sensibilità e attenzione letteralmente svaniscono quando si è di fronte a opinioni non del tutto allineate, per esempio, sulla crisi eco-climatica o, a maggior ragione, quando si tratta di scelte sanitarie. Non solo svaniscono: peggio, troppo spesso si trasformano in un disprezzo profondo, antropologico, che apre la porta a battute feroci, che rivolte ad altre categorie desterebbero, giustamente, scandalo e reazioni ben sicure di sé. Il tutto senza poi indugiare troppo sulla eterogeneità delle critiche né sulle ragioni che vengono mosse, appunto, dai non allineati; senza interrogarsi sulla complessità delle questioni che pongono e che tutti ci dovremmo porre. Ci si accontenta invece, troppo spesso, di alzare steccati identitari per frapporre una distanza netta tra sé e gli “altri”: anti-vax, antiscientifici, trumpiani, complottisti, negazionisti, terrapiattisti. Un po’ tutti in odore di estrema destra e fascismo.

Sollevando, con ciò, contraddizioni che gridano giustizia, ma che raramente vengono affrontate. Per iniziare col piede giusto, prendiamo la sineddoche per eccellenza del vasto panorama del complottismo: gli odiatissimi “anti-vax”, categoria che finisce per catalizzare indignazioni, ironie e disprezzo, nonché solitamente inclusiva di chiunque per qualunque ragione abbia dubbi sulle politiche pandemiche. Bene, l’avere (più di) qualcosa da ridire sul fatto che le linee politiche essenziali che hanno guidato la gestione globale del Covid-19 siano state scritte da CEPI (Coalition for Epidemic Preparedness) – Fondazione B. & M. Gates, DARPA (NATO) e Wellcome Trust – è una posizione in perfetta continuità con ciò che denunciava il “movimento dei movimenti” tra Seattle e Genova al volgere del millennio e con ciò che qualunque movimento di sinistra variamente intesa dovrebbe ancora combattere oggi: com’è possibile che questa posizione non solo non sia più (percepita come) coerente con ideali di sinistra ed emancipativi, ma sia addirittura diventata patologica e pure fascista?

Poi, però, in questi stessi ambienti accademici (come in molti della militanza di sinistra) ci si straccia le vesti di fronte all’“onda nera” che travolge Europa e Stati Uniti, spesso, ancora una volta, con studi che, se finalmente prendono in considerazione il ruolo delle “emozioni”, il più delle volte lo fanno per dare una spiegazione tendenzialmente psico-patologica del voto a destra, che lascia a intendere quanto sia invece “razionale” quello progressista.

Sono convinta che ci sia un nodo da affrontare, qui. E che questo nodo abbia a che fare con ciò che impedisce un dialogo tra sinistra e classi popolari, dove la prima non fa nulla per dissimulare il suo disprezzo verso i valori e i modi di vita delle seconde proprio mentre si dispera perché queste non le tributano più i loro consensi e preferiscono cercare e inseguire altre narrative.

Ma è un nodo che riguarda anche l’accademia. La quale, muovendosi lungo percorsi in fondo molto simili, denuncia con tanta veemenza quanta superficialità i pericoli delle fake news e del complottismo, malattie che ovviamente contagerebbero di preferenza il “popolino”, e nel contempo si allarma di fronte alla perdita di credibilità delle “autorità epistemiche consolidate”, cioè università e istituzioni scientifiche, agli occhi (di parti rilevanti) del popolo stesso. Tendendo però a liquidare ogni problema, come vedremo, attraverso le interpretazioni auto-assolutorie del populismo, politico ed epistemologico, e della post-verità.

Per questi motivi credo sia importante affrontare in modo serio, finalmente, un tema come quello del complottismo, di ciò che lo produce, delle dinamiche storiche in cui si inserisce, e di ciò che esso stesso alimenta. E, in questo senso, il libro di Matthieu Amiech, come cercherò di evidenziare nelle prossime pagine, fornisce parecchi elementi preziosi, illuminanti. Quello che invece farò io, in queste pagine, sarà provare a introdurre il tema partendo dall’individuare aporie e contraddizioni nelle sue interpretazioni oggi largamente prevalenti (da parte del giornalismo, ma anche della sinistra e del sapere accademico), per poi contestualizzarlo all’interno del più ampio problema del rapporto tra scienza e politica, rintracciandone alcune connessioni con la scientizzazione della politica e con il disincanto del mondo.

In questo percorso, seguirò principalmente il filo argomentativo del libro; cercherò però anche di intessere un dialogo tra questo e alcune ricerche e pubblicazioni che ho portato avanti negli ultimi anni, con amici/he e colleghi/e, su temi affini o contigui; e con varie altre letture recenti. Tra queste, in particolare, si potranno riconoscere le impronte significative del Manifeste conspirationniste (Seuil 2022), di The divide: how fanatical certitude is destroying democracy (di Taylor Dotson, MIT Press 2021) e di Favole del reincanto: molteplicità, immaginario, rivoluzione (di Stefania Consigliere, Derive Approdi 2020).

INIZIAMO A SFATARE QUALCHE LUOGO COMUNE

Cosa c’è dunque che non va in quelle reazioni così frequenti e automatiche? Cosa non funziona in quelle diagnosi che in modo così lineare, e semplice, individuano quasi tutti i problemi dell’oggi nell’ignoranza e nell’“analfabetismo funzionale” che rende il popolo (o comunque sempre “gli altri”) facile preda di fake news e complottismo?

Proviamo a sollevare qualche velo. Un primo problema è dato dal focalizzarsi su una fotografia istantanea senza tenere in considerazione come siamo arrivati a questo punto. Quando invece occorrerebbe partire dalla presa di consapevolezza, suggerita da Frédérique Lordon e ripresa da M. Amiech, della colpevole confisca del dibattito pubblico che ha sistematicamente privato la cittadinanza della possibilità e dei mezzi per capire le forze storiche che la dominano e per partecipare ai processi decisionali che disegnano gli scenari in cui dovrà vivere. Il complottismo, in questa prospettiva, appare piuttosto come sintomo di un’espropriazione, e come rifiuto, al tempo stesso e nonostante tutto, ad abdicare alla volontà di capire, di darsi una spiegazione.

Ci imbattiamo, continuando a sollevare qualche velo, nell’inadeguatezza e nella parzialità dell’informazione offerta dalle testate del mainstream, che in maniera crescente e accelerata negli ultimi anni si è intrecciata con dinamiche di militarizzazione del confronto, conformismo, censura e autocensura, dove su troppi temi i punti di vista dissonanti vengono immediatamente respinti come fake news, in un dibattito chiuso prima ancora di averlo aperto. Il complottismo, dunque – o meglio, l’etichettamento di posizioni critiche come complottiste – usato come arma politica per screditare il dissenso. Ma questa stigmatizzazione di posizioni minoritarie non si limita al piano verbale: come nel caso dei vaccini (per ora), ha legittimato soluzioni autoritarie nel segno dell’esclusione, della privazione di diritti essenziali, della separazione della cittadinanza tra meritevoli e non, sulla base dell’adesione e dell’obbedienza. È chiaro, e pure un’abbondante letteratura scientifica lo dimostra, che questo tipo di scelte – sia comunicative che politiche e legislative – determina un effetto boomerang (Attwell e Smith 2017; Goldenberg 2021), provocando la rottura della sfera pubblica come luogo di confronto di habermasiana memoria e, quindi, radicalizzazione delle posizioni (da entrambe le parti però, anche se si tende a dimenticarlo). Ma, tra chi viene escluso, si tratta di molto di più: di un senso di crescente estraniazione dal sistema di valori dominante e dalle sue categorie di lettura della realtà, di vissuti di lacerazione profonda e sofferta di legami e appartenenze, di «continenti percettivi che si allontanano, di forme di vita che diventano inconciliabili» (Manifeste, p. 31). Da qui occorre partire per capire come mai, a volte, si possa anche passare da una salutare diffidenza verso le narrazioni del potere alla convinzione, più problematica, che “tutto ciò che ci è stato insegnato è falso”.

Se solleviamo un altro velo, ci imbattiamo questa volta nella superficialità che conduce a un classismo evidentemente ignaro di sé. Quando parliamo di persone, e magari studiose/i, di sinistra, colpisce lo sbrigativo appiattimento sulle categorie ipersemplificanti e stigmatizzanti introdotte dal giornalismo mainstream (anti-vax, complottista e tutte le altre richiamate sopra). Soprattutto perché sono diversi gli studi che hanno invitato a uno sguardo più attento e cauto quando si parla di “complottismo”. Sottolineando, innanzitutto, come questo tenda a proliferare dove lo scostamento tra la realtà esperita dalle persone e la sua rappresentazione da parte di media e istituzioni supera una soglia critica. Il complottismo – o quello che molti definiscono con questa categoria, comunque problematica – prospera, insomma, sulle bugie delle élite. E ancor prima, sul non detto: prospera, cioè, laddove questioni che hanno un peso cruciale sulle nostre vite non diventano oggetto di un dibattito pubblico, aperto e capace di dare cittadinanza e legittimità ai diversi punti di vista.[1] Che è come dire, rovesciando la prospettiva, che sempre più spesso i presunti “complottisti” sono (lasciati) i soli a trattare, con mezzi e risorse eterogenei, questioni assolutamente vitali: dalle tecnologie 5(6)G all’impatto della più generale digitalizzazione della società, dal transumanesimo alle politiche sanitarie emergenziali.

E poi, soprattutto: chi decide quali teorie sono complottiste? Cosa distingue una teoria sociale critica da una conspiracy theory? Puntando l’attenzione sulle traiettorie seguite delle teorie sociali, Pelkmans e Machold (2011) mostrano come siano quelle promosse e sostenute dalle classi subalterne quelle che, con maggiore probabilità, finiranno per essere etichettate come complottiste. Non è insomma questione di fondatezza o razionalità, poiché non è agevole né forse possibile individuare criteri di distinzione su un mero piano epistemologico. Alla fine, la differenza la fanno i rapporti di potere. Tanto che una teoria del complotto, se sostenuta da attori in posizioni di potere, difficilmente sarà riconosciuta e ricordata come tale, anche qualora ne venga chiaramente dimostrata l’infondatezza, la strumentalità, talvolta la portata nefasta dei risultati (classico l’esempio delle “armi di distruzione di massa” suppostamente detenute da Saddam Hussein).

Del resto, a proposito di classismo, non ha destato le reazioni che avrebbe meritato la presa fortissima che ha recentemente acquisito, sugli scambi comunicativi di tutti i giorni, l’idea per cui solo chi ha un titolo di studio specifico sia titolato a parlare. Frutto avvelenato (uno dei tanti) del burionismo. Eppure, una tale idea è stata accolta e fatta propria, anche, o forse soprattutto, a sinistra. Senza la minima preoccupazione di quanto ciò significasse legittimare il silenziamento di quanti non hanno un titolo di studio elevato, il che poi sottende evidenti implicazioni di classe e giustizia sociale; né di quanto, in questo modo, si alimenti acriticamente la logica pericolosa per cui tanto si riserva il potere di decidere agli “esperti”, quanto inevitabilmente si spinge verso la depoliticizzazione delle questioni, restringendo lo spazio del dissenso e del confronto (ci tornerò più avanti).

Ma continuiamo a scavare. Siamo sicuri che sia (solo) il complottismo il problema? Non sarebbe urgente problematizzare anche, o forse soprattutto, quello che alcuni hanno battezzato il “dispositivo anti-complottista” e le sue implicazioni politiche?[2] Un’operazione, questa, che svolge il Manifeste conspirationniste, mostrando le vicende storiche che legano strettamente le origini della retorica anti-complottista – quindi fin da Karl Popper – con la genesi del neoliberalismo e del suo There Is No Alternative. Se tentare di produrre una intelligibilità storica del corso degli eventi è una presunzione fatale; se chiunque tenti di dire qualcosa su questo mondo che questo non dica già da sé oltrepassa i suoi diritti epistemologici: allora, non resta che adattarvisi. La funzione del dispositivo anti-complottista è fin dalle sue origini, questa la tesi degli autori, quella di legittimare l’ordine sociale esistente, ambendo a riservare per sé la facoltà di cospirare.

NOTE

[1] Cfr. Pelkmans e Machold (2011), Lagalisse (2020); sul tema del prosperare del complottismo sulle bugie dei potenti si può vedere anche la mia intervista a Erica Lagalisse, Teorie della cospirazione e critica sociale. Come il complottismo prospera, non sempre a torto, sulle bugie delle élite, “Malamente”, n. 20, gennaio 2021, p. 47-62, <https://rivista.edizionimalamente.it>.

[2] In Italia se ne è occupato per es. Lolli (2023)

RIFERIMENTI BIBLIOGRAFICI

Anonimo (2022), Manifeste conspirationniste, Parigi, Seuil.

Attwell K., Smith D.T. (2017), Parenting as politics: social identity theory and vaccine hesitant communities, “International Journal of Health Governance”, 22(3): 183-98.

Bazzoli, N., Lello, E. (2022), The neo-populist surge in Italy between territorial and traditional cleavages, “Rural Sociology”, 87(1): 662-691.

Bordignon, F. (2023), Alternative science, alternative experts, alternative politics. The roots of pseudoscientific beliefs in Western Europe, “Journal of Contemporary European Studies”, 31(4): 1469-1488.

Bucchi, M., Neresini, F. (2002), Biotech remains unloved by the more informed, “Nature”, 416: 261.

Chalmers J. (2017), The transformation of academic knowledges: understanding the relationship between decolonizing and indigenous research methodologies, “Socialist Studies”, 12(1): 97-116.

Coniglione, F., eds. (2010), Through the mirrors of science. New challenges for knowledge-based societies, Heusenstamm, Ontos Verlag.

Consigliere, S. (2020), Favole del reincanto: molteplicità, immaginario, rivoluzione, Roma, DeriveApprodi.

de Sousa Santos, B., Nunes, J. A., Meneses, M.P. (2022), Opening up the canon of knowledge and recognizing difference, “Participations”, 32(1): 51-91.

Dentico, N., Missoni, E. (2021), Geopolitica della salute: Covid-19, OMS e la sfida pandemica, Soveria Mannelli, Rubbettino.

Dotson, T. (2021). The divide: how fanatical certitude is destroying democracy, Cambridge, MIT Press.

Foucart, S., Horel, S., Laurens, S. (2020), Les gardiens de la raison: enquête sur la désinformation scientifique, Parigi, La Découverte.

Gigerenzer, G. (2015), Imparare a rischiare: come prendere decisioni giuste, Milano, Cortina.

Goldenberg, M. (2016), Public misunderstanding of science? Reframing the problem of vaccine hesitancy, “Perspectives on Science”, 24(5): 552-81.

Goldenberg, M.J. (2021), Vaccine hesitancy: public trust, expertise, and the war on science, Pittsburgh, University of Pittsburgh Press.

Grignolio, A. (2016), Chi ha paura dei vaccini?, Torino, Codice.

Harambam, J. (2021), Against modernist illusions: why we need more democratic and constructivist alternatives to debunking conspiracy theories, “Journal for Cultural Research”, 25(1): 104-122.

Harambam, J., Aupers, S. (2015), Contesting epistemic authority: conspiracy theories on the boundaries of science, “Public Understanding of Science”, 24(4): 466-480.

Jasanoff, S. (2021), Knowledge for a just climate, “Climatic Change”, 169(3): 1-8.

Kahneman, D. (2012), Pensieri lenti e veloci, Milano, Mondadori.

Keren, A. (2018), The public understanding of what? Laypersons’ epistemic needs, the division of cognitive labor, and the demarcation of science, “Philosophy of Science”, 85(5): 781-792.

Lello, E. (2020), Populismo anti-scientifico o nodi irrisolti della biomedicina? Prospettive a confronto intorno al movimento free vax, “Rassegna Italiana di Sociologia”, 3: 479-507.

Lello, E., Raffini, L. (2023), Science, pseudo-science, and populism in the context of post-truth. The deep roots of an emerging dimension of political conflict, “Rassegna Italiana di Sociologia”, 4: 705-732.

Lello, E., Saltelli, A. (2022), Lobbismo scientifico e dirottamento dello spazio pubblico, in E. Lello, N. Bertuzzi (eds.), Dissenso informato. Pandemia: il dibattito mancato e le alternative possibili, Roma, Castelvecchi, 187-203.

Lolli, A. (2023), Il complottismo non esiste o Miseria dell’anticomplottismo, in M.A. Polesana, E. Risi (eds.), (S)comunicazioni e pandemia. Ricategorizzazioni e contrapposizioni di un’emergenza infinita, Milano-Udine, Mimesis, 239-271.

Nunes, J. A., Louvison, M. (2020), Epistemologies of the South and decolonization of health: for an ecology of care in collective health, “Saude e Sociedade”, 29(3): e200563.

Osimani, B., Ilardo, M.L. (2022), “Nessuna correlazione”. Gli strumenti per la valutazione del nesso causale tra vaccinazione ed evento avverso, in E. Lello, N. Bertuzzi (eds.), Dissenso Informato. Pandemia: il dibattito mancato e le alternative possibili, Roma, Castelvecchi, 167-186.

Pielke, R.A.J. (2005), Scienza e politica, Roma-Bari, Laterza.

Quijano, A. (2005), Colonialidade do poder, eurocentrismo e América Latina, in A colonialidade do saber: etnocentrismo e ciências sociais. Perspectivas latino-americanas, Buenos Aires, Clacso, 117-142.

Reich, J.A. (2014), Neoliberal mothering and vaccine refusal: imagined gated communities and the privilege of choice, in “Gender and Society”, 28(5): 679-704.

Sarewitz, D. (1996), Frontiers of illusion: science, technology, and the politics of progress, Philadelphia, Temple University Press.

Saurette, P., Gunster S. (2011), Ears wide shut: epistemological populism, argutainment and Canadian conservative talk radio, “Canadian Journal of Political Science”, 44(1): 195-218.

Schadee, H.M.A., Segatti, P., Vezzoni C. (2019), L’apocalisse della democrazia italiana: alle origini di due terremoti elettorali, Bologna, Il Mulino.

Smith, P.J., Chu, S.Y., Barker, L.E. (2004), Children who have received no vaccines: who are they and where do they live?, “Pediatrics”, 114(1): 187-95.

Steinberg, T. (2006), Acts of God: the unnatural history of natural disaster in America, Oxford, Oxford University Press.

Taussig, M.T. (1986), Shamanism, colonialism, and the wild man: a study in terror and healing, Chicago, University of Chicago Press.

Wei, F., Mullooly, J.P., Goodman, M., McCarty, M.C., Hanson, A.M., Crane, B., Nordin, J.D. (2009), Identification and characteristics of vaccine refusers, “BMC Pediatrics”, 9(18): 1-9.

Wu Ming 1 (2021), La Q di Qomplotto. QAnon e dintorni. Come le fantasie di complotto difendono il sistema, Roma, Alegre.

Ylä-Anttila, T. (2018), Populist knowledge: post-truth repertoires contesting epistemic authorities, “European Journal of Cultural and Political Sociology”, 5(4): 356-388.

Zagzebski, L.T. (2012), Epistemic authority: a theory of trust, authority, and autonomy in belief, Oxford, Oxford University Press.

Zografos, C., Robbins, P. (2020), Green sacrifice zones, or why a green new deal cannot ignore the cost shifts of just transitions, “One Earth”, 3(5): 543-546.

Il puzzle del sesso biologico - Il proposito di Trump e un possibile diverso atteggiamento

Il 20 gennaio 2025, Donald J. Trump ha pronunciato il suo discorso presidenziale durante la cerimonia di insediamento come 47esimo presidente degli Stati Uniti. Fra i tanti propositi espressi, c’è quello di mettere fine alla «alla politica governativa di manipolare socialmente genere e razza. Da oggi, la politica ufficiale del governo degli Stati Uniti sarà che ci sono solo due generi: maschi e femmine» . Si è dimenticato che esistono gli intersex e che la materia è molto più complessa. Ma si sa, politici e giornalisti sono noti per banalizzare questioni serie e stravolgere la realtà.

In alcuni post precedenti (La costruzione di una identità, prima parte - Sesso (biologico), genere (sociale) e orientamento sessuale: 3 concetti non sovrapponibili, Seconda parte – Il sesso nell’antichità, Individuare il sesso, una storia infinita, e Cosa succede quando si nasce intersessual*?), abbiamo analizzato come nel campo biomedico si è costruito (nel tempo) il sesso biologico e diversi casi controversi nell’attribuzione dell’identità sessuale. L’antropologia, poi, è un campo privilegiato per conoscere come (in molte culture) l’identità sessuale sia uno “spettro” (nel senso di un fascio policromatico, un raggio d'azione, un range) più che un’ontologia dicotomica o binaria. Siamo quindi giunti alla conclusione che il sesso biologico è un puzzle costituito da molteplici tessere: cromosomi, marcatori genetici molecolari, dotti riproduttivi, gonadi, ormoni, organi riproduttivi per la loro funzione, genitali per la forma e funzione, pubertà (intesa come flusso ormonale secondario) e funzioni riproduttive incluse (ma non unicamente), produzione del seme, inseminazione, gestazione e caratteristiche sessuali secondarie quali sporgenza della cartilagine tiroidea che circonda la laringe (o pomo d’Adamo), crescita dei capelli, rapporto tra massa grassa e muscolare, crescita mammaria, voce, sesso psicologico, educazione ecc. L’intersessualità, nella larga maggioranza dei casi, non incide in modo significativo sulla salute della persona. E i genitali sono, quindi, soltanto una parte del corpo, che varia da persona a persona, come i nasi o le orecchie o altre parti del corpo. L’aspetto e loro dimensioni non sono determinanti per l’attribuzione sessuale.

LA MANIA DELLE CLASSIFICAZIONI

Al di là delle varie (controversie) metodiche per attribuire il sesso a una persona, forse vale la pena chiedersi: ma perché è così importante stabile se quello davanti a me è un maschio o una femmina (ammesso che lo si possa determinarlo così facilmente)? Qual è lo scopo di una classificazione?

Il sociologo Harold Garfinkel, il padre dell’etnometodologia , sosteneva che qualsiasi categorizzazione (o il collocamento di un oggetto/pianta/animale/persona in un tipo) è una costrizione, sempre relativa perché stabilita in relazione agli scopi pratici (“for all practical purposes”) di coloro che classificano[1]. In altre parole, non c’è nulla nella referente osservata che indichi a quale categoria essa debba necessariamente appartenere. Una posizione anti-essenzialista, che condivide con la filosofia taoista dove non esistono valori assoluti, enti fissi o immobili, esseri o cose a sé stanti, come invece le categorie vorrebbero.

Per cui, ogni volontà di classificazione risponde a una necessità pratica. Nello sport, dove in tempi recenti sono stati sollevati i casi dell’ostacolista spagnola Maria José Martínez-Patiño, della mezzo-fondista sudafricana Caster Semenya, della calciatrice zambiana Barbra Banda e (pochi mesi fa) della pugile algerina Imane Khelif (vedi Individuare il sesso, una storia infinita), lo scopo sarebbe di porre tutte e tutti nelle medesime condizioni di partenza. Che è un’assurdità, perché non siamo tutti e tutte uguali, neanche… alla partenza. Giancarlo Antonioni (grande n. 10 della Fiorentina) non era uguale a Pelè (n. 10 del Santos). Lo scontro, se fosse stato un duello individuale, sarebbe stato impari. Come lo fu, nel 1970 e 1971, tra Carlos Monzon e Nino Benvenuti. Eppure stavano nella stessa categoria (pesi medi).

Inoltre, se la differenza tra uomini e donne fosse così netta, come mai certe tenniste (ma l’esempio lo si può fare per tutti gli sport) possono benissimo battere certi tennisti? Non ci sono solo il testosterone o 1 coppia cromosomica a fare la differenza, ma una molteplicità di altre variabili. Che sfuggono alle categorizzazioni, che le categorie non riescono a gestire. Il pugile Primo Carnera combatteva con quelli del suo peso, eppure forse aveva un vantaggio datogli da una presunta malattia genetica (l’acromegalia), in cui l'eccessiva produzione di ormone della crescita (Growth Hormone, GH) indotto spesso da un adenoma dell'ipofisi produce una serie di modificazioni degli arti e dei tratti facciali (anche il campione statunitense di wrestling André The Giant sembra esserne affetto). Attorno alle atlete sopra ricordate nacquero molte polemiche (che produssero anche squalifiche). Eppure loro erano nate così. Invece il velocista sudafricano Oscar Pistorius non era nato con le protesi in fibra di carbonio; eppure dal 2008 fu ammesso a gareggiare con i (cosiddetti) normodotati.

Ma non perdiamo la domanda di partenza: qual è la necessità pratica che presiede questa particolare necessità di classificazione binaria (maschi e femmine) nello sport? La competizione. Stabilire chi è il migliore, chi è il primo, chi è il più bravo. Lo scopo (eminentemente pratico) è solo questo. Non ci sono altre ragioni. Togliamo questa ragione (eminentemente pratica) e tutto crolla. Infatti, sono certo che se le pugili Imane Khelif (accusata di essere un uomo) e Angela Carini lavorassero nella stessa azienda, nessun politico chiederebbe (perché contrattualmente, purtroppo, le cose stanno ancora così in molte professioni) per Khelif uno stipendio maggiore perché ha una coppia di cromosomi XY. Perché se lo facesse, arriveremmo al paradosso che, lei sarebbe un maschio per lo sport e una femmina per il lavoro.

Ma non perdiamo la domanda di partenza: qual è la necessità pratica che presiede questa particolare necessità di classificazione binaria (maschi e femmine) nello sport? La competizione. Stabilire chi è il migliore, chi è il primo, chi è il più bravo. Lo scopo (eminentemente pratico) è solo questo. Non ci sono altre ragioni. Togliamo questa ragione (eminentemente pratica) e tutto crolla. Infatti, sono certo che se le pugili Imane Khelif (accusata di essere un uomo) e Angela Carini lavorassero nella stessa azienda, nessun politico chiederebbe (perché contrattualmente, purtroppo, le cose stanno ancora così in molte professioni) per Khelif uno stipendio maggiore perché ha una coppia di cromosomi XY. Perché se lo facesse, arriveremmo al paradosso che, lei sarebbe un maschio per lo sport e una femmina per il lavoro.

UNA PROPOSTA DI SOLUZIONE PER GLI SPORT DI SQUADRA

In attesa di trovare delle soluzioni per gli sport individuali, qualcosa invece si potrebbe già fare, almeno per quelli collettivi. Unico settore dove ancora esiste una rigida divisione tra maschi e femmine (con tutti i controlli necessari per incasellare le persone in una delle due categorie) ormai scomparsa a scuola, nei collegi, nella polizia e perfino nell’esercito, un tempo autentica palestra machista. Perché mantenere questo apartheid sportivo, anziché dissolverlo in squadre miste e intersex?

NOTE

[1] Ad esempio i censimenti e le classificazioni anagrafiche sono nate per scopi pratici: il controllo sociale della popolazione, la quantificazione dei beni, il reclutamento di militari ecc. Infatti, le prime informazioni riguardo a indagini sulla popolazione risalgono addirittura al 3800 a.C. dove i Sumeri affrontavano vere e proprie indagini per misurare la quantità di uomini e beni di cui si poteva disporre. Le informazioni acquisite erano utili soprattutto in caso di guerra o di carestie. Nella Bibbia si fa riferimento al censimento effettuato da Mosè nel Sinai: il Signore parlò a Mosè, (…), e disse: ‹‹Fate il censimento di tutta la comunità degli Israeliti, secondo le loro famiglie, secondo il casato dei loro padri, contando i nomi di tutti i maschi, testa per testa, dall'età di venti anni in su, quanti in Israele possono andare in guerra (…)››. (Numeri 1, 1-3. Vedi anche Esodo 30,11-16): https://it.wikipedia.org/wiki/Censimento. Il controllo sociale è anche il principale motivo per cui è nata la statistica sociale.

Internet ci rende transumani - La fattoria degli umani di Enrico Pedemonte

1. QUELLO CHE L’UTOPIA NON SA

«Il male che gli uomini fanno sopravvive loro; il bene è spesso sepolto con le loro ossa». Il rammarico dell’Antonio di Shakespeare potrebbe essere rivolto alle utopie che hanno accompagnato la nascita di Internet e dei dispositivi digitali, e i nomi di di Vannevar Bush o di Douglas Engelbart potrebbero sostituirsi a quello di Cesare. Nel 2008 Nicholas Carr si domandava se Google ci rende stupidi, e di sicuro oggi molti analisti concordano sul fatto che non siamo qui a lodare la convinzione che le macchine possano contribuire ad aumentare l’intelletto umano – ma a seppellirla. Dalla presentazione del 9 dicembre 1968, con cui Engelbart ha mostrato per la prima volta l’interazione con un computer tramite mouse e interfaccia grafica, siamo passati attraverso la commercializzazione massiva della Rete, la formazione dei monopoli delle Big Tech, il saccheggio dei dati personali, lo sviluppo della società del controllo, la dipendenza patologica dalle piattaforme, la filter bubble, la polarizzazione delle opinioni e il dibattito sulla disinformazione. Di sicuro si è persa l’innocenza delle origini, la promessa di un nuovo mondo della comunicazione, la speranza di una libertà che il principio di realtà aveva negato nel mondo offline, la fiducia in comunità virtuali, senza confini, dove raggiungere una piena espressione del sé di ognuno.

Enrico Pedemonte ripercorre la storia che porta da Vannevar Bush fino ai nostri giorni in La fattoria degli umani, cercando di capire cos’è successo all’utopia degli spazi digitali, cosa si è inoculato nel sogno di un’umanità più perspicace e più emancipata precipitandolo in un incubo, nel terrore che tutto possa concludersi con lo sterminio della nostra specie da parte di un’AI superintelligente. L’ipotesi che un giorno o l’altro una macchina assuma l’aspetto di Terminator e compia una strage, come in un film di fantascienza, non è una preoccupazione realistica; ma è significativo che la retorica da cui viene accompagnato lo sviluppo delle nuove tecnologie abbia dismesso l’entusiasmo per l’intelligenza connettiva di Pierre Lévy, e abbia abbracciato il timore di scenari catastrofici. Pedemonte sospetta che un vizio sia presente fin dall’origine, e che i suoi effetti si siano amplificati con l’espansione della forza economica e del potere politico dei giganti della Silicon Valley.

2. IMMUNITÀ LEGALE

Anzi, i difetti sono almeno due, e si sono rafforzati l’un l’altro, o sono forse due sintomi di una stessa crisi, ancora più profonda. Il primo ha origine fuori dall’ambiente culturale della Silicon Valley, e si sviluppa nel cammino tormentato con cui il parlamento americando ha raggiunto la versione definitiva del Communications Decenct Act. La legge stabilisce che le piattaforme online non devono essere equiparate agli editori tradizionali, e le tutela da ogni intervento del governo nei loro confronti: in questo modo attori del nascente mercato digitale, come Google, Facebook, Twitter, sono stati messi al riparo da qualunque regolamentazione sia sul controllo dei contenuti, sia sulla ripartizione della distribuzione pubblicitaria – e più in generale sulla valutazione delle loro posizioni monopolistiche nei settori della ricerca, dei social media, dell’intelligenza artificiale. La supervisione che viene applicata ai giornali, alle radio e alle reti televisive, non agisce sugli algoritmi che gestiscono il ranking dei listati di risposte, la selezione dei post e la composizione delle bacheche personali, la profilazione dell’advertising: eppure tra il 2004 e il 2021 il numero di giornali nel mondo è quasi dimezzato (-47%), mentre l’accesso alle notizie tramite i social media è diventato una consuetudine tra gli utenti del Web.

Ma l’obiettivo delle piattaforme tecnologiche non è quello di consolidare la fiducia dei lettori nella verità dei contenuti divulgati, bensì quello di trattenerli il più possibile nella compulsione delle bacheche, e nell’incentivare il più possibile l’interazione con like, commenti, condivisioni. Mentre la verità si sta ancora allacciando le scarpe, una bugia ha già fatto il giro del mondo: così chiosava Mark Twain. Il controllo delle informazioni richiede tempo, e il più delle volte una storia esposta in buona fede è affetta da lacune, passaggi critici, contraddizioni; l’artefazione, o (quando serve) l’invenzione completa dei fatti, possono invece adattarsi all’ecosistema ideologico degli interlocutori, e sfrecciare da una mente all’altra senza ostacoli. La fatica che è richiesta all’utente nella ricognizione della complessità del reale, gli viene del tutto risparmiata quando la notizia è costruita attorno all’effetto emotivo, che suscita scandalo, orrore, sdegno o pietà. Le notizie a tinte forti attraggono i clic, coinvolgono i lettori, accendono il dibattito – spingono verso la radicalizzazione dei pregiudizi, a detrimento della riflessione e della mediazione. Gli esiti sono tossici per lo stato di salute delle democrazie e per la coesione sociale; per i bilanci delle società che amministrano le piattaforme sono invece un toccasana, perché assicurano il buon funzionamento della loro attività produttiva principale, l’estrazione dei dati.

3. DATI

Shoshana Zuboff ha sottolineato l’affinità tra il modello di business di imprese come Google e Facebook da un lato, e l’industria mineraria o petrolifera dall’altro lato. Le informazioni che le Big Tech estraggono dal comportamento degli utenti permettono loro di conoscere le caratteristiche sociodemografiche, gli interessi, le opinioni, le abitudini, le relazioni personali, le disponibilità di spesa, le paure di ognuno e di tutti – e naturalmente anche di controllarli, manipolarli, sfruttarli. Nessun settore imprenditoriale si è mai rivelato tanto promettente dal punto di vista dei profitti, e nessuno è stato così agevolato nella crescita, e messo al riparo dalle difficoltà minacciate dalle istituzioni a tutela della privacy e della libera concorrenza, nonché dalle interferenze di attivisti e giornalisti troppo curiosi. Motori di ricerca e social media serbano una biografia di ciascuno di noi più ampia, più ricca e obiettiva, di quella che noi stessi sapremmo confessare nel segreto del nostro foro interiore: nella registrazione di tutte le nostre domande, dei nostri like e dei nostri post, protratta per anni, si deposita una traccia delle aspirazioni, degli interessi e delle paure di cui spesso non conserviamo una memoria cosciente, ma che i database di Google e di Facebook mettono a disposizione degli inserzionisti. Inconscio, abitudini e passioni, individuate nel momento in cui emergono da pulsioni interne o da opportunità sociali, diventano la leva ideale per vendere prodotti e servizi – ma anche candidati elettorali, ideologie, priorità e strategie politiche.

Le piattaformi digitali tendono al monopolio: le persone frequentano i posti dove si trovano già tutti i loro amici, o cercano le informazioni che sono condivise dai loro clienti e dagli interlocutori in generale. In questo modo chi ha accumulato più dati è in grado di offrire esperienze più divertenti e informazioni più personalizzate, intercettando quindi nuovi utenti e appropriandosi ancora di più dati. Chi vince piglia tutto, come accade a Google che detiene circa il 90% delle quote del mercato della ricerca online mondiale. La tensione che ha alimentato questa forma di capitalismo trova la sua ispirazione e giustificazione ideologica nella letteratura di Ayn Rand e della fantascienza che ha nutrito imprenditori, tecnici, guru, profeti e visionari nerd della Silicon Valley: è questo il secondo vizio – questa volta del tutto interno alla cultura tech – che ha segnato dalle origini il percorso delle utopie della Rete. L’umanità deve essere salvata da se stessa, dalla sua imperfezione e dalla sua mortalità, e questo compito può essere assunto solo da un eroe che trascende qualunque limite gli venga opposto dalla società, dalla legge, dalle tradizioni e persino dal buon senso (anzi, da questo prima di tutto). L’individualismo senza rimorsi, la tensione a diventare l’eletto che porterà gli altri uomini oltre se stessi, anche a costo della loro libertà – sono il codice in cui è scritto il programma utopistico della Rete, come sede della vita che vale la pena di essere vissuta. Chi non ce la fa, o chi cerca di resistere – o addirittura chi tenta di non essere d’accordo – è destinato a soccombere e a scivolare nell’oblio della storia. La violazione della privacy, il prelievo dei dati, la manipolazione delle intenzioni, non sono quindi attività illegali, ma sono i doni che l’eroe riversa sull’umanità, per liberarla dalle sue limitazioni, dalle sue paure irrazionali, dalla sua mortalità.

4. L’UOMO (?) CHE VERRÀ

Pedemonte elenca sette movimenti in cui si possono classificare le mitologie principali da cui è guidato il capitalismo della Silicon Valley: Transumanesimo, Estropianesimo, Singolarismo, Cosmismo, Razionalismo, Altruismo Efficace, Lungotermismo. Le categorie non sono esclusive, si può aderire a più parrocchie nello stesso tempo, o transitare nel corso del tempo da una all’altra. In comune queste prospettive coltivano il culto dell’accelerazione nello sviluppo di nuove tecnologie, l’ambizione di realizzare simbionti tra uomo e macchina, dilatando le capacità cognitive degli individui, riprogrammando la vita e la natura, eliminando imprevisti, patologie e – ove possibile – anche la morte.

Le aspirazioni appartengono alla fantascienza, le intenzioni utopistiche sono sepolte e dimenticate, ma lo sviluppo di metodi di controllo, l’accentramento monopolistico, la violazione della proprietà intellettuale, l’abbattimento progressivo dello stato sociale e la privatizzazione dei suoi servizi, sono ormai la realtà del capitalismo dei nostri giorni – che ha trovato nelle tecnologie digitali, e nell’etica hacker che ne sostiene la progettazione, la piattaforma su cui reinventarsi dopo la crisi degli ultimi decenni del XX secolo. La realtà che è sopravvissuta alle utopie novecentesche è un mercato che ha assorbito la politica e la cultura, dove l’unico individuo che può esprimersi liberamente è quello transumanistico, che pone la macchina come obiettivo, e l’autismo del nerd come modello di vita.

BIBLIOGRAFIA

Carr, Nicholas, Is Google Making Us Stupid?, «The Atlantic», vol. 301, n.6, luglio 2008.

Engelbart, Douglas, Augmenting human intellect: A conceptual framework, SRI Project 3578 Stanford Research Institute, Menlo Park California October 1962.

Lévy, Pierre, L'Intelligence collective. Pour une anthropologie du cyberespace, La Découverte, Parigi 1994.

Pedemonte, Enrico, La fattoria degli umani, Treccani, Milano 2024.

Zuboff, Shoshana, The Age of Surveillance Capitalism: The Fight for a Human Future at the New Frontier of Power, Profile Books, Londra 2019.

Covid, tecnocrazia e "vera" politica - Due progetti paralleli

Dalle prime due parti (qui, la prima parte e qui, la seconda parte) dell’analisi degli algoritmi di valutazione dell'andamento della pandemia, ad aprile 2020, è emerso che questi algoritmi sono un caso solo apparente di tecnocrazia.

In realtà, abbiamo visto che:

- il tentativo di rendere gli algoritmi completi ha generato un eccesso di complessità che ha reso questi strumenti praticamente inservibili ai fini della decisione sulla Fase 2

- la decisione di passare alla Fase 2 è stata principalmente politica, seppur basata su un set minimale di dati scientifici, limitato ai trend di contagi, decessi e di saturazione delle terapie intensive.

Ora, questo non toglie che la relazione tra scienziati e governo abbia effettivamente avuto un carattere tecnocratico già nel primo periodo della pandemia[1], tra febbraio e maggio 2020.

Per comprendere la reale portata ed estensione di questo carattere tecnocratico faremo alcune brevi considerazioni su:

- il CTS e la rilevanza del valore della salute nella gestione della crisi

- il ruolo che ha giocato il CTS nei processi di decisione del governo

Vedremo che il governo ha preso le sue decisioni in modo principalmente politico ma, invece, ha lasciato ampio spazio a scienziati e tecnici sul come metterle in atto.

COS’ERA E COME FUNZIONAVA IL COMITATO MEDICO SCIENTIFICO

La presenza del CTS nel processo di decisione del Governo ha, certamente, amplificato il ruolo dei valori di salute e di sopravvivenza come condizioni di possibilità del bene comune e, quindi, ha condizionato le azioni del governo nella direzione di “prima la salute”.

Infatti:

- il ruolo del CTS era di dare consulenza al Capo del Dipartimento della Protezione Civile – e più tardi direttamente al Governo – su come fronteggiare la diffusione del contagio;

- i componenti del CTS erano “esperti e qualificati rappresentati degli Enti e Amministrazioni dello Stato”, di fatto 8 componenti su 12 erano medici: i tre presidenti del Consiglio superiore di sanità, dell'Istituto superiore di sanità e dell’AIFA, un professore di patologia clinica e di comunità, un esperto di medicina delle catastrofi, un infettivologo e un epidemiologico.

- Il CTS era sempre – ogni giorno, al mattino molto presto – l’iniziatore del processo di decisione. Era il CTS a effettuare la sintesi e il vaglio delle informazioni raccolte dal fronte del contagio e a prepararsi, sulla base dei dati, a dare consiglio al Capo della Protezione civile e ai rappresentanti del Governo, in primis al Ministro della Salute;

- spesso, il CTS agiva in coda al processo, assumendo la funzione di supporto e di legittimazione delle decisioni prese: i membri del CTS partecipavano e parlavano alle conferenze stampa e ai talk show fornendo elementi di spiegazione e di sostegno alle misure restrittive o meno del Governo.

Ora, per disciplina, per etica procedurale, la salute è il faro guida del medico, soprattutto in termini di assenza di malattia, di normale funzionamento del corpo, «Dovere del medico è la tutela della vita, della salute fisica e psichica dell'Uomo e il sollievo dalla sofferenza» (Codice di Deontologia Medica, all’Art. 3 – Doveri del Medico).

Ne risulta abbastanza ovvio che il CTS - un consesso di medici - si sia concentrato sui pilastri deontologici, guarire chi si è ammalato, garantire il funzionamento delle strutture di cura e, in caso di infettività, prevenire e controllare la diffusione della malattia.

Altrettanto ovvio appare il fatto che il Governo, consigliato e sostenuto dal CTS abbia posto i valori della salute e della sopravvivenza biologica al primo posto della propria scala assiologica nell’affrontare la crisi.

È interessante, peraltro, vedere che paesi iper-liberisti come Inghilterra e Brasile, in cui non c’era nulla di simile al nostro CTS, si siano, invece, orientati più nettamente sui valori della sussistenza economica delle imprese, del paese in generale e di conseguenza dei cittadini, mettendo in conto «un numero evitabile di persone contagiate e di morti» (Habermas J., Proteggere la vita, tr. It. D’Aniello F., Società editrice Il Mulino, 2022, p. 51); è famosa l’infelice frase di Boris Johnson: «many more families are going to lose loved ones before their time».

TECNOCRAZIA O NO?

Si ripropone quindi la domanda: Il Governo ha davvero preso delle decisioni, ha fatto delle scelte morali[2], oppure chi le ha fatte è stato il CTS?

Prima di provare a dare una risposta va ricordato che la più grande partita di decisioni si è giocata sul campo dell’economia, quello degli aiuti e dei sostegni economici.

Su questo campo il governo ha preso delle posizioni, ha compiuto delle vere e proprie scelte morali, basate su dei criteri e su una assiologia chiari; una assiologia che ha determinato la destinazione e i tempi dei sostegni economici, a chi prima e a chi dopo, a chi di più e a chi di meno. La scala di priorità è stata inizialmente concentrata sui lavoratori dipendenti delle imprese medio-grandi, quelle in grado di accedere alla cassa integrazione guadagni, per intenderci ed è poi cambiata, per rispettare le istanze di giustizia sociale portate avanti dalle opposizioni: occhio ai dimenticati dei primi momenti – tra cui liberi professionisti, lavoratori autonomi e microimprese.

Fatta questa premessa, proviamo a focalizzare quale sia stato il rapporto tra CTS e Governo nei primi mesi; l’analisi[3] di documenti video, di verbali e di decreti mostra che:

- è fuori di dubbio che il Governo abbia fatto delle scelte morali sul tema della salvaguardia della salute e della sopravvivenza. Il Governo ha delineato una scala di valori e questi valori li ha contestualizzati nel particolare della situazione che andava affrontando.

- È altrettanto fuori di dubbio che, nel costruire questa priorità di valori che vede salute e sopravvivenza in alto, il governo sia stato influenzato dal CTS – soprattutto dalla componente medica. Però, è emerso anche che la storia personale dei leader di governo, la tradizione di partito, le esperienze fatte, abbiano avuto un ruolo determinante

- Dove, invece, il Governo è stato molto più influenzato dal CTS sembra essere stato nel COME realizzare la tutela della salute e della vita. In questo, la vera scelta del governo è stata di affidarsi a tecnici, ai medici, agli epidemiologi. Lo dice Conte in passaggio chiarissimo il 25 di febbraio.[4]

- È evidente che la scelta di affidarsi a scienziati e tecnici è stata fatta sulla base del criterio delle competenze mediche e tecniche del CTS.

Quindi, sul come gestire la crisi, come salvaguardare la salute, il governo ha scelto di affidarsi, consapevolmente, a quelli che riteneva competenti e questo delinea palesemente una forma di tecnocrazia indiretta. Il processo analisi – sintesi – decisione – legittimazione in cui il CTS è dominante in tre passaggi su quattro ne è conferma.

Ma, ricordiamolo, all’inizio nessuno sapeva cosa stesse accadendo, né capiva cosa potesse accadere e, in quel momento di emergenza, il fattore tempo sembrava essere determinante[5].

Così come – in un momento successivo - ha fatto affidando a un militare la logistica della distribuzione dei vaccini. In Italia solo i militari hanno competenze logistico-operative e piani già pronti di quel tipo. Nessun altro. Non avrebbe potuto farlo un tecnico degli acquisti come Arcuri (bravo a reperire materiali con contratti emergenziali a prova di bomba).

Che poi il CTS abbia seguito delle linee super consolidate e tradizionali come l’ospedalizzazione sempre e comunque, la rinuncia alle cure domiciliari, linee che trovano una impressionante analogia nel Diario della Peste di Defoe – parliamo del 1665 – è altra cosa, su cui non credo di poter dare giudizi. Mi tengo dei sospetti.

Quindi, in conclusione, siamo stati di fronte ad una forma di solo parziale tecnocrazia, in cui il governo ha mantenuto per sé la prerogativa delle decisioni politiche sul cosa fare per gestire la crisi sanitaria ed economica, in termini di priorità, quantità, destinazioni, inclusioni ed esclusioni, ma ha ceduto sovranità alla scienza e alla tecnica sul come perseguire a questi obiettivi.

NOTE

[1] Non considero quello che è successo nei mesi successivi, con le due seconde ondate, quella di riaperture e quella di contagi dell’autunno 2020, del secondo lockdown, dei vaccini, del green pass e delle varie misure interdittive.

[2] Scelta morale: decisione su come orientare la propria condotta pratica basata su una scala di priorità tra principi o valori, appunto, morali.

[3] Le fonti sono i discorsi pubblici del Presidente de Consiglio e dei diversi Ministri – reperibili facilmente su YouTube o sul sito della Presidenza del Consiglio, i testi dei Decreti del presidente del Consiglio, i Decreti Ministeriali, le circolari della Protezione Civile, ecc.. Chi volesse avere un’ampia bibliografia e sitografia può chiederla alla Redazione di Controversie.

[4] Le parole di G. Conte: «io non ho competenza scientifica in questo campo, non ho alcuna competenza, e sarebbe presuntuoso […] sopravanzare e sovrapporsi a […] quelle che sono le valutazioni tecnico-scientifiche […] loro hanno articolato quelli che sono tutti i comportamenti e sono raccomandazioni indicazioni rivolte al personale sanitario e ovviamente a tutti i cittadini» (Conferenza stampa del Presidente Conte dalla Protezione civile, YouTube - Palazzo Chigi, Canale ufficiale del Governo italiano, 25 febbraio 2020 (https://www.youtube.com/watch?v=gWJoo8O6mZ8))

[5] Il problema del confronto con una situazione in cui «i fatti sono incerti, la posta in gioco alta, i valori in conflitto, e le decisioni urgenti» è affrontato dalle raccomandazioni della Scienza Post Normale; rimandiamo a Saltelli, A., 2024, SCIENZA POST-NORMALE, XI Appendice dell’Enciclopedia Italiana di Scienze, Lettere ed Arti, Istituto della Enciclopedia Italiana, Roma - https://www.researchgate.net/publication/387296164

Gli algoritmi del Covid-19. Un caso di tecnocrazia? - Seconda parte

Nella prima parte di questo percorso abbiamo esaminato i meccanismi algoritmici che avrebbero dovuto guidare il Governo Conte nelle decisioni sull’allentamento delle misure restrittive e di contenimento del contagio da SARS-CO-V-2.

Ora possiamo fare un passo in avanti nell’analisi critica degli strumenti di valutazione e sul loro ruolo nelle decisioni del Governo.

CONSISTENZA DEGLI INDICATORI

Nell’intenzione del Ministero della Salute e del Governo – e del Comitato Tecnico Scientifico che ha messo a punto i criteri e gli algoritmi – questi strumenti di valutazione del contagio e delle possibilità di contrastarlo dovrebbero essere il più possibile esatti, coerenti, oggettivi e indipendenti dalle interferenze politiche, e guidare il governo in modo sicuro e incontrovertibile verso la decisione “scientificamente” più corretta.

Di fatto, invece, il sistema di valutazione presenta delle aree di criticabilità metodologica, dei punti di debolezza e di incoerenza – soprattutto considerando il particolare momento in cui deve essere utilizzato - e risente di alcune evidenti influenze di tipo storico, sociale e politico che ne minano le attese di esattezza, oggettività e indipendenza.

Tra queste criticità, spicca che alcuni degli indicatori della capacità di monitoraggio[1] sono statisticamente poco indicativi in un momento in cui la capacità diagnostica è fortemente sottodimensionata. In questo particolare periodo la propensione italiana alla diagnosi con tampone è tra le più basse d’Europa (pur con una percentuale di positivi molto più alta degli altri paesi). Parliamo di una media di soli 88 tamponi per 100.000 abitanti al giorno.[2] Ne viene particolarmente inficiato il riferimento alla percentuale di casi segnalati con indicata la data di inizio dei sintomi e/o il comune di domicilio del caso stesso. Quello che questo indicatore misura effettivamente è un sottoinsieme non rappresentativo della situazione reale.

Un discorso simile vale per gli indicatori sulla capacità di accertamento diagnostico., in particolar modo per quelli relativi ai tempi tra inizio dei sintomi, diagnosi e isolamento. Per le ragioni appena viste di scarsa propensione “al tampone”, il numero di diagnosi effettuate e segnalate è sicuramente molto inferiore ai casi realmente presenti sul territorio; d’altro canto, l’indicatore – in questo periodo - non può che essere “fuori soglia”, a causa del meccanismo per lo più carente di prescrizione, prenotazione ed esecuzione del test diagnostico, che dilata enormemente i tempi tra inizio dei sintomi e diagnosi.

Un altro punto di caduta è rappresentato dagli indicatori sull’impegno di personale dedicato al tracciamento e al monitoraggio dei contatti oltre che alle operazioni di prelievo e invio dei test ai laboratori Un impegno che dovrebbe essere in linea con raccomandazioni Europee relative agli standard su numero, tipologia e ore di lavoro.

Un indicatore metodologicamente confuso, poiché mette insieme “mele con pere” (le mele sono l’impegno di contact-tracing, le pere l’impegno di gestione del processo di invio ai laboratori), con contorni poco chiari: il termine tipologia figure professionali è di difficile interpretazione in assenza di un elenco chiuso e condiviso di tipologie; il valore di riferimento per l’impegno pari a 1 operatore equivalente ogni 10.000 abitanti[3] (verbalizzato al CTS il 29 di maggio) cioè almeno 750 operatori per la sola area del milanese, ma, di nuovo, senza indicazioni su che tipologie di figure professionali debbano essere impiegate.

Inutile parlare della percentuale di casi confermati di infezione nella regione per cui sia stata effettuata una regolare indagine epidemiologica con ricerca dei contatti stretti: è un indicatore importante ma decisamente fuori contesto nella situazione di aprile – maggio 2020, in cui il Sistema Sanitario rincorre a distanza con i pochi mezzi disponibili l’evolversi del contagio. Lo stesso vale per i parametri di trasmissione che implicano l’analisi dei focolai e delle catene di trasmissione. Entrambi gli indicatori risultano incongrui nella situazione di aprile e maggio 2020.

Gli indicatori sulla stabilità della trasmissione sembrano essere più consistenti e aderenti al contesto: in linea generale, il trend dei casi segnalati alla Protezione Civile e al sistema integrato di sorveglianza sono sicuramente rappresentativi dell’andamento del contagio, anche se probabilmente sottostimano il fenomeno e risentono – nella componente di temporalità – dei difetti procedurali già visti. L’indicatore dei casi segnalati alla Sentinella COVID-Net è opzionale e – di fatto – non attuato, come non sembra essere mai stata attuata la rete-sentinella.

Un discorso a parte andrebbe fatto – ma non è questa la sede - per il parametro Rt, uno strumento che sembra essere metodologicamente valido solo se i significati di alcuni suoi parametri[4] vengono usati con cautela.

UNA QUESTIONE DI POLITICA SANITARIA: GLI INDICATORI DI OSPEDALIZZAZIONE

Nel terzo gruppo di indicatori – quello dei parametri di trasmissione e di tenuta dei servizi sanitari, troviamo il Tasso di occupazione della Terapia Intensiva, con la soglia accettabile del 30%, e il Tasso di occupazione dei posti letto in Area Medica per pazienti COVID-19, con una soglia di accettabilità del 40%. Questi due parametri sono sintomatici dell’approccio di ospedalizzazione che caratterizza la gestione del contagio in Italia: quello che preoccupa il CTS e il Ministero è se gli ospedali sono in grado di sostenere il flusso di malati da ricoverare, ignorando completamente – anche negli indicatori oltre che nella pratica – il ruolo della medicina territoriale, della terapia domiciliare (attuata solo sporadicamente in poche regioni) e della relativa sorveglianza. Di fatto, chi è malato e ha sintomi preoccupanti deve andare in ospedale; chi, invece, è malato e non va in ospedale è sostanzialmente lasciato a sé stesso; non è interessante – per la valutazione dell’andamento della pandemia – avere dati sulla consistenza del presidio medico territoriale e domiciliare: il focus è l’ospedale.

INCOERENZE INTERNE DEL SISTEMA DI VALUTAZIONE E DI ALLERTA?

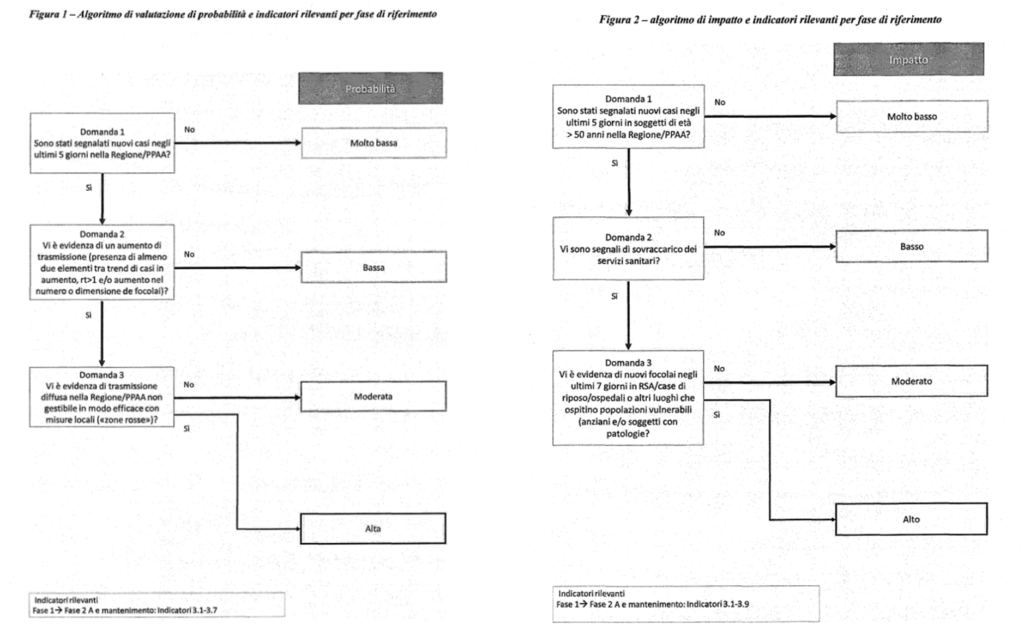

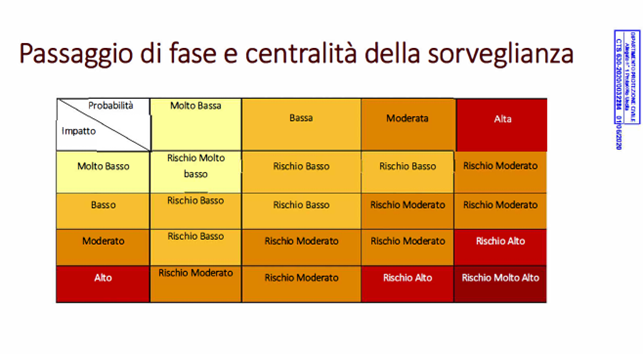

È curioso notare che l’algoritmo di valutazione del rischio è contenuto nello stesso documento dei 21 indicatori puntuali e di trend, ma – in realtà – fa riferimento solo al terzo gruppo di indicatori, quelli sulla trasmissione del contagio e sulla tenuta della risposta sanitaria (ospedaliera, s’intende) e include dei criteri di valutazione che esulano dai 21 indicatori - ad esempio, la gestibilità o meno della diffusione con “zone rosse” localizzate, oppure l’età (oltre i 50 anni) dei soggetti contagiati.

Lo sviluppo dell’algoritmo di calcolo del livello di rischio – nonostante sia un sistema di allarme per la “marcia indietro” verso misure di controllo più rigorose - sembra essere slegato da due terzi degli indicatori e assai riduttivo rispetto a quello per valutare la possibilità di transizione alla Fase 2.

Sembra che l’allerta e la marcia indietro tengano conto della sola misura dei fenomeni e non della loro misurabilità; come dire: non importa se i dati non sono affidabili, si decide su quelli.

D’altra parte, è pur vero che il sistema di calcolo prevede che – in caso di difficoltà o scarsa affidabilità delle misurazioni – ci si attesti su una condizione di rischio elevato e si imponga la “marcia indietro”.

In conclusione, dall’esame di dettaglio, si evidenziano numerosi punti deboli, in sintesi:

- scarsa indicatività statistica di una buona parte degli indicatori relativi alla capacità di monitoraggio e di accertamento diagnostico

- incongruenza di altri indicatori rispetto al contesto in cui sono applicati e, quindi alla loro effettiva utilizzabilità

- visione focalizzata sulle procedure di ospedalizzazione dei parametri di tenuta dei servizi sanitari e assistenziali

- incoerenza di alcuni passi dell’algoritmo di valutazione del rischio rispetto all’insieme di indicatori di processo e di risultato e la scarsa integrazione tra i due algoritmi

SIAMO DI FRONTE AD UN CASO DI SCIENTIFIZZAZIONE DELLA POLITICA?

Lo strumento di valutazione del tasso di rischio e delle condizioni di possibilità della transizione alla Fase 2, che il Comitato Tecnico Scientifico fornisce al Ministero della Salute e al Governo, composto dal set di 21 indicatori e dai due algoritmi, è molto articolato, apparente non troppo complesso da maneggiare e sembra cogliere un range ampio e abbastanza completo di punti di attenzione per la valutazione dello stato del contagio. La sua struttura rispecchia gli obiettivi di esattezza, coerenza, oggettività e indipendenza dalle interferenze politiche e sociali, per guidare l’azione politica in modo sicuro verso decisioni “scientificamente” corrette.

È chiaro che si tratta di un caso di tentata scientifizzazione della politica:

- le decisioni – se viene usato lo strumento per come è costruito – possono essere appaltate alla “scienza” e non tenere conto di variabili socialmente rilevanti quali, per fare un esempio, le esigenze di continuità del reddito o di socializzazione

- le indicazioni dello strumento sono basate su indicatori molto generali, che non tengono conto della stratificazione di età, di condizioni di salute (fa eccezione il > 50 anni dell’algoritmo della probabilità) e sociali.

- La visione dell’intervento è ristretta alla dimensione di ospedalizzazione e ignora tutti fenomeni e le possibilità di intervento e di azione sul territorio

- La scarsissima condivisione pubblica della strumentazione di osservazione e algoritmica, disponibile solo a prezzo di una ricerca approfondita tra i Decreti e i relativi allegati, denuncia una scarsa propensione della “scienza ufficiale” alla discussione pubblica.

In questo quadro, la “scienza medica ed epidemiologica” apparentemente neutrale ed oggettiva ma, come abbiamo visto, orientata alla semplificazione dei fenomeni, cieca alle sue dimensioni sociali e storicamente focalizzata sull’ospedalizzazione, sembra “catturare e guidare” la politica, portando i decisori ad abdicare al loro ruolo guida.

Tuttavia,

- le debolezze del sistema di misurazione, che lo rendono una cattedrale teoretica nel deserto epistemologico della pandemia del primo semestre 2020, con utilizzabilità estremamente limitata, salvo accontentarsi dei pochi indicatori effettivamente misurabili,

- e la mancata applicazione della regola che avrebbe imposto lo stop alla transizione a causa della valutazione di rischio elevato in caso di non misurabilità degli indicatori

hanno favorito un maggiore grado di libertà e di movimento da parte dei decisori politici.

Il governo italiano e il Presidente del Consiglio Conte hanno, infatti, dimostrato – forse solo nel caso delle riaperture del 4 e 18 maggio 2020 – di riuscire ad essere svincolati[5] dalla scientifizzazione e hanno deciso, di fatto, sulla base di una aperta dialettica tra le istanze morali della salute da un lato e della sopravvivenza economica dall’altro.

Le riaperture “limitate” del DPCM del 26 aprile[6] e il relativo controllo dello stato dei contagi sono state, quindi, il risultato di compromesso tra le istanze normative della medicina e la sintesi tra le due posizioni di stampo decisamente politico del governo e delle opposizioni[7].

NOTE

[1] Ad esempio, la percentuale di casi segnalati con indicata la data di inizio dei sintomi e/o il comune di domicili

[2] Cfr. Analisi Gimbe dei tamponi effettuati dalle Regioni nel periodo 22 aprile – 6 maggio 2020, in Franco Pesaresi, Tamponi: quanti se ne fanno e quanti ne servono, Welforum, Osservatorio Nazionale sulle politiche sociali, 14 maggio 2020

[3] Fonte: Verbale n. 83, 29 maggio 2020, Riunione del Comitato Tecnico Scientifico, Dipartimento della Protezione Civile

[4] la relativa isteresi rispetto al fenomeno, i problemi di distorsione del ricordo dell’insorgenza dei sintomi, la sua dubbia significatività per dare atto della velocità di diffusione o della virulenza di un agente infettivo in contesti di densità di popolazione diversa

[5] Questa conclusione non tiene in considerazione le decisioni del periodo successivo, in particolare quelle relative alle campagne di vaccinazione e al green pass, capitoli molto delicati sul tema della subordinazione della politica alla scienza.

[6] Si veda qui il testo del DCPM 26 aprile 2020

[7] Ne parlo diffusamente nella mia Tesi Magistrale Le scelte morali del governo italiano durante la prima parte della crisi pandemica del 2020.

Gli algoritmi del Covid-19 – Un caso di tecnocrazia?

La gestione della pandemia SARS-CoV-2 è stata, molto probabilmente, un caso emblematico di tecnocrazia, in cui la politica ha abdicato al suo ruolo di decisione per il bene pubblico a favore delle competenze tecnoscientifiche, in particolare mediche ed epidemiologiche, e delle linee di comportamento dettate dal Comitato Tecnico Scientifico istituito dalla Protezione Civile[1] e, spesso, con scarsissima o nessuna trasparenza.

L’algoritmo studiato dal CTS, nell’aprile del 2020, per misurare l’andamento del contagio e valutare se procedere con la fase di riaperture sembra essere un esempio lampante di questa tecnocrazia: è uno strumento complesso e fortemente tecnico, “detta” - di fatto – al governo quali comportamenti tenere e, infine, è rimasto praticamente celato all’interno dei decreti, non ne è stata data alcuna pubblicità né è stato possibile discuterne democraticamente

Proverò, in questo articolo, a far conoscere e ad esaminare criticamente i contenuti di questo algoritmo, e in quello successivo (che sarà pubblicato da Controversie la prossima settimana) a mostrare quale sia stato il suo ruolo e se, in questo caso, la politica abbia effettivamente ceduto la mano alla tecnoscienza. Con, forse, qualche sorpresa.

INQUADRAMENTO STORICO

Siamo alla fine di aprile del 2020, a un mese e mezzo dalla dichiarazione di pandemia di Covid-19[2], la situazione pandemica – datata 26 aprile – nel mondo e in Italia è questa:

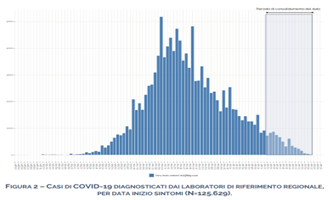

Il picco di contagi[3] è stato registrato da pochi giorni, il 20 aprile, e per la prima volta dall'inizio dell'epidemia, l'Italia registra una diminuzione nel numero degli “attualmente positivi”: 20 in meno del giorno precedente, per un totale di 108.237. Anche i ricoveri e le terapie intensive sono in calo; dalla prima settimana di aprile, infatti, i contagi giornalieri seguono una curva sensibilmente discendente, come si può vedere dal grafico del bollettino di “Aggiornamento nazionale, 28 aprile 2020”[4]