Un pensiero per coloro che periscono di certezza

Alla lunga, diventa piuttosto insostenibile vagare con il solo scopo di diffondere opinioni nate altrove. Per questo, inizio con un’ammissione di colpevolezza, forse più d’una.

Prima ammissione: questa risposta, pensata in origine come contraltare all’articolo di Matteo Donolato sul caso del sovraesteso femminile, è stata riscritta più volte di quanto mi piacerebbe ammettere. Al punto che mi ero convinto che valesse la pena scrivere un collage che comprendesse tutte le versioni precedenti. Sarebbe stata un’opzione molto democratica e molto moderna, sufficientemente paritaria. C’era tutto, pro e contro, e tutti nati in seno ad una stessa persona, che poi sarei io…

Seconda ammissione, corollario della prima: devo confessare di essere stato sballottato a fasi alterne dall’una all’altra parte della staccionata, e con altrettanta momentanea convinzione, con fretta e foga, ho interpretato il burattino degli uni e degli altri, di chi ci sta e di chi non ci sta. Ed ogni volta bisognava analizzare, e poi giudicare e condannare o perdonare. Arrivavo alla fine, e quel minimo di non-so-bene-cosa mi faceva scrivere, ad ogni conclusione, «che idiota!».

Dunque, ricomincio. C’è il fatto, lo strano caso del sovraesteso femminile: l’Università di Trento decide di andare per la via della provocazione, ogni professione indicata al maschile nei documenti d’Ateneo diverrà femminile, dunque sovraesteso. Ogni presidente è ora presidenta, ogni studente può diventare studentessa - the sky is the limit!

A dirla tutta, non nasce interamente come “caso”, lo diventa. Ci sono due rami della questione. Da una parte, mediaticamente, la divisione si forma sulla capacità divisiva dell’atto stesso, dall’altra questo stesso effetto di polarizzazione fomenta, in un fenomeno di feedback, l’amplificarsi della questione. Ecco, all’orizzonte, il «caso mediatico», il cui intimo meccanismo reclama la polarizzazione come elemento necessario per la sua riuscita, anzi, per la sua stessa esistenza.

Se tutto va a buon fine, da qualche parte si imbandisce un panel televisivo saggiamente strutturato per raccogliere il peso della provocazione e semplificare il tutto in una disputa tra contendenti. L’amplificazione iniziale funziona come una disseminazione ad alta velocità, «bisogna che se ne parli». Diversamente, lo scontro mediatico raccoglie i frutti con una sorta di sistema ad imbuto per generare categorie altamente digeribili. Rallenta il tempo, si distilla una suddivisione semplice delle parti contendenti: chi sta di qua e chi sta di là. È tutto propedeutico al nutrimento dell’ascoltatore. Due opinioni opposte l’una all’altra, ma sufficientemente chiarificate, possono essere distribuite al popolo, che a sua volta produrrà ancora una volta un effetto a cascata verso il basso. Così, la buona novella circola per il mondo, molto più semplice e strutturata di prima, e ciascun talk show si ripete in ogni bar che offra da bere del bianchino alle dieci del mattino, o qualche spritz all’happy hour.

Ma stai di qua o stai di là?

Se non hai deciso una parte, allora cosa parli a fare?!

Innanzitutto, pazienza… e dubbio che, a intenderlo propriamente, dovrebbe essere il metodo per sviare da questo inferno. Se dico «propriamente», è perché la polisemia di dubbio rischia di generare - ahimè - un ulteriore dubbio, dunque riformulo.

In un primo senso, dubitare contraddistingue un modo dell’intelligenza di procedere in avanti: dubito tra questa e quell’opzione. Nei limiti del possibile, possiamo chiamarlo un fatto di «problem solving». Quando dubito se sia meglio andare a destra o a sinistra, non dubito della mia inclinazione a giungere alla destinazione che mi sono precedentemente prefissato.

Dall’altra parte, con «dubbio» potremmo intendere ciò che da Henri Bergson in poi chiamiamo «l’inversione del normale corso di pensiero»: andare indietro, piuttosto che in avanti. Non consiste nel dubitare di quale opzione favorire - cosa scegliere dal menu o quale strada sia più favorevole al raggiungimento della meta -, ma piuttosto dubitare del modo nel quale le opzioni sono poste - sarà il menù giusto? Perché vado dove vado?

Non è più un’operazione dell’intelligenza dettata dal superamento di un ostacolo, ma più propriamente un atto del pensiero e della riflessione e…del dubbio.

A proposito di questo metodo, quando l’autore del Saggio sui dati immediati della coscienza (1889) ripropone il classico paradosso di Achille e la tartaruga, la contrapposizione tra spazio e tempo è sviscerata nel medesimo modo: non bisogna partire dalla dicotomia tra spazio e tempo come problema già formato, ma piuttosto risalire fino alla formulazione della questione. Primo lato della questione: siamo sicuri che spazio e tempo vadano posti come sono posti? Secondo lato della questione: perché, ed è una domanda a cui è altrettanto fondamentale rispondere, la dicotomia è stata posta proprio in questi termini?

È un modo di procedere che contraddistingue tutta l’opera bergsoniana: è necessario risalire la catena delle false contrapposizioni, curandosi di dar ragione del perché, in primo luogo, quella falsa dicotomia è venuta ad essere. In Materia e memoria la dicotomia tra idealismo e realismo è denunciata come errore già nelle pagine introduttive, mentre ne L’evoluzione creatrice sono poste in questione le (false) dicotomie tra ordine e caos, finalismo e meccanicismo, e molto altro ancora. Pur con qualche postilla, si può affermare che quello del filosofo francese è un metodo generale del pensiero.

Dunque, nel nostro caso si tratta non soltanto di osservare con scrupolo le opzioni che l’opinione pubblica ci propina, ma di saggiare le modalità stesse di questa produzione di schieramenti e, ultimo ma non ultimo, riflettere sulle ragioni per cui il dubbio che procede a “ritroso” parrebbe, almeno ad un primo e fugace sguardo, essere così sistematicamente avversato.

Perché da ambo le parti c’è una certa fretta, tanto di coloro che con fermezza reclamano la condanna repentina, quanto degli altri che gioirebbero sentendo annunciare che ciò che ieri era provocazione, oggi diventa legge e imposizione; ed ambo le parti sfruttano il “dubbio” solo nel suo senso “semplice”, ossia nel riproporre, piuttosto incessantemente, dei dubbi da risolvere rapidamente tra alternative già determinate: vai di qua o vai di là?

Possibile aver così poca cura di ciò che ci circonda da altalenare tra l’immediato rifiuto del nuovo o la condanna di ciò che è stato, con l’ottusa fiducia che ciò che sarà, per ciò stesso, sarà meglio? Anche l’altalena tra il «nuovo» e il «già stato», direbbe Bergson, è una falsa alternativa.

D’altra parte, nel suo secondo significato il dubbio rivela - almeno potenzialmente - l’inganno delle opzioni, scoprendosi come l’atto stesso di contrapposizione alla fretta delle parti. In virtù di ciò, non è un primariamente un meccanismo deduttivo per risolvere l’incertezza tra le opzioni, ma un metodo di retrocessione per porre sotto esame la creazione stessa del campo di alternative che ci sono proposte.

Se dovessi ipotizzare dove ci porterebbe questa ricerca, in primis si rivolgerebbe con sospetto verso la foga che contraddistingue questi schieramenti della domenica, che il giorno prima ci sono, il giorno dopo spariscono a favore di qualcos’altro. Bisognerebbe indagare psichicamente questa famelica necessità di applaudire e ripudiare, in quello che a tutti gli effetti sembrerebbe una continua fioritura di micro-identificazioni “alla giornata”, il cui funzionamento necessita la ripetizione ininterrotta di nuove approvazioni, così come richiede la brevità temporale di ogni nuova “battaglia”.

In ciò, si rivelerebbe al fondo degli attuali movimenti pseudo rivoluzionari, di cui “la provocazione del sovraesteso” fa parte, la loro ingenuità: a foga e certezza rispondono con foga e certezza, a iper-legiferazione rispondono con altrettanta iper-legiferazione, di conseguenza sono interamente determinati - oso dire prodotti - dal sistema stesso che credono di fronteggiare.

Di conseguenza, tra coloro che ci fanno ballare tra l’innegoziabilità di ciò che è sacro e la rinegoziazione di ogni cosa, la nostra attenzione dovrebbe vertere non tanto sulla valutazione di quale alternativa preferire, ma sulla presentazione stessa di questa alternativa, e delle ragioni storiche e culturali che forzano questo ristretto menù contro i nostri occhi, limitandoci la vista. Scoveremmo, come ho già scritto, il loro modo comune, l’intenzione manifesta di passare per la via dell’iper-legiferazione, che - in aggiunta o parallelamente - non passa più per i soli canali statali o sovrastatali, ma opera con un taglio trasversale tramite sistemi che mimano, ovunque, i tribunali: “giudizio-sulla-rete”, “cancel-culture” e “bolle mediatiche”, sono pienamente in linea con la definizione di questo percorso iperbolico della codificazione.

Scoveremmo tra coloro che difendono a spada tratta una lingua - come se questa fosse nata in seno alla mente brillante di un solo ed eroico legiferatore patriottico - e coloro che professano la possibilità di rinegoziare ogni parola - come se la lingua rinascesse nuova e candida ad ogni mattina - il comune desiderio di agire su vasta scala ad una micro-codificazione della lingua, fin nelle sue più intime fibre, al fine di direzionare le fibre sociali che stanno per essa… almeno in teoria.

Tra i movimenti rivoluzionari della lingua, e i moti controrivoluzionari della cultura, scoveremmo il timore comune di perdere il controllo di ciò che varia - di quel «che varia davvero, nonostante ogni previsione o premonizione» - benché l’una parte se ne dichiari fallacemente a favore, e l’altra esplicitamente contraria.

Una rettrice uomo salverà il mondo?

Il 28 marzo scorso il Consiglio di Amministrazione dell’università di Trento ha deciso per l’uso del femminile sovraesteso in tutti i suoi documenti ufficiali. Ovvero, per esempio, il rettore e il presidente diventano la rettrice e la presidente, anche se si tratta di uomini.

A seguito di questa decisione il rettore Flavio Deflorian diventa la rettrice Flavio Deflorian, il quale (o la quale?) ha così commentato il suo nuovo status: “Leggendolo mi sono sentito escluso. Così ho capito il senso della decisione”.

Il comunicato ufficiale recita: “È il primo caso di atto redatto in questo modo all’Università di Trento. Dall’adozione nel 2017 delle guida sul linguaggio rispettoso delle differenze, prosegue l’impegno dell’Ateneo per la costruzione di un’università più inclusiva”.

L’obiettivo di costruire un’università sempre più inclusiva è senz’altro condivisibile e, d’altro canto, il tema dell’inclusività è diventato uno dei temi più sensibili in tutte le università del mondo occidentale. Nel frattempo io faccio una certa fatica a capire perché nelle università non sia altrettanto popolare, che so, il tema dello sfruttamento dei bambini nelle miniere di litio africane per estrarre il raro minerale indispensabile per far funzionare i nostri pc e le nostre auto pulite… ma vabbè, sto divagando.

Torniamo al punto, naturalmente questa iniziativa ha fatto discutere sui giornali e sui social (ma per quel che ho visto, avrei immaginato un dibattito più caldo e serrato, segno forse che l’iniziativa di UniTrento non è stata presa molto sul serio?). Naturalmente molte voci a favore, provenienti soprattutto dalle aree culturali riconducibili ai movimenti come quello delle transfemministe e, a rimorchio, dai partiti di sinistra; qualche voce scettica, anche a sinistra, e non poche voci ironiche o sarcastiche, non necessariamente provenienti solo da visioni socio politiche di destra o reazionarie.

A questo punto però credo che ci siano due domande da farsi, la prima: una iniziativa di questo tipo ha una funzione di reale utilità nella lotta alle diseguaglianze di genere nella società? E la seconda: è per forza necessario dividersi per schieramenti ideologici (e partitici) su un tema come questo?

Provo a rispondere, a puro titolo personale, a entrambe le questioni. Senza girarci troppo attorno, credo che iniziative come questa non servano assolutamente a nulla per la causa dell’inclusione e, anzi, siano controproducenti. Già, perché ai reazionari con mentalità patriarcale (e chi decide se uno è reazionario con mentalità patriarcale?) un’iniziativa a come questa non solo NON li farà riflettere, ma servirà ad aumentare la loro convinzione di essere “in un mondo di pazzi” dal quale difendersi arroccandosi sulle proprie rassicuranti posizioni.

Poi però serve a poco (o a nulla) anche con le persone di mentalità aperta e consapevoli. Perché costoro sanno bene che esistono problemi reali, di contenuto, e scrivere rettrice di un uomo non risolve nulla dei problemi reali. E, quindi, quando leggo la dichiarazione della rettrice / rettore, che dice di essersi sentito escluso e di aver (finalmente!) capito (il non detto è “il dramma dell’esclusione femminile e fluida”), mi viene da ridere. Per cui, professoressa Flavio & C., se lei ha bisogno di questa cosa per capire che ci sono ancora da colmare dei gap di genere, siamo messi male male…

In realtà farei un torto all’intelligenza della rettrice / rettore a pensare che solo attraverso questa iniziativa lei / lui abbia preso coscienza esistenziale delle disuguaglianze di genere. Così a me questa iniziativa di UniTrento non sembra neppure una provocazione per sensibilizzare. Mi sembra, invece, solo un atto di piaggeria verso le frange estreme della cosiddetta cultura woke che, detto en passant, nulla hanno a che spartire col concetto di inclusività. Peggio ancora.

Ma qui c’è un altro punto, qualcuno effettivamente cerca un dialogo e un confronto su questi temi? A qualcuno interessa parlare di contenuti, di situazioni concrete? Francamente vedo sempre più intransigenza da una parte e dall’altra e sempre meno voglia di capire le ragioni altrui, e questo vale per tutti i temi di confronto del vivere comune nelle nostre società. Vengo poi alla seconda domanda. È proprio necessario creare delle contrapposizioni ideologiche?

Parrebbe di sì. Uno sport diffusissimo nel mondo intero, da sempre, è quello di dividersi in fazioni. A prescindere, in parte o anche completamente, dai contenuti. Contrapposizioni tra fazioni che spesso sfociano nella categorizzazione e demonizzazione del pensiero altrui e, infine, in odio reciproco; odio di appartenenza, di bandiera, che non è una bella cosa e che sa tanto di disagio psicologico.

Il problema è rompere questa spirale e spostare la discussione dal “packaging” al contenuto.

Non saranno delle rettrici uomini a riuscire in questo.

Perturbare l’universale - Un sasso lanciato nello stagno

Il rapporto tra genere e istituzioni è problematico fin dalle origini, poiché le istituzioni stesse sono le prime ad aver contribuito, spesso in maniera determinante, alla produzione e riproduzione del sessismo. In particolare, le istituzioni hanno agito in due modi: attraverso la discriminazione di alcuni gruppi, a partire dalle donne, fino a omosessuali, transessuali, intersessuali, etc., evidenziandone le particolarità; oppure esse hanno agito nel senso opposto, invisibilizzando gli stessi gruppi attraverso l’uso di un neutro universale. Per questo chiedersi quale possa essere il ruolo del linguaggio delle istituzioni nella sovversione del binarismo di genere è una domanda complessa e sfaccettata.

Già nel 1986, Alma Sabatini, una linguista femminista, su segnalazione della Commissione Nazionale Pari Opportunità della Presidenza del Consiglio dei ministri, ha scritto un testo per dare indicazioni per attenuare il sessismo della lingua italiana. A seguito di un’indagine sulla terminologia usata nel linguaggio istituzionale, nei libri di testo e nei mass media, Sabatini sottolineò la prevalenza del genere maschile, usato in italiano anche con doppia valenza (il cosiddetto maschile neutro) che annulla la presenza del soggetto femminile dai discorsi. Ha sottolineato il mancato utilizzo di termini istituzionali e di potere declinati al femminile (ministra, assessora, sindaca) e il prestigio concesso a un termine maschile, ma non al corrispettivo femminile. Sabatini afferma che: “La premessa teorica alla base di questo lavoro è che la lingua non solo riflette la società che la parla, ma ne influenza e limita anche il pensiero, l'immaginazione e lo sviluppo sociale e culturale”.

Le fondamentali riflessioni di Sabatini, e le sue raccomandazioni, hanno evidenziato l’assenza delle donne dal linguaggio della scena pubblica, ma allo stesso tempo hanno mostrato come criticare l’universale maschile non significhi uscire dal binarismo di genere. La struttura della lingua italiana, infatti, richiede una costante esplicitazione del genere a cui si appartiene, arrivando ad attribuirlo anche alle cose inanimate. Inoltre, per esprimere questa appartenenza di genere, in italiano è possibile riferirsi solo al maschile o al femminile, poiché non esiste un genere neutro che possa essere utilizzato. Negli ultimi anni, molti movimenti sociali che si definiscono queer hanno cercato di mettere in discussione questo binarismo imposto attraverso l’uso di asterisco, @ o -u come desinenze non sessuate. In questo senso i movimenti parlano di “queerizzare” la lingua italiana. Ciò significa pensare al modo in cui la lingua può essere forgiata dall’interno per opporsi, seguendo le indicazioni della linguistica queer[1], alle idee essenzialiste, naturalizzate ed egemoniche su genere e sessualità. Queste sperimentazioni, però, non trovano spazio negli ambiti istituzionali, nei quali sono ancora percepite come elementi di disordine[2]. Una forma di resistenza linguistica che proviene dai movimenti politici, da un uso situato e perturbante della lingua e dalla possibilità di utilizzare il linguaggio contro se stesso.

Allo stesso tempo, è importante notare come, nella tradizione del femminismo italiano della cosiddetta seconda ondata, il rapporto con la legge è spesso stato problematico ed è stato messo in discussione in molti modi. Come reso evidente riflessione del Collettivo della Libreria Femminista di Milano Non credere di avere dei diritti (1987), l’inclusione delle donne nell’attuale sistema giuridico è considerata un rischio: in questo senso era . In questo testo su giustizia e diritto si sostenevano alcune tesi: il diritto è concepibile solo come traducibilità e fonte dell’esistenza sociale; la giustizia può andare oltre il diritto attraverso la formula del giudizio politico sull’ingiustizia; fare giustizia significa praticare, ciascuna nel luogo in cui si trova, un’idea di mondo giusto fondata innanzitutto sulla valorizzazione dell’esperienza e sulla trama delle relazioni umane. Come sottolinea Tamar Pitch: “una caratteristica comune dell’approccio femminista è la messa in discussione della definizione positiva del diritto e della tradizione più rigida del positivismo giuridico, producendo norme e ragionando su norme al di fuori del perimetro della legge [...]. Questo non solo perché il femminismo costituisce ‘punto di vista esterno’, [...] ma perché ragiona sulle norme in vista della possibile produzione di regole giuste” (Pitch T., I diritti fondamentali: differenze culturali, disuguaglianze sociali, differenza sessuale, Giappichelli, 2004, p. 62).

Con queste premesse è possibile capire perché le teorie femministe guardino in maniera ambivalente i regolamenti, che allo stesso tempo esprimono le norme ma possono essere anche terreno della loro risignificazione, anche a partire dal linguaggio. In particolare da un linguaggio, come l’italiano, che non solo propone un rigido binarismo di genere, ma che riproduce costantemente l’egemonia maschile e la maschilità egemonica: “la maschilità egemone […] garantisce (o si presume garantisca) la posizione dominante degli uomini e la subordinazione delle donne. […] Il segno distintivo dell’egemonia è, infatti, l’autorità reclamata e ottenuta, più che la violenza diretta” (Raewyn W. C. Connell, Masculinities, Polity Press, 1995, p. 69) ed è pertanto quell’insieme di comportamenti, abitudini, modi di vita e di azione che riproducono il dominio senza bisogno di agire forme di coercizione. La maschilità egemone non è un tipo di carattere fisso, sempre e ovunque lo stesso, bensì si tratta della “maschilità che occupa una posizione egemone in una struttura data di relazioni di genere, una posizione che è sempre possibile contestare” (Cit., p. 76), anche da parte degli stessi maschi.

La teoria della maschilità egemone si basa sul pensiero di Antonio Gramsci e sul suo uso del concetto egemonia, il processo grazie al quale le classi dominanti ottengono un potere epistemico di definizione della cornice di significato entro la quale la realtà viene letta. Gramsci sottolinea come le classi dominanti mantengano la propria posizione di privilegio non solo attraverso l’azione diretta di un dominio, ma anche attraverso la creazione di modelli culturali tramite che possano creare consenso nelle classi subordinate rispetto alla legittimità e l’inevitabilità della posizione di privilegio della classe dominante stessa.

E le donne si trovano a occupare la posizione subalterna, a potersi esprimere solo con le parole e l’immaginario maschile, anche quando parlano di loro stesse. E i termini maschili e le desinenze maschili vengono presentate come neutre e in quanto tali universali e incontestabili. Proprio per questo, anche attraverso l’analisi del linguaggio, “possiamo […] ripensare la mascolinità egemonica come contesto pervasivo, superando la semplice distinzione tra soggettività egemoni e marginali o subalterne. Insomma intendere una più generale egemonia della e non nella maschilità, leggendo criticamente i riferimenti simbolici che strutturano, in forme diverse, tutte le maschilità” (Ciccone S., Maschi in crisi, Rosenberg & Sellier, 2019, p. 119).

Parlare di sé al maschile (come quando io, da donna, scrivo “eravamo tutti d’accordo") o riconoscersi in un appellativo al maschile (come quando le studenti rispondono al “buongiorno a tutti” di chi entra in aula), svela come l’essere donna sia una condizione straniante, in cui si è oggetto dei discorsi senza poterne diventare soggetto. Le donne imparano a pensarsi, in qualche modo, attraverso lo sguardo e le parole maschili e poi lavorano per differenza, per scarto rispetto a quello che vivono, in un processo che sovverte le traiettorie usuali del riconoscimento: non si tratta, infatti, di scoprire qualcosa, ma di smantellare qualcosa di già detto, di già riconosciuto.

Seguendo Teresa de Lauretis potremmo dire, così, che “il femminismo […] scoprì l’inesistenza della donna: il paradosso di essere allo stesso tempo catturate e assenti nei discorsi, sempre parlate ma inascoltate, e nell’impossibilità di esprimersi, mostrate come uno spettacolo eppure non rappresentate o irrappresentabili […], un essere la cui esistenza e la cui specificità sono simultaneamente affermate e rifiutate, negate e controllate” (de Lauretis T., Eccentric Subjects, in Ead. Figures of Resistance (1990), University of Illinois Press, 2007, p. 151). Questa inesistenza della donna diventa il motore per non poter fare a meno di interrogarsi costantemente su cosa voglia dire donna e “la ragione per cui non possiamo farne a meno è che, per le donne, il paradosso della donna non è un’illusione o un’apparente contraddizione, ma una realtà” (Cit., p. 154). Donna, quindi, sarebbe il prodotto di un’esclusione, di un’alterità che si mostra in maniera lampante nel linguaggio che utilizziamo.

In tutta la storia dei femminismi, non a caso, le donne si sono appropriate del lessico politico degli esclusi, dall’uguaglianza della Rivoluzione Francese all’emancipazione sindacale, per risignificarlo e svelarne la parzialità. Quando Olympe de Gouges scrive la Dichiarazione della donna e della cittadina nel 1792 non fa altro che questo: perturbare la rivendicazione dei diritti dell’uomo mostrando come quella stessa pretesa di universalità escluda le donne. Sostituire la parola donna alla parola uomo negli articoli della Dichiarazione, quindi, non è un gesto puramente semantico – come non lo sono mai le sovversioni linguistiche femministe, lesbiche, gay e transfemministe –, ma si tratta uno spaesamento che permette di cogliere i dispositivi di inclusione ed esclusione che sottendono alla politica. De Gouges lascia quasi invariato il testo della Dichiarazione, sostituendo donna e cittadina tutte le volte che compare uomo e cittadino, ma modifica in maniera sostanziale l’articolo dedicato alla libertà di opinione, che nella sua formulazione recita:

la libera comunicazione dei pensieri e delle opinioni è uno dei più preziosi diritti della donna, poiché tale libertà assicura la legittimità dei padri nei confronti dei figli. Ogni cittadina può quindi affermare liberamente: sono madre di un figlio che vi appartiene, senza che un barbaro pregiudizio la costringa a dissimulare la verità

(Olympe de Gouges, Déclaration des droits de la femme et de la citoyenne, 1791; trad. it., Dichiarazione dei diritti della donna e della cittadina, Il Melangolo, 2007, pp. 21-22).

De Gouges lega così la libertà di opinione alla possibilità di mettere in discussione uno dei cardini dell’ordine patriarcale: l’indissolubile legame tra paternità e matrimonio. Un gesto che sovverte l’ordine familiare, basato sull’idea della centralità del matrimonio come baluardo della legittimità della prole e strutturato attraverso il predominio maschile. E in questo modo, a partire da una condizione apparentemente privata come la maternità, mette in crisi quell’ordine politico fondato proprio sull’ordine domestico.

De Gouges svela anche l’impostura di una volontà generale che si esprime in una universalità che in realtà è maschile. Inoltre, riformulando l’articolo IV, pone in relazione libertà e giustizia, definendola come l’azione di restituire tutto quello che appartiene ad altri: poiché le donne non hanno mai posseduto nulla, possono così riappropriarsi di tutto quello che è loro. Emerge, così, un ideale di uguaglianza che cerca di tutelare anche la differenza[3], chiedendo un’inclusione nello spazio pubblico che non cancelli una storia differente, fatta si sopraffazione e ingiustizia, ma anche di resistenza.

In questo senso utilizzare un femminile sovraesteso permette un inciampo nel pensiero e nel linguaggio che può spingerci a riflettere sulle modalità di costruire l’universalità e i soggetti come omogenei, intercambiabili. Il disagio che gli uomini possono provare nel sentirsi inclusi in un tutte o nel trovarsi descritti come le docenti può essere produttivo non tanto per fondare una nuova norma, ma per perturbare quelle già esistenti e per provare a modificare la percezione delle cariche, dei ruoli di potere ma anche della pretesa universalità del maschile sottolineando le esclusioni che provoca. Il campo del linguaggio, in questo senso, è un campo di battaglia su cui vale la pena scendere e che sicuramente vale la pena osservare, anche per dare spazio ad altre narrazioni e ad altre possibili strutture, senza dimenticare, però, gli effetti materiali trasformativi che può produrre e che dovrebbero essere prodotti.

[1] La linguistica queer è una definizione data da Heiko Motschenbacher a quella branca della linguistica che, ispirandosi alle teorizzazioni sul queer, analizza criticamente le nozioni essenzialiste, egemoniche e naturalizzate su genere e sessualità. Si veda M. Heiko, Taking Queer Linguistics further: sociolinguistics and critical heteronormativity research, International Journal of the Sociology of Language, 212, 2011, pp. 149-179.

[2] Cfr. M. Baldo, Frocie, femminelle, terrone, polentone e favolosità varie. Quando il queer è di casa, online, 2017, http://www.queeritalia.com/blog/2017/5/13/frocie-femminelle-terrone-polentone-e-favolosit-varie-quando-il-queer-di-casa1 e I. Marotta e S. Monaco, Un linguaggio più inclusivo? Rischi e asterischi nella lingua italiana, Gender/sexuality/Italy, 3, 2016.

[3] Cfr. Martina Reuter, Equality and Difference in Olympe de Gouges’ Les droits de la femme. A La Reine, Australasian Philosophical Review, 3, 4, 2019, pp. 403-12.

Mundus patet - Ernesto De Martino e l’informe atomico

E la fine di “un mondo” non significherà la fine “del mondo” ma, semplicemente, “il mondo di domani”

Ernesto De Martino

Risale ai miti fondativi dell’antica Roma la comparsa del termine mundus, con cui si indicava il perimetro della città. Terra già esistente, diviene cosmo creato in virtù di un gesto collettivo. Il rito di fondazione prevedeva la partecipazione di un gruppo o, secondo uno sguardo diacronico, di una comunità. Ovidio racconta che venne scavato un fosso in cui riporre beni di vario genere. In seguito questo venne riempito di terra. Fu Romolo stesso, secondo l’autore, a tracciare con l’aratro «il solco su cui costruire le mura»[1]. Non solo un perimetro, bensì un’intera superficie. Catone spiega la derivazione del senso terreno del mundus dal mondo che sta «sopra di noi: la sua forma infatti […] è simile alla forma di quello»[2]. Alla forma a volta dell’universo corrisponde la forma a fossa, a “U”, del mondo sotto di noi, chiamato anche mundus Cereris: il mondo dei defunti. Il mondo degli inferi è cautamente sigillato con un apposito coperchio apribile, oppure è sovrastato dall’altare di Romolo. Mundus è dunque l’insediamento, il centro fissato, ma anche il limine tra mondo celeste e inferi. In quanto soglia esso assume un significato aggiuntivo, inserendosi in un’articolazione di senso e di operazioni ulteriori. Insieme al bue nero e alla giumenta bianca[3], Romolo si mette alla guida della sua aratro per tracciare il confine, il limen, del nuovo insediamento. È a partire dalla centralità delle tecniche agricole nella società romana “delle origini” che è possibile individuare il terzo senso del termine mundus che, secondo Herbert J. Rose, «poteva essere destinato a determinati riti agrari, poteva contenere per esempio piccole quantità di grano non tanto come primizie bensì per essere benedette dalle potenze del mondo infero»[4]. Si istituisce uno scambio tra mondo dei vivi e mondo dei morti cui segue la rigenerazione della terra. Nel capitolo di Morte e pianto rituale dedicato alla “Messe del dolore”, l’etnologo napoletano Ernesto De Martino (1908-1965) analizza la configurazione del rapporto dell’uomo del mondo antico con l’esperienza di morte. L’autore sostiene che «veder fiorire» e «veder scomparire» sono accadimenti che dipendevano «in larga misura da potenze che sfuggivano al controllo umano»[5], ma che nondimeno venivano integrati in un «ordine di lavori agricoli» che – come l’arare, il seminare e il raccogliere – istituivano un rapporto speculare con quelle forze indomabili, per cui l’uomo «si fa procuratore di morte secondo una regola umana»[6]. Così come, attraverso il raccolto, l’uomo decide per la morte della spiga, così attraverso il seminare l’uomo opera in direzione della propagazione della vita, della sua ripetizione. L’autore riconosce che questo rapporto organico non risolve, non evita, il rischio di una crisi[7]. Occorre fissare un primo interrogativo: in che senso non è sufficiente osservare e domesticare la natura – imitandola – per essere certi che «domani ci sarà un mondo»[8]?

Che cosa è “mondo”? È una sfera? Oppure è una volta, cui corrisponde una fossa, separate da un coperchio che noi uomini calpestiamo? Lo storico delle religioni Mircea Eliade (1907-1986) ha tentato di descrivere il tipo di spazio che viene in essere nell’esperienza dell’uomo religioso. Così come il coperchio serve ad un tempo da membrana e da limite invalicabile del mundus Cereris, così le Colonne d’Ercole sono il limite ultimo oltre cui non spingersi, pena cadere nel nulla e ritrovarsi faccia a faccia con Atlante. Allo strapiombo dell’Inferno dantesco corrisponde, secondo una simmetria longitudinale, la verticalità del Purgatorio alla cui somma sta l’Eden[9]. In queste tre rappresentazioni ricorre un carattere osservato da Eliade: «per l’uomo religioso lo spazio non è omogeneo»[10]. Esistono spazi consacrati, con una loro forza, un loro preciso significato; ed esistono spazi «non consacrati […] amorfi»[11]. I primi sono «l’unica cosa reale», mentre i secondi costituiscono una mera «informe distesa» che circonda i primi[12]. Lo spazio sacro diviene tale in virtù di una ierofania, di una manifestazione delle forze sacre che sancisce una separazione ontologica tra lo spazio sacro e lo spazio profano[13]. Da questa cesura nasce il templum come perimetro e indice che questo posto, questo cerchio di terra, è sede delle potenze sacre. Il tempio si costituisce come centro di orientamento, come centro di irradiamento: qui il sacro si concentra, il fedele vi si dirige, il sacro ne emana e viene sigillato in una forma – coperchio o montagna. Il mondo sembra essere, stando a Eliade e De Martino, il “reale” che si dispiega in quanto tale in forza di una significazione. Più che un villaggio, un bosco o un pianeta, il mondo è un prodotto – da producere, portare avanti – derivante e continuamente costruito nel rinnovamento di un legame agonistico dell’uomo con sé stesso e con le forze su cui non può nulla. Il mondo è il risultato di una tessitura faticosa che ricorda quella di Penelope: potenzialmente infinita. Se il mondo non è qualcosa di stabile bensì di stabilizzato che cosa succede quando l’uomo cessa di essere religioso? Religio, rilegare, cucire insieme l’uomo e il mondo, inserire l’esteriorità entro una trama ordinata, un disegno. Secondo Eliade non è possibile trovare un uomo che non sia religioso in toto, «anche la vita più desacralizzata conserva tuttavia le tracce di una valoristica religiosa del Mondo»[14]. Siamo meno religiosi, ossia siamo meno adeguati ad una religione istituzionalizzata, e il nostro rapporto con la natura è per molti aspetti meno sacralizzante che un tempo. Eppure la religione intesa come rapporto non riguarda solo le relazioni uomo-divinità e uomo-natura, bensì anche quella dell’uomo a sé e al suo simile. La religione è quel comportamento umano che continuamente sancisce la validità di determinati valori che divengono condivisi in quanto universalizzabili, ossia: traduce quotidianamente in pratiche le regole di un comportamento dello stare insieme in uno spazio collettivo. La comunità non è una sommatoria di individui, bensì un insieme organico orientato verso un modo del vivere in comune che costituisce la base per la formulazione delle regole – tacite o meno – di questo stesso vivere in comune. La religione, come la politica; il mundus, come lo Stato. Cosa hanno in comune queste forme di rapporto? Arrischiamo una risposta provvisoria: la religione e la politica, il mundus e lo Stato, costituiscono le forme – dunque i mondi? – entro cui si regolano le attività umane attraverso l’istituzione di regole e di valori che, differentemente da quanto oggigiorno si predica, non sono indefinitamente rinegoziabili. Se viviamo nell’epoca di crisi dei valori non è perché siamo meno religiosi o perché ci muoviamo in un mondo in cui le scienze “dure” insegnano la prevedibilità dei fenomeni, mostrandoci contemporaneamente la loro fallibilità intrinseca e dunque inducendoci a un certo scetticismo. La crisi dei valori deriva in primo luogo dalla friabilità della postura di chi ritiene che questi siano tutti, indipendentemente, sempre di nuovo rinegoziabili. L’apparente marmoreità di questa posizione vacilla nel momento in cui ne si considera il rovescio, il risvolto pratico: l’equivalenza potenziale di ogni futuro possibile.

Ci siamo domandati in che senso non è sufficiente osservare e domesticare la natura per essere certi che domani ci sarà un mondo. Se il mondo sorge come effetto di un procedimento di tessitura del reale che pone l’uomo al livello di Aracne, non stiamo dando troppo potere all’uomo? Se questo rimane religioso in quanto tessitore, possiamo accettare che il mondo finisca? Eppure, prima di domandarci questo, dobbiamo chiederci, insieme a De Martino, che cosa significa pensare la fine del mondo. Secondo l’etnologo il mondo è primariamente culturale. Il problema della fine sorge anticamente[15]: culture differenti rappresentano secondo le relative divinità, concezioni dello spazio e del tempo, della morte, la loro fine del mondo[16]. Il rischio della fine del mondo è ricorsivo e va affrontato in quanto, secondo l’etnologo, «se ignorato o leggermente accantonato può comportare soluzioni catastroficamente negative per l’umanità»[17]. Nel suo contributo De Martino declina gli assi portanti della sua riflessione alla luce dei «200 000 di Hiroshima»[18]. Il 6 agosto 1945, alle otto del mattino, un mondo è finito. Eppure, qualcuno ha preparato questa fine, la ha calcolata scrupolosamente sottomettendola a sperimentazioni, approvazioni e registri; ne ha osservato gli effetti dopo averli previsti più o meno approssimativamente. Il mondo è finito quel giorno per chi ignorava lo spesso tessuto di preparazioni, ma è finito anche per chi pazientemente preparava questo avvenimento, per chi lo ha curato. Un decadimento annoso dunque, le cui manifestazioni terminali indicano che la krisis è già trapassata nell’epoca in cui «l’umana civiltà può autoannientarsi, perdere il senso dei valori intersoggettivi della vita umana, e impiegare le stesse potenze del dominio tecnico della natura secondo una modalità che è priva di senso per eccellenza, cioè per annientare la possibilità stessa della cultura»[19].

Come armarci contro questo scacco? Una fine senza escaton, in cui alla vastità del mondo sopra e sotto di noi corrisponde la puntuale e calcolata localizzazione di una promessa di salvezza o di condanna. Il mondo non è forse mai stato così aperto.

NOTE

[1] Ovidio, Fasti e frammenti, in Opere, materiali a c. di F. Stok, UTET, Torino 1999.

[2] Catone, Commentari, in E. De Martino, La fine del mondo. Contributo all’analisi delle apocalissi culturali (1977), materiali a c. di G. Charuty, D. Fabre, M. Massenzio, Giulio Einaudi editore, Torino 2019, pp. 119-120.

[3] Ovidio, cit., p. 337.

[4] H. J. Rose, “The Mundus”, in Studi e materiali di storia delle religioni, XII, 1931, pp. 115-127, qui p. 121. Traduzione italiana parziale in E. De Martino, Morte e pianto rituale. Dal lamento funebre antico al pianto di Maria (1958), materiali a c. di M. Massenzio, Giulio Einaudi Editore, Torino 2021, p. 125.

[5] E. De Martino, Morte e pianto rituale, cit., p. 225.

[6] Ibid.

[7] Ippocrate di Coo e la sua scuola medica impiegavano il termine krisis per indicare quella fase del decorso della malattia che si impone come discrimine all’interno del percorso di guarigione del paziente. I due esiti possibili che potevano configurarsi anche contraddicendo le previsioni del medico e repentinamente consistevano nel decadimento nella morte o nella risoluzione dell’equilibrio organico nella guarigione. Più che l’alternativa del decorso ci interessa il carattere di imprevedibilità, di sorpresa, che comunque accompagna l’osservazione e la ricerca.

[8] E. De Martino, La fine del mondo, cit., p. 65. Corsivo nostro.

[9] Giorgio Agamben ne Il regno e il giardino dedica un capitolo al cosmo dantesco ricostruendone alcune interpretazioni teologiche e reinterpretandone il ruolo alla luce della sua percorribilità da parte di Dante, in forza della quale l’Eden si configurerebbe come “la figura della beatitudine terrena”, cui l’uomo può accedere. G. Agamben, Il regno e il giardino, Neri Pozza, Vicenza 2019, p. 71. Corsivo nostro.

[10] M. Eliade, Il sacro e il profano (1957), tr. it. E. Fadini, Bollati Boringhieri, Torino 2013, p. 19.

[11] Ibid.

[12] Ibid.

[13] L’Inferno dantesco nasce dall’urto di Lucifero sulla terra in seguito alla sua cacciata dal Paradiso. La terra risponde all’urto e alla forza ritirandosi. A questo movimento corrisponde l’emergere della forma conversa: il monte del Purgatorio.

[14] M. Eliade, Il sacro e il profano, cit., p. 20.

[15] “Il problema della fine del mondo” è il titolo del contributo di De Martino al convegno internazionale organizzato dal filosofo cristiano Pietro Prini nel 1964. Il convegno “Il mondo di domani” ebbe luogo a Perugia tra il maggio e il luglio 1964. Stando a Giordana Charuty al convegno parteciparono anche, tra altri, Paul Ricœur, Gabriel Marcel e Umberto Eco. Il contributo di De Martino venne inserito nel testo che seguì al convegno, dall’omonimo titolo, pubblicato da Prini a Roma nello stesso anno.

[16] Nel testo del 1977 De Martino analizza una varietà di modi di intendere, prevedere e interpretare, il tema della fine del mondo. Possiamo indicare, tra i numerosi indagati dall’autore, i casi della schizofrenia, del marxismo e della decolonizzazione. Nondimeno, si potrebbe considerare lo studio su Morte e pianto rituale come una propedeutica al testo del 1977: il lutto sancisce la fine di un mondo culturale, necessita la restaurazione di un ordine che può essere riarticolato e riassunto solo entro una dinamica collettiva che si esplica attraverso operazioni e tecniche intersoggettive.

[17] E. De Martino, “Il problema della fine del mondo”, in La fine del mondo, cit., pp. 69-76, qui p. 69.

[18] Ivi, p. 71.

[19] Ivi, p. 70.

La bomba atomica sulle città – Le colpe

Dal 6 agosto 1945, giorno dello sgancio della prima bomba atomica sulla città di Hiroshima (380.000 abitanti prima della guerra, 250.000 al momento dell’esplosione atomica), l’umanità dibatte su una questione terribile.

Il bombardamento atomico su Hiroshima e Nagasaki fu un’operazione legittima per mettere fine alla guerra? Ovvero, ci può essere una giustificazione etica nell’aver ucciso circa 200.000 persone a Hiroshima, in larga parte civili, e circa 80.000 a Nagasaki?

Gli Stati Uniti e gli Alleati hanno sempre sostenuto che quelle bombe erano l’unico mezzo per costringere il Giappone alla resa, quindi, secondo la loro ottica, in prospettiva sono servite a risparmiare la vita di decine di migliaia di soldati americani ed anche decine di migliaia di vite di militari e civili giapponesi.

Questo perché, altrimenti, l’unico mezzo per costringere alla capitolazione il Giappone sarebbe stato quello di invadere il suo territorio, così come fu necessario invadere la Germania nazista per mettere fine alla guerra in Europa.

Due cose sono certe nel racconto ufficiale americano: la prima, il Giappone non avrebbe capitolato senza un fatto eclatante che cambiasse completamente, non dico il rapporto di forze, ma proprio la concezione di quella guerra. Ed effettivamente la bomba atomica era, ed è stata, ciò che ha messo di fronte ad una situazione del tutto imprevista il Consiglio Supremo giapponese[1]. La seconda, i vertici militari americani prepararono diversi piani di invasione del Giappone e valutarono che sarebbero costati decine di migliaia di soldati morti.

Valutazione nata anche dall’esperienza della terribile battaglia di Okinawa (aprile – giugno 1945), prima invasione degli alleati sul suolo giapponese (arcipelago di isole a sud delle isole principali). Battaglia vinta ma che fu terribilmente cruenta, che costò la vita a circa 13.000 uomini tra perdite dell’esercito, marines e marinai, più un enorme dispendio di mezzi, e che fece capire agli americani come si sarebbero battuti i giapponesi dentro ai loro confini.

Quindi, se si segue il filo conduttore della narrazione USA e ragionando in un’ottica di mera contabilità di vite (essenzialmente americane), la decisione di Truman di sganciare le due bombe ebbe un senso razionale.

Ma in quella terribile estate del '45, la situazione militare e politica del conflitto nel Pacifico era realmente quella di un Giappone in ginocchio ma graniticamente deciso a non cessare i combattimenti e a versare tutto il proprio sangue e quanto più possibile del nemico, pur di non arrendersi e pur di respingere dal proprio (sacro) suolo l’invasore?

La risposta, come sempre, è complessa.

Che nel '45 il Giappone imperiale avesse ormai perso una guerra che aveva iniziato per primo, con fanatica sicurezza in sé stesso, e con l’attacco proditorio sferrato a Pearl Harbour contro la Marina Militare statunitense in assenza di una formale dichiarazione di guerra, era un dato di fatto.

A non voler guardare in faccia la realtà della situazione sul campo erano gli alti vertici militari, quegli stessi uomini che avevano giurato all’imperatore Hiroito che avrebbero spazzato gli americani dal Pacifico e avrebbero progressivamente imposto il dominio del Sol Levante su tutta l’Asia.

L’arrogante sicurezza della propria superiorità militare e, direi, anche antropologica, maturata con i successi militari espansionistici degli anni '30, annebbiò la lucidità di pensiero e la capacità di valutazione dei vertici giapponesi, che sottovalutarono – per loro tragicamente – la capacità di reazione degli Stati Uniti e la loro potenza industriale e militare.[2]

Ma che la guerra fosse persa era palese. La potentissima Marina Militare imperiale, orgoglio del Paese, distrutta dopo le disastrose battaglie navali delle Midway e Guadalcanal. L’esercito aveva subito perdite immense in uomini e materiali, ricacciato dai territori invasi nei primi anni di guerra e con molte forze allo sbando, isolate dai collegamenti con la madre patria. Anche l’aviazione era ormai quasi inesistente e, infine, l’interruzione dei rifornimenti di greggio e materie prime aggravava la situazione di un’industria bellica quasi completamente distrutta dai bombardamenti.

Inoltre, dal '44, tutte le principali città giapponesi e Tokyo in particolare furono bombardate sistematicamente e a più riprese dall’aviazione statunitense; il bombardamento più massiccio venne eseguito nel marzo del '45. Uno stormo di più di 300 bombardieri USA, armati di bombe incendiarie, scatenò un vero inferno di fuoco sulla capitale giapponese provocando circa 180.000 morti (pochi meno che a Hiroshima, molti più che a Nagasaki).[3]

La verità è che il Giappone era piegato e vinto e non tutti i vertici del Paese erano fanaticamente decisi a portare avanti la guerra fino al sacrificio totale.

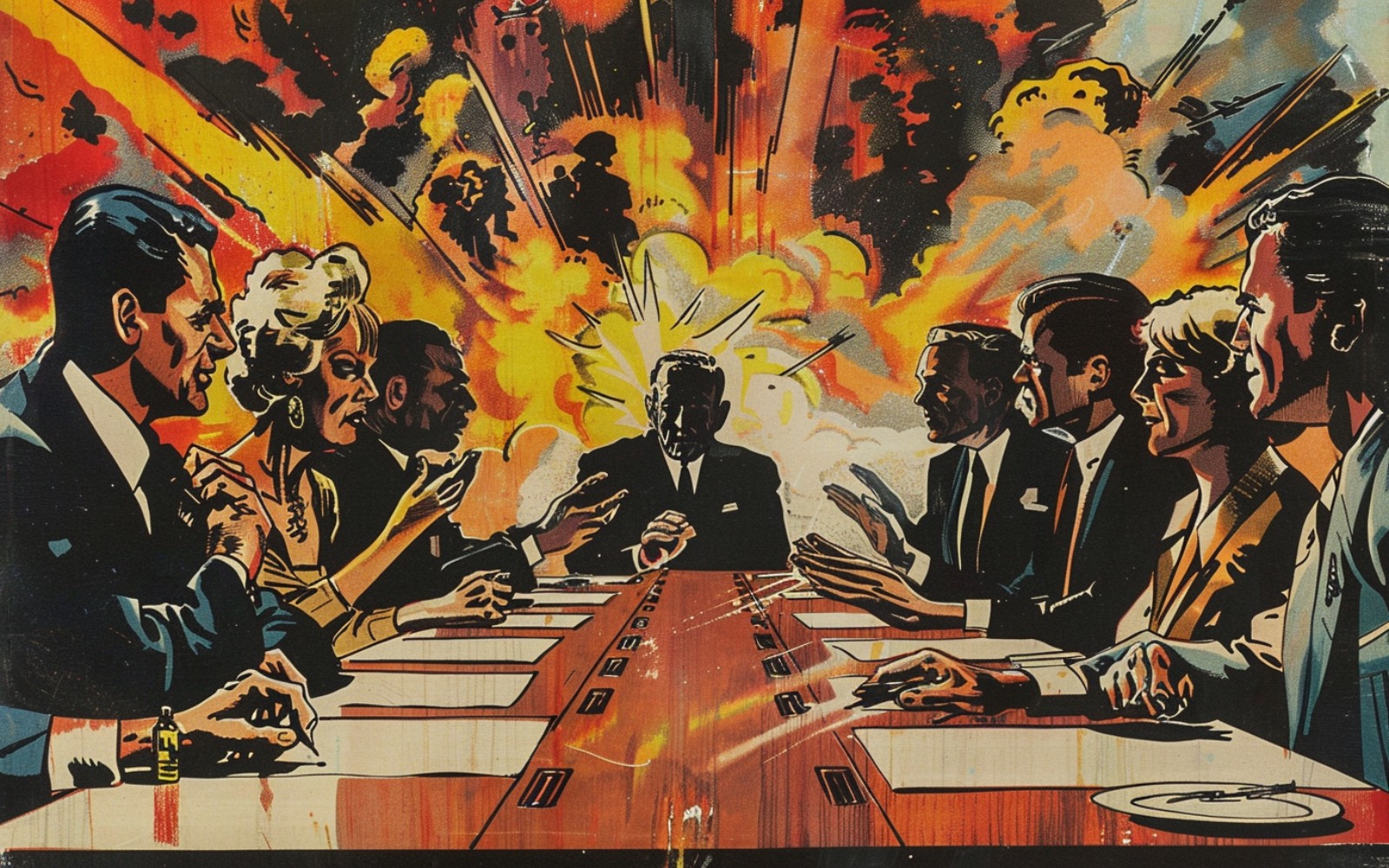

In seno al Consiglio di Guerra lo scontro era molto aperto tra l’ala oltranzista e coloro che invece avevano compreso che una prosecuzione del conflitto avrebbe avuto l’unico risultato di trasformare il Giappone in un cumulo di macerie e milioni di morti.

Già nel luglio del '44, all’indomani della sconfitta alle Marianne, in Giappone cominciò a crearsi un movimento favorevole ad una resa negoziata; resa che all’epoca sarebbe stata ancora possibile. L’intransigenza dell’ala militarista rese impossibile un negoziato ufficiale, ma fu lo stesso imperatore Hiroito che ruppe gli indugi e, uscendo dal suo ruolo di lontananza quasi divina dalle contingenze concrete, cercò attraverso l’ex primo ministro Konoye, da sempre contrario alla guerra, di allacciare contatti diplomatici con gli Stati Uniti, con la mediazione sovietica e svizzera, per trovare una soluzione.

L’imperatore, dimostrandosi ben più saggio dei suoi vertici militari, uscì definitivamente dall’ombra e nell’aprile del '45 riuscì a far nominare primo ministro Kantaro Suzuki, uomo da sempre a lui vicino e da sempre contrario alla guerra. Il tentativo di allacciare rapporti diplomatici con gli Stati Uniti per una resa onorevole aumentarono, ma sempre in modo non ufficiale poiché la posizione del Consiglio di Guerra restava intransigentemente sulla continuazione del conflitto.

I sovietici in realtà non fecero assolutamente niente per favorire un contatto, facendo perdere ulteriore tempo all’ala pacifista del governo giapponese; in ogni caso lo stallo decisionale non si sbloccò.

Quando i vertici degli Alleati che avevano sconfitto il nazifascismo in Europa si riunirono a Postdam, nei pressi di Berlino, diramarono le condizioni di resa ufficiali per il Giappone. Condizioni che subito l’ala pacifista giapponese considerò come accettabili (non veniva stravolto l’assetto istituzionale del Paese). Ma ancora una volta il conflitto interno nel Consiglio provocò una reazione enigmatica.

Il comunicato di risposta diramato dal governo, in giapponese, affidava alla parola “mokosatsu” - particolarmente intraducibile nelle lingue occidentali - la rappresentazione della volontà giapponese. Concetto, mokosatsu, assolutamente ambiguo, che poteva voler dire anche “astensione da una decisione”. Negli Stati Uniti però non si provò a cercare una risposta più intellegibile e si determinò che quella parola andava interpretata come un respingimento delle condizioni di resa offerte dagli Alleati…

Dopo il successo dell’esperimento atomico a Almogordo, Truman ruppe gli indugi e di fronte alla prospettiva di dover combattere ancora a lungo per sconfiggere il Giappone, decise per l’utilizzo della bomba atomica.

C’è da dire ancora una cosa; pare che un gruppo degli scienziati che avevano lavorato allo sviluppo del Progetto Manhattan, loro stessi spaventati dalla potenza distruttiva della bomba, avessero chiesto al Presidente di poter organizzare una dimostrazione internazionale sulle conseguenze di una esplosione atomica. Truman non prese neppure in considerazione la questione.

Questa è la genesi storica degli avvenimenti che portarono alla decisone di sganciare le bombe atomiche sul Giappone.

Si intrecciano ragionamenti razionali su come preservare vite umane, fanatismo, desiderio di vendetta, equivoci, volontà di potenza e altri sentimenti molto umani, più nel male che nel bene. Restano due domande che credo non avranno mai risposte univoche.

È stata una decisione legittima? E chi, più di altri, ha le mani sporche di sangue?

NOTE

[1] Il Consiglio Supremo di guerra era un organo composto da: Primo ministro, Ministro degli esteri, Ministro dell’esercito, Ministro della marina, Capo di stato maggiore dell’esercito, Capo di stato maggiore della marina. A questo organo spettavano le decisioni sulla guerra, alle riunioni del Consiglio poteva partecipare l’imperatore.

[2] Interessante notare che il grande ammiraglio giapponese Yamamoto, ideatore (suo malgrado) dell’attacco a Pearl Harbour era stato uno dei pochissimi militari di altissimo livello contrario alla guerra con gli Stati Uniti. Li conosceva molto bene avendo fatto per anni l’addetto militare in America.

[3] Il generale Le May, responsabile militare (ma gli ordini erano politici) dei bombardamenti su Tokyo alla fine del conflitto disse “immagino che se gli Stati Uniti fossero stati sconfitti, io sarei stato processato come criminale di guerra”.

Ciò che nasce con buone intenzioni muore di cattive

Il processo di fissione nucleare fu definito con esattezza nel 1939. Probabilmente la vigilia della seconda guerra mondiale non offrì il contesto psicologico e sociale migliore per condurre quella scoperta rivoluzionaria su una strada pacifica, ma questa non deve essere una scusa.

La scelta di progettare la bomba atomica è stata appunto una scelta.

Nessun topo costruirebbe una trappola per topi. Gli esseri umani hanno da sempre concentrato i loro uomini migliori e i loro sforzi più importanti nell'inventare, costruire e far funzionare trappole per altri esseri umani.

Perché?

Ogni specie naturale vive un equilibrio che sarebbe immutabile se non per eventi naturali estremi e comunque esterni alla specie. Una parte in causa dell'equilibrio che lo rompe e lo ripristina, uguale o diverso.

L'uomo ignora qualsiasi forma di equilibrio esterno alla propria specie e rompe qualsiasi equilibrio sociale costruito dalla sua specie dopo un certo tempo.

Perché?

Le altre specie cosiddette dominanti hanno perso il proprio privilegio per cause esterne. Dalla notte dei tempi fino alla comparsa dell'uomo. Noi corrompiamo qualsiasi sistema naturale e sociale forse per darci un futuro. Ci vogliamo mettere in cima a qualsiasi piramide naturale o sociale perché è il posto più sicuro che possiamo immaginare.

Da lì sentiamo il controllo e vediamo il futuro. Finché le buone intenzioni dell'inizio ci suggeriscono qualcosa di diverso. Improvvisamente sentiamo che quella sicurezza non è abbastanza. Qualcosa ci supera, o soltanto ci sembra. E scatta inesorabile l'ennesima trappola per esseri umani costruita da esseri umani.

Il fenomeno che abbiamo innescato a quel punto ci supera. Diventa troppo grande per essere in possesso del singolo e ogni singolo inizia a sentirlo necessario nonostante estraneo a sé. Quindi estraneo a tutti e necessario per ciascuno. L'esigenza specifica e contingente oscura le conseguenze possibili di cui eravamo consapevoli fin dall'inizio. Ma è ormai un moto irrefrenabile, al punto in cui lo mettiamo in discussione già non ci rendiamo più conto o non siamo più in grado di connotare le forze che avevamo evocato e lo stanno conducendo.

Quando la trappola è pronta l'unica opzione è usarla. Ci mettiamo davanti alla valanga e pronunciamo la fatidica frase: Cosa Abbiamo Fatto Stavolta.

Stavolta finora ha sempre avuto un'altra volta. Viviamo un paradosso che ha bisogno di rinnovarsi costantemente per restare valido, e perpetriamo questo paradosso di cui sembra non possiamo più fare a meno. Lo rinnoviamo ogni volta come fosse l'unico futuro che siamo in grado di immaginare.

Achille cercava le battaglie per la gloria che lo attendeva inesorabile. Morì per una flebile lancia.

Ora sono diventato Morte, il distruttore di mondi – L’inevitabile dimensione politica della scienza

PRECISAZIONI

Precisazione numero uno: la famosa frase “Now I am become death, the destroyer of worlds” non è stata coniata da Oppenheimer ma è presa dal testo Hindu Bhagavad-Gita, in un passo in cui Arjuna prega Krishna, incarnazione della divinità Vishnu, di rivelare la sua forma divina, “armata di molte armi”; quando Krishna-Vishnu si mostra a Arjuna, attribuisce a se stesso il modo d’essere di Kalah, divinità della morte[1].

Precisazione numero due: Robert Oppenheimer dichiarò – in una intervista del 1965 - di aver pensato a quel passo del Bhagavad-Gita il 16 luglio 1945, nel momento in cui vide la luce abbagliante e il fungo della prima esplosione atomica di test levarsi in cielo. Nel testo Hindu Arjuna paragona lo sfolgorio di Vishnu a “migliaia e migliaia di soli [che] sorgessero insieme nel cielo”.

Precisazione numero tre: quando Oppenheimer si attribuisce questo pensiero - nel 1965 - la parabola delle sue considerazioni morali sulla bomba – sulle bombe, compresa quella a idrogeno – ha compiuto il suo ampio arco e si è fermata in una posizione decisamente anti-militarista e contraria alla corsa agli armamenti nucleari.

CHI ERA ROBERT OPPENHEIMER? PERCHÉ NE PARLIAMO OGGI?

Julius Robert Oppenheimer nasce a New York nel 1904 e, dal 1922 (a 18 anni!) studia fisica a Harvard con P. W. Bridgman; a Cambridge, con E. Rutherford e J. Thomson; a Gottingen, con Max Born, suo supervisore di dottorato, dove conobbe e studiò con Heisenberg, Jordan, Dirac, Fermi e Teller; a Leiden con P. Ehrenfest; a Zurigo, con W. Pauli. Dal 1929 fu di nuovo negli Stati Uniti, alla Berkeley e al Caltech.

La sua attività scientifica fino al 1942 è proteiforme e lascia segni importanti sia sul versante teorico che su quello sperimentale della teoria quantistica e di alcuni aspetti dell’astrofisica. Pare che abbia la capacità di vedere i nessi tra lavoro sperimentale e lavoro teorico[2] e generare nuove idee per sviluppare teoria e applicazioni.

Nel 1942 – nonostante il suo vissuto politico di iscritto al Partito Comunista – il governo statunitense gli affida la direzione del Progetto Manhattan, con l’obiettivo dichiarato di realizzare la prima bomba a fissione nucleare.

Il progetto – guidato da Oppenheimer e che vedeva coinvolti i più importanti fisici di quei tempi - portò alla costruzione del primo ordigno di test – il gadget – fatto esplodere il 16 luglio 1945 nel deserto del New Mexico.

Poco meno di 15 giorni dopo, due bombe vere realizzate dal Progetto Manhattan e chiamate Little Boy e Fat Man distrussero le città giapponesi di Hiroshima e Nagasaki, uccidendo istantaneamente più di 200.000 persone e ferendone gravemente altrettante, con effetti sulla salute di moltissimi altri, che ancora vengono curati dalla sanità giapponese.

Questi tre eventi segnarono il termine della Seconda guerra mondiale e l’inizio dell’escalation degli armamenti nucleari in molte nazioni, armamenti che ancora oggi vengono irresponsabilmente sventolati come minaccia distruttiva e con atteggiamento di sfida in alcuni conflitti locali.

Parliamo di Robert Oppenheimer perché è l’uomo che ha organizzato e, con caparbia e genio, gestito il Progetto Manhattan.

Ne parliamo proprio ora perché nacque centoventi anni fa, il 22 aprile, e perché il film di Christopher Nolan, che ne racconta alcuni tratti della vita, dal dottorato a Cambridge nel 1926 al Premio Enrico Fermi nel 1963, ha appena vinto 7 Oscar, 5 Golden Globe e 7 premi Bafta. Proprio il film – molto ben documentato - di Nolan ci serve come punto di appoggio per raccontare Oppenheimer.

Ne parliamo anche perché Oppenheimer è un personaggio emblematico:

- è di confine tra l’immagine ideale della scienza neutrale e la realtà spesso disconosciuta della sua dimensione politica,

- è in bilico, altalenante, tra morale procedurale e morale sostanziale.

L’INEVITABILE POLITICITÀ DELLA FISICA

Nel 1942, Oppenheimer aderisce – stupito dal fatto di essere stato scelto dal governo a dispetto dei suoi modi spesso fuori dalle regole e del suo impegno politico di orientamento comunista – con determinazione e passione al Progetto Manhattan e realizza, guidando militari, civili e scienziati, la più imponente struttura teorica, sperimentale e applicativa che la fisica abbia mai visto: 130.000 persone coinvolte, 2 miliardi di dollari investiti, 3 anni di lavoro e una new town dedicata in cui scienziati, civili e militari convivono e lavorano confinati.

La sua motivazione sembra avere tre teste, come il cane Cerbero della teogonia di Esiodo.

La prima testa è la convinzione che la scienza sia un vettore di progresso, che abbia un carattere incrementale di continuo avanzamento verso la conoscenza più ampia e completa; il Progetto di realizzazione della Bomba, per Oppenheimer, rappresenta l’irripetibile opportunità di sviluppare conoscenza teorica e sperimentale con il più eccezionale gruppo di scienziati viventi e con risorse quasi illimitate.

La seconda testa è la visione del potenziale generativo di bene collettivo che Oppenheimer attribuisce alla scienza, in particolare alla fisica; ancora una volta, il Progetto Manhattan può, nella visione di Oppenheimer, permettere lo sviluppo di tecnologie e opportunità di grande importanza per l’umanità; nel corso delle lezioni Reith alla BBC, nel 1953, Oppenheimer dice:

«

il progresso della scienza non si arresterà finché ci saranno uomini. Sappiamo che il nostro lavoro è tanto un mezzo quanto un fine. Una grande scoperta appartiene al mondo della bellezza; e la nostra fede — la nostra quieta e insopprimibile fede - è che la conoscenza sia un bene in sé e per sé. Ma è anche uno strumento; è uno strumento per i nostri successori, che la useranno per indagare qualcos'altro e più profondamente; è uno strumento per la tecnologia, per le attività pratiche, e per il destino dell'uomo (Oppenheimer R., Scienza e pensiero comune, 2023, p. 91).

»

La terza testa della motivazione-Cerbero di Oppenheimer è l’apparente necessità di arrivare a fare la bomba prima dei nazisti, prima di Hitler; necessità amplificata dalle congetture strumentali, e poco documentate, sullo stato dell’arte dei fisici del Reich, ed evidenziata nel film di Nolan:

«Oppenheimer (a E. Lawrence)

Lo so bene qual è il fottuto progetto, Lawrence! Sappiamo tutti della lettera di Einstein e Szilard a Roosevelt. Lo avvertono che i tedeschi potrebbero fare la bomba. E io lo so cosa significa per i tedeschi avere la bomba» (Nolan C., Gadget – sceneggiatura finale di Oppenheimer, p. 42).

«Oppenheimer (al colonnello Groves)

State parlando di trasformare la teoria in una vera e propria arma più rapidamente dei Nazisti» (Cit. p. 51).

In queste tre posizioni contestuali si mostra il carattere di confine di Oppenheimer.

All’inizio del progetto – coglie il carattere inevitabilmente politico della scienza: è uno strumento di progresso che non si pone in modo neutrale e serve obiettivi etici[3] e politici, con un innegabile valore morale, sconfiggere il male, rappresentato da Adolf Hitler e dai nazisti.

Nel corso del progetto, di fronte alle obiezioni morali di scienziati e amici che intravedono il pericolo rappresentato dall’enorme potere distruttivo della Bomba e dubitano della moralità del loro ruolo nella realizzazione, la risposta di Oppenheimer è di confine: da un lato fa leva sul valore morale della sconfitta di Hitler; dall’altro, si affida all’ideale di neutralità della scienza, dei cui potenziali effetti negativi lo scienziato non si deve occupare; l’uso corretto e moralmente accettabile dei risultati della ricerca e applicazione scientifica è un problema della politica, non della comunità scientifica: «come dovrebbe fare Truman a rassicurare il popolo americano? » gli chiede L. Strauss e Oppenheimer risponde: «Limitando la diffusione delle armi atomiche attraverso il controllo internazionale dell’energia nucleare» (Cit. p. 107-108).

Al momento dell’esplosione – narra lui stesso – ha l’intuizione di stampo Hindu del suo carattere di distruttore di mondi.

Infine, al termine della guerra – la cui fine è attribuita alla bomba realizzata da Oppenheimer e dai suoi colleghi di Los Alamos, alla distruzione “dimostrativa” delle due città giapponesi e alle più di 400.000 vittime tra morti e feriti – viene travolto dalla responsabilità del massacro che ha contribuito a compiere.

IL PERICOLO DELLA MORALE PROCEDURALE

Un’etica formale, o procedurale, «giudica la moralità di un’azione non prendendo in considerazione scopi o conseguenze, ma solo la conformità dell’azione alla legge», a obiettivi predefiniti, per esempio, da una disciplina professionale o da un programma politico.

Differentemente, l’etica sostanziale identifica i principi morali

«

prendendo in considerazione scopi o conseguenze, […] in cui la legge morale non può essere separata dal particolare (le inclinazioni, gli scopi, le situazioni pratiche) perché è solo dalla loro sintesi che nascono i concreti doveri e le reali azioni morali (Heller A., Per un’antropologia della modernità, 2009, pp. 54-71).

»

Arrivare ad avere la bomba prima dei nazisti è una azione e un dovere morale perché incarna il principio sostanziale di evitare di mettere in mano ad un capo di stato ritenuto folle e capace di tutto, qual è Hitler, un’arma che può distruggere intere nazioni.

È questo principio morale che Oppenheimer usa come traduzione per reclutare gli scienziati nel Progetto Manhattan.

Al contrario, usare il Progetto e costruire la bomba per fare progressi nell’esplorazione della fisica subatomica e per testare nella pratica teoria e matematica della fisica quantistica è senza ombra di dubbio affidarsi a un’etica procedurale: è rispondere ad una legge, quella del progresso scientifico, senza prendere in considerazione le conseguenze; è separare la morale dal particolare, è evitare di confrontarsi con la realtà morale, di farsi domande.

Il film di Nolan – raccogliendo i temi della bio “American Prometeus” di K. Bird e M. J. Sherwin (2005) - propone due momenti emblematici che sottolineano come il Progetto fosse pervaso e fondato su un’etica procedurale, cieca alle conseguenze: il primo è la conversazione tra Hans Bethe e Oppenheimer sul rischio che l’esplosione nucleare, mai fatta prima, possa diventare incontrollata e mettere a fuoco tutta l’atmosfera terrestre,

«Bethe: Le probabilità di una reazione nucleare incontrollata sono vicine allo zero;

- O.: Vicine allo zero?

- Bethe: Oppie, questa è una buona notizia;

- Oppie: Puoi rifare ancora i calcoli?

- Bethe: Avrai la stessa risposta. Finché non facciamo davvero detonare una di queste cose, la migliore rassicurazione che puoi avere è questa: (sbatte le carte) vicine allo zero».

La probabilità di distruggere l’atmosfera terrestre e cancellare la vita dal pianeta in pochi istanti è quasi nulla, e questo quasi nulla è sufficiente per archiviare l’eventualità e procedere con il Progetto della bomba.

Questo è il rischio di affidarsi ad un corpus disciplinare e di adottare un’etica procedurale. Si perde di vista il senso morale, si evitano le considerazioni sulle conseguenze, rassicurati dai dettami della disciplina, riportati nella comodità della deresponsabilizzazione dello scienziato.

Il secondo momento emblematico è la riunione dopo l’annuncio del lancio della bomba in Giappone: tutti – scienziati, tecnici, militari e civili di Los Alamos – vengono presi da un orgasmo di gioia, di delirio e di orgoglio patriottico; è la vittoria nella guerra, è – soprattutto – il successo del Progetto messo in pratica. L’etica procedurale della scienza neutrale annulla le conseguenze dell’azione e fa scordare la dimensione politica della stessa scienza.

Oppenheimer, di fronte alle persone del Progetto Manhattan:

«Alzo le mani in un gesto teatrale e vittorioso – la folla acclama…

“Il mondo ricorderà questo giorno […]

sono orgoglioso di quello che avete realizzato […]

sono sicuro che ai giapponesi non è piaciuto”» (Cit. pp.139-140).

CONCLUSIONE

Spesso gli scienziati credono ciecamente nel mito del progresso scientifico e nella neutralità della scienza, e si rifugiano nella propria zona di tranquillità, abdicando al ruolo di soggetti morali e lasciando nelle mani della politica o del business tutte le responsabilità dell’uso delle tecnoscienze che creano.

Sono convinto che dimenticare il ruolo nativamente politico, morale e sociale delle tecnoscienze e dei loro creatori sia un comportamento moralmente grave e socialmente pericoloso, che mette fuori gioco la comunità scientifica, asservendola al potere.

Dalla scenografia di Oppenheimer (Cit., p. 143 – 145)

ANTICAMERA DELLA STANZA OVALE, ALLA CASA BIANCA – DI GIORNO

Sollievo, gentile formalità, guardo sul tavolino:

Time magazine con me in copertina: "PADRE DELLA BOMBA ATOMICA”.

ASSISTENTE

Il Presidente Truman la riceve ora.

INTERNO, STANZA OVALE

Truman si alza dalla scrivania per stringermi la mano -

TRUMAN

Dr Oppenheimer, è un onore.

OPPENHEIMER

Signor Presidente. Segretario Byrnes.

TRUMAN

Come ci si sente ad essere l’uomo più famoso del mondo?

TRUMAN (CONT’D)

Lei ha aiutato a salvare molte vite americane. […]

La sua invenzione ci ha permesso di riportare i ragazzi a casa.

La nazione è in debito con voi.

Mi torco le mani una con l’altra, profondamente a disagio...

OPPENHEIMER

Signor Presidente, sento di avere le mani sporche di sangue.

Truman mi guarda in modo diverso. Si toglie il fazzoletto bianco dal taschino sul petto della giacca e me lo offre -

TRUMAN

Lei pensa che a qualcuno a Hiroshima o a

Nagasaki gliene freghi qualcosa di chi ha costruito la bomba?

Loro badano a chi l’ha sganciata.

Io l’ho fatto.

Hiroshima non ha a che fare con Lei.

NOTE

[1] Il nome della divinità Hindu, Kalah, in sanscrito significa tempo. Argomento delicato.

[2] In quest’ordine: alcuni aspetti del suo lavoro suggeriscono l’importanza delle divergenze sperimentali per generare nuove determinazioni e variazioni delle teorie. Questo tema è sviluppato da M. Hagner e H.J. Rheinberger in Experimental Systems, Objects of Investigation and Spaces of Representation, In Experimental Essays, edited by Heidelberger M. and Steinle F., 355–73. Baden-Baden: Nomos, 1998.

[3] Attenzione, dico “etici” e non morali, la morale è già definita, qui si tratta di perseguirne degli obiettivi.

L’era post-atomica - Achille Mbembe e l’ultima utopia dell’umanità

Necropolitica

Qual è la relazione fra vita, morte e potere in quei sistemi politici che funzionano solo in uno stato di emergenza? Questa è una delle domande fondamentali a cui Achille Mbembe, filosofo originario del Camerun, cerca di rispondere all’interno di Necropolitics, un saggio breve ma molto denso pubblicato nel 2013. In esso, Mbembe afferma che «la massima espressione della sovranità risiede, in larga misura, nel potere e nella capacità di dettare chi può vivere e chi deve morire» (Necropolitics, 2019, p. 11).[1] Da ciò segue che «esercitare la sovranità significa esercitare il controllo sulla mortalità e definire la vita come dispiegamento e manifestazione del potere» (Cit. p. 12).[2]

È chiaro, fin dalle prime righe, il rimando al concetto di biopolitica, sviluppato da Michel Foucault nel corso degli anni ’70 per comprendere i problemi legati a fenomeni propri dei viventi costituiti in popolazione, come quelli riguardanti la salute, l’igiene, la natalità etc… e al modo in cui sono stati gestiti dalla «pratica governamentale» (Naissance de la biopolitique, 1979, p. 333). Secondo Mbembe, tuttavia, la sovranità esercita una forma di potere che va oltre la decisione circa la gestione della vita della popolazione in questione, provocando intenzionalmente la morte di quest’ultima o di parte di essa. Distinguendo tra vita «utile» e vita «superflua», il principio della razza è ciò che permette di tracciare una cesura nel continuum biologico dell’umanità e consente alla sovranità - specialmente in ambito coloniale - di giustificare ed esercitare la sua funzione di morte. Nel mondo contemporaneo, la nozione di necropolitica è necessaria per rendere conto dei modi in cui

«le armi vengono impiegate nell’interesse della massima distruzione delle persone e della creazione di mondi di morte, nuove e uniche forme di esistenza sociale in cui vaste popolazioni sono sottoposte a condizioni di vita che conferiscono loro lo status di morti viventi» (A. Mbembe, Necropolitics, p. 40).[3]

Tecnologia nucleare

Sebbene né Mbembe né Foucault parlino esplicitamente delle armi nucleari o dell’era atomica, l’intreccio dei concetti di biopolitica e necropolitica può essere un’utile chiave di lettura del fenomeno, soprattutto per quanto riguarda il nostro presente. Infatti, anche se non viviamo più in un’epoca in cui la bomba atomica occupa un posto centrale nella vita delle persone, così come è stato subito dopo Hiroshima e Nagasaki, e soprattutto durante la Guerra fredda, essa rimane una presenza inquietante sullo sfondo della politica internazionale: lo abbiamo visto con i recenti sviluppi della guerra in Ucraina. Alla luce di quanto detto prima, le armi nucleari possono essere interpretate come una parte fondamentale dell’esercizio della sovranità, basato sull’intreccio tra biopotere e necropotere. Servendosi delle armi nucleari, infatti, la sovranità politica, che sia quella di uno Stato o di un blocco di Stati, può legittimarsi e riaffermarsi di fronte ad eventuali nemici, in quanto unica detentrice non solo di uno strumento di controllo e regolazione della vita, ma anche e soprattutto di un veicolo di morte.

Ciò risulta evidente anche nel Trattato di non proliferazione nucleare, entrato in vigore nel 1970 e a cui oggi aderiscono più di 190 Paesi. Esso si fonda su tre pilastri: impegnare al disarmo i cinque Stati che detenevano ufficialmente armi nucleari (Cina, Francia, Regno Unito, Russia, USA), offrire una base giuridica alla non proliferazione delle armi nucleari e consentire l’uso pacifico dell’energia nucleare. Di fatto, tuttavia, al Trattato non si sono ancora adeguate quelle stesse nazioni che l’avevano proposto e che avrebbero dovuto puntare al disarmo, dato che gli altri Stati accettarono di non dotarsi di armi nucleari solo perché quelli che le possedevano si impegnarono ad eliminarle nel giro di pochi anni[4]. La tecnologia nucleare, dunque, rimane tutt’oggi essenziale nella definizione del potere politico sovrano, sia a livello nazionale che internazionale.

Brutalismo

Allargando l’orizzonte della riflessione, secondo Mbembe stiamo assistendo a un’escalation tecnologica mai vista prima, la cui scintilla di inizio potrebbe essere a nostro parere identificata con la creazione e l’utilizzo della bomba atomica. Lo sviluppo sempre più rapido delle tecnologie sta rivoluzionando il nostro rapporto con il mondo, rendendo sempre più difficile separarle dalle nostre vite. A questo proposito, il filosofo parla in La communauté terrestre (2023) di una «seconda creazione», che passa attraverso il dispiegamento di un'umanità ibrida dotata di un doppio: l'umano e il suo oggetto.

La tecnologia, oggi, si fa teologia ed escatologia, portando l’uomo a credere in un possibile futuro in cui potrà finalmente separarsi dalla natura, addomesticare la vita e passare ad un altro stadio dell’evoluzione biologica. Mbembe parla di «brutalismo» per mostrare come questa transizione verso un'umanità ibrida corrisponda a forme di politica la cui funzione è quella di distruggere e separare, formando non l'impossibilità del luogo, ma la costruzione di un non-luogo, in cui circoscrivere certe porzioni di umanità. Con questo termine, l’autore fa riferimento a un’epoca in cui la tecnologia non è più solo uno strumento, essa è la forma che ha preso la metafisica, prima nella storia occidentale e dopo nella storia globale. Nell’epoca del brutalismo, ci si avvale di tre tipi di ragione, cioè quella economico-strumentale, quella elettronico-digitale e quella neurobiologica. Tutte si basano sulla convinzione che c’è sempre meno differenza tra l’uomo e la macchina, che anzi quest’ultima dovrebbe prendere sempre più decisioni al posto nostro. Dunque, secondo Mbembe, non sono più solo gli schiavi o i nativi delle colonie ad essere considerati oggetti, ma con lo sviluppo delle intelligenze artificiali e dell’ingegneria genetica il confine stesso tra uomo e oggetto è destinato a sfumare.

Utopia

Contro questa visione del futuro dell’umanità come definitivamente separata dal resto degli esseri viventi sulla Terra, Mbembe propone una politica di «liberazione del vivente» che si dispieghi a partire da una comunità terrestre, che sia composta da una molteplicità di archivi e che abbracci tutti gli esseri viventi. In essa, inoltre, «è il diritto dei viventi e non più il diritto dei popoli che determina i gradi e le condizioni di appartenenza» (Brutalisme, 2023, p. 173)[5]. È evidente, tuttavia, che la Terra come unità politica globale non esiste ancora. Ecco perché Mbembe afferma che «su un piano politico, il nome Terra è un’utopia, forse l’ultima utopia» (La communauté terrestre, p. 72)[6]. Il suo non esserci ancora non ne diminuisce l’importanza, anzi. Secondo Mbembe, infatti, l’essere umano è posto davanti a un’ultima scelta: «o la riparazione, o i funerali» (Cit. p. 72)[7]. La Terra sarà il luogo a partire dal quale l’umanità intraprenderà l’opera di rigenerazione del vivente, oppure «essa ne sarà la tomba universale, il suo mausoleo» (Cit.) [8]. Il concetto di utopia, pertanto, ricopre un ruolo centrale nella riflessione di Mbembe, il quale trae ispirazione dalle opere di Ernst Bloch, un filosofo che, come afferma Fergnani, ha fatto dell’utopia «il nucleo centrale cui si riconducono tutti i momenti ed aspetti essenziali del suo pensiero» (Utopia e dialettica nel pensiero di Ernst Bloch, p.191). Nel paragrafo 7 di Brutalisme, Mbembe cita espressamente Spirito dell’utopia (1918) e Il principio Speranza (1959), i due pilastri fondamentali del lavoro di Bloch, i quali costituiscono una lunga esortazione all’umanità e permettono a Mbembe di approfondire e strutturare la sua idea della Terra come ultima utopia.

Secondo Bloch, infatti, la speranza è uno dei motori più potenti della storia ed esige non un ottimismo ingenuo o una fede cieca nel progresso, né un pessimismo assoluto, incondizionato e paralizzante, ma un ottimismo critico e militante. Gli esseri umani, nati per la gioia, riescono a lanciarsi verso il divenire solo attraverso la speranza, fondando quest’ultima su un’utopia concreta[9], ovvero agendo a partire da condizioni storico-concrete che si radicano nella situazione sociale presente. Occorre analizzare il divenire storico e cercare nell’attualità quelle «eccedenze utopiche» che possono essere utilizzate per concepire nuove possibilità per il futuro; altrimenti sperare «sarebbe soltanto un atto arbitrario della volontà e, in fondo, l’effetto compensativo di una disperazione che è più profonda e ben altrimenti radicata nei fatti» (Falappa, L’umanità come utopia, p. 60).

In conclusione, contro una visione nichilistica della realtà, contro un potere politico che fonda il suo potere sulla paura, contro un’articolazione ingiusta e ineguale delle relazioni internazionali, oggi Achille Mbembe, lettore di Bloch, ci ricorda che «l’importante è imparare a sperare» (Bloch, Principio speranza, p. 5).

NOTE

[1] Il testo originale è: «the ultimate expression of sovereignty resides, to a large degree, in the power and the capacity to dictate who may live and who must die», traduzione della Redazione.

[2] Il testo originale è: «to exercise sovereignty is to exercise control over mortality and to define life as the deployment and manifestation of power», traduzione della Redazione.

[3] Il testo originale è: «weapons are deployed in the interest of maximum destruction of persons and the creation of death-worlds, new and unique forms of social existence in which vast populations are subjected to conditions of life conferring upon them the status of living dead», traduzione della Redazione.

[4] M. Elena, Il nucleare tra pace e guerra, Atti Acc. Rov. Agiati, a. 263, 2013, ser. IX, vol. III, B: 45-70.

[5] Testo originale: «c’est le droit des vivants et non plus le droit des gens qui determine désormais les degrés et les conditions d’appartenance», traduzione della Redazione.

[6] Testo originale: «sur un plan politique, le nom Terre est une utopie, la dernière utopie peut-être», traduzione della Redazione.

[7] Testo originale: «ou la réparation, ou les funérailles», traduzione della Redazione.

[8] Testo originale: «elle en sera le tombeau universel, son mausolée», traduzione della Redazione.

[9] «L'utopia concreta respinge sia un “superficiale” (oberflächlich) empirismo che aderisce ai dati reificati e che al più si attende la sintesi dal loro progressivo accumulo, sia l'”esuberanza” del sognatore, che pretende di andar oltre sorvolando», (F. Fergnani, Utopia e dialettica nel pensiero di Ernst Bloch, p. 194).

Odorata Ginestra, contenta dei deserti - L’isola di Ghiaccio-Nove