Cibo di alta qualità, crescita economica, salvare il pianeta o salvare gli animali? - 4 istanze morali in tensione

09/07/2024Animali,Ambiente e Ecologie,Politica

Due settimane fa, parlando della FAO e della controversia sulle misure più efficaci per contenere le emissioni di gas serra, abbiamo evidenziato un possibile conflitto tra l’obiettivo di diminuire significativamente la CO2 immessa nell’atmosfera e la missione della FAO stessa di garantire a tutti abbastanza cibo di alta qualità.

Nell’accezione della FAO, infatti, il cibo di alta qualità è principalmente rappresentato dalle proteine di origine animale e, quindi, ridurre le emissioni di CO2 che vengono dagli allevamenti intensivi significa mettere in crisi il meccanismo di approvvigionamento di una parte importante del cibo di alta qualità.

Questa tensione tra i due obiettivi mostra come, spesso, i problemi di carattere scientifico (il modo in cui ridurre la produzione di CO2 è indubbiamente un problema scientifico) celino una dimensione politica e, quindi, di scelte morali [1].

In questo caso, esaminando con maggiore attenzione i termini della controversia, emerge che ci sono almeno quattro obiettivi di carattere politico e morale in tensione reciproca:

- La riduzione della CO2 anche attraverso il drastico ridimensionamento dell’industria della carne [2], che fa capo all’istanza morale di “salvare il pianeta”,

- La garanzia che tutti abbiano sufficiente cibo di alta qualità, che fa capo all’istanza morale di “salvare le persone umane” dalla fame e dagli effetti negativi che derivano da una alimentazione insufficiente o troppo povera,

- La salvaguardia dell’economia e dell’occupazione delle sfere sociali in cui operano i produttori di carne, la cui istanza morale può essere riassunta in “garantire lavoro e sussistenza”,

- L’attenzione alla vita e al benessere degli animali non umani, importante per una sempre più diffusa sensibilità la cui istanza morale di riferimento è “non uccidere e non far soffrire tutti gli animali”.

In modo molto schematico e semplificato, la tensione reciproca tra le 4 istanze morali è abbastanza evidente considerando gli effetti della riduzione degli allevamenti:

- ridurre significativamente gli allevamenti (e la CO2 che producono) può generare crisi economica e disoccupazione, almeno nel breve periodo e, contestualmente, ridurre la disponibilità di cibo di alta qualità per chi ne ha bisogno

- mantenere in continuità gli allevamenti con la conseguente stabilità economica e occupazionale, può – invece – impedire il raggiungimento degli obiettivi di contenimento della CO2 e (senza può) provoca morte e sofferenza a milioni di animali non umani (bovini, ovini e suini)

A queste 4 istanze morali va aggiunta quella del rispetto e della continuità delle tradizioni, tra cui quelle alimentari, che includono – spesso – il consumo di carne, abitudinario o addirittura con sfumature rituali (ad esempio, il Sunday Roast in Gran Bretagna, il capitone a Natale e l’agnello a Pasqua in Italia, il tacchino per il Thanksgiving negli US ecc.), che complica ulteriormente il quadro.

Questa contrapposizione di obiettivi mostra chiaramente come, dietro una questione scientifica (il maggiore o minore valore della CO2 da allevamenti), si ponga la necessità di fare delle scelte morali, di determinare quali siano le priorità da assegnare alle diverse opzioni e ai diversi obiettivi, cosa sia più importante, quale sia il valore da collocare in cima alla scala.

E, ancora una volta, mostra che le scienze e il lavoro scientifico non siano neutrali ma

- influenzate da istanze sociali, politiche e morali; l’interpretazione riduttiva del tasso di CO2 legato agli allevamenti intensivi, in questo caso, può essere stato influenzato da considerazioni di natura economica, occupazionale e alimentare

- politicamente e socialmente attive; in questo caso, ancora, la lettura della FAO ha orientato l’agenda politica e ambientale in direzione diversa da quella della riduzione dell’allevamento di animali da carne

È, perciò, opportuno non credere alla presunta obiettività e neutralità delle scienza ma – riconoscendone la rilevanza per la vita di tutti e senza cadere in forme di critica distruttiva – fare attenzione alle implicazioni sociali, politiche e morali che esse sottendono.

--------

A ben vedere, inoltre, queste contrapposizioni tra istanze morali che, prese una alla volta, sono tutte ampiamente condivisibili (chi non vuole salvare la Terra? E chi non vorrebbe eliminare la fame dal mondo? E chi si opporrebbe ad una economia florida e con meno disoccupazione? A chi piace veder soffrire e morire animali innocenti?) sono ben rappresentate tra gli organismi sovranazionali che, in particolare, fanno capo alle Nazioni Unite:

- la FAO – che ha la missione di assicurare cibo sufficiente e di qualità per tutti

- l’UNEP – che lavora a favore della tutela dell’ambiente e della sostenibilità

- la WOAH – che si occupa della salute e del benessere degli animali non umani

- l’ILO – organizzazione internazionale per il lavoro, con il fine di creare maggiori opportunità di occupazione e redito dignitosi

- la Banca Mondiale e il Fondo Monetario Internazionale – che dovrebbero impegnarsi per uno sviluppo equo ed equilibrato di tutte le nazioni

Organismi e obiettivi in tensione o, addirittura, in parziale conflitto tra loro. Come si possono – quindi – armonizzare agende [3] tanto diverse tra loro?

Un primo passopotrebbe essere quello di abbattere una sorta di tabù, quello dell’identificazione del cibo di alta qualità con la carne animale seguendo, ad esempio, le linee guida del Rapporto EAT – Lancet, che indica vie alternative (e spesso a minor costo) di alimentazione ricca e completa. Se la FAO adottasse questo punto di vista uno dei termini di opposizione si eliminerebbe.

Un secondo passo potrebbe essere, conseguenza del primo, l’adozione di una politica di progressiva trasformazione dell’economia dell’allevamento in economia della produzione e trattamento dei cereali per alimentazione umana, con misure di sostegno eco-finanziario da parte della Banca Mondiale, e con risultati efficaci per la salvaguardia dell’ambiente (meno CO2), del benessere di animali umani (meno rischi cardiaci) e non umani (meno sofferenze e morti).

Inoltre, eludendo la difficoltà di armonizzare politiche mondiali, potrebbe essere opportuno focalizzare gli interventi su aree micro economiche ed ambientali, in cui le misure di contenimento delle emissioni di CO2 possono essere orientate in modo mirato e gli interventi per la trasformazione ambientale, alimentare e produttiva possono essere sostenuti in modo più efficace, creando esperienze pilota e buone pratiche da diffondere.

Sempre con un occhio attento alle relazioni tra scienze, società, morale e politica, e con le orecchie aperte alle istanze minoritarie – anche quelle scientifiche – che possono alimentare l’innovatività e le soluzioni meno ovvie.

NOTE

[1] In modo molto semplificato, possiamo definire scelta morale una scelta fatta in modo consapevole sulla base di esperienze, convinzioni e scale di priorità e di valori. Per fare queste scelte usiamo, infatti, quello che sappiamo, quello che abbiamo provato, quello che ci ha insegnato se la scelta ci farà bene o male; per sapere se quello che accadrà ci farà bene o male usiamo l’esperienza del piacere e del dolore; per discernere tra piacere e dolore utilizziamo una scala di valori, cioè una classifica di cosa fa più bene o più male.

[2] Soprattutto bovina, cfr. Pathways towards lower emissions. A global assessment of the greenhouse gas emissions and mitigation options from livestock agrifood systems, Food and Agriculture Organization of the United Nations, Rome, 2023, ISBN 978-92-5-138448-0, si può scaricare qui, p. 12

[3] Qualcosa, in questo senso, è stato fatto: si tratta di ONE HEALTH un approccio integrato alla salute umana, animale e ambientale, che coinvolge la FAO, la WHO e la WOAH, e che – per ora – consiste in un gruppo trasversale di esperti costituito nel 2021 con l’obiettivo di sviluppare un punto di vista olistico su salute e ambiente e di fornire consulenza su questo tema alle Agenzie che lo formano. Questo approccio sembra essere, tuttavia, molto orientato alla tutela della salute umana.

La valutazione oggettiva non esiste - È sempre guidata da una teoria (soggettiva) sottostante…

09/07/2024Paradigmi scientifici,Sociologie

Si sente spesso pronunciare l’espressione “valutazione oggettiva”. Essa viene commissionata e richiesta a studiose, consulenti e valutatrici. In realtà tale espressione è un ossimoro. Perché la valutazione è sempre soggettiva. Forse, il vero pericolo è che diventi soltanto arbitraria. Ma a questo ci sono rimedi.

Le esperte e studiose serie di valutazione (non le praticone) lo sanno bene. E da molto tempo, ormai.

Cito solo tre approcci di importanti autori e autrici, che fin dagli anni ’80 hanno tematizzato questo aspetto, in polemica con la valutazione di impianto positivista e sperimentale:

- la valutazione realistica (Realistic Evaluation) di Ray Pawson e Nick Tilley

- la valutazione guidata dalla teoria (Theory-Driven Evaluation) di Chen e Rossi

- la valutazione basata sulla teoria (Theory Based Evaluation) di Carol Weiss

Il tratto comune a questi tre approcci è mostrare (e teorizzare) come la valutazione sia sempre guidata da una teoria sottostante, e quindi basata sia su assunti epistemologici ma anche di conoscenze di senso comune.

Vediamo un esempio illuminante che ci proviene dall’economia

Il valore di una professione

La New economics foundation (Nef) è un istituto di ricerca, consulenza e idee innovative (think tank) composto da una cinquantina di economiste, famose per aver portato nell'agenda del G7 e G8 (a fine anni duemila) temi quali il debito internazionale.

Nel 2009 si proposero di condurre una ricerca sul valore delle professioni, che adottasse però una prospettiva diversa (da quelle tradizionali). Tale prospettiva aveva lo scopo di “collegare gli stipendi al contributo di benessere che un lavoro porta alla comunità".

Come spiegarono nella stessa introduzione della ricerca, "abbiamo scelto un nuovo approccio per valutare il reale valore del lavoro. Siamo andati oltre la considerazione di quanto una professione viene valutata economicamente e abbiamo verificato quanto chi la esercita contribuisce al benessere della società. I principi di valutazione ai quali ci siamo ispirati quantificano il valore sociale, ambientale ed economico del lavoro svolto dalle diverse figure".

--------

In altre parole, se si modificano i criteri teorici, culturali, ideologici (ma questa è una scelta, una decisione, un atto soggettivo), avremmo risultati di ricerca molto diversi.

Il Nef calcolò così il valore economico di sei diversi lavori, tre pagati molto bene e tre molto poco, introducendo nuovi criteri e abbandonando i vecchi (soggettivi anche loro, ovviamente).

Il risultato fu sorprendente e rovesciava le gerarchie tradizionali.

Ad esempio, comparando un operatore ecologico e un fiscalista, il Nef concludeva che il primo contribuisce con il suo lavoro alla salute dell'ambiente grazie al riciclo delle immondizie, mentre il secondo danneggia la società perché studia in che modo far versare ai contribuenti meno tasse. Quindi il primo dovrebbe essere pagato molto di più e il secondo molto di meno (per usare un eufemismo).

Lo stesso vale, dicono al Nef, per i banchieri che prosciugano la società e causano danni all'economia globale.

In generale, esaminando “il contributo sociale del loro valore, abbiamo scoperto che i lavori pagati meno sono quelli più utili al benessere collettivo".

Conclusione che certamente approverebbero i due uomini in giallo, ma anche Wim Wenders, visto che con il suo ultimo film Perfect Days (2023) fa un biopic di un addetto alle pulizie dei bagni pubblici di Shibuya (uno dei 23 quartieri speciali di Tokyo), quasi un eroe dei nostri tempi.

Le economiste del Nef sono molto chiare: “il nostro studio vuole sottolineare un punto fondamentale e cioè che dovrebbe esserci una corrispondenza diretta tra quanto siamo pagati e il valore che il nostro lavoro genera per la società. Abbiamo trovato un modo per calcolarlo e questo strumento dovrebbe essere usato per determinare i compensi".

Per cui, la valutazione è primariamente un problema teorico.

Solo secondariamente diventa un problema tecnico.

Proprio l’opposto di quello che molte scienziate ci dicono, e continueranno a (men)dire…

RIFERIMENTI BIBLIOGRAFICI

Chen H. T. (1990), Theory driven Evaluation, Thousand Oaks: Sage.

Chen H. T. e Rossi P. H. (1981), The multi-goal, theory-driven approach to evaluation. A model linking basic and applied social science, in “Social Forces”, 59, pp. 106-22.

Pawson R. e Tilley N. (1997), Realistic evaluation, London: Sage.

Weiss C. H. (1995), Nothing as Practical as Good Theory: Exploring Theory-Based Evaluation for Comprehensive Community Initiatives for Children and Families, in Connell J. P., Kubisch A. C., Schorr L. B. e Weiss C. H. (a cura di), New Approaches to Evaluating Community Initiatives. Vol. 1 Concepts, Methods, and Contexts, The Aspen Institute, Washington (DC), pp. 65-92.

Weiss C. H. (1997a), How can Theory-Based Evaluation make greater headway? in “Evaluation Review”, 4, pp. 501-524.

Weiss C. H. (1997ab), Theory-based evaluation: past, present, and future, in “New Directions for Evaluation”, 76, pp. 41-55,

Weiss C. H. (1998), Evaluation. Methods for studying programs and policies, Upper Saddle River (NJ): Prentice Hall, 1998.

Un fiume norvegese, il governo e dei pescatori tradizionali - La conoscenza scientifica come forma di colonialismo?

09/07/2024Tecniche e Tecnologie,Antropologie,Politica

Noi occidentali abbiamo imparato a dare per scontato che la conoscenza scientifica abbia un primato epistemologico sulle altre forme di conoscenza. Ma esistono anche delle conoscenze tradizionali che non sono formalizzate in teorie, concetti specifici, ma che possono avere una forte presa sulla realtà.

------------

Nel saggio “Indigeneity, science and difference: notes on the politics of how”, John Law e Solveig Joks (2019) analizzano una controversia coloniale riguardante la regolamentazione della pesca del salmone nel fiume Deatnu.

Da un lato c’è il governo norvegese che, con i suoi ricercatori e biologi, vuole imporre delle norme per preservare le popolazioni di salmoni attraverso la riduzione delle attività di pesca. Secondo il governo e i ricercatori, gli obiettivi di stoccaggio non venivano raggiunti e il numero di salmoni stava diminuendo.

Questo gruppo di scienziati finlandesi e norvegesi aveva raccolto statistiche, modellato stock ittici ed eseguito proiezioni demografiche; sulla base di questi elementi aveva elaborato delle regole rigide su chi può e chi non può pescare in questo fiume scandinavo, con quali tecniche, in quali periodi e in quale ora del giorno. Queste norme sono il prodotto di statistiche e proiezioni biologiche sulla popolazione ittica.

Dall’altro lato ci sono le popolazioni indigene dei Sàmi che abitano sulle rive del fiume: i Sami conoscono come si comporta il livello dell'acqua nella sua loro parte di Deatnu, conoscono l'ora del giorno più propizia, il momento della stagione più favorevole per pescare, le predisposizioni dei vari tipi di salmone, e come incidono la temperatura, il sole, il vento, la pioggia e la neve sulla pesca.

In altre parole, hanno pratiche e concezioni diverse del fiume e del salmone.

Inoltre, la cautela e il rispetto per il fiume e per il salmone, il senso del luogo, la modestia, sono valori fondamentali che orientano la loro pratica di pesca; ad esempio, non pescano più salmone del necessario, non contano i pesci che catturano (farlo sarebbe irrispettoso) e non pescano quando i salmoni stanno per riprodursi. Fanno affidamento su un tipo di conoscenza caratterizzata da un'avversione per le statistiche. Anche i pescatori Sàmi si preoccupano per il salmone, solo che non lavorano con i numeri, ma si chiedono: arriverà il salmone? Continueranno ad arrivare? E, se ne arrivano meno, perché?

Nonostante ciò, il governo norvegese ha adottato le norme prodotte dal gruppo di scienziati riducendo i periodi di pesca da 11 (nel 2016) a 4 (nel 2017).

Queste regole - però - impedivano ai Sami di pescare quando le condizioni erano giuste, oppure glielo impedivano in un’altra parte del fiume anche se lì le condizioni sono giuste ma non in quella dove loro abitavano; impedivano di pescare anche se lo stato del tempo e del fiume sono ottimali, o le attività degli altri pescatori e l’ottima pesca dell’ultimo periodo hanno fatto capire loro che quello è un buon momento per pescare.

-------------

Il punto è che queste regole ignorano le competenze delle popolazioni locali e la loro più profonda preparazione perché le costringe a pescare in orari predeterminati e, a volte, inappropriati; oppure permettono di pescare quando invece non si può perché non c’è nessuno che ti può aiutare con le reti, oppure perchè l’acqua è troppo bassa o alta.

Gli autori dello studio mettono in luce l’asimmetria di potere tra le pratiche della biologia e le conoscenze ecologiche tradizionali dei Sami. La scienza dei biologi e ricercatori si basa sulla raccolta e l’elaborazione rigorosa di dati sistematici all'interno di un modello o ipotesi di ricerca, in grado di produrre un tipo di conoscenza oggettiva.

Quella dei Sàmi, invece, è un tipo di conoscenza in gran parte basata sull’esperienza, orale e visiva, intuitiva, e altamente qualitativa. Proprio per questo motivo viene marginalizzata.

Questo produce degli effetti più ampi.

In primo luogo, con la pesca limitata a quattro periodi all’anno, diventerà quasi impossibile per i giovani Sami imparare l’arte della pesca tradizionale, e questo la farà piano piano scomparire, insieme a quell’insieme di saperi e conoscenze sul come controllare una barca e maneggiare una rete, ma anche su come funziona il fiume, dove scorrono i canali profondi, dove è probabile che nuotino i salmoni. Tutto ciò richiede tempo, pazienza e pratica, ma con l’introduzione di queste regole tutto ciò viene loro tolto.

In secondo luogo, la scelta di adottare quelle norme ha una forte dimensione politica. Siamo di fronte a due modi differenti di assemblare la realtà. La modellazione scientifica della pesca mette in scena un modello fatto di meccanismi causali standard per spiegare le specificità di particolari fiumi, popolazioni e tassi di sfruttamento. In questo mondo non c’è spazio per le pratiche di pesca Sámi.

Gli autori parlano di un “soffocamento ontologico”, da parte del mondo delle regole che ignora le contingenze tradizionali dei locali e mette in atto un altro tipo di realtà. I modelli degli scienziati mettono in pratica una logica di colonizzazione perché presumono che esista un unico mondo “scopribile” attraverso meccanismi e/o correlazioni.

Ma questo tipo di rappresentazione non lascia spazi per storie, realtà e conoscenza alternative.

Sembra evidente che, a volte, la conoscenza scientifica ha lo stesso effetto del colonialismo sui Paesi che sono diventati colonie, cioè l’imposizione di un modo di pensare alla realtà in aperto contrasto e incompatibile con gli stili di vita tradizionali.

L’idea dell’oggettività, dello sguardo da nessun luogo non è realistica, I laboratory studies (Latour e Woolgar 1979; Knorr Cetina 1997) hanno mostrato come l’oggettività venga prodotta attraverso una continua manipolazione degli oggetti.

In questo caso abbiamo una ontologia, quella degli scienziati e biologi, che viene sovrapposta all’ontologia dei Sàmi.

I Sami hanno, infatti, una visione di cos’è oggettivo, ma la scienza impone una realtà divergente, che poi propone alla politica e pretende che sia implementata.

CONCLUSIONE

Nel momento in cui le norme vengono implementate si genera un circolo vizioso, in cui alcuni scienziati possono giustificare le proprie pratiche con frasi del tipo “eh ma sono scelte politiche”. Allo stesso tempo, la politica, implementando quel tipo di decisioni può deresponsabilizzarsi, attraverso il famoso mantra “lo dice la scienza”. La scienza fornisce una importante legittimazione alle scelte politiche a causa della sua autorità epistemica sulle altre forme di sapere, ma proprio per questo motivo non può rivendicare una neutralità perchè le decisioni prese producono degli effetti.

La scienza è una pratica sociale che crea un tipo di realtà e, spesso attraverso la politica, la mette in atto. Non c’è spazio per altre versioni. La natura viene rappresentata come un'unica realtà modellata da meccanismi generali che possono essere individuati dai ricercatori, mentre la cultura viene vista come multipla, soggettiva e normativa.

La sfida non è convincere le popolazioni Sami che la conoscenza scientifica è epistemicamente superiore, ma piuttosto fare in modo che la conoscenza dei Sami venga integrata nella scienza. La necessità è quella di creare pratiche materiali concrete che avvicinino gli uffici, i laboratori, i modelli biologici dei “coloni” alle pratiche locali dei Sámi.

Nel caso specifico la direzione potrebbe essere quella di “ammorbidire” il realismo della biologia.

BIBLIOGRAFIA

Knorr-Cetina K. (1997), Sociality with Objects. Theory, Culture and Society 14 (4):1-30.

Latour B. e Woolgar S. (1979), Laboratory life: The construction of scientific facts, Princeton University Press, Princeton.

Law, J., & Joks, S. (2019). Indigeneity, Science, and Difference: Notes on the Politics of How. Science, Technology, & Human Values, 44(3), 424-447.

Il contagio corre su internet - Malattie social-media-mente trasmissibili

02/07/2024Tecniche e Tecnologie,Salute e Medicina

Melanconie

Secondo Agamben (1979) non si sono mai aggirati per l’Europa tanti fantasmi come nel Medioevo. Il problema non è da ricondurre alle superstizioni del periodo, ma alle regioni più elevate della scienza del periodo Scolastico: alla fantasia e ai suoi prodotti, i fantasmi, spetta un ruolo centrale nella teoria della conoscenza. Sono immagini quelle che i sensi catturano dalla realtà, ma è compito della fantasia trattenerle e svilupparle nel sistema di specchi che in cui si articola la parte più spirituale della razionalità – quella speculativa. Il Medioevo era, quindi, più ossessionato dall’immagine di quanto lo sia la nostra epoca; ha anche elaborato una riflessione raffinata sull’ossessione, tanto che la nozione stessa di «idea fissa» è in debito con le concezioni medievali della «melanconia», e con il potere degli spiriti intermedi (o dei demoni) di imprimere un’immagine nella fantasia senza permetterle di focalizzare più alcun’altra figura. Il suo oggetto non esiste, ma questa evidenza non le impedisce di sbarrare la strada verso la propria realizzazione, che è l’imitazione di Cristo, e di riconoscere la vera felicità, che è Dio.

Le fibre dell’isolamento

Il testo di Leslie Jamison - Esami di empatia - mostra che, in età contemporanea, le immagini continuano a fissarsi nello stesso modo, con la sola differenza che l’agente non è più un demone ma Internet, e il gioco degli specchi coinvolge anche gli altri soggetti che condividono la stessa monomania, e che con la loro approvazione rendono l’ossessione abitabile, oggettiva, invalicabile, meglio di quanto potessero fare i vecchi spiriti.

Tra i fantasmi descritti da Jamison, due evidenziano meglio il carattere autodistruttivo dell’ossessione: due malattie che contagiano in prevalenza le donne, due epidemie che hanno cominciato a espandersi dopo il 2001 e che hanno trovato nei canali di Internet il veicolo principale, anche se con due destini del tutto diversi.

La prima delle due è stata tenuta a battesimo su un forum online da Mary Leitao, una biologa tecnica di laboratorio, che l’ha etichettata «morbo di Morgellons», sulla base dei sintomi censiti in una rivista medica francese del Seicento. Una dermatite che può originare anche dolore e irritazioni, e che costringe il paziente a grattarsi fino all’escoriazione, è l’anamnesi della malattia di cui soffre anche il figlio della Leitao, e che nessun medico è riuscito a ridurre ad una diagnosi convincente. Nelle piaghe provocate dagli strofinamenti per lenire il prurito, come aveva pronosticato Thomas Brown mentre esaminava i ragazzi (i «Morgellons») della regione di Languedoc, la biologa ha rintracciato fibre sottili e granelli scuri. A questi corpi estranei si dovrebbe imputare l’infezione e il dispiegamento dell’intera collezione di sofferenze connesse; ma la rivelazione che la filologia ha consegnato alla Leitao è rimasta una scoperta malinconica, una verità ripudiata e stigmatizzata come eresia dalla comunità medica. Secondo la scienza istituzionale le cause del morbo risalgono ad una sindrome di «Münchausen by proxy», una reazione auto-immune ipertrofica indotta da paranoie di vario genere, insieme al bisogno di ottenere attenzioni.

Dalla metà degli anni Duemila la Fondazione Charles Holman convoca una volta all’anno ad Austin, nella Chiesa di Westoak, i pazienti di Morgellons che si sentono traditi dalla medicina ufficiale, per sviluppare colloqui tra malati e ricercatori. Quando Jamison ha partecipato all’evento nel 2012 ha incontrato persone con un’immagine di sé stesse del tutto distorta – ma adeguata all’isolamento sociale cui sono consegnate dalla loro condizione economica, lavorativa, famigliare. La malinconia che opprime queste conversazioni – interviste, o saggi di empatia – riesce a far coincidere i confini del concetto medievale con la nostra nozione di prostrazione emotiva. Le pazienti, anche quelle che a giudizio della giornalista godono di un aspetto attraente, si percepiscono sfigurate dalle macchie e dalle piaghe della dermatite, e accettano la conseguenza di consegnarsi ad un destino di clausura, il cui unico contenuto è l’ispezione delle proprie ulcere, alla ricerca di filamenti e di micro-frammenti scuri. Al convegno di Austin i «morgi» ritrovano un’identità nel nome proscritto del loro morbo, nella censura che è ad un tempo dannazione e salvezza della loro comunità. Il riconoscimento reciproco si ferma a questa assenza o a questo esilio, e la compresenza nella Chiesa di Westoak è una giustapposizione di solitudini che non si parlano, separate dalla varietà dei sintomi e delle convinzioni sulla natura del contagio, ma soprattutto dall’introversione dell’autoesame, dall’ossessione per gli specchi e le lenti di ingrandimento.

La sindrome dell’influencer

Decine, se non centinaia di migliaia di Morgellons sono stati curati dai medici con una combinazione di antinfiammatori e di ansiolitici: alcuni si sono fatti guidare dalla terapia e sono guariti, altri sono rimasti imprigionati dalla sindrome. Una sorte del tutto differente è toccata all’altra malattia, che nelle pagine della Jamison è ancora senza un nome ufficiale: la vulvodinia non è una sindrome per diseredati, ed è stata sostenuta dalla testimonianza di numerose influencer sui social media. La legge presentata nel 2022 In Italia al Senato vantava come ambassador Giorgia Soleri, influencer su TikTok e – a quel tempo – fidanzata di Damiano dei Måneskin. Sui media istituzionali le pazienti vengono contate con percentuali di vaste proporzioni (10%-15% di tutte le donne), senza mai citare la fonte del dato: denunciano una sofferenza nell’area genitale, per la quale i medici non riescono a risalire ad una causa fisiologica univoca. In questo caso però le testimoni sono di riguardo, e come ricostruisce Fontana (2024), qualunque contestazione della loro posizione viene stigmatizzata come un rigurgito di patriarcato che ancora scuote l’inconscio della comunità scientifica. Gli influencer non possono essere accusati di Schwärmerei, la possessione fanatica che Lutero imputava ai contadini ribelli di Melantone (sostenitori della Riforma luterana ma antagonisti dell’aristocrazia feudale con cui Lutero aveva stretto un’alleanza politica), e che i medici rintracciano nei Morgellons: non li si può accusare di non essere padroni della loro parola, di essere solo il veicolo della voce dei demoni che li abitano. Quindi l’OMS ha riconosciuto la formazione di questa nuova identità morbosa, e della comunità di cittadini che ne soffre, e l’ha iscritta nell’ICD-11, con il nome in cui si riconoscono i suoi pazienti.

Il potere di dire la verità

La comunità scientifica è incompatibile con i Morgellons ma compatisce la vulvodinia. Nel primo caso occorre liberare l’anima da un demone, che assoggetta gli individui a immagini capaci di fissare un discorso eretico nella mente, e di trasformare il corpo nel teatro che lo mette in scena. Nel secondo caso i pazienti sono peer reviewer di un discorso scientifico che, attraverso la diagnosi della malattia, contribuisce a liberare l’identità femminile (e l’intera società, che nella soggettività femminile trova la sua espressione più avanzata) dai pregiudizi riemergenti del patriarcato. Jamison presenta una galleria di saggi di empatia, in cui tenta di restituire a questo termine un contenuto sperimentale, una comprensione dell’altro attraverso l’adesione alla sua identità, la partecipazione alle condizioni che imprimono sulla sua vita la forma della sua individualità, con una pressione che è passione e patologia. Nelle sue pagine la vulvodinia si afferma come il dolore che la tradizione occidentale incide nel corpo delle donne nell’assegnarle al genere femminile: una forma di potere di coesione sociale che è congruente e accessibile al regime classificatorio del potere di veridizione da parte della comunità scientifica. I Morgellons sono l’espressione di un’esclusione, l’introiezione di un esilio sociale che li isola anche l’uno dall’altro: un esercizio congruente con la pratica del potere scientifico di rimuovere ciò che non deve appartenere alla tassonomia dell’oggettività, di rigettare la soggettività chi non ha abbastanza forza per partecipare alla peer reviewing.

O forse la vulvodinia è uno degli ultimi compromessi che le comunità di internet cercano di stabilire con le procedure e gli attori delle istituzioni tradizionali, in attesa che le identità modellate online non abbiano più bisogno di altro credito se non l’autonomia della propria fondazione per abitare il proprio mondo, sovrapposto e incompatibile, anempatico, con quelli posseduti dagli altri.

BIBLIOGRAFIA

Agamben, Giorgio, Stanze, Einaudi, Torino 1979.

Fontana, Laura, Il complesso mondo delle malattie “Internet-based”, «Link», 19 febbraio 2024.

Jamison, Leslie, The Empathy Exams, Graywolf Press, Minneapolis 2021.

La costruzione sociale della bicicletta - Ovvero, le tecnologie non sono neutrali

02/07/2024Tecniche e Tecnologie,STS

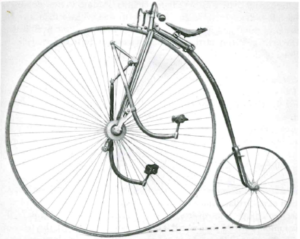

Provate ad immaginare una di quelle volte in cui avete deciso di fare un giro in bicicletta, magari in una bella giornata di primavera. Dopo esservi preparati e aver preso quello che vi serve, entrate finalmente in garage per prendere la bici ed uscire. Tuttavia, invece di trovare la bici che usate di solito trovate una di quelle bici con la ruota anteriore molto grande (figura 1) e diffuse alla fine dell’Ottocento. Pensate ad un mondo in cui tutto è uguale ad oggi, ma invece che utilizzare la bici moderna tutti usano queste bici. Partire da questa immagine strampalata e apparentemente senza senso permette di porre in rilievo una questione: le cose potrebbero essere andate diversamente da come le conosciamo? Oggi potremmo avere una bici diversa da quella che ci risulta apparentemente come normale? Infatti, come vedremo, “non c’è un solo modo possibile o un solo modo migliore di progettare un artefatto” (Bijker, Hughes e Pinch 1987, p.40 trad. mia), come nel caso della bici. È da questi interrogativi che parte anche l’approccio SCOT (Social Construction of Technology) allo studio della tecnologia, e attraverso cui Wiebe Bijker (1995) ricostruisce la traiettoria di sviluppo che ha portato alla bici moderna.

Un primo prototipo risale ad un disegno del 1493, attribuibile a Leonardo Da Vinci, in cui viene rappresentato un biciclo con due ruote delle stesse dimensioni, pedali e manubrio. Dunque, Bijker (ibidem) si chiede: perché si è dovuto aspettare fino al XIX secolo per l’affermazione della bici moderna? Questo mostra come per avere un’innovazione tecnologica non basta che ci sia un inventore isolato dal mondo e con una buona idea (Magaudda e Neresini 2020). Infatti, si è dovuto attendere fino al Settecento per la costruzione del primo célerifère (figura 2), un biciclo con una struttura di legno e due ruote della stesse dimensioni, e senza la possibilità di sterzo. Per spostarsi era necessario spingere a terra con i piedi, il più della volte infangandosi. Per questo motivo, iniziarono ad emergere una serie di varianti, tra le quali ebbe particolare successo il vélocipède (figura 3): aveva una struttura di ferro, il manubrio, la sella e i pedali regolabili. In questo caso, i problemi erano principalmente legati alle troppe vibrazioni e allo slittamento laterale del mezzo. In seguito, con l’ordinary bicycle (figura 1) venne introdotta una posizione di guida rialzata sopra la grande ruota anteriore, la quale permise di attenuare i colpi e di non infangarsi, evitando il contatto diretto con il terreno. Inoltre, questo biciclo fu reso più leggero con l’impiego di raggi di filo metallico per la struttura delle ruote.

L’ordinary bicycle fu pubblicizzata dai suoi ideatori attraverso un’impresa ciclistica in cui venne percorsa la tratta che va da Londra a Coventry in un solo giorno. Questo evento contribuì alla costruzione dell’immagine della bici a ruota alta come mezzo sportivo, veloce ed efficiente. Non a caso, in un primo momento i principali utilizzatori di questo biciclo furono i “giovani atletici e danarosi” (Bijker 1995), per i quali era un mezzo sportivo per andare veloce e per manifestare la propria virilità e machismo. Infatti, viste le grandi dimensioni, l’ordinary bicycle richiedeva una serie di doti fisiche e atletiche per essere utilizzata, non era un mezzo sicuro e accessibile a tutti.

Se da un lato i giovani atletici erano i principali utilizzatori dell’ordinary, dall’altro lato, diversi individui rimanevano esclusi dalla possibilità d’impiego del biciclo, per cui si può parlare anche di una serie di gruppi di non-utilizzatori. Nello specifico, per le persone anziane e per chi non aveva una certa prestanza fisica l’ordinary non era un mezzo sicuro con cui potersi muovere: c’era un forte rischio di cadute ed infortuni. Inoltre, veniva escluso dall’utilizzo del biciclo anche chi non aveva la disponibilità economica per acquistarlo. Infine, alle donne non era consentito utilizzare questo mezzo perché entrava in netto contrasto con i codici di abbigliamento femminile dell’epoca. In relazione a ciò, in quel periodo si sviluppò la Rational Dress Society, una società di donne che rivendicava il diritto di vestirsi in maniera più libera evitando corsetti, tacchi e gonne pesanti, in modo da poter accedere anche all’utilizzo della bici.

Se da un lato i giovani atletici erano i principali utilizzatori dell’ordinary, dall’altro lato, diversi individui rimanevano esclusi dalla possibilità d’impiego del biciclo, per cui si può parlare anche di una serie di gruppi di non-utilizzatori. Nello specifico, per le persone anziane e per chi non aveva una certa prestanza fisica l’ordinary non era un mezzo sicuro con cui potersi muovere: c’era un forte rischio di cadute ed infortuni. Inoltre, veniva escluso dall’utilizzo del biciclo anche chi non aveva la disponibilità economica per acquistarlo. Infine, alle donne non era consentito utilizzare questo mezzo perché entrava in netto contrasto con i codici di abbigliamento femminile dell’epoca. In relazione a ciò, in quel periodo si sviluppò la Rational Dress Society, una società di donne che rivendicava il diritto di vestirsi in maniera più libera evitando corsetti, tacchi e gonne pesanti, in modo da poter accedere anche all’utilizzo della bici.

Come sottolinea Bijker (1995), questa prima fase di sviluppo della bicicletta si caratterizzata per la presenza di diversi “gruppi sociali rilevanti” (giovani atletici e danarosi, donne, anziani); ovvero, gruppi di attori che condividono al loro interno la medesima interpretazione di un artefatto tecnologico come la bici. In tal senso, si parla di una “flessibilità interpretativa” tra i vari gruppi: se per i giovani atletici l’ordinary è un mezzo sportivo e virile, per il gruppo degli anziani rappresenta qualcosa di poco sicuro, mentre, per il gruppo delle donne diventa un campo di rivendicazione dei diritti alla libertà di abbigliamento e all’utilizzo della bici. Queste diverse interpretazioni riguardano una serie di problemi e soluzioni che vengono poste dai vari gruppi rispetto al funzionamento di un particolare artefatto tecnologico e che lo rendono utilizzabile. Va precisato che questa flessibilità non riguarda solo il “modo in cui le persone pensano o interpretano gli artefatti, ma anche la flessibilità nel modo in cui gli artefatti sono progettati” (Bijker, Hughes e Pinch 1987, p. 40 trad. mia). Dunque, è in relazione alle interpretazioni dei diversi gruppi social che prendono materialmente forma differenti modelli di bici. Ad esempio, per rispondere al problema del codice di abbigliamento femminile vennero sviluppate delle bici con la pedalata laterale (figura 4); mentre, per rispondere al problema della sicurezza vennero progettati modelli come la Lawson bicycle (figura 6) e la xtraordinary (figura 5), delle varianti della Ordinary in cui venne ridotta la grandezza della ruota anteriore e la trazione venne spostata sulla ruota posteriore. In questo senso, si vede bene come la tecnologia incorpori una serie di aspettative sociali da parte di chi la progetta e, al contempo, essa contribuisca a stabilizzare e dare forma alle relazioni tra i vari gruppi di utilizzatori.

Quindi, com’è stato poi possibile passare da questa molteplicità e varietà di bicicli differenti a quella che noi riteniamo essere la bici moderna? Per Bijker (1995) la risposta è da trovare nello pneumatico ad aria. Quest’ultimo inizialmente era visto come qualcosa di esteticamente ridicolo e poco funzionale. Tuttavia, la situazione cambiò nel maggio del 1889, quando il ciclista W. Hume vinse una gara dimostrando la validità degli pneumatici ad aria e della Safety bicycle (figura 7). È in questo momento che per Bijker (ibidem) c’è il momento di “stabilizzazione e chiusura” nella traiettoria di sviluppo tecnologico della bici: c’è una soluzione tecnica che permette di far convergere le interpretazioni dei vari gruppi sociali, rispondendo ai diversi problemi che essi pongono. In questo senso, la safety bicycle permette di rispondere sia alla necessità di andare veloce del gruppo dei giovani atletici, sia all’esigenza di una certa guida in sicurezza da parte di persone anziane e meno prestanti fisicamente, inoltre, permette un allineamento dei codici di abbigliamento femminile con l’utilizzo della bicicletta. Con la fase di stabilizzazione e chiusura la bici diventa quello che gli STS (Science and Technology Studies) definiscono una “scatola nera”; ovvero, una tecnologia pronta all’uso, disponibile per essere impiegata e che non è necessario problematizzare ulteriormente. Per questa ragione, quando ci riferiamo alla bicicletta nella vita di tutti i giorni non dobbiamo specificare che ha due ruote della stessa misura, i pedali, il manubrio, la catena; questi sono degli elementi che assumiamo come certi.

Da questa storia può essere fatto emergere quello che è il modello analitico dell’approccio SCOT per guardare allo sviluppo e all’innovazione tecnologica, il quale si articola principalmente in tre fasi (Bijker, Hughes e Pinch 1987; Bijker 1995): inizialmente c’è una “flessibilità interpretativa” di quelli che possono essere particolari dispositivi tecnologici, i quali vengono progettati con forme e caratteristiche diverse per rispondere ai problemi posti dai vari gruppi sociali; in una seconda fase avviene la “chiusura interpretativa”, l’artefatto tecnologico e le interpretazioni dei gruppi si stabilizzano arrivando a convergere tra loro; infine, questa chiusura va ricollegata e spiegata in un contesto sociale più ampio.

In conclusione, riprendendo gli interrogativi da cui siamo partiti, le cose potrebbero essere andate effettivamente in modo diverso? Gli STS, e in particolare l’approccio SCOT, ci insegnano che la traiettoria dell’innovazione e dello sviluppo tecnologico è qualcosa di aperto, incerto, e non deciso a priori. Come nel caso della bici, le tecnologie vengono progettate in relazione alle aspettative dei gruppi sociali e, al contempo, contribuiscono a dare forma alle stesse relazioni tra gruppi e individui. In altri termini, tecnologia e società co-evolvono e si danno forma a vicenda in un tessuto unico e senza cuciture, un saemless web (Bijker 1995). Per questa ragione, il percorso che porta all’affermazione di una tecnologia non è qualcosa di lineare e già scritto: non è sufficiente che ci sia un inventore o una scoperta scientifica per sviluppare automaticamente una tecnologia più sofisticata, la quale finirebbe per impattare sulla vita quotidiana delle persone. In tal senso, le tecnologie che si affermano non sono quelle “più efficienti” o che “funzionano meglio”, ma quelle che si configurano come tali in particolari contesti d’uso. Per questa ragione, la bici moderna non si è affermata perché era la migliore da un punto di vista tecnico e di costruzione rispetto alle concorrenti, ma perché ha permesso di far convergere le interpretazioni dei vari gruppi sociali rispondendo ai loro problemi d’uso. Questo discorso può essere esteso per l’analisi di altre tecnologie e mostra come il processo di sviluppo tecnologico sia un processo non lineare e mai dato per scontato, in cui gruppi di attori e artefatti tecnologici si costruiscono reciprocamente.

BIBLIOGRAFIA

Bijker, W. E. (1995). Of Bicycles, Bakelites, and Bulbs. Toward a Theory of Sociotechnical Change. The MIT Press.

Bijker, W. E., Hughes, T. P., Pinch, T. J. (1987). The social Construction of Technological Systems. New Directions in the Sociology and History of Technology. The MIT Press.

Magaudda, P., Neresini, F. (2020). Gli studi sociali sulla scienza e la tecnologia. Il Mulino.

Quando è nata la Scienza? - Dall'antica Grecia all'epoca dei lumi

Fino a qualche decennio fa, quando la scienza era considerata un corpus di idee sul mondo naturale, i suoi albori venivano collocati nel contesto del pensiero filosofico della Grecia Antica (Popper 1972). È ragionevole? Vediamo.

Partendo da Platone…

Platone nel Teeteto usa il termine epistêmê con il significato (ampio) di conoscenza: epistêmê non sarebbe altro che sensazione (151 E). Un concetto quindi non sovrapponibile all’attuale concetto di scienza, solitamente esibito come alternativo alla (semplice) conoscenza. Infatti, nel Teeteto la conoscenza scientifica sarebbe una specie particolare della conoscenza più generale, non una conoscenza alternativa. Per cui non sarebbe corretto tradurre epistêmê con ‘scienza’.

Invece, alla fine del Libro VI della Repubblica, nella celebre immagine della linea divisa (509 D-511 E), Platone parla di due tipi di conoscenza: chiara (saphenêia) e oscura/indeterminata (asapheia). Per Platone, però, ‘chiara’ non vuol dire ‘certa’. La conoscenza chiara pertiene al mondo intellettuale (anima); quella oscura deriva dai sensi e riguarda il mondo sensibile. Per Platone abbiamo sapere o scienza solo nel mondo intellettuale, non di quello sensibile perché le osservazioni empiriche non aggiungono nulla alla conoscenza piena (o conoscenza in senso stretto). Viene così introdotta una distinzione netta tra ‘epistêmê’ (che diviene la conoscenza chiara, basata sulla logica, che sta in piedi da sola, da epi + istemi) e doxa (le credenze, che possono essere dogmatiche perché poggianti sull’autorità, oppure basate sulle opinioni, sia vere che false, credibili o meno). Infine, Platone distingue anche due tipi diversi di ‘epistêmê’ o conoscenza chiara: quella (come la matematica e la geometria) che si sviluppa a partire da ipotesi e deduce attenendosi alle conseguenze che ne derivano; e quella (la dialettica) che si interroga e spiega anche i fondamenti delle ipotesi stesse. Per cui, anche se le scienze matematiche sono epistemai, tuttavia solo la dialettica è in grado di raggiungere la conoscenza piena, perché si interroga sulle ipotesi di partenza.

Aristotele: un passo avanti…

Aristotele, nel libro Analitici Secondi (II 2, 71b9-15), compie un ulteriore passo, sviluppando una teoria della "conoscenza scientifica", che chiama… epistêmê. Questo diverso significato della parola epistêmê l’avvicinerebbe maggiormente al concetto di scienza. In questo testo, Aristotele sostiene che abbiamo episteme (cioè, conoscenza scientifica) di X quando si danno le seguenti condizioni: conosciamo Y, sappiamo che Y è la ragione/causa (aitìa) di X, e questa relazione tra X e Y è necessaria. Per Aristotele epistêmê implica quindi dare spiegazioni, trovare le cause/ragioni. Necessità e spiegazione causale sono i due ingredienti fondamentali della conoscenza scientifica, che è una forma molto precisa di conoscenza.

Per cui la nostra domanda iniziale (quando è nata la scienza?) sembrerebbe trovare risposta nella proposta di Popper. Ma non è così.

Dal Medioevo al 1600

La tradizione latina medievale ha poi tradotto epistêmê in ‘scientia’. In questo senso c’è una dipendenza diretta tra il testo degli Analitici Secondi e l’epistemologia medievale. Tuttavia, il termine ‘scientia’ significava solo conoscenza, sapere, notizia; almeno fino al XVII secolo. Ciò non di meno, il termine ‘scientia’ ha significato cose molto diverse in epoche diverse e culture diverse. Perciò le cose si complicano nuovamente.

Infatti, a quel tempo, lo studio della natura cadeva invece sotto l'espressione "filosofia naturale". Essa comprendeva al suo interno tutti quei campi di ricerca che noi oggi chiamiamo geologia, astronomia, chimica, ottica, biologia e botanica, ma anche la filosofia e la teologia. Inoltre, a differenza della scienza contemporanea, la filosofia naturale non si basava sulla sperimentazione (ritenuta invece successivamente l’elemento centrale della scienza), ma sulla speculazione intellettuale e la tradizione. Infine, tutti coloro che investigavano la natura si identificavano comunemente con l'espressione "filosofo naturale".

Il "metodo scientifico" - sperimentale e quantitativo - che diede origine alla scienza sperimentale, venne sistematizzato solo tra il XVI e XVII secolo, durante il periodo della cosiddetta Rivoluzione Scientifica. Secondo alcuni (per esempio Whitehead 1920) il merito di questo cambiamento andrebbe attribuito a poche illustri figure come quella di Francis Bacon o Galileo Galilei; secondo altri, invece, il processo di formalizzazione del metodo scientifico richiese ancora diversi decenni e il contributo di molte scoperte in molti campi differenti, dall'astronomia alla geologia.

Il padre di tutti i fraintendimenti: l’essenzialismo

Entrambe le prospettive, però, partono da un presupposto essenzialista, cioè che possano essere identificate delle caratteristiche costitutive della scienza come categoria di pensiero, e che queste rimangano immutate nel tempo. Tuttavia, come abbiamo visto all’inizio di questo capitolo, la scienza non ha caratteristiche fisse e immutabili ma, in quanto istituzione, essa coincide con la comunità che ne riproduce le convenzioni e così facendo la pone in essere. Se così non fosse non si potrebbero spiegare molte figure ‘ibride’, se viste con gli occhi di oggi: ad esempio Newton, da alcuni considerato il fondatore della fisica classica e la figura con la quale la rivoluzione scientifica raggiunse il culmine, non solo intitolò la sua opera più celebre Philosophiæ Naturalis Principia Mathematica (1687) (e non utilizzò quindi la parola “scienza”) ma benché oggi poco ricordato, scrisse copiosamente anche di teologia, occultismo e soprattutto di alchimia.

Invece il termine ‘scienziato’ (scientist) è stato introdotto solo nel primo Ottocento. Tant’è che personaggi come Galileo o Newton erano ancora chiamati ‘filosofi naturali’ (natural philosophers). Il termine ‘scienziato’ fu coniato per la prima volta dallo studioso inglese William Whewell nel 1834, in una sua recensione all’opera di Mary Somerville On the Connexion of the Physical Sciences. Ma la diffusione di questo termine non fu immediata. Infatti, il britannico Lord Kelvin (1824-1907), più di tre decenni dopo, nel 1867, intitolava ancora la propria opera Trattato sulla Filosofia Naturale.

Infine, il termine platonico epistêmê non ha avuto fortuna nei secoli ed è stato reintrodotto come ‘epistemologia’ soltanto a metà dell’Ottocento, a opera dello studioso scozzese James Frederick Ferrier nel suo libro Institutes of Metaphysics (1854), con il significato (però) di teoria della conoscenza (che oggi chiameremmo gnoseologia). Peraltro, il termine epistemologia ha oggi significati un po’ diversi nei paesi anglosassoni e nell’Europa continentale.

Concludendo…

Come si può vedere, da questa breve disamina, la domanda iniziale è destinata a rimanere inevasa.

Se invece adottiamo la strategia costruttivista del boundary work, possiamo dire che la scienza, in quanto istituzione, nasce quando comincia a venire riconosciuta come un campo a sé stante, distinto, e quando gli scienziati cominciano a identificarsi come tali e quindi a rivendicare autorità a partire dalla categoria di scienza. A questo si aggiunga il fatto che oggi si tende a privilegiare una diversa prospettiva, che considera la scienza come un insieme di pratiche (anziché di idee). Per cui le attività dei filosofi della Grecia Antica, così lontane dalle pratiche scientifiche odierne, non sarebbero rubricabili sotto il concetto di ‘scienza’ (Bowler e Morus 2005). L'istituzione della scienza moderna viene invece fatta coincidere con l'emergere di una certa organizzazione istituzionale, di pratiche, di strumenti. In base a questa diversa prospettiva, la scienza avrebbe inizio all'epoca dei lumi, quando il metodo scientifico venne sistematizzato e la scienza istituzionalizzata in organizzazioni come l’Accademia Nazionale dei Lincei di Roma (1603), l’Academie des Sciences di Parigi (1666), La Real Academia de Ciencias y Artes di Barcellona (1764), la Royal Society di Londra (1768) o l’Academia das Ciências di Lisbona (1779).

NOTE

Articolo tratto da: Gobo, G. e Marcheselli, V. (2021), Sociologia della scienza e della tecnologia, Roma: Carocci, pp. 149-151.

BIBLIOGRAFIA

Bowler P. J. e Rhys Morus I. (2005), Making Modern Science. A Historical Survey, University of Chicago Press, Chicago, London.

Popper, K. (1972), Objective Knowledge: An Evolutionary Approach, Oxford University Press, New York (trad. it. Conoscenza Oggettiva, Armando Editore, Roma 1972).

Whitehead A. N. (1920), The Concept of Nature, Cambridge University Press, Cambridge.

Avanti verso il nulla - Sul futurismo nichilista contemporaneo (prima parte)

La nave

ha anche un motore

e avendo un motore

non sa dove va ma continua a andare

(Giorgio Gaber, La nave, 1974)

Cosa diremmo di una persona che, magari a causa di un trauma o di un lutto, vivesse concentrata sul passato e rifiutasse di vivere il presente e fosse del tutto chiusa alla dimensione del futuro? Certo, che non sta bene. Non si può vivere decentemente così. E di una che, specularmente, fosse proiettata esclusivamente verso il futuro e le future realizzazioni, incapace di vivere nel presente, e di tenere in conto a maggior ragione delle esperienze del passato? Anche in questo caso, diremmo che soffrirebbe, che non sarebbe in grado di godere della vita, la quale in fondo è fatta di una serie di momenti presenti. Se fossimo in un contesto di psicologia individuale potremmo parlare nel primo caso di un disagio dovuto a una forma di malinconia, nel secondo a una forma di euforia maniacale.

Spostandoci sul terreno del carattere sociale,[1] abbiamo da una parte un orientamento “passatista”, fissato cioè a un passato ritenuto in quanto tale preferibile e incline, dunque, al misoneismo (al rifiuto cioè di ogni novità), tipico delle società preindustriali; dall’altro un orientamento futuro-centrico, “futurista”, altrettanto nevroticamente fissato all’esaltazione del dileguare di ogni cosa in favore di un “nuovo” in quanto tale certamente migliore. Quest’ultimo è propriamente il carattere dell’epoca che viviamo in particolare nelle società più avanzate, segnate dal predominio dispotico di un potere che è insieme tecnico e capitalistico. Il dogma di oggi dice che «il futuro è il posto migliore»;[2] ed è di tale dogma, non meno contestabile per il fatto di essere… moderno, che si parlerà in questo articolo.

Il documento da cui propongo di prendere le mosse è la fulminante dichiarazione dell’ingegnere informatico Yann LeCun, capo del team di Meta (il nuovo nome di Facebook) che si occupa di intelligenza artificiale, nel corso di un’intervista rilasciata a un quotidiano italiano: «Mi affascina il futuro. Del presente mi interessa capire solo gli sbagli e come superarli».[3] Una frase che può essere considerata un “concentrato” di un più generale modo di rapportarsi alla temporalità che la società attuale suggerisce e impone ogni giorno nel suo «monologo elogiativo» permanente.[4] Il dirigente di Meta, che risponde in questo modo alle caute preoccupazioni espresse dall’intervistatore sulle prospettive dell’IA, com’è chiaro, non dichiara solo di essere affascinato dal futuro, ma di trascurare e disprezzare il presente (del passato naturalmente neppure parla), in quanto – sembra di capire – unicamente luogo di passaggio verso l’unica meta interessante, appunto il futuro. Ma c’è un problema: quella meta, una volta divenuta presente (ogni futuro di oggi è il presente di domani), ricadrà nello stesso disinteresse, in favore del futuro di domani. E in verità una meta non c’è neppure: c’è solo quella che potremmo chiamare una fuga senza fine verso il nulla, o «furia del dileguare» – per usare una espressione hegeliana[5] – per la quale ogni momento presente non vale che in quanto preparazione di un momento futuro, che sarà ovviamente migliore, e così via all’infinito.

Ha osservato il filosofo tedesco-coreano Byung-Chul Han, in un bel libro dedicato alla Scomparsa dei riti, che «oggi al tempo manca una struttura stabile. Non è una casa, bensì un flusso incostante: si riduce a una mera sequenza di presente episodico, precipita in avanti». (La scomparsa dei riti. Una topologia del presente, Milano, Nottetempo, 2021, p. 13).

Si procede, dunque, sempre “avanti” e sempre più rapidamente, in un fenomeno di accelerazione sociale che è oggetto di crescente attenzione da parte delle scienze sociali.[6] In questo illimitato e davvero scriteriato procedere, nessun valore, nessun obiettivo, nessuna condizione desiderabili debbono essere posti, perseguiti, mantenuti; l’unica cosa che conta e che deve esistere, l’unico punto di riferimento per il nostro agire, è il costante flusso delle merci, ma anche delle esperienze, delle tecniche, delle forme di vita:[7] una condizione, dunque, realmente nichilista.

È una dinamica che era stata a suo tempo già individuata da Marx, che pure non si era soffermato sugli esiti nichilistici qui indicati, quando aveva rilevato che «il movimento del capitale è senza misura» (Marx K., Il capitale, libro I, a cura di Delio Cantimori, Roma, Editori Riuniti, 1974, p. 185).

-------------

In questa modalità di rapporto con il tempo, che nasce nel quadro della modernità capitalistica e della sua complessiva rimodulazione dell’esperienza e della vita sociale, accade – secondo quanto sottolineato trent’anni fa da Giacomo Marramao – che «la prospettiva tende progressivamente a fagocitare l’esperienza» (Giacomo Marramao, Minima temporalia. Tempo spazio esperienza, Milano, Il Saggiatore, 1990, p. 108), potendosi parlare di vera e propria «propensione nichilista» (cit. p. 104) della modernità. Mi pare tuttavia evidente che è l’ultima fase della modernità, quella apertasi negli ultimi decenni, a rendere egemone e “totalitaria” tale propensione. E l’accelerazione dell’innovazione tecnologica in molti ambiti, in quello informatico in particolare, ha avuto in questo un ruolo determinante.

Ha osservato a questo proposito Gabriele Balbi, in un notevole recente pamphlet sulla ideologia digitale, che «il tempo storico ideale per la rivoluzione digitale è proprio il futuro, anche perché nel presente viene sempre raccontata come incompleta, come un processo in continua evoluzione, come una trasformazione che non ha né può avere una fine predefinita» (Balbi G., L’ultima ideologia. Breve storia della rivoluzione digitale, Roma-Bari, Laterza, 2022, p. 64-65). Non sorprende, allora, che un recentissimo saggio sulle prospettive dell’applicazione dell’intelligenza artificiale si dichiari in copertina – programmaticamente – una Apologia del futuro (De Biase L, Apologia del futuro. Quello che il domani può fare per noi, Roma, LUISS University Press, 2024).

Il tempo dell’era digitale, in effetti, è proprio un tempo della precarietà e dell’incompletezza, foriero inevitabilmente di ansia e di senso di inadeguatezza, forse proprio di quella «vergogna prometeica» indicata da Günther Anders come il portato principale e perturbante della nostra epoca di dominio della tecnica industriale (fa parte di essa non solo il sentirsi inferiori in potenza alle macchine, ma anche, insieme, il sentirsi troppo lenti rispetto alle velocità macchiniche).[8]

Non mancano del resto alcuni sintomi addirittura clamorosi di tale deriva, se pensiamo per esempio a certi esiti obiettivamente antiumanistici propri di quelle visioni della rivoluzione digitale che si dichiarano post- o transumaniste. Così per esempio Hans Moravec, uno dei profeti del transumanismo, poteva affermare già vent’anni fa, in relazione agli imminenti sviluppi delle nanotecnologie e dell’intelligenza artificiale, con un misto di fatalismo e di entusiasmo: «l’uomo biologico si troverebbe naturalmente spinto fuori dall’esistenza, poiché una specie sopravvive raramente a uno spazio ostile che presenta un grado di evoluzione superiore» (cit. in Paul Virilio, Ce qui arrive, Paris, Éditions Galilée, 2002, tr.it. Milano, Cortina, 2002, p. 19-20).

Al venir meno di ogni valore, di ogni capacità di identificare dei fini razionali nello sviluppo sociale, si accompagna come si vede, in non pochi casi, il rifiuto della umanità stessa. O meglio quella che – se si pensa a certo dibattito oggi molto in voga sull’IA – si potrebbe definire una voglia matta di dimissioni dall’umano.

-------------

In ogni caso, quel che qui mette conto sottolineare è che nella visione attuale dovremmo affidarci con sicurezza all’impersonale flusso delle cose, alle asserite leggi dello sviluppo tecno-scientifico, sicuri che esse siano apportatrici di beneficio generale. Una visione del mondo e della storia non solo falsa, dal momento che postula una natura neutrale e deterministica dello sviluppo tecnologico (come se esso non fosse attraversato dalla storia, dal conflitto degli interessi, dalle dinamiche economiche, da influssi culturali ecc.), ma chiaramente finalizzata a radicare nelle coscienze dei contemporanei un senso di stupido ottimismo e di cieca fiducia verso l’organizzazione sociale presente. Una pedagogia dell’apatia e della passività, in definitiva.

L’adesione a questo “regime di temporalità” implica infatti l’adesione al modello economico e sociale dominante, a quello che un sociologo italiano, Mauro Magatti, ha definito «capitalismo tecno-nichilista», ovvero un modello in cui la razionalità strumentale e l’imperativo del profitto hanno riassorbito senza residui ogni altro criterio.[9] Tale modello, che si forma a partire dall’ultimo quarto del Novecento, prima negli Stati Uniti poi in Europa, non ha più molto a che fare con il vecchio capitalismo “weberiano” (lavoro, disciplina, impegno, attaccamento alla proprietà…), ma è piuttosto un capitalismo del desiderio e della seduzione, nonché della liberazione attraverso la tecnica. Un capitalismo che promette all’individuo una generalizzata libertà (di natura peraltro fantastica e delirante) un po’ da tutto: dal lavoro faticoso, dalla politica, dalle relazioni sociali e sentimentali, ora perfino – nelle tecno-utopie postumaniste, come si vedeva poc’anzi – dalla materia e dalla biologia stesse. Ma navigando in questo insieme di… “liberazioni” da ogni radicamento, è l’umano stesso che abdica a se stesso, l’individuo stesso, apparentemente celebrato, che finisce per precipitare appunto nel nulla.

Sulla dimensione realmente nichilistica del capitalismo contemporaneo (cioè dove per nichilismo non si intende una ideologia o una dottrina, ma appunto una configurazione socio-culturale reale) è intervenuto nei suoi ultimi anni il filosofo Aldo Masullo (1923-2020):

«la condizione del nostro odierno esistere esige non tanto una discussione sull’essenza del nichilismo, quanto un’esplorazione di effettivi stati di nichilismo. (…) Uno dei sintomi è la profonda trasformazione dei nostri rapporti con il tempo. Oggi la velocizzazione dei cambiamenti (travolgente esito tecnologico), l’accelerazione del quotidiano, l’immediatezza del repentino, insomma il dissolversi della durata nel delirio di eventi puntiformi, esaltano l’istantaneo senza ragione e il vuoto del presente».[10]

Particolarmente radicato in ambito scientifico-tecnologico,[11] questo approccio alla temporalità dilaga in realtà in ogni campo della vita odierna (sempre più permeato del resto dalla macchina tecno-scientifica e dalle sue “esigenze”), spingendoci tutti in una dimensione di accelerazione permanente i cui effetti in termini di disagio crescente sono ormai oggetto di un’ampia letteratura sociologica, psicoanalitica, antropologica ecc.,[12] oltre ad essere stati denunciati nella celebre enciclica Laudato si’ di Papa Francesco con parole molto lucide.[13]

-------------

In un piccolo saggio dedicato al concetto di Futuro, Marc Augé ha rimarcato il nesso che nella percezione attuale del futuro ricopre la dimensione (tipica di società industriali avanzate e consumistiche) della “innovazione”: quest’ultima – sosteneva l’antropologo francese scomparso nel 2023 – costituisce un vero e proprio «fatto sociale totale», secondo la celebre definizione di Marcel Mauss, poiché «riguarda simultaneamente tutti gli aspetti della società e fa appello a tutti i suoi attori» (Augé M., Futuro, Torino, Bollati Boringhieri, 2012, p. 81).[14] È insomma un futuro-come-innovazione quello che risulta oggi socialmente egemone, un futuro come costante susseguirsi di novità (proprio come l’industria capitalistica deve perennemente presentare nuove merci, vere o presunte non importa), un futuro meramente quantitativo. Un futuro che – dicono molti osservatori – finisce per farsi fagocitare da se stesso, e dunque un futuro che, paradossalmente, si auto sopprime in favore di un eterno presente (così François Hartog, su cui si tornerà, che parla infatti di «presentismo» per indicare l’attuale «regime di storicità»)[15].

È chiaro che stiamo parlando di quale idea di progresso sia oggi dominante; ovvero di come questa idea, così intimamente legata a tutta la vicenda della modernità occidentale, si configuri nella società industriale avanzata di oggi (o forse dovremmo dire, per essere à la page, società digitale). Se questa furia “futuristica” di cui abbiamo parlato appare oggi così dominante e in sostanza accettata è anche perché il mito del progresso è uno di quelli cui, nel disincantamento generalizzato, ancora crediamo (paradossi del postmodernismo? Forse…). Ma, giunto a questo punto, per non abusare della pazienza del lettore, rimando alla seconda parte di questo articolo. Stay tuned.

NOTE

[1] Uso qui il concetto di “carattere sociale” come inteso tra gli altri da Erich Fromm, per esempio, in Beyond the chains of illusion. My encounter with Marx and Freud (1962), tr.it. Marx e Freud, Milano, il Saggiatore, 1968, p. 75-92. Vedi anche la voce Carattere sociale, in Luciano Gallino, Dizionario di sociologia, Torino, Utet, 2014 (1.ed. 1978), p. 94-96.

[2] Così, dovendo proporre una serie di scritti e discorsi di Barack Obama al termine del suo secondo mandato presidenziale, una grande casa editrice italiana decide di intitolare il volume che li raccoglie: Barack Obama, Il futuro è il posto migliore. Il 44. Presidente degli Stati Uniti in parole sue, prefazione di Walter Veltroni, Milano, Rizzoli ETAS, 2017.

[3] La dichiarazione del manager di Meta si trova in: Pierluigi Pisa, Arriva la nuova IA di Meta. “Imparerà da sola, penserà e proverà emozioni umane”, “la Repubblica”, 14 giugno 2023, p. 32-33.

[4] L’espressione si deve a Guy Debord, nella Società dello spettacolo (1967): «Lo spettacolo è il discorso ininterrotto che l’ordine presente tiene su se stesso, il suo monologo elogiativo» (Guy Debord, La società dello spettacolo, in Id., La società dello spettacolo. Commentari sulla società dello spettacolo, introduzione di Carlo Freccero e Daniela Strumia, Milano, Baldini & Castoldi, 2019, p. 71-72).

[5] Il concetto di «furia del dileguare» [die Furie des Verschwindens], coniato da Hegel nella Fenomenologia dello spirito (Cfr. G.W.F. Hegel, Fenomenologia dello spirito, vol. II, trad. di Enrico De Negri, Firenze, La Nuova Italia, 1963, p. 129) con riferimento agli esiti utopistico-estremistici della Rivoluzione francese (dove alla «libertà assoluta» non resta che «l’operare negativo» che non s’acquieta mai, producendo catastrofi politiche), viene qui adottato per indicare la pulsione intima dell’Occidente capitalistico, che lo spinge (ci spinge) ad operare solo in senso negativo e dissolvente, senza alcun costrutto sensato ed equilibrato.

[6] Mi limito qui a citare Hartmut Rosa, Accelerazione e alienazione. Per una teoria critica del tempo nella tarda modernità, Torino, Einaudi, 2015.

[7] Osservava David Harvey, in un saggio ormai di riferimento su questi temi, The condition of postmodernity (1990): «La dinamica di una società “usa e getta”, come l’hanno definita scrittori come Alvin Toffler, cominciò a diventare evidente durante gli anni Sessanta. Significava qualcosa di più del semplice buttar via una cera quantità di prodotti (…); significava buttar via valori, stili di vita, relazioni stabili, e l’attaccamento alle cose, agli edifici, ai luoghi, alle persone, ai modi ereditati di fare ed essere» (David Harvey, La crisi della modernità, Milano, il Saggiatore, 1993, p. 349).

[8] Cfr. Günther Anders, L’uomo è antiquato.1. Considerazioni sull’anima nell’epoca della seconda rivoluzione industriale, Torino, Bollati Boringhieri, 2003, p. 37-120.

[9] Cfr. Magatti M., Libertà immaginaria. Le illusioni del capitalismo tecno-nichilista, Milano, Feltrinelli, 2009.

[10] Nell’intervista il grande filosofo italiano riassumeva le tesi del suo Stati di nichilismo, Roma-Napoli, Paparo, 2016.

Ricordiamo che, nella filosofia italiana contemporanea, sostenitori della tesi del nichilismo come condizione storico-sociale del modo di produzione capitalistico sono stati Costanzo Preve, in particolare in Il convitato di pietra. Saggio su marxismo e nichilismo (Milano, Vangelista, 1991), e Massimo Bontempelli, La conoscenza del bene e del male, Pistoia, CRT, 1998.

[11] Giampietro Gobo ha sottolineato di recente su questo blog come l’accelerazione sociale dominante sia dannosa per la stessa attività scientifica: cfr. Giampietro Gobo, Quando la pazienza è più produttiva della fretta. Sull’esistenza di un nuovo pianeta, “Controversie”, 07/05/2024,

[12] Cfr. Hartmut Rosa, Accelerazione e alienazione, cit.

[13] «La continua accelerazione dei cambiamenti dell’umanità e del pianeta si unisce oggi all’intensificazione dei ritmi di vita e di lavoro, in quella che in spagnolo alcuni chiamano “rapidación” (rapidizzazione). Benché il cambiamento faccia parte della dinamica dei sistemi complessi, la velocità che le azioni umane gli impongono oggi contrasta con la naturale lentezza dell’evoluzione biologica» (Papa Francesco, Laudato si’. Lettera enciclica sulla cura della casa comune, commenti di Bruno Bignami, Luis Infanti de la Mora, Vittorio Prodi, Bologna, Edizioni Dehoniane, 2015, p. 19).

[14] Nelle società attuali – osserva ancora Augé – «potremmo dire che ormai siamo capaci di definire il nostro rapporto con lo spazio e il tempo, cioè con l’elemento essenziale dell’attività simbolica che definisce l’essenza dell’uomo e dell’umanità, solo attraverso artefatti messi a punto dall’industria e fatti circolare su mercato» (ivi, p. 78).

[15] Cfr. François Hartog, Regimi di storicità. Presentismo e esperienze del tempo, Palermo, Sellerio, 2007.

FAO, alimentazione e emissioni di CO2 - Una controversia e un conflitto di interessi?

24/06/2024Animali,Ambiente e Ecologie,Politica

COS’È LA FAO

La FAO – Food and Agriculture Organization – è «un’agenzia specializzata delle Nazioni Unite che guida gli impegni internazionali mirati a sconfiggere la fame». Il suo obiettivo dichiarato è «raggiungere la sicurezza alimentare per tutti e assicurare alle persone l’accesso regolare a quantità sufficienti di cibo di elevata qualità, al fine di condurre vite sane e attive»[1].

Questa missione, dichiarata nella sezione “About us” del sito, dice una serie di cose importanti per la controversia che stiamo esaminando: la FAO è un’agenzia delle Nazioni Unite; agisce per garantire a tutti (paesi e popolazioni) accesso a quantità sufficienti di cibo; il cibo deve essere di elevata qualità; in ultimo, il cibo sembra essere funzionale all’obiettivo di condurre una vita sana ed attiva.

TEMA, ATTORI E POSIZIONI DELLA CONTROVERSIA

La controversia verte su quanto potrebbe contribuire la diminuzione del consumo di carne – in particolare di carne bovina[2] – sul contenimento delle emissioni di CO2 nell’atmosfera e, di conseguenza, sull’effetto serra nei prossimi 25 anni.

Da tempo si parla del fatto che gli allevamenti (intensivi) di bestiame, in particolare di bovini destinati al macello per la produzione di carne a uso alimentare umano[3], sono una fonte rilevante – il 12% del totale[4] – delle emissioni di CO2 e di “gas serra” nell’atmosfera.

La riduzione delle emissioni legate agli allevamenti intensivi è una tematica ricorrente nella narrazione giornalistica e si intreccia con l’istanza animalista sulle condizioni e le sofferenze imposte a bovini, ovini e suini e con quella ambientalista sui gas serra.

La questione coinvolge anche la disponibilità di alimentazione proteica a basso costo per le fasce di popolazione meno ricche e il tema delle tradizioni culturali alimentari.[5]

Gli attori sono di questa disputa sono, da una parte la FAO e il suo rapporto “Pathways towards lower emissions. A global assessment of the greenhouse gas emissions and mitigation options from livestock agrifood systems” presentato alla conferenza ONU sul clima, la COP28 di Dubai; dall’altra parte, due fisici che studiano l’impatto di varie attività umane sull’ambiente: Paul Behrens e Matthew Hayek, tra gli autori degli studi scientifici citati nel rapporto della stessa FAO.

Il rapporto Pathway towards lower emission realizzato dalla FAO stima la riduzione delle emissioni di CO2 che si può ottenere con una serie di interventi sulle pratiche di allevamento e alimentari. L’efficacia stimata per ciascuno di questi interventi è la guida per definirne rilevanza e priorità.

Prime, per efficacia stimata e per priorità di attuazione, ci sono due linee di intervento sulle modalità di allevamento degli animali da carne:

- la prima linea suggerisce di incrementare la produttività degli allevamenti;

- la seconda linea propone di migliorare l’alimentazione e lo stato di salute degli animali negli allevamenti.

Quali sono i razionali e gli effetti attesi di queste misure di contenimento delle emissioni?

La prima linea, quella della produttività, è legata in modo diretto alla previsione di aumento della popolazione mondiale (+ 20% nei prossimi 25 anni) e proietta un aumento proporzionale di produzione animale necessario a soddisfare la domanda di carne e latticini. Grazie all’aumento di produttività, la FAO stima un possibile minore incremento di emissioni pari al 30%.

Per inciso, il rapporto FAO - fatto salvo per la riduzione dell’età di macellazione degli animali, che favorirebbe un migliore rapporto tra costi di produzione, volumi di prodotto (carne, peso dell’animale ucciso) e emissioni di gas - non suggerisce specifici modi per migliorare la produttività ma parla soltanto di “enhanced efficiency at every production stage along the supply chain” e “adoption of best practices”.

La seconda linea di intervento, relativa all’alimentazione e al benessere degli animali negli allevamenti, potrebbe migliorare i risultati della prima misura per varie ragioni: una alimentazione con cibi più calorici, meno grassi e più oli essenziali può far crescere prima e meglio gli animali; alimenti tannici possono ridurre la quantità di gas nella fase di ruminazione; in generale, una alimentazione “più sana” può far diminuire il tasso di mortalità degli animali e, nello stesso tempo, aumentare il tasso di crescita.

La FAO considera di minore rilevanza, in termini di effetti e di priorità, le misure relative al cambiamento delle abitudini alimentari, al consumo più responsabile e alla conseguente minore domanda di carne per uso alimentare, quali:

- cambiare le abitudini alimentari, in particolare ridurre il consumo di carne, seguendo le indicazioni governative, con un effetto di contenimento delle emissioni tra il 2% e il 5%[6];

- ridurre gli sprechi dei generi alimentari nella parte finale della filiera[7], dalla vendita al consumo, con un effetto di contenimento tra il 3% e il 6%.

Ecco, il tema del cambiamento delle abitudini alimentari è il centro della controversia.

Behrens e Hayek sostengono, infatti, in una lettera indirizzata al Direttore della Divisione Produzione Animale e Salute della FAO, che il rapporto FAO ha distorto e mal utilizzato una serie di informazioni, sottostimando l’effetto di riduzione delle emissioni associato alla riduzione del consumo di carne.

In particolare, i due scienziati, denunciano che:

- la FAO ha usato un loro studio del 2007 mentre altri studi più recenti – loro e di altri autori – disegnano uno scenario diverso e più favorevole alla riduzione del consumo di carne;

- l’effetto del cambiamento alimentare è calcolato sulla base di raccomandazioni nazionali (NDR - National Dietary Recommendations) obsolete; quelle più aggiornate raccomandano quantità di carne e di latticini molto minori;

- il rapporto contiene una serie di errori sistematici che portano a sottostimare gli effetti del cambio di dieta, tra i quali: l’utilizzo dei massimi di scala per gli NDR, la comparazione di grandezze difficilmente commensurabili, il raddoppio dei valori di emissioni al 2025, l’uso di un mix incongruente di anni di confronto;

- infine, che il rapporto FAO non prende in considerazione le linee guida più aggiornate sulle diete sostenibili e salutari raccolte – ad esempio – nell’autorevole e recente studio EAT – Lancet del 2019

Sulla base di queste considerazioni, Berhens e Hayek sostengono che il minore consumo di carne avrebbe effetti strutturali e decisamente superiori a quanto stimato dalla FAO, ponendosi in controtendenza rispetto alla strategia di inseguire una crescita della domanda di carne proporzionale all’aumento della popolazione.

Alla lettera con cui chiedono di rivedere il rapporto, la FAO ha – responsabilmente, va detto – replicato che il rapporto è stato sottoposto a peer-reviewing in doppio cieco e che, quindi, va ritenuto affidabile, ma si impegna a indagare sulle questioni sollevate e a confrontarsi con Berhens e Hayek su metodo e merito.

Nel frattempo, però, il rapporto della FAO è stato utilizzato nella conferenza sul clima COP28.

CONCLUSIONI

Ora, aspettando di vedere cosa succederà, viene da chiedersi quanto la FAO sia un soggetto indicato per definire strategie, linee guida e priorità per le misure di contenimento della CO2 nell’atmosfera, seppure se correlate all’alimentazione; la domanda si pone perché alcune misure di contenimento possono essere in parziale conflitto con gli obiettivi della FAO.

Sembrano emergere, infatti, almeno quattro ordini di problemi:

- La FAO ha la missione di garantire, qui e ora, che tutti abbiano cibo di elevata qualità e abbondante; un cambiamento radicale degli schemi produttivi e alimentari, basati – ad esempio – su una rapida riduzione degli allevamenti intensivi e su un deciso allontanamento dall’alimentazione carnea può essere in conflitto con la missione della FAO, per due ragioni: la prima è la necessità di sostituire – in tempi altrettanto serrati – carne e latticini a basso costo con prodotti vegetali di qualità e altrettanto reperibili; la seconda è la necessità di riassestamento economico e occupazionale del settore e dei paesi produttori di carni meno ricchi, che richiederebbe un sostegno organizzato a livello sovranazionale;

- la missione della FAO è centrata sulla nozione di “cibo di alta qualità”, nozione che è socialmente costruita e per lo più rappresentata da cibi a elevato contenuto proteico di origine animale, carne e latticini[8] (meglio se a basso prezzo); una svolta verso la diminuzione di questi cibi è certamente in conflitto con la nozione di “alta qualità” della FAO e richiede anche un cambiamento culturale rilevante;

- la natura della FAO – emanazione dell’UN e controllata da 143 paesi, tra i quali alcuni grandissimi produttori di carne bovina in allevamenti intensivi – richiede di tenere conto del possibile conflitto di interessi tra le misure di riduzione del consumo di carne e i paesi produttori;

- l’ultimo tema che emerge è la possibile competizione tra l’istanza morale di una migliore e più abbondante disponibilità di cibo e quella di salvaguardia dell’ambiente a cui fa capo il contenimento delle emissioni di CO2; chi decide di queste due istanze ha la priorità?

Senza nulla togliere al suo compito insostituibile, la FAO non dovrebbe, però, essere soggetto normativo su come ridurre le emissioni, ma occuparsi di mettere in atto, senza effetti negativi sul benessere di tutti, le misure più efficaci di contenimento delle emissioni decise da organismi dedicati a questo e confrontarsi con questi sulla maggiore o minore priorità dell’istanza alimentare versus quella ambientale.