L'argomento fantoccio (dall'inglese straw man argument o straw man fallacy) è una fallacia logica che consiste nel confutare un argomento, proponendone una rappresentazione errata, distorta o addirittura ridicola.

Senza tentar di scrivere nulla di originale, possiamo affidarci al relativo articolo di Wikipedia, che recita:

«

in una discussione una persona sostituisce all'argomento A un nuovo argomento B, in apparenza simile. In questo modo la discussione si sposta sull'argomento B. Così l'argomento A non viene affrontato. Ma l'argomento B è fittizio: è stato costruito espressamente per mettere in difficoltà l'interlocutore (ecco perché “fantoccio”). Se l'operazione retorica riesce sembrerà che l'avversario sia riuscito a smontare l'argomento A. Tutto sta nel far sembrare che A e B coincidano.

L'argomento fantoccio è generalmente un argomento più debole di quello iniziale e per questa ragione più facile da contestare.

L'argomento può essere costruito:

-

- estremizzando l'argomento iniziale;

- citando fuori contesto parti dell'argomento iniziale;

- inserendo nella discussione una persona che difenda debolmente l'argomento iniziale e confutando la difesa più debole dando l'impressione che anche l'argomento iniziale sia stato confutato;

- citando casi-limite dal forte impatto emotivo;

- citando eventi avvenuti sporadicamente e/o accidentalmente e presentandoli come se fossero la prassi;

- forzando analogie fra argomenti solo apparentemente collegati tra loro;

- semplificando eccessivamente l'argomento iniziale;

- inventando una persona fittizia che abbia idee o convinzioni facilmente criticabili facendo credere che il difensore dell'argomento iniziale condivida le opinioni della persona fittizia.

Esempi

A un argomento fantoccio si può fare riferimento per deviare una discussione nel corso di un dibattito.

-

- A: Il proibizionismo non è lo strumento migliore per evitare il diffondersi dell'alcolismo.

- B: Soltanto persone senza un'etica potrebbero proporre di consentire a tutti, compresi i minori, un accesso indiscriminato all'alcool.

La persona A non aveva proposto di offrire un accesso indiscriminato all'alcool, ma di tentare un approccio diverso da quello basato solo sulla proibizione e la repressione. La fallacia sta nell'estremizzare la posizione adottata da A fino a trasformarla in qualcosa di diverso da ciò che A intendeva dire e di molto più attaccabile nella discussione.

-

- A: Bisognerebbe ridurre gli investimenti in campo militare e aumentare gli investimenti nella ricerca.

- B: A vuole lasciarci indifesi contro i nemici.

La persona B ha estremizzato l'argomento della persona A che parlava di ridurre, non eliminare, gli investimenti in campo militare.

»

Questa lunga citazione ben introduce il terrapiattismo come argomento fantoccio per delegittimare la critica sociale.

Molti giornalisti, filosofi, sociologi, politologi e psicologi (nelle loro argomentazioni) amano inserire nella categoria dei complottisti un guazzabuglio di soggetti: no-vax, vegani, no-TAV, negazionisti climatici, 5G, antivivisezionisti, biodinamici, omeopati ecc. e terrappiattisti. Che cosa abbiano in comune queste persone non è dato saperlo, però il minestrone è sempre un piatto (intellettualmente) povero che sfama tutti.

Un fenomeno irrisorio

Ebbene, se tutti gli altri soggetti hanno al loro interno scienziati (anche di grande qualità e, a volte, anche più famosi di quelli che li denigrano), non mi risulta esistano scienziati terrapiattisti.

Se tornate su Wikipedia, dove si parla della Flat Earth Society (“Associazione della Terra Piatta”), nata in Inghilterra, che sostiene il mito della "Terra piatta" e che conta membri (quanti?) sparsi in tutto il mondo, non troverete un solo scienziato. Così anche in Italia.

Inoltre, chi il 24 novembre 2017 è andato (in un hotel della periferia milanese) al convegno dei terrapiattisti italiani, ha affermato che in sala «erano presenti 40-50 persone: togliendo relatori, giornalisti e curiosi, i terrapiattisti convinti tra il pubblico erano forse una ventina. Non molti, considerando che siamo in una grande città».

“Nel 2018, Le Iene e Vice Italia si spingono in un ristorante di Agerola, in provincia di Napoli per assistere a un convegno nazionale di terrapiattisti e contano meno di cinquanta persone. L’anno seguente, Wired e lo youtuber Barbascura li raggiungono in un hotel di Palermo: rilevano la stessa affluenza e sono entrambi convinti che almeno la metà dei presenti sia lì per ridere o contestare” (Lolli 2023, Il complottismo non esiste o Miseria dell’anticomplottismo, pp.240-1).

Sempre Alessandro Lolli racconta anche che nel 2021 il Censis fece una ricerca da cui risultava che il 5,8% della popolazione italiana (cioè circa 3.400.000) era terrapiattista. Un numero enorme. Significa che ogni 100 persone che conosciamo, 6 sono terrappiattisti. E siccome io non ne ho mai incontrato uno, il mio collega (certamente un complottista) ne conosce 12.

Ma dove stanno tutti ‘sti terrapiattisti? Tutti nascosti? Ma al Censis non è sorto il dubbio che gli intervistati forse lo stavano prendendo in giro (perculà dicono a Roma)?

In conclusione, di che cosa stiamo parlando? Del (quasi) nulla.

Perché, allora, si dà grande spazio (sui mass media e in accademia) a questo fenomeno praticamente inesistente? Scomodando nientepopodimeno che il fisico Luciano Maiani (ex direttore del Cern a Ginevra e del Cnr a Roma, professore di Fisica Teorica alla Sapienza di Roma, socio linceo), che scrive addirittura una lettera a un terrapiattista.

Con tutte le cose importanti da fare, proprio dei terrapiattisti ci si deve occupare?

E perché mescolarli con un fenomeno di critica scientifica e sociale ben più consistente (sia numericamente che qualitativamente)?

Cui prodest? avrebbero detto gli antichi latini… loro sì convinti terrapiattisti.

Il complottismo degli anti-complottisti. Le trappole mentali dei debunkers

Da quasi un decennio i temi della post-verità, delle fake-news e delle teorie del complotto sono diventati un’ossessione non solo per i giornalisti, ma anche per gli accademici. Per alcuni sociologi, psicologi, filosofi ecc. sembra che tutti i mali del mondo vengano dai cospirazionisti, persone malate, irrazionali e anti-scientifiche, carbonari dei nostri giorni, che passano il loro tempo a fornicare sui social media, a costruire ad arte notizie false per poi diffonderle.

Un po’ di casi storici

Poi dopo qualche decennio si scopre, ad esempio, che il super testato dietilstilbestrolo (una specie di estrogeno prescritto tra il 1938-1971 per prevenire l'aborto spontaneo) causa centinaia di casi di adenocarcinoma (un tumore, solito insorgere mediamente intorno ai 17 anni) in donne nate (chiamate poi figlie DES) da madri che l’avevano assunto. Oppure che il super testato talidomìde, prescritto in particolar modo alle donne in gravidanza, provoca migliaia di nascituri con deformazioni (es. focomèlia); o, più recentemente (2004), che il super testato Vioxx, “un farmaco per l’artrite, largamente prescritto, fu scoperto aumentare il rischio di infarto e ictus, soltanto dopo esser stato sul mercato per cinque anni” (Conis, 2015: 233).

Per fare un altro esempio, ricordo che Albert Sabin, medico e virologo (inventore di uno dei due vaccini contro la polio), almeno sin dal 1980 (fino al 1993, anno della sua morte), manifestò più volte, mediante interviste stampa e TV, diverse perplessità su alcuni vaccini, sui vaccini antinfluenzali e sulle politiche vaccinali, anche italiane, come quella dell’obbligatorietà del vaccino antiepatite B, come ebbe a dire il 4 dicembre 1991 a RAI 3: «A mio giudizio si tratta di un errore grossolano e sono certo che il ministro della Sanità è stato molto mal consigliato. In realtà in Italia oltre l’80% di casi si verificano tra i tossicodipendenti che fanno uso di siringhe infette o che non cambiano siringhe (…) Affrontando questi aspetti del problema si otterrebbero risultati migliori di quelli garantiti dalla vaccinazione obbligatoria previsti dalla legge appena approvata...». Quel “mal consigliato” fu più chiaro vent’anni dopo, quando la magistratura accertò (con sentenza definitiva nel 2012) che l’allora ministro, il medico e liberale De Lorenzo, nel febbraio 1991 aveva ricevuto una tangente di 600 milioni di lire dalla Smith Kline Beechm (Glaxo), l’azienda produttrice proprio del vaccino Engerix B. Non risulta che De Lorenzo sia stato poi radiato dall’ordine dei medici.

Proprio quest’ultimo episodio ci insegna che i sociologi, psicologi, filosofi così ferventemente anti-complottismi dovrebbero avere un atteggiamento meno manicheo e più laico, aperto e tollerante.

Perché i complottismi di oggi potrebbero (ripeto cento volte ‘potrebbero’) essere le verità di domani.

In altre parole, un approccio cauto e “storico” non farebbe male. Come suggeriscono diversi autori (Di Piazza, Piazza e Serra 2018, Veltri e Di Caterino 2017, Cuono 2018, Lorusso 2018, Adinolfi 2019, Gerbaudo 2019, Ottonelli 2019) che hanno individuato diversi limiti epistemologici, descrittivi, normativi e strategici del concetto di post-verità.

Un caso per tutti è quello dell’amianto (ma si potrebbe parlare del tabacco, del DDT, dei coloranti per le bevande ecc.). Un minerale naturale conosciuto e usato sin dall'antichità e fino all'epoca moderna, per gli scopi più disparati: da magici e rituali fino a quelli industriali. In Italia il suo uso è proibito solo dal 1992. Ma “risale agli inizi del ’900 il primo processo in Italia (in Piemonte) nel quale venne condannato il titolare di un’azienda che lavorava amianto perché la pericolosità del minerale era stata ritenuta circostanza di conoscenza comune. La prima nazione al mondo a riconoscere la natura cancerogena dell'amianto, dimostrandone il rapporto diretto tra utilizzo e tumori e a prevedere un risarcimento per i lavoratori danneggiati, fu la Germania nazista nel 1943”[1]. Ma si sa: i nazisti facevano propaganda.

Patologizzare la critica sociale, comprimere il dissenso

Dal punto di vista scientifico, ‘complottismo’[2] è un termine che richiama un concetto con uno statuto epistemologico molto incerto e controverso. Tant’è che risulta essere un termine molto carico politicamente. Infatti secondo l’antropologo Didier Fassin (2021) esiste una tendenza crescente, nelle scienze umane, ad assimilare la critica sociale al pensiero cospirativo, utilizzando il secondo per delegittimare la prima. Per cui, mediante questo termine, abbiamo un inquinamento della sfera pubblica e un disincentivo alla partecipazione.

Allo stesso modo, il politologo greco Yannis Stavrakakis, parlando di ‘populismo’, argomentava che che è una categoria, più che descrittiva, normativa, e di conseguenza ‘performativa’, nel senso che è una costruzione di coloro che governano (gli anti-populisti) per imporre i loro “regimi di verità”, come li chiamava Michel Foucault (un autore che gli studiosi anti-complottisti sembrano aver dimenticato).

A tal fine, il filosofo della scienza Paul Feyerabend (1975), a cui il dibattito sul complottismo avrebbe probabilmente fatto ridere, diceva che “nella scienza occorre dar voce a tutti, anche ai punti di vista che in quel momento possono sembrare errati”. E continuava “è opportuno conservare tutte le teorie, anche quelle che nel corso del tempo sono state scartate, perché è sempre possibile che tornino attuali”, perché ogni teoria non è mai sviscerata in tutti i suoi aspetti: la deriva dei continenti, un tempo ritenuta una teoria pseudoscientifica, è oggi parte integrante del patrimonio scientifico, soprattutto dopo la scoperta delle prove paleomagnetiche che sostengono il concetto di tettonica a zolle. Anche l'evoluzione della specie o l'eliocentrismo furono inizialmente sottoposte a feroci critiche scientifiche.

E la filosofa femminista Sandra Harding sosteneva che “anche le scienze naturali (es. fisica e chimica), e non solo le scienze umane (es. sociologia e antropologia), sono influenzate anche dalle credenze e opinioni personali degli scienziati”.

Le trappole mentali dei debunkers e fact checkers

Sembrerebbe che solo i complottisti ragionino in modo surreale. Ed è compito dei debunkers e fact checkers, i Roland Freisler o gli Andrej Vyšinskij del XXI secolo, scoprire l’infondatezza di quelle che poi saranno definite fake news.

C’è però un particolare. Inquietante. I debunkers sono strabici: fanno il pelo sempre ai critici dello status quo, e quasi mai ai governanti o coloro che gestiscono il sistema dell’informazione. Per cui operano all’interno dei “regimi di verità” e dei “regimi di discorso”.

Altrimenti avrebbero indagato e scoperto l’infondatezza (per fare uno degli esempi più clamorosi) delle dichiarazione del Segretario di Stato americano, Colin Powell, che il 5 febbraio 2003 all’assemblea generale dell’ONU aveva mostrato le fotografie di laboratori mobili (si scoprì poi che erano dei modellini) di costruzione di armi biologiche (le famose armi di “distruzione di massa”) e avrebbero guardato cosa conteneva (talco anziché antrace) quella fialetta esibita teatralmente durante il suo discorso.

In altre parole, i debunkers e gli anti-complottisti soffrono delle stesse trappole mentali dei cosiddetti complottisti. Essi cadono nel fenomeno della “reazione all’oggetto” (Cacciola e Marradi 1988), fenomeno socio-cognitivo-emotivo, per cui nel dare un giudizio su una notizia si guarda alla fonte PRIMA che al contenuto. Per cui se la fonte è un’istituzione rispettata, allora le sue notizie non possono essere che vere (così successe per Colin Powell, mentre Saddam Hussein faceva propaganda). E’ viceversa.

Ma il contenuto della notizia non viene quasi mai esaminato senza preconcetti.

In conclusione, anti-complottisti “di terra, di mare e dell'aria”… datevi una calmata.

NOTE E BIBLIOGRAFIA

[1] https://www.inail.it/cs/internet/docs/dossier_storia_amianto-pdf.pdf

[2] Un tempo si chiamava “dietrologia” (vedi https://www.ilpost.it/2024/02/08/sgobba-quando-il-complottismo-si-chiamava-dietrologia/)

Adinolfi, M. (2019). Hanno tutti ragione? Post-verità, fake news, big data e democrazia. Roma: Salerno Editrice.

Cacciola Salvatore e Marradi Alberto (1988), Contributo al dibattito sulle scale Likert basato sull’analisi di interviste registrate, in Marradi (a cura di), Costruire il dato, Milano: Angeli, 63-105.

Conis, Elena (2015), Vaccine Nation. America’s Changing Relationship with Immunization, Chicago: University of Chicago Press.

Cuono, M. (2018). “Post-verità o post-ideologia: un problema politico,online e offline”. In Web e società democratica: un matrimonio difficile, a cura di E. Vitale and F. Cattaneo, 66–82. Torino: Accademia University Press.

Di Piazza, S., Piazza, F., and Serra, M. (2018). “Retorica e post-verità: una tesi controcorrente”. Siculorum Gymnasium 71 (4): 183–205.

Fassin, Didier (2021) Of Plots and Men. The Heuristics of Conspiracy theories,in Current Anthropology, 62(2), pp. 128-137.

Feyerabend, Paul K. (1975) Against Method, Londra: Verso Book. Trad. It. Contro il Metodo. Milano: Feltrinelli, 1979.

Gerbaudo, P. (2019). “Una falsità scomoda: fake news e crisi di autorità”. In Fake news, post-verità e politica, edited by G. Bistagnino and C. Fumagalli, 74–91. Milano: Fondazione Giangiacomo, Feltrinelli.

Harding, Sandra (1993). “Rethinking Standpoint Epistemology: What is Strong Objectivity” Feminist Epistemologies (a cura di) Alcoff L., Potter E., New York e Londra: Routledge.

Lorusso, A. M. (2018). Postverità: fra reality tv, social media e storytelling. Bari: Laterza.

Ottonelli, V. (2019). “Disinformazione e democrazia. Che cosa c’è di fake nelle fake news?”. In Fake news, post-verità e politica, a cura di G. Bistagnino and C. Fumagalli, 92–115. Milano: Fondazione Giangiacomo Feltrinelli.

Stavrakakis, Y. (2017). “How did ‘populism’ become a pejorative concept? And why is this important today? A genealogy of double hermeneutics”. POPULISMUS Working Papers 6.

http://www.populismus.gr/wp-content/uploads/2017/04/stavrakakis-populismus-wp-6-upload.pdf

Veltri, G. A., and Di Caterino, G. (2017). Fuori dalla bolla: politica e vita quotidiana nell’era della post-verità. Sesto San Giovanni: Mimesis.

Monopattini elettrici e numeri maltrattati – Strumentalizzare le statistiche

A metà agosto dell’anno scorso, in vacanza in un paesello di montagna, sono caduto con la bicicletta e mi sono rotto un paio di ossa, finendo al pronto soccorso.

Sulla base delle frequenze di incidenti rilevate, un ipotetico giornale locale avrebbe potuto titolare così la pagina della cronaca del giorno dopo: ”Sempre più numerosi gli incidenti gravi ai ciclisti nel paese di Vattelapesca”

--------

Nulla di falso in questo titolo: la vittima dell’incidente è un ciclista; l’agosto precedente scorso non c’erano stati incidenti ai danni di ciclisti; grave è grave, mi è costato ricovero e intervento.

Il cronista avrebbe potuto anche scrivere, che gli incidenti in bicicletta, in agosto, a Vattelapesca: “Si moltiplicano”, “Crescono in maniera esponenziale”, tutto senza allontanarsi di un passo dalla verità.

Ora, è evidente che questa presentazione della questione – pur corretta dal punto di vista del rapporto con la realtà – rischia di essere drammatica e fuorviante.

--------

Cambiamo scenario: il 12 ottobre 2023, un telegiornale a diffusione nazionale titola un servizio: “Sempre più pericolosi i monopattini elettrici, incremento del 78% degli incidenti mortali”.

Lo spunto per il servizio – che si focalizza sulla pericolosità dei monopattini elettrici – è la morte di una ragazza che è stata travolta, a Trento, mentre attraversava la strada con il suo monopattino; non era ancora noto se fosse a bordo del monopattino oppure se lo stesse spingendo a mano.

È normale, nella pratica giornalistica, utilizzare un evento puntuale come pretesto per introdurre un articolo che parla di fenomeni generali, niente da dire. È il caso, tuttavia, di esaminare qualche aspetto del fenomeno generale di cui parla questo servizio:

- L’incremento del 78% di cui si parla è un dato relativo al 2022, rispetto al 2021

- Gli incidenti mortali con il monopattino nel 2022 sono stati, in valore assoluto, 16

- Nel 2023, fino al 12 ottobre, il numero di incidenti mortali con il monopattino più attendibile è 15 (la ragazza di Trento è la quindicesima).

Sembrerebbe, quindi, che il numero assoluto, nel 2023,di incidenti mortali con il monopattino fosse in calo rispetto al 2022.

Andiamo avanti: se esaminiamo la fonte, che supponiamo attendibile (Aci-Istat), gli incidenti mortali simili nel 2021 sono stati 10 (9 conducenti e un pedone), quindi l’incremento nel 2022 scende al 60%.

Cos’è, quindi questo 60%? Potrebbe trattarsi dell’incremento di incidenti gravi, non solo di quelli mortali. Una sorta di metonimia? No, si tratta di una lettura riduttiva dei dati del 2021, che non conta un pedone investito ma solo i conducenti.

Con un minimo ancora di approfondimento, scopriamo che il servizio tace sul “denominatore nascosto” del fenomeno degli incidenti: il numero di monopattini elettrici circolanti e il suo incremento negli anni di cui si parla.

Non si trovano facilmente dati sull’incremento tra 2021 e 2022 dei mezzi di proprietà ma sicuramente i noleggi di monopattini elettrici è aumentato di circa il 50%.

Tra 2022 e 2023, invece, ci sono fonti che parlano di un aumento del 140% dei monopattini privati e di più del 100% dei noleggi.

In proporzione ai monopattini circolanti, è plausibile che l’incidenza di incidenti sia diminuita nel 2022 e c’è l’evidenza di una riduzione del 50% nel 2023.

Addirittura, secondo l’Osservatorio Nazionale sulla Sharing Mobility, tra il 2021 e il 2022, il rapporto tra incidenti, numero di monopattini e chilometri percorsi è calato dell’80%.

Il quadro che si scorge approfondendo le cifre è, quindi, decisamente diverso.

Eppure, questa percentuale drammatica del 78% di incidenti mortali in più fornisce al servizio – e ai numerosissimi altri articoli di stampa che in quei giorni ne ricalcano i contenuti – il carattere di affidabilità scientifica: sono numeri, sono percentuali, sono calcoli scientifici, legittimano le affermazioni e le conclusioni.

E distorcono irrimediabilmente la realtà. Perché?

Ecco perché: ad ottobre 2023 è iniziata la discussione parlamentare delle nuove misure di legge che riguardano i mezzi di cui parliamo: obbligo di targa e di assicurazione, obbligo del casco, dotazione di freni anteriore e posteriore indipendenti, frecce, limiti di velocità e regole di parcheggio; oggi, parte di queste misure diventa legge.

La vera notizia d’agenzia da lanciare era, quindi, la legge - che è diventata esecutiva in questi giorni - la cui legittimazione doveva passare attraverso un percorso di drammaticità: quello dell’incremento degli incidenti.

Questa vicenda mette in luce come si possono facilmente maltrattare i numeri e farli diventare “dati scientifici” con risultati distorti, secondo regole di rilevanza sociale.

P.S.: Il quotidiano locale della zona dove sono caduto l’agosto scorso non ha parlato del mio infortunio, né delle statistiche sugli incidenti ciclistici. Il Sindaco del paesello non aveva in programma, me l’ha assicurato di persona, nessuna nuova legge comunale sulle mountain bike.

RIFERIMENTI PER I DATI:

- ACI – ISTAT, report incidenti stradali 2022

- Osservatorio sulla Sharing Mobility

- EMG Mobility, 13 Febbraio 2023

- Wired 22.05.2023

Un nuovo francescano? - Paolo Benanti e la commissione algoritmi

Il professore Paolo Benanti è stato nominato Presidente della Commissione sull’Intelligenza Artificiale per l’Informazione e l’Editoria della Presidenza del Consiglio.

La Commissione è un organo del Dipartimento per l’Informazione e l’Editoria istituito dalla Presidenza del Consiglio poco più di due mesi fa, con lo scopo di analizzare le implicazioni dell’Intelligenza Artificiale nel campo dell’editoria e dell’informazione e, di conseguenza, consigliare il Dipartimento che ne è responsabile. La commissione è stata presieduta - dalla fondazione sino alle sue dimissioni - dal professor Giuliano Amato, politico, giurista, docente universitario e manager pubblico.

La nomina di Giuliano Amato aveva sorpreso molti; l’assegnazione della presidenza a Paolo Benanti forse anche di più.

Paolo Benanti ha un curriculum eccellente e si può dire - senza timore di smentita - che è uno dei massimi esperti mondiali di Intelligenza Artificiale; è un frate Francescano del Terzo Ordine Regolare, teologo, eticista, docente presso la Pontificia Università Gregoriana, consigliere di Papa Francesco per l’Intelligenza Artificiale, membro della Pontificia Accademia per la Vita con mandato sulla Intelligenza Artificiale, membro del New Artificial Intelligence Advisory Board dell' ONU, autore di libri sul ruolo dell'umano nella civiltà tecno-umana.

Ovunque si parli del profilo etico delle tecnologie e del ruolo della Intelligenza Artificiale nella vita dell'uomo, la presenza di Benanti è pertinente. È, tra l'altro, colui che ha coniato il termine Algoretica, cioè l'etica degli algoritmi. Da anni infatti si interroga e fa riflettere su come la tecnologia sia passata dallo status di strumento in mano all'uomo a quello di parte integrante dell'ecosistema sociale, e sempre più influente su questo ecosistema.

È sicuramente apprezzabile che Benanti abbia accettato di esporsi nel ruolo di Presidente della commissione: qualsiasi linea guida ne uscirà sarà certamente pertinente e di alto profilo. Paolo Benanti ama poi scherzare sul ruolo degli eticisti, come lui: gli eticisti fanno le domande e si tengono alla larga dalle risposte. Nel campo dell'etica le giuste domande sono infatti la cosa più importante, quelle che dovrebbero influenzare politici e stakeholders affinché affrontino i temi davvero rilevanti.

La domanda centrale posta dal lavoro di Paolo Benanti si può riassumere in questa: le macchine devono avere un'etica? Quale? Quali limiti ci sono e devono esserci nel rapporto tra la nuova specie delle macchine intelligenti e l'essere umano?

Gli eticisti non scendono in campo per dire cosa non si può fare o, peggio, pontificare su giusto e sbagliato, dice Benanti; il loro ruolo fondamentale su temi delicati e pervasivi della vita collettiva - com'è e come sarà sempre più l’Intelligenza Artificiale - deve essere appunto quello di porre le giuste domande, per far sì che le persone e le istituzioni ricerchino le risposte più adatte al contesto in cui operano. In questo il professor Paolo Benanti non potrà che essere eccellente: le persone, l'essere umano - in particolare nel loro rapporto con la tecnologia - sono sempre state al centro della sua attenzione.

Una volta tanto possiamo dire che in Italia abbiamo messo la persona giusta al posto giusto.

Conversazioni sull'Intelligenza Artificiale - Medicina, un salto culturale quantico

Gianluca Fuser: Alessio, tu ti stai occupando – nel tuo lavoro - di tecnologie di Intelligenza Artificiale applicate al mondo della cura veterinaria e questo ti dà l’opportunità di spaziare anche nell’ambito delle molte sperimentazioni destinate alla medicina umana. Che impressione hai del fermento che anima questo settore?

Alessio Panella: Un fatto certo è che nel settore della medicina veterinaria la sperimentazione si spinge più in là che in quello della medicina umana, purtroppo in virtù del fatto che gli animali non umani sono ancora e per lo più considerati sostituibili e di un ordine di importanza morale inferiore a quello degli umani – come tu ben sai.

Si testano, infatti, già sul campo applicazioni che interpretano le TAC in modo apparentemente esaustivo; c’è già chi pensa che il medico veterinario potrà ricevere il referto completo e definitivo senza quasi vedere le immagini.

L’ovvio vantaggio è in termini di riduzione dei costi e dei tempi operativi; forse si può aggiungere una maggiore attenzione ai fenomeni “fuori focus”, quelli spesso ignorati a causa della distorsione cognitiva del medico che – nell’immagine - cerca la patologia che già pensa di dover cercare e rischia di non notare segnali poco evidenti di altre patologie.

Nel campo della medicina umana, invece, ci si muove con maggiore prudenza. Ma non pensare che le applicazioni in sperimentazione o già in uso siano meno dirompenti.

Gianluca: Ad esempio?

Alessio: I casi sono moltissimi ma posso indicarti un paio di esempi secondo me molto rilevanti, che convergono su un obiettivo comune: ridurre la spesa sanitaria. In un caso per il sistema sanitario nazionale britannico (NHS), nell’altro caso per le assicurazioni private su cui si basa il sistema sanitario statunitense.

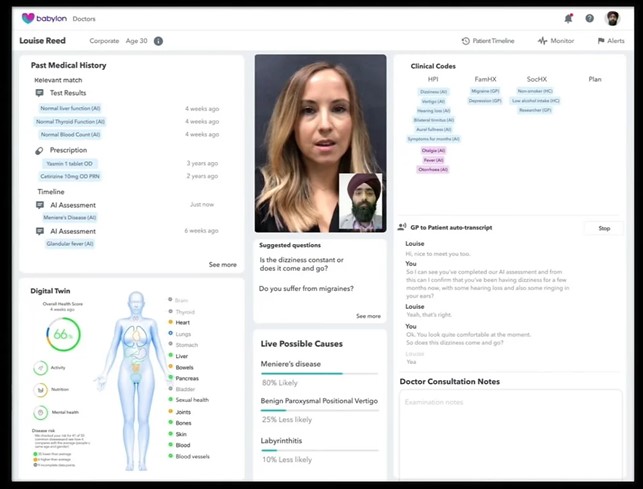

Per non tediarti, oggi affronterei il primo caso, quello di Babylon, un sistema di “visita a distanza” adottato in via sperimentale dal NHS in alcune aree di Londra. Il contatto tra medico e paziente avviene conversano in video: il paziente usa una app su smartphone, il medico la sua postazione con il suo personal computer.

Durante la conversazione Babylon mostra al medico la storia sanitaria del paziente mentre trascrive la conversazione e la interpreta: isola, cioè, i sintomi rilevanti riportati dal paziente, evidenziandone anche possibili collegamenti con patologie pregresse. Valuta poi inoltre anche il quadro complessivo dello stato di salute del paziente, anche in forma grafica, con una sorta di gemello digitale proposto sullo schermo.

Infine, assiste il medico nel lavoro diagnostico: in primo luogo, proponendo una serie di potenziali diagnosi basate sulla storia clinica, sui sintomi e sulle frequenze statistiche che “ha in pancia” e, in secondo luogo, suggerendo al medico le domande da fare per seguire un percorso organizzato di approfondimento e di diagnosi differenziale.

L’ultima funzionalità è quella con la quale il software analizza le espressioni facciali e la postura del paziente a schermo e informa il medico di eventuali stress o disagi che il paziente sta provando. In sostanza guida il medico anche nella relazione con il paziente, finché questi non sia sereno del risultato della visita.

Gianluca: Che parte svolge la IA in questo processo?

Alessio: Dalla A alla Z. Se vogliamo essere puntigliosi, l’unico passaggio che non è pervaso di IA è la cartella clinica, la storia sanitaria del paziente. Tutto il resto: interpretazione del linguaggio parlato, collegamenti, analisi dello stato di salute e delle espressioni facciali, proposte e suggerimenti, sono tutti guidati da programmi di IA. Che, è bene ricordarlo, sono basati principalmente su inferenze a base statistica.

Puoi vedere chiaramente che vantaggi si ribaltano sull’economia del NHS: meno presenza fisica sul territorio, meno spostamenti, visite più veloci, minori rischi di malattie professionali da contagio per i medici, probabilmente meno costi per accertamenti diagnostici, sicuramente minori costi di apprendistato per i medici di assistenza di primo livello.

Gianluca: Detta così, mi pare che ci possano essere dei vantaggi non trascurabili anche per i pazienti. Perlomeno si potrebbe pensare che – se lo staff medico nel suo complesso è dimensionato in maniera adeguata – si possa garantire una maggiore accessibilità dei servizi di prima assistenza per le situazioni non gravi e una maggiore efficacia nell’indirizzamento diagnostico o terapeutico. Oltre che, come dicevi prima, la possibilità di cogliere problemi fuori focus.

Alessio: Non sbagli affatto. Questi vantaggi ci possono essere di sicuro se – come puntualizzavi – lo staff è ben dimensionato e la base di conoscenza dell’applicazione è adeguata. Aggiungi anche che la somma di medico e di software che lo supporta possono garantire anche un tasso di errore diagnostico, a pari informazioni.

Gianluca: Quindi, non vedi problemi?

Alessio: Purtroppo alcuni problemi ci possono essere: se la “macchina” funziona bene, il medico – che dovrebbe essere la figura principale in questa relazione a tre – può essere meno competente o passare in secondo piano e rischia di diventare solo un tramite tra macchina e paziente. La tentazione per i gestori di un sistema sanitario che deve risparmiare è grande: riduzione dei percorsi professionalizzanti, standardizzazione verso il basso, passaggi delegati interamente alla macchina. Un altro rischio – connesso con la de-professionalizzazione dei medici di prima assistenza – è l’appiattimento delle diagnosi sulle frequenze statistiche.

Gianluca: Cosa significa? Che riconosciuti alcuni sintomi la macchina proporrà sempre la stessa diagnosi, perché statisticamente più frequente?

Alessio: Esattamente questo: se il medico non si impegna nella valutazione delle diverse possibilità di malattie che presentano gli stessi sintomi, in altre parole non fa la diagnosi differenziale, tutti sono malati della stessa malattia. Ma, soprattutto, tutti sono malati!

L’assenza di un contatto personale, di conoscenza del paziente, delle sue idiosincrasie e della sua storia – non solo di quella clinica - unite alla minore competenza e alla pressione “produttiva” sui medici possono fare il disastro.

Gianluca: Quindi i benefici che abbiamo visto prima si prospettano solo sul fronte del contenimento dei costi sanitari?

Alessio: Sì, se il governo di questo sistema complesso di medicina a distanza supportata dall’intelligenza artificiale non si focalizza sul termine “medicina”, cioè sulla pratica condotta da un medico, vero, capace e coadiuvato da macchine ben funzionanti. E se non dimentica il ruolo fondamentale del contatto di prossimità con il paziente.

Gianluca: Sono del tutto d’accordo con te: solo un’accorta gestione di questi processi può coniugare il contenimento dei costi e una maggiore attenzione per i pazienti.

Un ultimo punto, per oggi: dal punto di vista etico e della responsabilità, come vedi questa innovazione?

Alessio: Il problema della responsabilità è significativo: nel processo congiunto medico-macchina, quando viene commesso un errore chi si prende la responsabilità? Il medico o la macchina? Come hai già scritto su questo blog, c’è un’intera filiera di potenziali responsabili, che deve essere ordinata dal punto di vista legale e pratico – e parlo anche della necessità di trasparenza dei meccanismi di apprendimento e di esecuzione.

Quello che non va dimenticato, però, è il punto di vista del paziente: preferisce che il suo caso clinico venga analizzato da un dottore di 25 anni che si è laureato ieri l'altro e ha visto solo venti casi, oppure da un software che non sa come funziona ma che ha elaborato e sintetizzato 2 milioni di casi simili?

Quello che voglio dire è che l’entrata in campo di questi software è un urto culturale, che non riguarda la maggiore o minore possibilità di errore di una macchina rispetto ad un umano, ma chi commette l’errore.

All’estremo: noi accettiamo l’errore umano come naturale, se la diagnosi sbagliata del medico mi uccide è un umano come me che l’ha fatto. Ma se l’errore è della macchina? Accettare di essere uccisi da una macchina: ecco il salto quantico che ci impone questo cambiamento di paradigma culturale.

AI Act – La prima legislazione europea sull’Intelligenza Artificiale

Anno 45 a.C.: Giulio Cesare legifera sulla circolazione dei carri nei centri abitati – dall’alba alla metà del pomeriggio[1]. L’obiettivo è di snellire il traffico urbano, ridurre la sporcizia (sterco dei cavalli), l’odore e il rumore nelle strade durante il giorno (non è cambiato nulla, mi pare).

Anno 1865: in Gran Bretagna viene promulgato il Red Flag Act[2] che impone alle autovetture (self-propelled vehicles, la tassonomia è importante: distingue dalle vetture a cavalli) di avere un equipaggio di almeno 3 persone, di non superare la velocità massima di 4 miglia orarie sulle strade fuori città e di 2 miglia orarie in città, di essere precedute a 60 yarde da un uomo a piedi con una bandiera rossa che ne segnali l’arrivo, regoli il passaggio di carrozze e cavalli e, infine, faccia fermare il veicolo a motore in caso di necessità.

È una normativa stringente, finalizzata – oltre che a proteggere il lavoro dei vetturini pubblici – a garantire la sicurezza delle persone contro la minaccia del trasporto privato "self-propelled".

Anno 1903: entra in vigore il primo codice della strada organico a New York, a fronte della velocità che possono raggiungere senza sforzo, “effortless”, gli autoveicoli lungo le strade cittadine.

Anno 1929: con poco meno di 250.000 circolanti su tutto il territorio nazionale – nasce il Codice della Strada italiano, che vedrà alcune riedizioni e ammodernamenti, nel 1992 e quest’anno.

Queste normative hanno tutte come principale finalità il contenimento dei rischi per guidatori, passeggeri, passanti e cose a fronte del pericolo generato da una tecnologia: i mezzi di trasporto su strada.

E hanno influenzato lo sviluppo della tecnologia “automobile”, così come la tecnologia “automobile" ha orientato il nostro modo di vedere la realtà e le nostre dinamiche sociali, produttive, economiche - come rilevava Bruno Latour con la sua teoria dei Quasi Oggetti [3]

9 dicembre 2023, due giorni fa: l’Unione Europea – primo organo istituzionale al mondo a farlo – ha approvato l’AI ACT, piattaforma normativa sull’utilizzo delle tecnologie di intelligenza artificiale. [4]

“Un quadro giuridico unico per lo sviluppo dell'intelligenza artificiale di cui ci si può fidare. E per la sicurezza e i diritti fondamentali delle persone e delle imprese.”, dichiara Ursula Va Der Leyen [4].

L’obiettivo di questa legge è “garantire che l'IA protegga i diritti fondamentali, la democrazia, lo Stato di diritto e la sostenibilità ambientale”, permettendo uno sviluppo efficace ma “sicuro” delle innovazioni.

Tra le norme “in negativo” si evidenziano:

“i sistemi di categorizzazione biometrica che utilizzano caratteristiche sensibili, come le convinzioni politiche, religiose e la razza; la raccolta non mirata di immagini del volto da Internet o da filmati di telecamere a circuito chiuso per creare database di riconoscimento facciale; il riconoscimento delle emozioni sul posto di lavoro e nelle scuole; il social scoring; le tecniche manipolative; l'IA usata per sfruttare le vulnerabilità delle persone.” [4]

In positivo, invece, vigerà l’obbligo alla “valutazione dell'impatto sui diritti fondamentali.” [4] Delle applicazioni di IA.

Il punto critico che ha reso complessa la negoziazione è l’utilizzo delle tecnologie di IA da parte delle forze dell’ordine, soprattutto per il riconoscimento biometrico e in tempo reale e la polizia predittiva.

“Alla fine i negoziatori hanno concordato una serie di salvaguardie e ristrette eccezioni per l'uso di sistemi di identificazione biometrica (RBI) in spazi accessibili al pubblico ai fini di applicazione della legge, previa autorizzazione giudiziaria e per elenchi di reati rigorosamente definiti” [4]

Al di là delle specifiche indicazioni normative, va notato che:

- Le istituzioni comunitarie europee hanno adottato un punto di vista molto concreto sull’IA, in cui prevale il suo carattere di tecnologia, con usi ed effetti privati e pubblici

- In quanto tecnologia, come accadde per gli autoveicoli dal 1865 in poi, ne ha considerato i rischi per i soggetti che rappresenta: popolazione e tessuto produttivo, e ha – conseguentemente - imposto delle misure di controllo e di contenimento di questi rischi.

- Nell’ambito dei rischi da contenere, sono stati privilegiati quelli che riguardano la discriminazione, l’invasione del territorio emotivo personale, la manipolazione dei comportamenti e i danni fisici e psicologici agli individui.

- Inoltre, è stata posta una particolare attenzione sulle tecnologie IA definite “ad alto impatto”[5], che includono i sistemi di IA generale-generativa, come Chat GPT 3.5, per i quali è obbligatoria “l’applicazione ex ante delle regole su sicurezza informatica, trasparenza dei processi di addestramento e condivisione della documentazione tecnica prima di arrivare sul mercato”. [4]

In poche parole, i produttori dovranno rendere pubblico come viene addestrato il sistema e su quali basi!

L’IA, con questa normativa, viene assimilata a molte altre tecnologie, anche dal punto di vista del legislatore, perde una parte dell'aura di mito contemporaneo,

viene collocata nella sua “rete di relazioni, che si estende ben oltre la sua forma”[7]

e – dopo la glorificazione dei potenziali vantaggi già avvenuta in molte sedi istituzionali [6] -

i rischi che genera vengono affrontati in modo concreto

come accade, almeno dal 45 a.C., per tutte le nuove tecnologie.

NOTE

[1] Lex Iulia Municipalis, https://www.archeologiaviva.it/4055/rumore-e-traffico-in-citta-un-problema-di-sempre/#:~:text=Gi%C3%A0%20nel%2045%20a.C.%20Giulio,circa%20le%20cinque%20del%20pomeriggio).

[2] https://vlex.co.uk/vid/locomotives-act-1865-808255757

[3] Bruno Latour, Non siamo mai stati moderni, Eleuthera, 2018

[4] https://www.rainews.it/articoli/2023/12/intesa-ue-per-la-legge-su-intelligenza-artificiale-breton-momento-storico-97d8b5ca-141f-4284-a6fb-434b9871ee01.html

[5] Categorizzate per potenza di elaborazione almeno pari a 10^25 FLOPs (floating point operations per second, un criterio tutto sommato più adeguato di quello proposto precedentemente sul fatturato dell’impresa.

[6] Si veda il mio post del 24 ottobre 2023, Etica, morale e intelligenza artificiale, https://www.controversie.blog/etica-intelligenza-artificiale-un-approccio-analitico-e-normativo/

[7] Bruno Latour, Non siamo mai stati moderni, Eleuthera, 2018

La carne coltivata come «cibo del futuro»? - Controversie tra scienza e pubblici

Il 16 novembre scorso è stata approvata dal parlamento italiano una legge che, tra le altre cose, mette al bando la carne coltivata in laboratorio, prevendendo multe da 10.000 a 60.000 euro per chiunque la somministri, produca o distribuisca sul territorio italiano. Questa legge rende anche illegale qualsiasi riferimento a terminologie legate alla carne e alla macelleria per prodotti a base vegetale che “imitano” quelli tradizionalmente legati ai cibi animali[1]. La mossa del Ministro dell’Agricoltura e della Sovranità Alimentare Lollobrigida (sostenuto dal principale sindacato agricolo italiano, Coldiretti) va chiaramente nella direzione della difesa di un’industria che – per quanto nascosta sotto l’idea del “made in Italy” – di italiano ha ben poco, dal momento che importiamo fino al 60% del fabbisogno nazionale di carne.

Va innanzitutto ricordato che si tratta di una legge di per sé vuota, dal momento che la carne coltivata in laboratorio non ha ancora l’approvazione dell’EFSA, l’agenzia europea che vaglia i cosiddetti novel food prima che siano immessi sul mercato. Qualora invece dovesse essere approvata, la legislazione europea avrebbe la priorità su quella nazionale, per cui la legge italiana diventerebbe una barriera alla libertà di commercio all’interno dell’UE. Si potrebbe in ogni caso aprire una procedura di infrazione nei confronti dello stato italiano.

Vale tuttavia la pena ragionare attorno alle ragioni e ai posizionamenti che emergono dal dibattito su questa legge. Il governo Meloni, conservatore e reazionario, si pone a difesa della salute dei cittadini, delle “tradizioni” e dell’agricoltura “buona” che (in questa costruzione) si pratica nel nostro paese. Coloro che osteggiano la legge, e che invece favoriscono questo nuovo cibo, suggeriscono che l’Italia perda così l’occasione di investire e fare ricerca su una “materia” che diventerà sempre più centrale nel mercato alimentare, fornendo delle risposte ai problemi legati all’industria della carne, tra cui quelli ambientali, di salute e di benessere animale[2].

Ciò che maggiormente colpisce di questo dibattito pubblico è la sua polarizzazione, ossia come sia possibile essere o dalla parte della carne tradizionale, dell’allevamento animale e di una dieta onnivora o dalla parte dell’innovazione alimentare sotto l’egida del biocapitale. In realtà, entrambe le parti sono schiacciate su ciò che c’è: da un lato, il paradigma esistente (e romanticizzato) della produzione agricola e delle tradizioni, dall’altro il dogma scientifico del progresso e della “soluzione” tecnologica alle sfide del presente[3]. Si potrebbe dire che in entrambi i casi si tratta di una forma di protezione nei confronti dell’ansia che le crisi odierne ci pongono di fronte, una reattiva e una che vede nelle “narrazioni promissorie”[4] dell’innovazione la possibilità di mantenere lo status quo pur di fronte agli sconvolgimenti dell’Antropocene.

Nella polarizzazione del dibattito sulla carne colturale si discute se sia meglio quella animale o quella fatta nel bioreattore. Tertium non datur. Eppure, un discorso circa la riduzione del consumo di carne e derivati animali, se non addirittura la loro eliminazione, è non solo disponibile ma anche supportato scientificamente per i suoi benefici sulla salute umana e del pianeta[5]. Nell’Occidente a capitalismo avanzato non abbiamo nessuna deficienza proteica a livello di popolazione, anzi, siamo in marcato sovrappiù. Non c’è nessuno bisogno “nutrizionale” di inventare alternative alle proteine animali, perché possiamo già fare senza, o con quantità estremamente ridotte. L’avvento di forme di carne o proteine “sostenibili” tende ad accreditare l’importanza, la piacevolezza e il significato stesso di questi prodotti. Potrebbero addirittura, per un ironico effetto di rimbalzo, aumentarne il consumo complessivo. È necessario allora approcciare in modo critico, ma al contempo complesso, questo tema, oltre la polarizzazione ma favorendo il senso critico.

La “cassetta degli attrezzi” dell’ecologia politica può essere utile dal momento che, pur non demonizzando l’innovazione e la tecnologia come mediazione e strumento imprescindibile di convivenza tra umano e non umano, ne considera i regimi di potere e sapere, di dominio ed esclusione, di proprietà e accesso[6]. In quest’ottica non esistono forme di relazione neutre, innocenti o naturali: non lo sono le pratiche di allevamento “tradizionali” (in costante ri-definizione a seconda di tecnologie emergenti e fortemente determinate da materie di sintesi come i farmaci), non lo è la carne coltivata, che non è una mera “risposta” ai problemi delle proteine animali ma un dispositivo che ridefinisce piuttosto che pacificare la questione.

L’ecologia politica, in ottica intersezionale, pone alcuni nodi di attenzione. Quello della classe, ad esempio: può un’innovazione supportata da capitali ad alto rischio e multinazionali del bigtech o della carne tradizionale garantire l’accesso a cibo nutriente per i settori più fragili della popolazione? Chi avrà accesso a questo alimento? Inoltre, la carne colturale promette di riarticolare i rapporti di genere, razza e classe – superando la cultura del macello che rende gli animali non umani mera “cosa” disponibile, e così anche problematizzando quelle analogie che supportano il dominio su soggetti femminilizzati e razzializzati in quanto “animali”, “bestie da soma”[7], “carne da macello”[8].

Tuttavia, un’innovazione di per sé non sarà capace da sola di riarticolare questi assi di dominio, che potrebbero anzi riproporsi su scala diversa se le radici sociali, politiche e culturali che la supportano non sono problematizzate. Similmente, è da chiedersi se la promessa di liberare spazi agricoli oggi dedicati alla produzione animale possa davvero intendersi nei termini di una “liberazione” dei territori, o invece come una loro messa a disposizione per nuove recinzioni e valorizzazioni. Tanto più che la carne colturale oggi non si delinea come una sostituzione della carne tradizionale, ma un’aggiunta sul mercato.

Tocca chiedersi allora: a che cosa e a chi serve l’innovazione? Viene presentata come necessaria per soddisfare una richiesta globale in aumento, nell’evidenza che una riduzione del consumo non si è verificata negli ultimi decenni. Tuttavia, questa premessa è basata su un presente in cui il consumo di carne è favorito a livello culturale, economico, scientifico. L’utilità sociale reale in questo contesto non è per nulla data, ma eventualmente da verificare collettivamente, così come la distribuzione delle risorse che ne sostengono la ricerca e la produzione.

La prospettiva dell’ecologia politica in questo senso problematizza l’innovazione alimentare ma non per dismettere qualsiasi tecnologia o idealizzare delle pratiche contadine “tradizionali” come depositarie di un rapporto idilliaco e naturale con l’ambiente. Al contrario, mettendo in discussione la dicotomia naturale/artificiale, pone delle domande politiche circa quali tecnologie possano aiutarci a ristabilire dei rapporti di equilibrio dinamico con il resto della biosfera nel senso di una giustizia non solo ecologica ma anche sociale.

Le destre si collocano in uno spazio di critica al capitale globale in modo populista: indicando in astratte “multinazionali” e “capitale del big-tech” le responsabili dei rischi, della standardizzazione alimentare, e della perdita di sovranità alimentare della popolazione. Questi discorsi intrecciano paure e risentimenti reali, che si intensificano in momenti di incertezza e precarizzazione quali quelli che viviamo. Si possono però nominare e criticare le radici sistemiche delle ingiustizie alimentari: capitalismo, patriarcato, colonialismo, razzismo e specismo sono la matrice di potere che attraversa e dà forma non soltanto all’innovazione alimentare ma alle diete del presente nel loro complesso (carne “tradizionale” inclusa). L’ecologia politica propone allora una lotta per la giustizia ambientale e alimentare nella contestazione di questi assi di potere, e in una riappropriazione dei mezzi tecnologici per sperimentare nuove relazioni sociali, ecologiche, interspecie.

NOTE

[1] https://www.corriere.it/politica/23_novembre_16/carne-coltivata-divieto-legge-il-governo-rispetta-agricoltori-3b7998e6-84c0-11ee-87a1-ab403d0b1b3f.shtml

[2] https://www.wired.it/article/carne-coltivata-sintetica-camera-approva-divieto/

[3] https://effimera.org/di-carne-post-animale-e-altre-forme-di-innovazione-alimentare-appunti-di-ecologia-politica-per-una-lettura-critica-e-intersezionale-di-alice-dal-gobbo/

[4] Jönsson, E. (2016) ‘Benevolent technotopias and hitherto unimaginable meats: Tracing the promises of in vitro meat’, Social Studies of Science, 46(5), pp. 725–748. Available at: https://doi.org/10.1177/0306312716658561.

[5] Mazac, R. and Tuomisto, H.L. (2020) ‘The Post-Anthropocene Diet: Navigating Future Diets for Sustainable Food Systems’, Sustainability, 12(6), p. 2355. Available at: https://doi.org/10.3390/su12062355.

[6] Per un approfondimento su questo e ciò che segue, si veda il già citato articolo https://effimera.org/di-carne-post-animale-e-altre-forme-di-innovazione-alimentare-appunti-di-ecologia-politica-per-una-lettura-critica-e-intersezionale-di-alice-dal-gobbo/, o: Dal Gobbo, A. (2023) ‘Of post-animal meat and other forms of food innovation: a critical and intersectional reading from the perspective of political ecology’, Consumption and Society, 1(aop), pp. 1–10. Available at: https://doi.org/10.1332/RVDO1043.

[7] Taylor, S. (2021) Bestie da soma. Disabilità e liberazione animale. Edizioni degli Animali; si veda anche Ko, A., & Syl, K. (2020). AFRO-ISMO. Cultura pop, femminismo e veganismo nero. VandA edizioni.

[8] Adams, Carol. Carne da macello. La politica sessuale della carne. Una teoria critica femminista vegetariana (2020).

La vicenda di Indy Gregory - Chi ha paura del dubbio?

La vicenda di Indi Gregory si può esaminare da varie angolazioni.

Quella che mi interessa di più - a posteriori - non è nel focus principale del caso, ovvero se fosse giusto o meno staccare le macchine e a chi spettasse la decisione ultima.

Su questi punti è stato detto e scritto moltissimo nei giorni scorsi e possiamo trovare tutte le sfumature di opinioni che vanno da “vita a tutti i costi” fino a “staccare le macchine al più presto” [1].

Ognuno di noi avrà la sua posizione in proposito che deriva da sensibilità e background.

Si è parlato molto poco, invece, di come queste argomentazioni siano state presentate all’opinione pubblica e di come abbiano parlato gli “addetti ai lavori”.

Secondario? Non credo, perché nel modo di porre le questioni si gioca una partita di potere culturale.

Diciamo comunque che abbiamo assistito a polemiche feroci decisamente brutte. Decisamente brutte perché il rispetto per il dolore avrebbe suggerito toni diversi e una minor divisione in fazioni con sentori partitici.

Ma torniamo al punto che più mi interessa; mi è dispiaciuto vedere che tutta la vicenda è stata trattata con molta intransigenza da coloro che hanno sostenuto la decisione del tribunale inglese di staccare le macchine, come se una posizione che nasce dalla conoscenza scientifica e dal suo approdo legale, non potesse essere messa in discussione. Naturalmente sto generalizzando, ma chiunque abbia letto i giornali credo convenga con me che “la scienza” ha sdegnosamente rifiutato le ragioni del “sentimento”, forse anche ingenuo.

Abbiamo sentito e letto molte affermazioni tranchant da parte dei medici sull’inutilità e disumanità di prolungare una vita come quella di Indi.

Ma qui sorge una questione non da poco: se sei medico sicuramente valuti meglio la situazione di un paziente e le sue prospettive, ma questo ti dà realmente maggior voce in capitolo sulla decisione finale? Ovvero il tuo giudizio vale più di quello di un cittadino normale? Ovvero appartieni a una categoria eletta (insieme ai giudici) che da sola può stabilire il punto di non ritorno?

Sembrerebbe, in molti addetti ai lavori, che la decisione sia solo un saldo tra voci attive e voci passive. La riduzione in voci attive e passive di sentimenti, emozione, dolore, appare come qualcosa di assurdamente freddo.

Tutto il mondo che ha spinto per lo stacco immediato delle macchine mi è sembrato come arroccato su posizioni che non potevano essere messe in discussione per nessun motivo.

Posizioni col bollino della scientificità, quindi indiscutibili, e voi che scienziati non siete dovete stare zitti, tanto non capite.

Il refrain costante dei giorni che hanno preceduto il distacco delle macchine è stato “quella non è vita e va chiusa al più presto”, affermazione categorica senza possibilità di replica, e chi replicava veniva tacciato di visione oscurantista e reazionaria. Per contro, lasciando da parte gli ultras delle posizioni ultra cattoliche, non si può non notare la prudenza di un giornale come l’Avvenire, che notoriamente riflette le posizioni della CEI, e dello stesso Papa Francesco.

Dietro questa rigidità nel voler chiudere la questione Indi al più presto tacciando di ignoranza reazionaria idee diverse, vedo un brutto fantasma, la soddisfazione di sentirsi categoria eletta (da chi?) e quindi “migliore”.

C’è una grande differenza tra spiegare perché - forse - staccare le macchine sia la decisione migliore e l’atteggiamento di chi non ha voluto neppure prendere in considerazioni opzioni diverse.

E ancora, contesto i molti che hanno detto “con migliaia di bambini sani che muoiono in guerre di cui sono vittime sacrificali, occuparsi di Indi è una sorta di perdita di tempo”.

Non è vero. La tragedia dei bambini di Gaza e dei mille altri posti dove sono vittime, non sminuisce la questione Indi. La vicenda della bambina di Nottingham non interferisce con lo sdegno per le morti innocenti a Gaza; questa argomentazione sembra un pretesto per chiudere in fretta la questione senza rompiscatole che si fanno prendere da dubbi pietistici.

In definitiva, credo che se le ragioni della scienza non tengono conto anche delle ragioni del sentimento si sfocia nell’arroganza di chi si sente investito dalla ragione e sfugge al confronto. Insopportabile.

NOTE

[1] Ecco, in proposito, alcuni link a diverse posizioni:

https://www.avvenire.it/rubriche/pagine/indi-gregory-nella-scelta-tragica-i-veri-esclusi-sono-stati-i-genitori

https://www.quotidianosanita.it/cronache/articolo.php?articolo_id=118216

https://www.nicolaporro.it/indi-gregory-deve-morire-tre-motivi-per-cui-nicola-porro-sbaglia/

https://www.scienzainrete.it/articolo/caso-indi-qualche-domanda-riflettere/giovanni-boniolo/2023-11-12

https://www.ilprimatonazionale.it/approfondimenti/indi-gregory-la-disumanita-di-una-societa-che-tratta-la-vita-come-carta-straccia-271155/

https://www.repubblica.it/cronaca/2023/11/12/news/borgna_intervista_caso_indi_gregory-420134627/

https://www.imolaoggi.it/2023/11/14/remuzzi-per-indi-scelta-giusta/

La vicenda di Indi Gregory - L'opzione del silenzio

«Ciò che viene di solito impedito non è l’espressione,

bensì la formazione di un opinione propria»

(G. Anders, La catacomba molussica).

Ciò che diverrà la norma, ammoniva Deleuze all’inizio degli anni ’90, sarà avere un'opinione su tutto, necessariamente. Significa essere forzati allo schieramento, per quanto grottesco esso sia.

Come resistere a questa fiumana d’inumanità?

Non lasciandosi trascinare dal tempo della responsabilità, precedente all’atto, e neppure da quello successivo delle colpe, proprio del fatto compiuto.

Abbiamo perso la memoria dello spazio di mezzo, eroso dal richiamo quasi militaresco al giudizio forzato,

adombrato dal costante accanimento della cacofonia mediatica:

il silenzio.

Le religioni (dal latino religāre, unire insieme) fanno del silenzio (dal sancrito Si-nâmi, il lego) una legatura. Raccoglimento invisibile per sua stessa costituzione.

Perciò stesso, effimera fonte d’umanità.

Se credete di perdere l’occasione di dire la «cosa giusta», di farvi scappare l’opinione migliore su ciò che «bisognava fare», allora non avrete compreso di condannare in tal modo una vita infranta alla parodia, di fare delle vostre parole una commedia «all’italiana» dipinta su di un corpo inerme.

Il silenzio è la madre del dubbio, il dubbio la sorgente del pensiero.

La vicenda di Indy Gregory - Paradossi nascosti

La storia triste e dolorosa della fine di Indi Gregory occulta alcuni paradossi:

- Il primo è – a mio avviso - il più clamoroso: il giudice, per decidere nel miglior interesse del soggetto [1], come impone la legge britannica, ha deciso di sopprimere sia l’interesse che il soggetto.

- Il secondo paradosso è che i tutori del minore, che dovrebbero avere il dovere e anche il diritto di tutelare, come prima cosa, la vita della figlia minore e, come seconda cosa, i suoi interessi, per decisione di medici e di un giudice non hanno potuto farlo

- Il terzo paradosso è che i medici che dovrebbero tutelare la vita dei pazienti – come detta la deontologia professionale, che si rifà ad Ippocrate - medici che hanno dichiarato che la bambina non era in condizioni di sofferenza e probabilmente non aveva funzioni cerebrali, hanno optato per non difendere la vita, pur non trovandosi in condizioni di accanimento terapeutico.

- Ultimo paradosso: se le funzioni cerebrali (in ottica riduzionista) sono la condizione necessaria alla coscienza di piacere e di dolore, allora la bambina non aveva coscienza (consapevolezza) del dolore.

Se invece le sensazioni (in ottica meno riduzionista) possono essere oggetto di coscienza anche “fuori” dalle funzioni cerebrali, allora la bambina aveva coscienza del dolore, ma anche del piacere, e l’equilibrio tra le sue sensazioni non poteva essere noto.

In entrambe le opzioni la scelta del miglior interesse è opaca e paradossale.

NOTE

[1] Di seguito due estratti della motivazione del giudice inglese, Robert Peel:

«With a heavy heart, I have come to the conclusion that the burdens of invasive treatment outweigh the benefits. In short, the significant pain experienced by this lovely little girl is not justified when set against an incurable set of conditions, a very short life span, no prospect of recovery and, at best, minimal engagement with the world around her. In my judgment, having weighed up all the competing considerations, her best interests are served by permitting the Trust to withdraw invasive treatment in accordance with the care plan presented»

«The evidence clearly establishes that she experiences significant pain and distress several times a day, and each painful episodes lasts up to ten minutes. It has been observed by Dr E, other clinical team members, the nursing staff, and the Guardian, all of whose evidence I accept. The descriptions of her wincing, struggling to breathe, gasping and developing tears in her eyes are vivid. Such pain is caused by her multiple treatment interventions including invasive ventilation, suctioning, use of IV lines, blood tests and the like. It will continue for as long as the interventions continue»